AleQwerty

Usuario (Argentina)

que las ondas de radio. Uno de los mayores problemas en las comunicaciones entre la Tierra y las naves o satélites enviados al espacio es el retardo que se produce desde que se envía la señal de datos hasta que se recibe. Desde tierra hasta un satélite en órbita baja este tiempo es pequeño, pero cuando se sitúa a 35.000 km como los geoestacionarios la cosa cambia y se tarda mucho tiempo en enviar o recibir información. Los próximos sistemas de comunicaciones de la NASA abandonarán las señales de radio en favor de una nueva tecnología de comunicación basada en la luz llamada Laser Communications Relay Demonstration (LCRD), la cual está siendo desarrollada actualmente por la NASA y que promete una tasa de transmisión de datos entre 10 y 100 veces mayor que la actual basada en radiofrecuencia. El dispositivo se denomina ILLUMA (Integrated LCRD LEO User Modem), del tamaño de un teléfono, por lo que será bastante más pequeño que los actuales dispositivos de comunicaciones de los satélites, y los chips que usan pueden ser todos impresos mediante técnicas litográficas como los procesadores actuales. La longitud de onda de los láseres empleados en la comunicación es muchísimo más pequeña (varios órdenes de magnitud) que la de las ondas de radio, con el consiguiente ahorro de energía y mayor ancho de banda aprovechable para las señales ópticas, lo que permitiría obtener imágenes de alta resolución de forma casi instantánea, lo que facilitaría el estudio de fenómenos atmosféricos entre otras aplicaciones. Se espera que las primeras comunicaciones gracias a este nuevo sistema comiencen en 2017. Sin embargo, no se trata del primer intento de comunicación basada en láseres. En 2013, como parte del proyecto Lunar Atmosphere and Dust Environment Explorer (LADEE), se consiguió en un enlace de comunicación con la órbita lunar una velocidad de descarga de datos de 622 megabits por segundo (Mbps) y una de subida de 20 Mbps.

La NASA está de enhorabuena, ya que el Congreso de los Estados Unidos ha asignado a la compañía un presupuesto para 2016 de 90 millones de dólares, seis veces más de lo que se había solicitado inicialmente. Gracias a esta inyección de dinero la NASA comenzará el próximo mes de febrero la primera etapa de fabricación del que será su observatorio especial insignia, hablamos del telescopio WFIRST (Wide Field Infrared Survey Telescope), que tendrá un campo de visión 100 veces mayor que el del telescopio espacial Hubble (HST) y permitirá el estudio de la materia oscura, exoplanetas, y sistemas solares lejanos. Con un espejo de 2,4 metros de diámetro, al igual que el Hubble, este nuevo telescopio contará con un innovador sistema que le permitirá captar longitudes de onda infrarrojas a mayor profundidad y tomar imágenes a una resolución de 300 megapíxeles. Además, estará equipado con un coronógrafo que bloquea las superficies muy brillantes permitiendo visualizar de forma directa decenas de gigantes gaseosos y de hielo alrededor de otras estrellas y exoplanetas con mayor detalle. No será hasta el 2024 que la NASA ponga en órbita a WFIRST para descubrir los misterios que se esconden en el espacio, ya que será cuando sea puesto en órbita en el punto L2 (segundo punto de Lagrange), localizado a 1,5 millones de kilómetros de la Tierra.

Según un informe recientemente publicado por Panda Security, los expertos detectaron el pasado año un aumento récord de nuevos tipos de malware. Concretamente 84 millones, por lo que más de una cuarta parte (el 27,63%) de todo el malware jamás creado se ha lanzado a la red en los últimos 12 meses. Estás serían las principales amenazas según el informe: Troyanos: 51,45% del nuevo malware creado en 2015, y causante del 60,30% de las infecciones en el mismo período.Virus: 22,79% del malware, pero responsables únicamente del 2,55% de las infecciones.Gusanos: 13,22% del malware, no mucho más eficientes que los anteriores: 2,98%.PUP o programas potencialmente no deseados: Representan el 10,71% de los nuevos softwares maliciosos… y el 28,98% de las infecciones.Spyware / adware: se sitúa en último lugar en número de muestras de nuevo malware con un 1,83%, pero le debemos el 5,19% de las infecciones. Pero si hay una amenaza que requiere de atención especial esta es, sin duda, Cryptolocker: este ransomware se alzó, a ojos de Panda Security, como el gran protagonista de los ciberataques realizados a lo largo de 2015. Según Luis Corrons, director técnico de PandaLabs: “Cryptolocker es la mejor apuesta para los cibercriminales, ya que constituye una de las maneras más sencillas de conseguir dinero. Además, ha demostrado ser muy eficaz, sobre todo en el caso de las empresas que no piensan dos veces antes de pagar para recuperar su información robada”.

incluso configurando la privacidad. Desde su lanzamiento, Windows 10 ha tenido que hacer frente a lo largo y ancho del mundo a acusaciones que lo etiquetaban de ser un spyware. El asunto ha llegando bastante lejos, protagonizando muchas noticias y agrios debates en la red. Hasta ahora muchos creían que deshabilitando las características que podían comprometer la privacidad y el envío de la telemetría ya estaban protegidos, sin embargo eso no es la realidad, ya que Windows 10 todavía es capaz de realizar funciones de seguimiento, según un análisis realizado por un usuario de Voat llamado CheesusCrust. Para averiguar sí Wnidows 10 seguía enviando datos incluso después de ajustar las opciones de privacidad, instaló el sistema operativo en una máquina virtual en un portátil con Linux como sistema anfitrión, y utilizó un router DD-WRT para monitorizar el tráfico. Deshabilitó las características que podían comprometer la privacidad y el envío de la telemetría, para luego dejar la máquina virtual funcionando durante toda la noche, todo con el fin saber qué tráfico generaba Windows 10 en esas condiciones. Ocho horas después (suponemos que después de dormir), el usuario CheesusCrust encontró que el sistema operativo intentó realizar 5.500 conexiones a 93 direcciones IP diferentes, de las cuales casi 4.000 se hicieron a IP pertenecientes a Microsoft. Después de dejar la máquina virtual encendida durante 30 horas, Windows 10 había expandido sus conexiones a 113 direcciones IP no privadas, abriendo las puertas a que el tráfico fuese interceptado por un hacker. Luego el usuario de Voat hizo otra prueba reinstalando Windows 10 en una máquina virtual, y después de utilizar una herramienta de terceros llamada DisableWinTracking, dejó el sistema quieto y encendido durante 30 horas, viendo que el número de conexiones se había reducido hasta los 2758, que se hicieron a 30 direcciones IP diferentes. Es importante mencionar que se utilizó Windows 10 Enterprise Edition para las pruebas, debido a que ofrece un mayor control por parte de los usuarios sobre el sistema. ¿Un problema sobredimensionado? Hasta ahora todo tiene apariencia de polémica, pero, ¿qué tráfico se está enviando? La realidad es que no es tan sencillo de saber, porque uno puede pensar en los datos personales de uno, sin embargo perfectamente se puede tratar del tráfico generado por las peticiones de actualizaciones y otras tareas que realiza el sistema operativo, que no tienen nada que ver con los datos del usuario. Microsoft se defiende diciendo que recolectan “una cantidad limitada de información para ofrecer una experiencia segura y confiable. Esto incluye una identificación anónima del dispositivo, el tipo de dispositivo y los cuelgues de las aplicaciones”, que Microsoft y sus socios utilizan para mejorar la confiabilidad de la aplicación. Aquí tenemos una cantidad de datos nada despreciable que pueden ser enviados a Microsoft y que no corresponden a ninguno personal del usuario. Microsoft podría reaccionar ante esta situación Forbes recoge que Microsoft se podría estar planteando muy en serio el dar más control a los usuarios sobre qué datos envía Windows 10 a sus servidores, en un intento de aplacar la polémica y borrar la fama de spyware que arrastra su último sistema operativo para ordenadores x86. Sin embargo desde el medio económico recuerdan que el pasado mes de septiembre la compañía prometió algo en la misma dirección, sin que aparentemente se haya dado grandes pasos al respecto. Todo apunta a que la compañía se está planteando darle control total a los usuarios sobre los datos que pueden ser enviados a sus servidores, y posiblemente esa sea la única salida real para un problema que se ha convertido en toda una mancha en la reputación de Windows 10.

Las baterías de Apple, Samsung, LG y más usan cobalto minado por niños en África Un nuevo informe de Amnistía Internacional asegura que el cobalto de las baterías de muchos dispositivos provienen de mano de obra infantil. El cobalto es un elemento muy común en las baterías de ion de litio usadas por la mayoría de los smartphones y tablets del mercado, el problema está en su procedencia y cómo se ha minado. Más de la mitad del cobalto de todo el mundo procede de la República Democrática del Congo, yel 20% proviene de mineros locales que minan y recogen el material a mano y se lo venden a los distribuidores, que a su vez se lo venden a los fabricantes. El cobalto de las baterías de tu smartphone puede venir de la mano de niños Entre estos mineros locales hay muchos menores de edad, incluso niños de siete años, denuncia Amnistía Internacional. Según la investigación, en estas minas no se garantizan los derechos humanos, pero la mayoría de jóvenes tiene que trabajar para permitirse la educación primaria, que puede costar hasta 30 dólares cada mes. Seguir el rastro de la procedencia de los minerales es muy difícil, como ha confirmado Microsoft, y necesitaría de una colaboración de todas las compañías implicadas. Apple por su parte asegura que está evaluando docenas de materiales además del cobalto para resolver los problemas laborales y medioambientales que produce su exportación. Microsoft y Apple son sólo dos de las compañías en la lista de fabricantes que usan el cobalto proveniente de estos mineros locales del Congo, a través de la compañía china proveedora Huayou Cobalt. Motorola, Dell, HP, Huawei, Lenovo, LG, Samsung, Sony y Vodadone también usan sus servicios, además de fabricantes de coches como Daimler (Mercedes-Benz) y Volkswagen.

Tras conocer el Star Wars: Trials on Tatooine, Ubisoft también se plantó en la Games Developrs Conference anunciando una experiencia de realidad virtual con una de sus mejores franquicias, hablamos del Assassin’s Creed . En este caso será un spin-off del juego basado en la película del juego que llegará a los cines el próximo año. Bajo el nombre de Assassin’s Creed VR Experience. Estamos así ante otra “experiencia cinematográfica” (y no un juego ) que usará escenas filmadas de la película junto a la tecnología de realidad virtual para meternos en el papel de un ancestro asesino español en el siglo XV. Por desgracia, no tenemos ni tan siquiera un vídeo que nos muestre el trabajo de la desarrolladora, la cual colabora con FOX y Practical Magic para llevar hacia delante el proyecto.

El navegador Vivaldi ha sido desarrollo por el cofundador de Opera Software, y fue presentado como beta el año pasado. Ahora ha salido de esa beta para convertirse en un producto finalizado en su forma actual, aunque eso no significa que no vaya a seguir evolucionando poco a poco. Este navegador utiliza el motor de renderizado Blink, la bifurcación de WebKit desarrollada por Google para incluir en Chrome, y que también usan en Opera. Por tanto las páginas se verán igual que en Chrome, pero hace un mejor uso de los recursos del sistema, algo necesario para los equipos menos potentes. Entre las características que se incluyen en el navegador se encuentran la posibilidad de tomar notas, disposición de pestañas apiladas y en mosaico, soporte a las extensiones de Chrome, y la posibilidad de mantener una segunda web abierta en la misma ventana como un panel independiente. Los atajos de teclado son personalizables para los que hagan un fuerte uso de ellos.

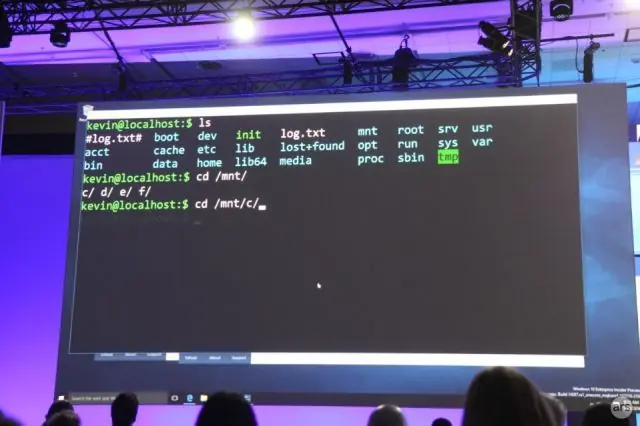

En los últimos días, hemos visto aparecer en escena una buena cantidad de pruebas que hablan del fuerte interés que tiene Microsoft en poder generar alianzas con distintas firmas para llevar Linux a su sistema operativo Windows. De hecho, habíamos sido testigos anteriormente de un Bash de Linux que aparecía de forma nativa en Windows 10, algo que luego fue confirmado durante la Build 2016 de la compañía de Redmond, mientras los usuarios esperan detalles al respecto, considerando que nunca ha habido tantas pruebas de una intención de acercamiento de Windows a Linux. Linux le queda cada vez más cerca a Windows Ahora bien, muchos se preguntarán entonces de dónde nace este repentino interés de Microsoft por acercarse a Linux, y no es que estén especialmente atraídos sus ingenieros por este sistema operativo alternativo, sino más bien por la enorme cantidad de desarrolladores que lo siguen prefiriendo para sus productos antes que a Windows debido a las herramientas internas que podemos encontrar en él. No por nada hablábamos del Bash, que es uno de los elementos constituyentes más clásicos de las distribuciones GNU/Linux, pues se trata del encargado de ejecutar los distintos comandos. En efecto, este sistema funciona a través de comandos de texto, y es por eso que Microsoft habría alcanzado algunos acuerdos comerciales con Canonical, a fin de poder llevar la versión de Ubuntu a Windows 10 y lanzarla junto con la gran actualización del primer aniversario de este sistema operativo que saldrá en julio próximo. De este modo, parece que Microsoft quiere ofrecer algo más que emulaciones, para dar el salto al soporte nativo para estos otros entornos, de forma que se pudieran instalar y ejecutar elementos como Ruby, Redis o emacs, atrayendo a desarrolladores de Linux a su propia plataforma, una política que comenzó con Steve Ballmer, y aunque ha abandonado la firma, sigue adelante.

Ante la pregunta de si Oculus Rift llegaría a los equipos Mac que comercializa el gigante de Cupertino Palmer Luckey ha sido contundente, ya que ha afirmado que lo hará “si Apple lanza alguna vez un buen equipo”. No ha sido la forma más afortunada de decirlo, pero desde luego el CEO de Oculus no se ha cortado un pelo. Dando una explicación más elaborada podemos resumir que el motivo principal que frena la llegada de este kit de realidad virtual a OS X es la falta de potencia gráfica de los equipos Mac. Tal y como comentó Luckey Apple no prioriza el rendimiento gráfico en sus equipos, algo que implica que aunque compres por ejemplo un Mac Pro de seis mil dólares no cumplirás los requisitos mínimos, es decir, una GTX 970 o una R9 290, ya que la gráfica que montan viene a ser como una Radeon HD 7970. Desde luego los Mac no son equipos para jugar, y mucho menos están concebidos para funcionar con kits de realidad virtual, aunque no podemos descartar que Apple acabe preparando un modelo específicamente diseñado para funcionar con éstos, sobre todo si el mercado empieza a mover dinero de verdad. Finalmente debemos tener en cuenta otro apunte importante que hizo el CEO de Oculus, y es queno cree que sea rentable llevar la realidad virtual a Mac, incluso aunque acaben teniendo el hardware necesario, ya que no considera que sea algo que atraiga especialmente a sus usuarios. Más información: ZDNet.

La tan famosa Ley de Moore podría terminar antes de lo que pensamos una vez conocida una noticia nacida desde el seno mismo de Intel, que indica que el concepto tick-tock utilizado por la compañía para el desarrollo de sus procesadores, podría llegar a ser modificado en breve. Es decir, en poco tiempo ya no apostaría por la reducción del tamaño de los transistores, representada por el Tick, ni tampoco por la generación de nuevas microarquitecturas, representado en este caso por el Tock. ¿La Ley de Moore se acerca a su final? Para que quede claro, cada nueva generación de Intel y sus procesadores apostaba por uno de los dos sistemas para mejorar el rendimiento de la anterior, y así las dos últimas que fueron Broadwell y Skylake representaron un Tick y un Tock de forma respectiva. Intel podía además mantenerse así segura de lanzar una nueva generación al mercado cada año o año y medio, y ese rango de renovación justamente el que mantenía vivo a la Ley de Moore, por lo que si el concepto de actualizaciones es retocado, queda claro que la Ley de Mooe no podría seguir existiendo, o al menos no lo haría como ahora. Incluso, Intel no sólo ha reconocido de forma indirecta en sus últimos comunicados que se le está haciendo imposible seguir el ritmo del Tick-Tock, sino además que poco a poco comenzará a apostar por un nuevo concepto, denominado “Process-Architecture-Optimization”, que contempla mayores tiempos de espera entre la producción de nuevas generaciones. De cara a estos nuevos tiempos, Intel ha informado que sus principales intereses tienen que ver con el desarrollo de microarquitecturas para escritorio y portátil. Sin embargo, la generación de 14 nm seguirá siendo utilizada más de lo esperado, con el retraso de la de 10 nm, en lo que parece ser el quiebre de la Ley de Moore.