Reyverng

Usuario (Venezuela)

Así usa las Oculus Rift y las HTC Vive el ejército israelí El uso de sistemas de realidad virtual para el entrenamiento militar no es nuevo, pero el último ejemplo del ejército israelí demuestra lo mucho que esta tecnología puede aportar en conflictos armados. Los soldados israelíes están usando las Oculus Rift y las HTC Vive para hacer simulaciones previas de ataques de Hamas a través de los túneles que surcan la frontera entre Israel y Gaza. La realidad virtual, perfecta para simulacros militares Uno de los responsables de este entorno de entrenamiento —un alto mando cuyo nombre no se ha comunicado debido a la regulación militar— explicaba cómo la realidad virtual permite situar a los soldados en ejercicios que es imposible realizar en el mundo físico. Mientras que las gafas de Oculus son perfectas para simular los sistemas de túneles y obstáculos para soldados que entrenan sentados, las HTC Vive permiten simular entornos virtuales en los que un soldado de pie puede por ejemplo desmantelar bombas. Estas herramientas, aseguran en el ejército israelí, permiten realizar entrenamientos en la mitad de tiempo y con un ahorro en costes importante. Para su puesta en marcha se han invertido cientos de miles de dólares que incluyen 10 estaciones de trabajo y varias unidades de gafas de Oculus y HTC. Las fuerzas israelíes pusieron en marcha este proyecto tras los ataques palestinos que se realizaron a través de túneles que se construyeron en la franja de Gaza hace unos años. El ejercito israelí ha destruido 32 de esos túneles, pero la forma de hacerlo —colocando explosivos en el interior— es peligrosa porque hay trampas bomba en el interior, y estas gafas de realidad virtual preparan a los soldados para lidiar con un escenario al que nunca antes se habían enfrentado.

Del F1 al F12, para qué sirven las teclas de función en Windows y tu navegador Hoy te vamos a contar para qué sirven las teclas de función de tu ordenador. Son esas teclas que van desde el F1 hasta el F12 que llevan en nuestros teclados desde el principio de los tiempos. Y es que como su propio nombre indica, cada una de ellas tiene funciones específicas cuando las pulsas en tu ordenador. Concretamente, te vamos a contar para qué sirven cuando las pulsas en el explorador o escritorio de Windows y en tu navegador web. Para que este sea un artículo útil y de rápida revisión, te vamos a mostrar toda esta información en sencillas tablas. Seguramente cuando revises las tablas verás que hay teclas como la F7 o F9 que no tienen funciones en ninguna de las dos. Esto es porque las teclas de función también sirven como atajo en determinadas aplicaciones como Word, Excel o AutoCad, por lo que no todas se utilizan en tu sistema operativo o en tu navegador. Las teclas de función en Windows Vamos a empezar mostrándote para qué sirven las teclas de función en Windows. En la tabla podrás ver la tecla concreta junto a la acción que realiza cuando la pulsas cuando estás en el escritorio de Windows, en el explorador de archivos o en cualquier otro de los menús. También te hemos incluido un par de combinaciones populares como el pulsar a la vez Alt + F4 o el Mayúscula + F10. Las teclas de función en tu navegador Los navegadores también hacen uso de las teclas de función, y aunque algunas de las teclas realizan acciones comunes a las de Windows, hay otras que hacen otras cosas algo más específicas. Vamos a mostrártelas todas en el cuadro que ves a continuación.

Qué significa que mi CPU sea de 32 o 64 bits y cuál es la diferencia Cuando te vas a descargar un sistema operativo o al instalar una aplicación siempre tienes las dos mismas alternativas: descargarte la versión de 32 bits o la de 64. De hecho, incluso algunas aplicaciones como Chrome han decidido que te van a pasar de una versión a otra dependiendo de las características de tu equipo. Hoy en día puedes tener una CPU de 32 o 64 bits, y de ahí viene que suela haber una versión para cada cantidad de bits. ¿Pero qué significan realmente estas cantidades? Hoy te vamos a explicar de dónde vienen estos números, cómo saber cuántos bits tiene tu procesador y cual es la diferencia entre ambas cantidades. ¿Qué significa que mi CPU sea de 32 o 64 bits? En el mundo de la informática, los 32 y 64 bits se refieren al tipo de unidad central de proceso o CPU, al sistema operativo, los drivers y el software. Todos ellos utilizan una misma arquitectura. De esta manera todos los componentes hablan "el mismo idioma", y pueden funcionar correctamente los únicos con los otros. Por lo general, las arquitecturas más utilizadas a día de hoy son dos. Por un lado están las de 32 bits, a cuyo software es conocido también como x86, y por otra el hardware de 64 bits cuyo software se conoce también como x64 o un x86-64 al que a su vez también se conoce como AMD64. Las nomenclaturas se refieren a cómo se almacenan los datos. Como su nombre sugiere, los sistemas de 32 bits almacenan sus datos en piezas de 32 bits, mientras que los otros lo hacen con piezas de 64. Esto puede decir que, por lo general, al trabajar con "palabras" más grandes puedes hacer más en menos tiempo, lo que facilita que puedas llegar a hacer más en menos tiempo. Este gráfico muestra a escala es logarítmica los tamaños de espacio para las "palabras" de cada tipo de procesador. El que la CPU de tu ordenador tenga 32 o 64 bits depende de lo viejo que sea. Prácticamente todos los ordenadores que te llevas pudiendo comprar en la última década tienen casi seguro una arquitectura de 64 bits. Pero todavía hay personas e instituciones con equipos muy antiguos de 32 bits, o sea que tanto los sistemas operativos como los desarrolladores de software siguen dándole soporte. Apple es la gran excepción en todo este lío. Ellos empezaron a implementar los 64 bits en 2009 con Snow Leopard, y como tienen el control de su hardware y sistema operativo poco a poco han ido haciendo de esta arquitectura la única opción en sus equipos de sobremesa. Por lo tanto, las aplicaciones para estos ordenadores también suelen ser casi siempre sólo de 64 bits. ¿Qué diferencias hay entre ambos? La principal diferencia entre ambas arquitecturas es que los procesadores de 32 bits no son capaces de gestionar tanta memoria RAM como los de 64. Tengas en tu ordenador 8 o 16 GB de RAM, un sistema operativo de 32 bits sólo puede aprovechar un máximo de 4 GB. Los de 64 bits pueden utilizar muchísima más, teóricamente hasta 16 Exabytes, unos 16 millones de Terabytes. Aún así de momento estamos lejos de que haya ordenadores domésticos capaces de montar tanta RAM, y desde luego los sistemas operativos tampoco llegan a esas cantidades en sus topes. Por ejemplo, la versión Home de Windows 10 de 64 bits puede trabajar con hasta 128 GB, y la versión Pro puede con hasta 512 GB de RAM. Esto es importante dependiendo del uso que le des al ordenador, ya que afecta directamente a la multifunción. Con 3 o 4 aplicaciones abiertas a la vez un procesador de 32 bits podría funcionar bien, pero si abres más necesitarás más RAM, por lo que no puedes utilizar tantas como en los sistemas de 64 bits. Como hemos dicho antes, los ordenadores de 64 bits tienen capacidad de hacer más en menos tiempo. Pero tienes que tener en cuenta que eso no quiere decir que las aplicaciones de 64 bits sean siempre más rápidas, ya que esta velocidad dependerá de la manera de funcionar y de las exigencias de cada aplicación. Pero otras veces sí que son más rápidas porque con 64 bits se puede asignar más memoria virtual por proceso. Con 32 bits sólo puedes asignar 2 GB de memoria a cada aplicación, mientras que teóricamente los 64 bits pueden llegar a los 8 TB. Esto lo notarás especialmente en programas exigentes que hagan especial uso de la memoria como Photoshop. Por lo tanto, como las aplicaciones optimizadas para sistemas operativos de 64 bits como las propias Photoshop o Virtualbox aprovechan al máximo la amplitud del proceso y la memoria que les brinda el sistema operativo, pueden trabajar más rápido y ser más eficientes. Eso sí, a la hora de jugar las diferencias ya no son tantas. Pocos juegos requieren más de 4 GB de memoria RAM, por lo que la arquitectura no va a ser tan importante como tener una buena tarjeta gráfica con la que mejorar su rendimiento. Como ves en la gráfica los sistemas operativos de 64 bits son retrocompatibles, lo que quiere decir que pueden utilizar programas de 32 bits, aunque los mantiene separadss. Es por eso que encontrarás una carpeta de Archivos de programa, donde instalas las aplicaciones de 64 bits, y un *Archivos de programa (x86) en el que instala las de 32 bits. También es importante saber que aunque una CPU de 64 bits puede utilizar un sistema operativo de 32 o 64 bits, las CPU de 32 bits sólo pueden utilizar los de su arquitectura. Eso sí, si en una CPU de 64 bits instalamos un sistema operativo de 32, no podremos utilizar aplicaciones de 64. Saber si mi sistema es de 32 o 64 bits en Windows Puedes dar por sentado que si te has comprado recientemente un ordenador, casi con total seguridad este será de 64 bits. Sin embargo, puede que por alguna razón hayas o te hayan instalado sin querer un sistema operativo de 32 bits. Para comprobar esto en Windows 10 tienes que pulsar el menú de inicio y escribir Acerca de tu PC para que te aparezca la opción con el mismo nombre y puedas entrar en ella. Se te abrirá una ventana en la que puedes ver la información de tu equipo. Entre ella verás una sección llamada Tipo de sistema, y en ella te dirá cual es la arquitectura de tu procesador y de tu sistema operativo. Para otras versiones anteriores de Windows vale con hacer click derecho en Mi PC y elegir la opción Propiedades. Verás una ventana informativa muy parecida a la de Windows 10, en la que también tendrás una sección Tipo de sistema en el que te especifique los bits de tu procesador y sistema operativo. Y claro, también tienes el truco de entrar en C: y ver cuántas carpetas de archivos de programa hay. Si tienes una segunda Archivos de programa (x86) necesariamente estás utilizando un sistema operativo de 64 bits. Saber si mi sistema es de 32 o 64 bits en GNU/Linux Para saber la arquitectura de tu sistema operativo en distribuciones GNU/Linux suele ser suficiente con ir a la Configuración de Sistema. Puedes acceder buscando ese nombre en el lanzador de tu sistema, o buscando el icono de opciones arriba a la derecha, pulsándolo y eligiendo la opción. En este menú tendrás que ir a la opción llamada Detalles. Aquí verás una pantalla en la que se te informará sobre la versión de tu distribución que utilizas, qué cantidad de memoria RAM, procesador y tarjeta gráficas utilizas y la capacidad de tu disco duro. Y también tienes un campo llamado Tipo de SO en el que se te mostrará cual es la arquitectura de tu sistema operativo. También puedes acceder a la terminal del sistema operativo, en la que utilizando los comendos arch o uname -m, ambos hacen lo mismo, se te mostrará la información sobre la arquitectura de tu sistema.

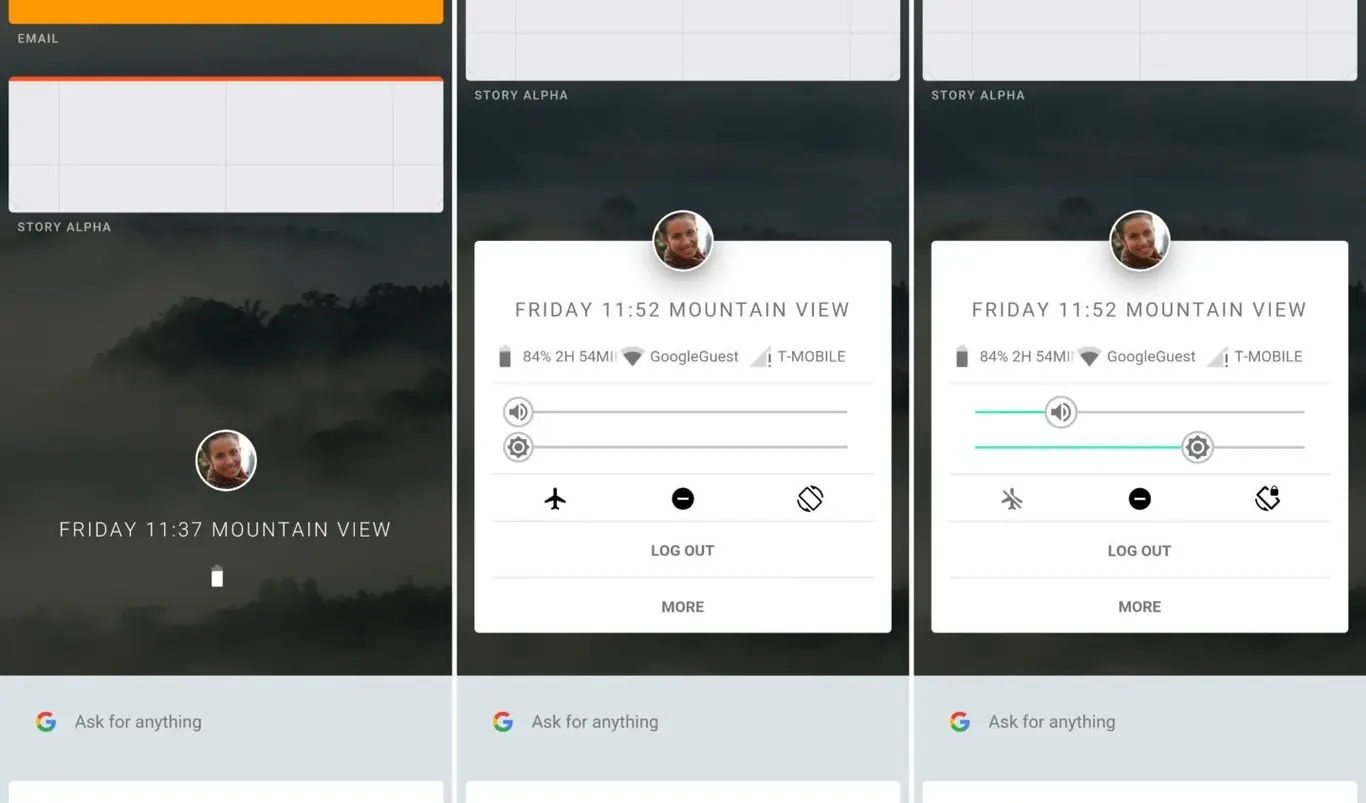

Este es el nuevo aspecto de Fuchsia, el sistema operativo secreto de Google que abandona el kernel Linux Los rumores sobre la llegada de un tercer sistema operativo de Google llevan tiempo produciéndose. Esa teórica mezcla de Android y de Chrome OS se llama Fuchsia, y hay una diferencia importante con esas dos plataformas: que no estará basado en el kernel Linux. El nuevo kernel se llama Magenta y eso permitirá a Google 'librarse' de esa dependencia y de la GPL. Google no esconde el desarrollo de Fuchsia aunque no ha confirmado públicamente la existencia de esta plataforma, y ahora aparecen nuevas imágenes de una interfaz que apunta maneras pero a la que le queda aún mucho recorrido. La interfaz de usuario de Fuchsia tiene nombre: Armadillo Como indican en Ars technica, ese kernel llamado Magenta está orientado según la documentación del desarrollo a "teléfonos modernos y ordenadores modernos con procesadores rápidos, cantidades de RAM no triviales y periféricos de todo tipo en entornos de computación abierta". La definición no es especialmente concreta, pero parece apuntar al futuro de móviles y tabletas convertibles que ahora están gobernadas por Android. Este es el logotipo de Fuchsia Uno de los últimos componentes en conocerse es Armadillo, la interfaz de usuario de Fuchsia, que está basada en el SDK Flutter que hace tiempo que muestra sus ventajas en desarrollos abiertos y que ahora también cobrará vida en la interfaz visual del sistema operativo de Google. Es posible compilar el proyecto y lograr "ver cómo queda todo", pero de momento la usabilidad de Fuchsia es muy limitada. En su estado actual nos encontramos con una pantalla de inicio con un teclado, un botón de inicio y algo similar a un gestor de ventanas. En esa pantalla de inicio el comportamiento es el de una gran lista en la que hacemos scroll vertical, con algunos datos en el centro. La interfaz presenta una lista de aplicaciones recientes en forma de tarjetas —similares a las que presenta la multitarea actual en Android— mientras que debajo están una lista de sugerencias tipo "Google Now". El funcionamiento, como indican quienes lo han probado, es aún errático y muy limitado, pero en Google se están tomando muy en serio este desarrollo, tal y como confirmaba uno de los responsables del desarrollo. "No es un juguete ni un proyecto del 20% [del tiempo]", comentaba. Todo apunta a que Fuchsia es algo así como un Android rediseñado desde cero para coger lo mejor que tiene esta plataforma pero aprovechando ideas que no podrían implementarse (al menos, no fácilmente) allí. Puede que Google comience a hablar por fin de este proyecto en Google I/O, pero lo que parece estar claro es que aún queda bastante tiempo para que Fuchsia pueda competir con sus hermanos mayores.

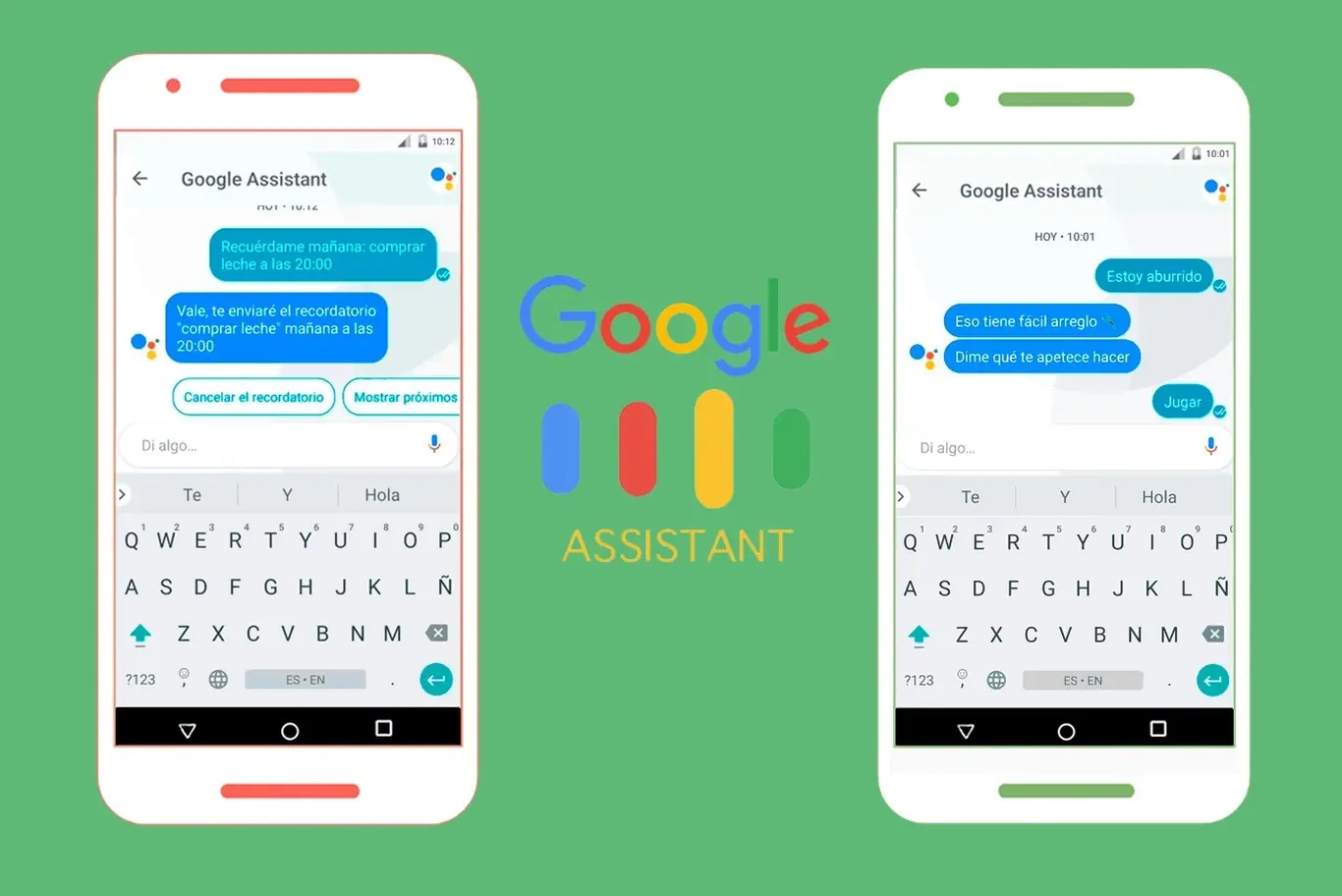

Google Assistant ya sabe español, aunque aún le queda mucho por aprender Google Assistant es a partir de hoy un poco más políglota. Al inglés (Estados Unidos y Reino Unido), alemán, portugués (Brasil), hindi y japonés, ahora hay que añadir el español a su lista de idiomas compatibles. Por ahora se integrará como beta en la aplicación de mensajería Google Allo y en los próximos meses irá llegando a Google Home, Google Pixel y otros smartphones Android. Para poder probar Google Assistant en español simplemente habrá que instalar (o actualizar) Allo para Android y iOS. link: https://www.youtube.com/watch?v=oS9_AJpNVdk Por ahora sólo por escrito Aunque como decimos ya se está trabajando en su versión completa en español, por ahora Google Assistant sólo sabe leer y contestarte por escrito en nuestro idioma a través de Allo. ¿Qué cosas concretas podemos hacer con él? Preguntarle cosas. Básicamente, tener Google integrado dentro de la aplicación. Puedes hacer preguntas del estilo:¿Qué hora es? ¿Qué tiempo hace en México DF? ¿Cómo ha quedado el partido del Real Madrid? ¿Cómo se dice gato en japonés? ¿Cuál es la comida típica de Galicia? Que haga cosas por ti. Como buen asistente, puede configurar una alarma para cuando le digas, llamar a un restaurante para reservar mesa, añadir recordatorios o eventos a tu calendario, guardar información que necesitamos a menudo (como la clave de tu WiFi, por ejemplo, simplemente hay que decírselo una vez y lo recordará cuando le preguntes "¿Cuál es la clave de mi WiFi?", que nos enseñe fotos nuestras con un amigo (aquí busca en Google Fotos), etc. Entretenernos. Si te aburres, puedes pedirle que te cuente algo gracioso, proverbios o que te recomiende juegos, tráilers de películas, etc. link: https://giphy.com/gifs/xUPGcKJMfwPiZitP6E Tiene personalidad, pero no es racista o sexista Para conocer mejor al asistente de Google y su aprendizaje en español, estuvimos hablando con Behshad Behzadi, director de búsquedas conversacionales en Google. Una de las primeras preguntas que le hicimos tuvo que ver con la inteligencia artificial y el riesgo de que ofrezca resultados racistas, sexistas o con sesgo ideológico. ¿Cómo pretenden evitar eso? Le hemos añadido personalidad al asistente: puede hacer bromas, tener opiniones sobre el tiempo que hace, un color favorito... pero también le hemos enseñado a identificar si lo que el usuario le está diciendo o preguntando puede herir sensibilidades a determinados grupos de personas. En esos casos, el asistente no contestará o dirá "Lo siento, no he entendido lo que has dicho". Entonces, ¿dejan que los algoritmos y el machine learning se encarguen de cuestiones sensibles como ésta? Prácticamente sí, aunque según Behshad tienen un equipo humano dedicado a supervisar y a reaccionar rápidamente en caso de que algo vaya "tremendamente mal". Aquí también nos avisa de que el sistema no será perfecto desde el día uno, y que, en todo caso, el machine learning servirá para que, si sucede un error, no vuelva a repetirse en el futuro. Como curiosidad, la personalidad de Google Assistant está diseñada por equipos de diferentes empresas como Nintendo, Pixar o The Onion. ¿Para cuándo sabrá perfectamente español? Behshad nos confirmó que el equipo de Google ya está trabajando en localizar por completo el asistente en español. Por localizar se refieren a que entienda perfectamente el español escrito y hablado y en los diferentes acentos. "Esperemos que sea en los próximos meses". ¿Próximos meses dentro de este mismo año? "Probablemente, sí". Será cuestión de tiempo que Google Home llegue a España y Latinoamérica. La consecuencia directa de esto afecta a otros productos de Google, como Google Home, que ahora sí tendría sentido que llegara al mercado español y latinoamericano. De hecho, le preguntamos sobre esto mismo, y Behshad nos dijo "tarde o temprano acabará llegando", así que será cuestión de tiempo. ¿Sucederá lo mismo con Google Pixel que no está a la venta en países como España? Aquí ya no se quiso mojar, por lo que quizá Google decida esperar ya al hipotético Pixel 2. Lo que sí nos aseguró es que Google Assistant en español llegará "pronto" a los smartphones Android compatibles. Y esto seguramente sean malas noticias para Bixby o Alexa, que aún se pierden en nuestro idioma. link: https://giphy.com/gifs/xUPGcyC9hLrPbW1rBC

El Oukitel K10000 Pro cuenta con una monstruosa (y grandiosa) batería de 10.000 mAh Y dale con los móviles ultradelgados de diseño. De verdad, algunos usuarios quieren móviles más gorditos y con más batería para no sufrir tanto con esa autonomía que suele dar más de un problema. No hay muchos que apuesten por este apartado, pero aquí tenemos a Oukitel para demostrar que hay opciones para todos los gustos. Es lo que logran con su Oukitel K10000 Pro, el sucesor de un modelo aparecido hace dos años. Como sucedía entonces, la característica más llamativa de este smartphone es la inclusión de una batería monstruosa de 10.000 mAh que ahora se une a prestaciones que pondrán este dispositivo "a tono" con los tiempos actuales. Modesto en casi todo, pero excepcional en batería Los responsables de Oukitel aseguran que además el tiempo de carga de esa "enorme" batería será de tan solo tres horas gracias a un sistema de carga rápida de 12V/2A. La firma mostró el dispositivo durante el MWC de este año, pero aún tendremos que esperar unas semanas —se le espera en junio— para poder adquirirlo y tampoco se conoce el precio, aunque su antecesor se vendía por unos 220 euros. El diseño del nuevo modelo será similar al de su predecesor, el Oukitel K10000 que ya contaba con esa asombrosa batería. Una de las pegas del modelo, claro, será su peso, que se estima que será de 292,5 gramos, pero es que este dispositivo superará claramente a su antecesor en el resto de especificaciones: contará con una pantalla de 5,5 pulgadas FullHD protegida por Gorilla Glass. El procesador es algo modesto, ya que se trata de un MediaTek MT6750T (ronda los 40.000 puntos en AnTuTu) con ocho núcleos a 1,5 GHz. Estará acompañado por 3 GB de RAM y 32 GB de capacidad, pero no se conocen aún datos sobre otros apartados como su cámara o sus opciones de conectividad. Lo que es seguro es que si queréis un móvil que aporte garantías en el terreno de la autonomía, aquí tenéis al candidato ideal. Los responsables de Oukitel aseguran que puede aguantar entre 10 y 15 días de uso, pero nos tememos que esa cifra es demasiado optimista. Eso sí: quienes lo probaron en el MWC obtuvieron 24 horas de tiempo en pantalla, una cifra realmente fantástica (5-6 horas se consideran aceptables en los smartphones actuales) que si se confirma hará a más de uno plantearse esta opción modesta en casi todo menos en esa "monstruosa" autonomía.

Cuando la realidad virtual me hizo querer aprender más de historia en un museo de 150 años Me encanta visitar museos. Y no sólo de pasada. Me gusta perderme, pararme a leer la información disponible, analizar lo que veo. Sin embargo, aunque siga queriendo más, llega un momento en el que estoy cansado de leer o, dicho de otra manera, poner de mi parte para disfrutar de la ciencia o del arte que tengo ante mí. Suele venir al rescate la típica película o documental que te cuenta cosas. Tú no tienes que hacer nada más que prestar atención. El problema es que ahí acabas poniendo encefalograma plano y, si la temática no te engancha, posiblemente acabes más aburrido que antes. Hasta que llega la realidad virtual y te demuestra que eres capaz de interactuar con lo que ves mientras te van explicando conceptos. Eso es lo que me pasó a mí con el proyecto "Vive el pasado" de Samsung y el Museo Arqueológico Nacional de Madrid. Mira, escucha o explora a tu ritmo Se trata de un proyecto de recreación histórica digital llevada a la realidad virtual. Se han seleccionado cinco épocas de la historia de España (Prehistoria, Protohistoria, Hispania Romana, Edad Media y Edad Moderna) y se ha desarrollado un escenario virtual para cada una de ellas. En el Museo hay instalados cinco puestos o tótems (uno para cada época) que incluyen unas gafas Gear VR, un Samsung Galaxy S7 y unos auriculares Samsung Level. Dentro del smartphone está instalada la aplicación "Vive el pasado", que incluye dos modos diferentes: Guiado. Aquí una guía virtual nos cuenta en unos dos minutos cada etapa de la historia de España. Podemos interactuar con lo que vemos, pero la experiencia se acaba cuando termina la explicación. Libre. Nos dejan todo el tiempo que queramos para explorar cada rincón de los escenarios. Una vez que te colocas las gafas y los auriculares, la experiencia es bastante intuitiva, incluso para los que nunca hayan probado la realidad virtual. Todo está explicado paso por paso y es muy sencillo. En cuanto seleccionamos el idioma (español o inglés) enseguida comienza el tour (en nuestro caso probamos el modo guiado). Escuchas e interactúas con el entorno al mismo tiempo: retienes mucho mejor lo que te cuentanAparte de que va todo muy fluido, lo que más me gustó fue que, mientras escuchaba a la guía contarme sobre las casas de la época musulmana en España, podía mover la cabeza para ver en detalle y en 3D lo que me estaba contando. Igual resulta una obviedad, pero la retención de contenido se me hizo tan natural que, sí, aprendí más en dos minutos que durante todas esas soporíferas horas leyendo textos llenos de fechas y datos aburridos. Guía virtual que nos encontramos en la aplicación "Vive el pasado" A nivel técnico, la aplicación se ha desarrollado con fotogrametría y modelado 3D. En el caso de la guía, se ha utilizado motion capture de una persona real para que los movimientos sean más realistas y "humanos". Todo el proyecto ha sido dirigido por Magoga Piñas Azpitarte, especialista en recreación digital y animación y con experiencia en series como 'Juego de Tronos' o películas como 'Ágora'. La gran pega es que hay muy pocos puestos VR en el museo: será difícil no desesperarse con las colas. ¿El futuro de los museos? Más allá de que sean pocos puestos con gafas VR y que las colas vayan a ser ingentes para disfrutar de la experiencia in situ, Samsung y el Museo avisaron de que esto es un primer paso y quieren ver qué tal funciona para ver si tiene sentido y cómo se puede mejorar. De hecho, ya están trabajando en una experiencia más: una visita virtual al propio Museo Arqueológico Nacional. Alguien preguntó si estas experiencias no son contraproducentes para los museos. "Si tengo la aplicación, para qué voy a venir", dejaba caer un periodista. El director del Museo Arqueológico Nacional, Andrés Carretero Pérez, contestó de manera contundente: Es un temor al que nos enfrentamos los museos hace tiempo, pero ya lo superamos y ahora creemos que, al contrario, incentiva la visita para ver en directo lo que ya conoces gracias a la aplicación. Son experiencias que se alimentan recíprocamente. Esta afirmación habría que contrastarla con datos, pero sí es cierto que lo que propician proyectos como éste es que cada vez más gente pueda disfrutar de lo que hasta ahora sólo se podía vivir en los museos. Ojalá y haya muchos más proyectos así.

Cuando la frontera en el mundo de la informática eran los 640K Cuenta la leyenda que en 1981 Bill Gates dijo que "640K deberían ser suficientes para cualquiera". Él mismo negó más tarde haberlo dicho, y lo cierto es que no hay pruebas claras de que lo hiciera. Lo que sí existió desde luego fue ese límite para los programadores de los viejos IBM PC, y la barrera la impuso la propia IBM, dominadora absoluta del mercado en la época. Aquel límite definió toda una generación de ordenadores. Una que empezaba a tratar de separar la informática "de juguete" de los ordenadores de 8 bits convencionales de esos IBM PC que con procesadores como el Intel 8086 o el 8088 quiso demostrar que, efectivamente, 640K serían todo lo que el mundo necesitara. Al menos durante un tiempo. Gates y la cita maldita que nunca se pronunció Como explicaban en ComputerWorld hace casi una década, aquella asombrosa metedura de pata nunca existió. Mucho más real fue la que el fundador de Digital Equipment, Ken Olsen, hizo en 1977 cuando dijo aquello de que "no hay razón para que una persona normal tenga un ordenador en su casa". Olsen se cubrió de gloria, desde luego, y aunque luego intentó escapar de aquella frase, su visión de futuro le perseguiría el resto de su carrera, y lo haría porque ciertamente se lo merecía. Gates, por contra, ha sido perseguido por esa cita a pesar de haber negado una y otra vez haberla pronunciado y de que nadie ha conseguido demostrar que lo dijera. Contestando a un estudiante sobre el tema a mediados de los 90, el cofundador de Microsoft explicaba aquella pesadilla: He dicho algunas cosas estúpidas y otras incorrectas, pero no esa. Nadie involucrado en la informática te podría decir que cierta cantidad de memoria podría ser suficiente para siempre. Sigo encontrándome con esa absurda cita atribuida a mí que dice que 640K de memoria son suficientes. Nunca hay una referencia, la cita simplemente fluye como un rumor, repitiéndose una y otra vez. Así era el mundo en 640K Cuando se produjo esa cita IBM era algo así como la Facebook de nuestros días. Omnipresente y aparentemente invulnerable, con un monopolio de facto en el mundo del PC que acabaría escapándosele entre los dedos. Aquellos IBM PC contaban con procesadores como los Intel 8086 y los 8088, CPUs de 8 bits que no obstante contaban con un bus de direcciones de 16 bits. En este apartado había distintas filosofías: Motorola tenía un bus de direcciones unificados en el que las direcciones de la memoria RAM y las de los periféricos de entrada y salida compartían el mismo espacio de memoria, mientras que Intel prefirió dividir ambos espacios. De hecho, los 8086 y 8088 tenían un bus de memoria de 20 bits que permitía direccionar hasta 1 MB de memoria, mientras que los Motorola 68000 tenía un bus de direcciones de 24 bits (16 Mbytes), un salto que Intel acabó dando con los Intel 286. Aunque esos procesadores de Intel podían llegar a direccionar un espacio de direcciones de 1 MB, en realidad tanto el chipset como el sistema operativo acababan dictando los límites. Y si había un verdadero dictador en esa época, ese era MS-DOS, el sistema operativo de aquellos equipos. La "maldición" de la memoria convencional La barrera de los 640 KB que fue impuesta por IBM y el sistema operativo MS-DOS, y se conoce como "memoria convencional". Esa parte del espacio de direcciones físicas disponibles estaba destinada a la RAM, y estaba disponible desde el primer momento para todo tipo de aplicaciones y, por supuesto, para el propio sistema operativo DOS. Los 384 KB restantes (recordemos, 1 MB = 1024 KB) que podía direccionar el 8088 de los IBM PC estaban reservados para la llamada Upper Memory Area (UMA), reservada por ejemplo para el mapa de memoria del adaptador gráfico de la época (el legendario Color Graphics Adapter o CGA), para la IOS y para memoria compartida para dispositivos físicos como adaptadores de red. El problema es que esa limitación de los 640 KB pronto afectó a aplicaciones y juegos que trataban de ofrecer más prestaciones, y eso hizo que a medida que pasaban aquellos años de la década de los 80 se acabaran creando técnicas para liberar memoria convencional que por ejemplo llegaron con DR-DOS 5.0 y con MS-DOS 5.0. Seguro que algunos de nuestros lectores recordarán hacer uso del controlador EMM386 de aquella versión de MS-DOS, aunque otras alternativas como QEMM también se hicieron populares. Para ello sobre todo se trasladaban los controladores de dispositivos a los bloques de memoria de la UMA , algo que no hacía necesario cambios hardware y que preservaba la compatibilidad de las aplicaciones. Este mapa de direcciones de memoria no es de un 8088: es de los nuevos procesadores de Intel, que como veis tienen ese primer megabyte reservado para compatibilidad DOS. Aquella legendaria barrera no desaparecería fácilmente: mantener la compatibilidad de aplicaciones y del sistema operativo con sus versiones anteriores hizo que tuviera vigor incluso tras el lanzamiento del Intel 286. Aquel microprocesador permitía direccionar hasta 16 MB de memoria en modo protegido, pero si el procesador funcionaba en "modo real" (para ofrecer esa compatibilidad total) volvíamos a contar con 1 MB de memoria direccionable, sin más. De hecho y como indican la Wikipedia, incluso los PCs actuales con procesadores Intel tienen ese área de memoria entre los 640 y los 1024 KB reservada ( PDF ), pero en realidad esas direcciones son invisibles para los programas y para los sistemas operativos modernos, que hace años que pasaron a ofrecer un sistema de memoria virtual que hace que no tengan que trabajar con direcciones físicas de memoria. Los 640KB en perspectiva: ¿cuánto consumen las aplicaciones actuales? Mucho ha llovido desde que Intel lanzara aquellos procesadores y MS-DOS dominara la informática personal. Casi cuatro décadas después los avances han permitido que las ganancias en potencia de proceso y prestaciones hardware sean asombrosas. Los micros de hoy en día de 64 bits soportan en teoría 16 exabytes, pero los espacios de direcciones reales son inferiores, sobre todo por limitaciones impuestas por cada sistema operativo. Cómo pasa el tiempo. De los 640 KB... a esto. En Windows 10, por ejemplo, ese límite depende de la edición en la que nos encontremos: podríamos instalar 128 GB de RAM en Windows 10 Home, pero en el resto de ediciones (Pro, Education, Enterprise) ese límite asciende a unos increíbles 2 TB (con "T" de tera, ya sabéis). En Red Hat Enterprise Linux 6 ese límite llega a los 16 TB (aunque el espacio virtual de direcciones puede llegar a los 128 TB), mientras que en macOS podremos llegar a los 128 GB. Esas cifras mareantes nos hablan desde luego de la evolución que hemos vivido en estos años, y que también se ha notado en la memoria que aprovechan las aplicaciones durante su ejecución. Aquellos 640 KB con los que tenían que "jugar" los desarrolladores en los 80 contrastan con cantidades que varían según la configuración pero que por norma rondan los 4 u 8 GB de RAM en equipos de sobremesa y portátiles y que suelen rondar los 2 GB en dispositivos móviles. En el PC la cosa se complica, porque si uno contabiliza la memoria de las 16 pestañas que tenía abiertas en el momento de comprobar ese consumo la cifra se disparaba (incluyendo plugins) a algo más de... ¡2 GB! según el gestor de tareas de Windows 10. Incluí por tanto Spotify, Slack y una ventana del explorador de Windows como ejemplos para esta referencia básica. Como se puede ver, el consumo de memoria de todos estos ejemplos es enormemente alto en comparación con el de las aplicaciones y juegos en MS-DOS. De hecho hemos querido crear una breve comparación indicando "cuántos bloques de 640KB consumirían" esas aplicaciones en aquel momento si se hubieran podido combinar varios bloques de 640 KB para dar vida a estas herramientas. En el caso de Chrome o Netflix, por ejemplo, el resultado es claro: ambas consumen 132 veces más que ese máximo del que "nunca habló" Bill Gates. Curioso, y a la vez una prueba más de todo lo que ha avanzado el segmento.

'Alien: Covenant', review: el regreso del clásico peca de timidez Las declaraciones de los responsables de esta nueva entrega de la franquicia 'Alien' no dejan lugar a dudas: es un regreso a los mismísimos orígenes de la serie. Se repiten escenas y tópicos de la primera historia que en su día eran atrevidos y distintos, hoy lugares comunes, y vuelve a tomar los mandos, tras la extraña experiencia de 'Prometheus', un Ridley Scott casi 40 años más viejo que el que dirigió 'El 8º Pasajero'. Después de múltiples devaneos que han llevado a la serie a multiplicar la cantidad de aliens en pantalla, a pasear a los xenomorfos por toda la galaxia y hacerlos descender a la Tierra, a proponerlos como plaga bíblica, arma biológica o sparring para cazadores estelares, 'Covenant' vuelve a situar a la criatura diseñada por H.R. Giger como una fuerza indómita de la naturaleza. Aunque pasada por el turmix de filosofía existencialista de 'Prometheus'. Es decir: la operación de Fox para revitalizar a su criatura pasa por picotear entre lo más tradicional y menos rompedor de la franquicia, los tópicos que el espectador medio asocia a la saga, y usar 'Prometheus' como trampolín estético y parcialmente temático. Paradójicamente, el interés de 'Alien: Covenant' no está en cuando clona a sus mayores, cuando reverencia al clásico, sino cuando propone alternativas. Cuando es menos 'Alien'. link: https://www.youtube.com/watch?v=svnAD0TApb8 Llamada de socorro: comienzan los problemas La acción de 'Alien: Covenant' se sitúa diez años después de los accidentados sucesos que diezmaron la tripulación de la Prometheus. La Covenant es una nave colonizadora cuyo equipo es despertado de la hibernación tras un accidente durante el viaje. Con el capitán muerto, deciden no entrar de nuevo en hibernación y desviarse de su destino proyectado para atender una llamada de socorro. En ese planeta al que se desvían, aparentemente fértil y de atmósfera respirable, encuentran los restos de la nave en la que escaparon el androide David (Michaerl Fassbender) y la doctora Shaw. Pero también una forma de vida mutante, adaptable y muy agresiva que les ataca en cuanto desembarcan. Como se observa, el esquema de la primera 'Alien' (entre otras) se repite sin demasiados reparos: una tripulación de currantes que se comportan más como camioneros que como héroes espaciales efectúa un accidentado descenso en un planeta desconocido atendiendo un SOS. La diferencia: aquí entra en la ecuación David, androide de aviesas intenciones idéntico al propio de la nave, Walter. Scott se esfuerza por pulsar determinados botones que inequívocamente asociamos a la saga (salvo a 'Aliens', quizás): una tripulación en suprioridad numérica pero que no puede hacer nada para enfrentarse a la ferocidad e implacabilidad del organismo alienígena, cuyo proceso de reproducción y crecimiento es descrito con un detallismo que roza la pornografía para biólogos. Por desgracia, la sensación de extrañeza constante, de organismo obscenamente distinto al humano tanto en lo moral como en lo fisiológico, y que convertía de forma extraña e intuitiva a la 'Alien el 8ª pasajero' original en una especie de asimilación de algunas ideas de Lovecraft pero en clave de tremendismo futurista, aquí ha desaparecido. Ha desaparecido porque Alien ha entrado ya en el panteón de monstruos clásicos, aquellos cuyos orígenes, características y debilidades nos sabemmos al dedillo. Y la culpa la tienen películas que sin duda alguna adoramos, como 'Aliens': pero el xenomorfo, por mucho que aquí adopte nuevas -y moderadamente inquietantes- formas, como los neomorfos, ya no es un misterio absoluto, un enigma incomprensible. Por eso 'Alien: Covenant' es más interesante cuando se adentra en terrenos inexplorados: los neomorfos -pese a su confusa y, en cierto modo, injustamente "mágica" forma de reproducción- no solo son espectacularmente agresivos, con un comportamiento sanguinario y velocísimo, sino que tienen una corporeidad genuínamente alienígena, lo que entronca con la extrañeza del primer Alien, el xenomorfo primigenio. Mejor cuanto más raro Y por eso es agradecido cuando Scott sorprende abundando en los disparates de 'Prometheus', una película decididamente con altibajos, pero mucho más atrevida y sorprendente que esta, llena de sanguinolencia abrupta y conversaciones filosófica absurdas. En ese sentido, lo mejor de 'Covenant' recuerda a aquella: la conversación inicial de David con su creador, la interacción entre los dos androides idénticos... También brilla 'Covenant' cuando incide en temas que el canon de la serie había dejado medio olvidados, pero son interesantísimos. Por ejemplo, los experimentos biológicos con los aliens están en el mismo ADN de la serie, gracias a la infravalorada 'Alien: Resurrección' y a los comics de Dark Horse. Aquí se recuperan con bastante fortuna. Para todo lo demás, opta Scott por jugar sobre seguro: la fría voz de Madre, chest-busters, huevos, chicas guerreras (Katherine Waterston, apropiada como clon de Ripley, aunque tanto Danny McBride como Fassbender se lucen más, algo inaudito en la serie), sangre de ácido y lanzamientos de mandíbula... La acción es adecuadamente violenta, pero los impersonales surtidores de CGI juegan alguna mala pasada al tono visceral que busca Scott. Más interesantes son las secuencias con las que Scott ya había brillado en 'Prometheus': parajes de planeta desolados ("no se oyen pájaros" dice Waterston en una de las frases más acertadamente fantastique de la película), naves de arquitectura absurda descendiendo sobre mantos de nubes... curiosamente, Ridley Scott está más cómodo y se gusta más cuando indaga en lo novedoso, aunque el gancho de 'Covenant' sea justo el opuesto. Ningún fan de la franquicia va a salir de la película especialmente decepcionado. Según gustos y según la radicalidad de cada cual, la inevitable secuencia de sexo y muerte será interpretada como una caída en el tópico o como una reconversión de 'Alien' en una franquicia de terror abiertamente comercial. Por eso mismo, los que se quejaron de 'Prometheus' se frotarán las manos. El regreso de un 'Alien' canónico La prensa está siendo prácticamente unánime en el recibimiento de la película de Scott, siempre en un tono bastante tibio. Es decir, "bien, pero...". Dicho de otro modo, estamos ante una entrega digna de 'Alien', pero no ante el heredero directo de la clásiquísima primera parte. Y ya dependiendo de tu gusto por 'Prometheus', lo podemos dejar en desastre mayúsculo o derrape justito. Por aquí, devotos como somos de la franquicia, hasta de sus entregas más esquinadas, echamos de menos algo de la locura que empapaba 'Prometheus'. Aquella mezcla de secuencias mudas interminables, ciencia-ficción estilo soviético, cháchara filosófica e insensatez argumental. 'Alien: Covenant' es una entrega reconocible de 'Alien', sí, pero es que eso es lo mejor que puede decirse de ella: que es muy reconocible. Es decir: vas a encontrar tus aliens icónicos y alguna sorpresa, todos los tropos temáticos de la franquicia replicados con respeto casi enfermizo, y muchas ganas de Scott de ser recordado como padre único de la criatura. Aquí preferimos cuando la saga toma riesgos, se equivoca y se traiciona a sí misma, con espacio para la sorpresa y la verbena.

Siete minutos de olas infinitas e hipnotizantes que han sido creadas a partir de solo siete fotos No todo va a ser tecnología pura y dura, a veces nos encontramos con el resultado de la misma, en manos de verdaderos artistas. El caso que nos ocupa es el de un vídeo - o sucesión de animaciones - que parecen no tener fin y en el que el protagonista son las olas del mar. El vídeo que compartimos es una composición de siete minutos de los diferentes trabajos que Armand Dijcks ha estado realizando con las fotografías de Ray Collins , especialista en retratar el mar. Todo ese metraje se ha confeccionado a partir de imágenes, nada de vídeos. ¿Cómo se consigue ese movimiento? Pues no será la primera vez que se tire de algoritmos para darle gracia a algo estático, pero en esta ocasión la herramienta principal es Adobe After Effects. Armand la utiliza en Infinite Now, más concretamente hace uso de ‘ Puppet Warp ’. La segunda herramienta utilizada es Cinemagraph de Flixel . link: https://vimeo.com/215405296 Me imagino realizar este trabajo con una cámara de vídeo y me parece una tarea imposible, por resolución e iluminación necesaria. De hecho Dijcks comenta a la gente de PetaPixel que le han preguntado muchas veces por la cámara que ha utilizado para registrar el ‘slow-motion’. Nada de cámaras de vídeo, aquí lo que se hace animar las imágenes, darle vida a las olas con las herramientas citadas: con After effects se crea el movimiento, con Cinemagraph Pro se le da forma de loop y se crean máscaras para las partes que tienen que moverse. El acompañamiento perfecto lo pone la música, que se ha compuesto para la ocasión por André Heuvelman, e interpretada por el pianista Jeroen van Vliet, ambos de la Rotterdam Philharmonic Orchestra. Las fantásticas animaciones sueltas las tenéis en este enlace, pero os voy a dejar algunas a continuación para que disfrutéis de su trabajo: link: https://flixel.com/cinemagraph/etkm6cv4mvwc18qejgl3 link: https://flixel.com/cinemagraph/l7tyatig3pbfdwb56x2v link: https://flixel.com/cinemagraph/ulqyqqzqr93nwo61efc6 link: https://flixel.com/cinemagraph/ipkiqw2it44g39lmca4r link: https://flixel.com/cinemagraph/t6ho4ga4fz3bdxnl36nj