Supralogico

Usuario (Argentina)

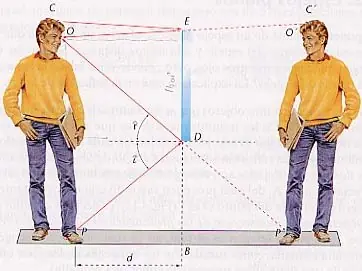

¿Cuál es el largo mínimo de un espejo para vernos de cuerpo entero? La respuesta nos puede hacer ahorrar algo de dinero, ya que el precio de un espejo, además de su calidad, material del marco, si es artesano o los tipos de bordes, depende sobretodo de su tamaño (¿me equivoco?). Aquí dejo el vídeo explicativo aunque te adelanto la respuesta: El espejo debe medir de largo la mitad de tu altura. Si mides 180 cm (1,8m), el espejo debe medir 90cm de largo. De esta manera, te puedes ver de cuerpo entero desde cualquier distancia. Si vives en pareja, ya sabes, debéis comprar el espejo a la medida del más alto. ¿Puede esto evitar alguna disputa de pareja a la hora de comprar un espejo? No creo que la física pueda evitar estas cosas, aún. Les dejo también esta imagen explicativa: FUENTE PASATE POR MIS OTROS POST!!!

Gatos cuánticos de luz (NIST) dijo:Seguramente has oído hablar del experimento mental propuesto por el físico Erwin Schrödinger en 1935. Este alemán, en los albores de la física cuántica, utilizó la “paradoja del gato” para explicar la superposición de estados de una función de onda, algo que aún hoy, casi 80 años más tarde, sigue siendo bastante complicado de entender. Un grupo de físicos del NIST han realizado un experimento que reproduce la paradoja de Schrödinger, pero utilizando fotones en lugar de felinos. ¿Cuales serán sus aplicaciones prácticas? De todas las polémicas características que presenta la física cuántica, la más impactante es la que permite a las funciones de onda describir combinaciones de dos o más estados simultáneamente. Eso inspiró a Erwin Schrödinger para escribir su “paradoja del gato”. Esta paradoja, propone un experimento en el que un gato -siempre según los principios de la física cuántica- estaría vivo y muerto a la vez. Si bien la naturaleza macroscópica de un felino hace que las propiedades de los cuantos no se apliquen al él, una sola partícula puede -en teoría- desatar la serie de acontecimientos explicados por Schrödinger y que, eventualmente, llevarían al gato o bien a la muerte, o bien a una larga vida. En el NIST han creado verdaderos “gatos cuánticos” A pesar de que todo esto puede sonar muy extraño para los no iniciados, los físicos pueden lidiar perfectamente con esos temas gracias a los modelos que han desarrollado luego de décadas de incesante y arduo trabajo. Cuando es posible, se diseñan experimentos destinados a comprobar tal o cual propiedad, y por lo general los resultados reflejan lo que las ecuaciones habían predicho. Uno de estos experimentos acaba de ser realizado por un equipo de científicos del National Institute for Standards and Technology (NIST). Gerrits Thomas, quien ha estado a cargo del experimento, se encuentra redactando un detallado informe sobre el mismo, que será publicado próximamente. Pero mientras esto ocurre, los físicos están en condiciones de adelantar algunas conclusiones: han sido capaces de crear verdaderos “gatos cuánticos” hechos de fotones (partículas de luz), que -según explican- podrán mejorar los equipos destinados a efectuar medidas de precisión, la informática y las comunicaciones. NIST ha creado una nueva forma de luz conocida como “squeezed vacuum” El equipo del NIST ha creado su “gato cuántico fotónico” utilizando los principios de la óptica y pulsos de un láser ultra rápido. El láser ha servido para excitar unos cristales especiales, creando una nueva forma de luz conocida como “squeezed vacuum” (algo así como “vacío comprimido”). Esta luz se hizo pasar luego a través de un dispositivo llamado divisor de haz. Los fotones se identificaron mediante un sensor creado por el NIST, que es capaz de detectar y contar fotones individuales. Dependiendo del número de fotones que se emiten y los que se cuentan, más un montón enorme de cálculos que solo los locos físicos del NIST son capaces de comprender, se obtiene el equivalente cuántico de la superposición de dos haces láser con fases opuestas. La pregunta que debemos hacernos, aún cuando todo el proceso realizado nos suene a chino, es “¿Para qué me sirve esto?” El NIST ha encarado este experimento y otros relacionados no solo por el “hambre de conocimientos” que suele caracterizar a los científicos, sino por que comprender cabalmente el comportamiento de estos nuevos estados de la luz servirá para mejorar las técnicas de medición denominadas “interferometría”, que sirven para medir distancias utilizando la interferencia que se crea entre dos haces de luz. Además, creen que esta investigación también puede contribuir al desarrollo de la prometida informática cuántica, que -según nos han jurado una y otra vez- algún día podría resolver problemas que son inabordables con los ordenadores actuales. La seguridad también puede ser mejorada con estos sistemas, gracias a los (recientemente violados) algoritmos de cifrado cuántico. El trabajo servirá para mejorar las técnicas de interferometría. Como puedes ver, todo resulta bastante vago. Seguramente en el “paper” que está escribiendo Gerrits Thomas no vamos a encontrar algo tan concreto como “gracias a este experimento mañana vamos a tener una memória de ordenador más rápida” o “se terminaron los problemas de seguridad”. Con un poco de suerte, esto sentará las bases sobre las que, mucho trabajo mediante, en una o dos décadas se pueda construir algún dispositivo basado en este nuevo estado de la luz. Mientras tanto, seguimos de cerca estos experimentos y las novedades que puedan surgir de los laboratorios especializados. FUENTE PASATE POR MIS OTROS POST!!!

¿Funciona el cerebro de los grandes maestros del ajedrez de manera diferente al de la población general? De Groot estuvo interesado por la actividad intelectual que tiene lugar cuando jugamos al ajedrez. Sus estudios le condujeron a diversas conclusiones, una de las cuales es que los momentos más importantes en el pensamiento y que inclinan a un movimiento o a otro son los primeros instantes tras observar una nueva configuración del tablero. Una teoría relativamente reciente, la teoría dual del razonamiento, parece apoyar esta tesis y puede dirigir el estudio del funcionamiento del cerebro de los grandes maestros de ajedrez. Fue en 1965 cuando Adriaan de Groot nos ofreció sus tesis sobre los procesos intelectuales asociados al juego del ajedrez (de Groot, 1965). De Groot no sólo fue un reputado psicólogo holandés, sino también un gran jugador de ajedrez que falleció ya en el siglo XXI y que investigó detenidamente los procesos mentales vinculados a la elección de movimientos en este juego. Entre sus principales descubrimientos es destacable su idea relativa a que los primeros momentos de visualización de un nuevo escenario son los que condicionan en mayor medida una decisión concreta sobre una pieza. En su opinión, el jugador no llega nunca a movimientos realmente novedosos, ya que todas sus elecciones se basan en la experiencia, sea ésta propia u obtenida a partir de la observación de otros jugadores. Esta propuesta de de Groot (1965) se ha visto recientemente apoyada y fundamentada gracias a la teoría del proceso dual en el razonamiento. Descripciones en profundidad de esta teoría, así como de las pruebas empíricas que la apoyan, se pueden hallar en Evans (2008), Legrenzi (2008) y en Inglis y Simpson (2006). Central en ella es la distinción de dos sistemas cognitivos de razonamiento en los seres humanos. Uno de estos sistemas es el que tiene que ver con las intuiciones y el otro el correspondiente al razonamiento abstracto. Stanovich (1999) fue el primero en utilizar, para nombrar a los dos ámbitos cognitivos, los términos que en el momento presente son empleados mayoritariamente: “Sistema 1″ y “Sistema 2″. El Sistema 1 es rápido e inconsciente, y el ser humano lo comparte con los animales. Sólo su producto final es consciente y, según parece, surgió pronto evolutivamente hablando. Está formado por diferentes subsistemas, algunos de los cuales son innatos, mientras que otros se obtienen como resultado de la experiencia (Stanovich, 2004). El Sistema 2, en contraste, es lento, consciente y exclusivo de las personas. Es el que tiene que ver netamente con el razonamiento y se puede considerar tardío desde el punto de vista evolutivo. Cabe la posibilidad de que este Sistema 2 revise y, eventualmente, corrija y modifique las intuiciones del Sistema 1. Se han encontrado incluso evidencias neurológicas que parecen apoyar esta teoría dual. Goel y Dolan (2003) realizaron resonancias magnéticas de los cerebros de personas realizando ejercicios intelectuales y notaron que era posible atribuir a cada uno de los dos sistemas un lugar cerebral distinto. En concreto, se puede deducir de sus estudios que el Sistema 1 se relaciona con una activación de la corteza prefrontal ventro-medial y que el Sistema 2 se vincula con la corteza prefrontal lateral derecha. Inglis y Simpson (2006) interpretan los hallazgos de de Groot a partir del esquema de la teoría dual y afirman que, si bien los maestros de ajedrez disponen de capacidades analíticas muy avanzadas, lo más sorprendente es que su “observación” del tablero es diferente a la de los aficionados a este deporte. Es posible deducir, por tanto, que, desde su punto de vista, los expertos en ajedrez perciben exclusivamente lo esencial al valorar los riesgos asociados a cada movimiento y a cada pieza. Parece demostrarse, de este modo, que la experiencia no sólo permite el progreso en capacidades analíticas, sino también en la adquisición de estrategias en el ámbito del Sistema 1, esto es, en el ámbito de la intuición. Y es que, si Reyna (2004) e Inglis y Simpson (2006) están en lo cierto, podemos entender, por ejemplo, por qué los maestros de ajedrez pueden mover piezas de manera intuitiva y rápida, llegando incluso a ser capaces de disputar varias partidas simultáneamente. Lo que sucedería es que utilizan estrategias interiorizadas en su Sistema 1, y, por tanto, inconscientes, que les permiten tomar decisiones y elegir movimientos sin grandes esfuerzos de análisis o de razonamiento. Fuente PASATE POR MIS OTROS POST!!! Los Simpsons y la Geoingenieria Entrevista a Michio Kaku Carl Sagan, el maestro de millones (ACTUALIZADO) Como detectar fraudes Albert Camus Bunge y el Psicoanalisis Carl Sagan y la Existencia de Dios La Sociologia Y Carl Sagan La Psicologia Cientifica y las Pseudopsicologias ¿Que es Cientifico? Educacion y Epistemologia Compleja Buenas Charlas=Neuronas Sincronizadas ¿Geometria Plana o Curva?

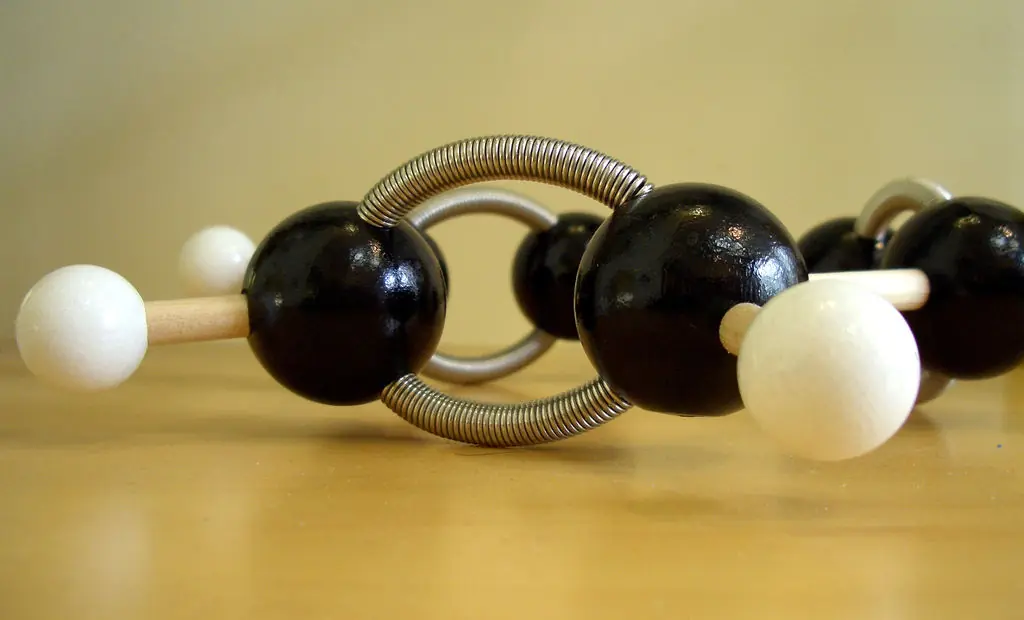

¿Es la creatividad el resultado del esfuerzo o de la inspiración? En el siglo XIX, el químico Kekulé aseguró que había descubierto la estructura de la molécula del benceno gracias a que había soñado con una serpiente que se mordía su cola. Este hecho provocó que muchos pensaran que en la invención no tienen un papel tan importante el estudio y la actividad metódica. No obstante, parece que, en realidad, sí que poseen una función esencial y que la creatividad es el resultado tanto de las peculiaridades subjetivas del individuo como de su formación académica. En el siglo XX, desde el ámbito de la filosofía de la ciencia, aparecieron trabajos que defendían que el descubrimiento científico poseía una lógica, es decir, que era un procedimiento que seguía pasos ordenados. Un enfoque particularmente emblemático en este sentido puede ser el de Hanson (1985). Las tesis de Hanson (1985) pueden ser entendidas como un apoyo a la idea de que la invención y la creatividad en los seres humanos son procesos más afines a la racionalidad que a la irracionalidad, teniendo, por consiguiente, mayor relación con las tareas metódicas que con la actividad guiada por la inspiración que, habitualmente, se les atribuye a los artistas de diferentes ámbitos y que se describe, en ocasiones, por medio de alusiones mitológicas que apelan a las musas griegas. No obstante, existen episodios en la historia de la ciencia que, aparentemente, pueden poner en cuestión este enfoque. Tal puede ser el caso de, por ejemplo, el famoso y conocido sueño de Kekulé. Kekulé fue un reputado químico orgánico alemán que vivió y desarrolló su actividad intelectual a lo largo del siglo XIX (sobre el impacto y la trascendencia de sus investigaciones puede hallarse información relevante en Rocke, 1985, y en Benfey, 1958). Un aspecto importante de su trabajo es el relativo a la mencionada ensoñación, la cual ha sido considerada por algunos como uno de los casos científicos más impactantes, pues condujo nada menos que al descubrimiento de la estructura de la molécula del benceno. Según Kekulé, él pudo describir esta estructura porque soñó con una serpiente que se mordía la cola, lo que le llevó a plantearse la posibilidad de que la molécula del benceno tuviera forma de anillo. Los científicos de su época intentaban descubrir la estructura de la citada molécula a partir del conocimiento disponible sobre otras moléculas de carbono, cuya estructura consistía en cadenas lineales. De esta manera, aunque no se rechazaban otras alternativas, tampoco se consideraban otras opciones. De ahí la trascendencia de la aportación de Kekulé. No obstante, esta sugerente historia pierde gran parte de su encanto a partir de los hallazgos de documentos del propio Kekulé que ilustran cómo fue su verdadero proceso de descubrimiento, el cual se vio acompañado de procedimientos de análisis puramente académicos y científicos, y poco relacionados con lo onírico. En este sentido, quizás podrían ser aplicables a este caso las tesis de Gentner (1983) acerca del razonamiento analógico. Según esta autora, en los procesos de comparación existe una transferencia desde el análogo al tópico (en el caso del sueño de Kekulé, podríamos hablar de una transferencia de la serpiente soñada a la molécula del benceno), transfiriéndose únicamente aquello que es semejante y de interés. Lo que se comparan son nexos relevantes, independientemente de los componentes que esos nexos unen. Desde este punto de vista, un nexo relevante entre la serpiente soñada y la molécula del benceno bien pudo ser la estructura circular. En cualquier caso, un trabajo relativamente reciente, el de Stenning y Van Lambalgen (2002), ha estudiado este caso de la historia de la ciencia y las consecuencias que presenta con respecto a los supuestos de Hanson (1985). Desde su punto de vista, a pesar de que soñar es, efectivamente, un proceso irracional, no hay que olvidar que Kekulé sólo pudo interpretar su sueño como una señal para una hipótesis novedosa porque se hallaba en un contexto histórico de la química determinado. Un científico de otra época que no tuviera relación con dicho contexto no podría haber interpretado su sueño de la misma manera. Por tanto, según ellos, existen tanto niveles idiosincrásicos o subjetivos, como sistemáticos o lógicos, en las actividades creativas y de descubrimiento, y se pueden conciliar estas dos dimensiones. No se trata de despreciar los aspectos personales propios de cada sujeto, sino de recordar que esos aspectos sólo pueden ser fructíferos a partir del contexto teórico en que se dan. Tenemos, de esta manera, que la sugerente historia de que Kekulé descubrió la estructura de la molécula del benceno gracias a un sueño es una verdad incompleta, ya que habría que añadir que el que soñó fue un químico con la formación académica correspondiente a su época y que únicamente en función de esa formación pudo aplicar su sueño a sus estudios. Parece, pues, que la creatividad y la invención no dependen exclusivamente de las particularidades subjetivas de los individuos, y que se necesita estudio, formación y trabajo académico para que las intuiciones den un buen resultado. Hanson y los “amigos de la lógica del descubrimiento” tienen, por tanto, su parte de razón. Las novedades apropiadas en la ciencia precisan de un conocimiento previo que necesita ser debidamente relacionado, analizado y elaborado para poder llegar a descubrimientos. Inspiración y método, ambos factores a la vez, pueden ser la clave . Fuente PASATE POR MIS OTROS POST!!! Los Simpsons y la Geoingenieria Entrevista a Michio Kaku Carl Sagan, el maestro de millones (ACTUALIZADO) Como detectar fraudes Albert Camus Bunge y el Psicoanalisis Carl Sagan y la Existencia de Dios La Sociologia Y Carl Sagan La Psicologia Cientifica y las Pseudopsicologias ¿Que es Cientifico? Educacion y Epistemologia Compleja Buenas Charlas=Neuronas Sincronizadas ¿Geometria Plana o Curva?

No verás muchos objetos como este sobre la faz de la Tierra VER!!! Es, efectivamente, un casco de bombero. Un casco de bombero soviético de 1986. Un casco de bombero soviético que estuvo en Chernóbyl la noche del accidente y que ahora yace olvidado en un armario del hospital abandonado de Pripyat, adonde llevaban a los heridos y enfermos durante las primeras horas. La radiación natural normal suele variar entre veinte y treinta millonésimas de roentgen por hora. El límite máximo de seguridad en la Unión Europea para los trabajadores de la industria nuclear más expuestos equivale aproximadamente a medio roentgen al año (más rigurosamente, 50 milisieverts/año con un máximo de 100 mSv durante cinco años consecutivos). Una exposición a quinientos roentgens en cinco horas se considera generalmente mortal de necesidad. En Hiroshima, una hora después del bombardeo atómico, hacían mil roentgens por hora (Laboratorio Nacional de Oak Ridge, DWG 78-265). Este casco, y el hombre que se cubría con él, estuvo expuesto a una radiación de veinte mil roentgens por hora durante un periodo de tiempo difícil de determinar pero sin duda prolongado. Muchas decenas de minutos. Puede que más de una hora. No verás muchos objetos sobre la faz de la Tierra que hayan estado expuestos a semejante radioactividad. No tan de cerca, al menos. Aún hoy, casi un cuarto de siglo respués, este casco sigue siendo un objeto radioactivo peligroso al que no resulta nada conveniente acercarse demasiado. Si alguien va a robarlo, tiene bastantes números para llevarse la penitencia con el pecado y seguirá teniéndolos durante una larga temporada. Ahora, por favor, vuelve a mirar la foto. César Toimil se acercó, un poquito, para conseguir esta fotografía. César es un lector de este blog, fotoperiodista para la Voz de Galicia, que ha estado tres veces en Chernóbyl con objeto de realizar un libro fotográfico aún inédito sobre el lugar y se lo conoce ya como la palma de su mano. Nos lo cuenta así: un día, paseando por Pripyat con un amigo de fiar… dijo:…me dice: “te voy a enseñar algo que lo ha visto muy poca gente” y me lleva a una habitación del hospital de la ciudad. Un sitio especialmente tétrico y bastante poco fotografiado. Coge un palo largo y con él saca de un armario un casco de bombero. “Este casco pertenece a uno de los bomberos que llegaron primero al incendio del reactor. No encontrarás muchas cosas que hayan estado a más de 20.000 roentgens”. Yo quiero darle las gracias a César por compartirlo con nosotros autorizándome a reproducirla en la Pizarra de Yuri; y recordar a todo el mundo que esta fotografía le pertenece y está protegida por copyright y los demás derechos aplicables en estos casos. César gastó mucho tiempo, trabajo, dinero y algún riesgo para conseguirla, junto al resto de su extraordinaria colección; este esfuerzo no merece que se la pasen al dominio público sin al menos pedirle permiso. Monumento a los liquidadores en Kovel, Ucrania. Fuente PASATE POR MIS OTROS POST!!! "Nada resulta mas engañoso que un hecho evidente"

El debate Dawkins-Collins sobre Ciencia y Fe El siguiente es un debate entre el zoólogo Richard Dawkins, de Oxford, y Francis Collins, que fuera director del programa oficial del genoma humano. Dawkins ocupa la cátedra ‘Charles Simonyi” de Public Understanding of Science de la Universidad de Oxford. Su campo de investigación ha sido la etología y ha escrito un sinnúmero de libros. El último es un best seller y se titula “The God Delusión”. Se ha definido públicamente no sólo como ateo sino como un predicador del ateismo. El Dr. Collins es Director of the Nacional Human Genome Research Institute y ha encabezado el programa oficial del Genoma Humano al frente de 2.400 científicos para mapear los 3.000 millones de letras bioquímicas de nuestra genética. Ha escrito más de 300 artículos científicos y un libro titulado “The Language of God”. Su equipo ha ayudo a descubrir la causa de la fibrosis cystica, de la neurofibromatosis y de la enfermedad de Huntington. Es un cristiano creyente. Vamos a transcribir el debate tal como ha sido publicado por el Time del 13 de noviembre de 2006, sin embargo sabemos de algunos puntos que no se incluyeron en la publicación, como la discusión sobre la historicidad de Jesús y otros, tal como lo manifiesta Collins en “Newsletter” (enero-febrero de 2007), publicación de ASA. Time: Profesor Dawkins, si uno realmente entiende la ciencia, ¿Dios es una ilusión tal como sugiere el título de su libro? Dawkins: La cuestión de si realmente existe un creador sobrenatural, un Dios, es una de las preguntas más importantes que debemos contestar. Yo pienso que es una pregunta científica. Mi contestación es no. Time: Dr. Collins, ¿usted cree que la ciencia es compatible con la fe cristiana? Collins: Sí. La existencia de Dios puede ser verdad o no. Pero llamarla una pregunta científica implica que las herramientas de la ciencia pueden proveer la contestación. Desde mi perspectiva, Dios no puede estar totalmente contenido dentro de la naturaleza y, por lo tanto, está fuera de la habilidad de la ciencia dar una respuesta. Time: Stephen Jay Gould, un famoso paleontólogo de Harvard, argumentó, que ciencia y religión pueden coexistir, porque ocupan cajas separadas herméticamente. Parecería que ambos de ustedes discrepan. Collins: Parecería que Gould levanta una pared artificial entre dos visiones comunes que no existen en mi vida. Porque creo fehacientemente en el poder creativo de Dios, creando en primer lugar todo lo que existe, encuentro que estudiar el mundo natural me da la oportunidad de observar la majestad, la elegancia, lo intrincado de la creación de Dios. Dawkins: Pienso que los compartimientos separados de Gould fueron un ardid meramente político para ganarse a los religiosos tibios hacia el campo de la ciencia. Pero es una idea vacía. Hay muchos espacios donde la religión no se mantiene distante del campo científico. Cualquier creencia en milagros es totalmente contradictoria, no sólo con los hechos de la ciencia sino con el espíritu de la ciencia. Time: Profesor Dawkins, ¿piensa Usted que la teoría de la evolución de Darwin va más allá que una simple contradicción a la historia del Génesis? Dawkins: Sí. Durante siglos, el argumento más poderoso sobre la existencia de Dios en el mundo físico fue el llamado argumento del diseño: las cosas vivientes eran tan hermosas y elegantes, tan aparentemente diseñadas que solo pudieron ser hechas por un diseñador inteligente. Pero Darwin produjo una explicación más sencilla. Su vía es un gradual y mejorado crecimiento comenzando en inicios muy simples, y trabajando paso a paso mediante pequeños progresos hacia más complejidad, más elegancia, más perfección adaptable. Cada paso no es demasiado improbable para que nosotros no podamos entender, pero cuando los sumamos en forma acumulativa durante millones de años, tenemos esos monstruos de improbabilidad, como el cerebro humano o un bosque tropical muy denso donde llueve todo el año. Debería ser una advertencia, a que nunca más asumamos que porque algo es complicado, lo debe haber hecho Dios. Collins: No veo que la narración básica sobre la evolución del Profesor Dawkins sea incompatible con que la haya diseñado Dios. Time: ¿Cuándo habrá esto ocurrido? Collins: Siendo Dios sobrenatural, Él también está fuera del tiempo y del espacio. Por lo tanto, al momento de la creación del universo, Dios también pudo haber activado la evolución, con total conocimiento de cómo iba a resultar, y más aún incluyendo el hecho de estar ahora manteniendo esta conversación. La idea que Él no sólo puede predecir el futuro, nos da espíritu y libre albedrío para realizar nuestros deseos, se torna enteramente aceptable. Dawkins: Creo que eso es tremendamente desechable. Si Dios quiso crear vida y seres humanos, sería muy rara la extraordinaria e indirecta forma de esperar 10.000 millones de años antes de iniciar vida alguna y luego esperar otros 4 mil millones de años hasta arribar a que se logren seres humanos capaces de adorar y pecar y todas esas otras cosas que a la gente religiosa le interesa. Collins: ¿Quiénes somos nosotros para decir que fue una forma rara de hacerlo? Yo no creo que sea el propósito de Dios que sus intenciones sean absolutamente obvias para nosotros. Si a Él le conviene ser una divinidad que debemos buscar, sin estar presionados a hacerlo, ¿no hubiera sido razonable para Él usar el mecanismo de la evolución sin colocar señales o vías obvias para revelar su rol en la evolución? Time: Sus dos libros sugieren que si las constantes universales, las seis o más que caracterizan nuestro universo, hubieran variado en algún modo, eso hubiera hecho la vida imposible. Dr. Collins, ¿puede suministrarnos un ejemplo? Collins: Si la constante gravitacional hubiera variado en una parte en cientos de millones de millones, luego la expansión del universo después del big bang no hubiera ocurrido de la manera necesaria para que existiera vida. Cuando observamos la evidencia, es difícil pensar que esto fue simple casualidad. Pero si desea considerar la posibilidad de un diseñador, esto resulta una explicación pausible para lo que de otra manera es un evento excesivamente improbable, particularmente nuestra existencia. Dawkins: La gente que cree en Dios concluye que debe haber un accionador divino de una perilla que accionó, a su vez, las perillas de media docena de estas constantes para que sean exactamente adecuadas. El problema es que esto significa, porque hay algo bastamente improbable, que necesitamos un Dios para que nos lo explique. Pero Dios mismo sería aún más improbable. Los físicos han arribado a otras explicaciones. Una es que estas seis constantes no son libres para variar. Algunas teorías unificadas eventualmente demostrarán que están tan ligadas como la circunferencia y el diámetro de un círculo. Esto reduce las probabilidades que todas ellas ocurren independientemente solo para encajar en el proyecto. La otra vía es la de los multiversos. Esta dice que a lo mejor el universo que habitamos es uno de un gran número de universos. La gran mayoría no tendría vida porque tienen una constante gravitacional equivocada. Pero como el número de universos aumenta, las probabilidades apuntan a una pequeña minoría de universos que tengan las adecuadas constantes. Collins: Esta es una elección interesante. Salvo una solución teórica que yo creo improbable, Usted debería decir que hay millones de millones de universos paralelos allá afuera, que no podemos observar en el presente, o debe decir que hay un plan. Yo encuentro el argumento de la existencia de un Dios, que hizo la planificación, más lógico que el burbujear de todos estos multiversos. De manera que la navaja de Occam –Occam dice que uno debe elegir la explicación más simple y directa- me guía a creer más en Dios que en el multiverso, que parece una exageración para la imaginación. Dawkins: Acepto que hay cosas más grandes y más incomprensibles de las que podemos imaginar. No puedo entender porqué Usted invoca improbabilidad y aún no admite que se está pegando un tiro en su pie por postular algo igual- mente improbable, mágicamente, en la existencia de la palabra Dios. Collins: Mi Dios no es improbable para mí. El no necesita una historia de su creación, o ser explicado por otra cosa. Dios es la contestación a todas aquellas preguntas de ¿Cómo todo se ha originado? Dawkins: Creo que ésta es la madre y padre de todo esto. Es una honesta búsqueda científica descubrir de donde proviene esta aparente improbabilidad. Ahora, el Dr. Collins dice: “Bueno, Dios lo hizo y Dios no necesita explicación porque Dios está fuera de todo esto”. Bueno, esto es una increíble evasión de la responsabilidad a contestar. Los científicos no hacen esto. Los científicos dicen: “Estamos trabajando en esto, nos esforzamos por entender”. Collins: Por cierto que la ciencia debería continuar para ver si puede hallar evidencia para los multiversos que puedan explicar porqué nuestro universo está tan bien afinado. Pero objeto la aseveración que cualquier cosa fuera de la naturaleza está fuera de la conversación. Este es un empobrecido punto de vista a preguntas que nosotros los humanos podemos hacer, tales como ¿Por- qué estoy aquí?, ¿Qué sucede después que morimos? ¿Hay un Dios? Si Usted se niega a reconocer lo apropiado de estas preguntas, arribamos a la probabilidad cero con respecto a Dios después de haber examinado el mundo natural porque no te convence sobre una base de evidencia. Pero si mantiene su mente abierta sobre que Dios puede existir, puede apuntar a aspectos del universo que son consistentes con esa conclusión. Dawkins: Para mí, el enfoque más correcto es decir que somos profundamente ignorantes en estos temas. Necesitamos trabajar más en este aspecto. Pero de repente, decir que la contestación es Dios, pareciera que es para terminar la discusión. Time: ¿Podría la contestación ser Dios? Dawkins: Podría haber algo increíblemente grande e incomprensible y que está más allá de nuestro entendimiento. Collins: Eso es Dios. Dawkins: Sí. Pero pudiera ser cualquiera de mil millones de dioses. Podría ser el Dios de los marcianos o de los habitantes de Alfa de Centauro. Las posibilidades de que sea un Dios en particular, Yahweh, el Dios de Jesús, es por lo menos mínima, la obligación recae sobre Usted para demostrar que éste es el caso. Time: El libro del Génesis ha guiado a muchos protestantes conservadores a oponerse a la evolución y algunos insisten que la tierra sólo tiene 6.000 años. Collins: Hay creyentes sinceros que interpretan Génesis 1 y 2 en una forma literal que francamente es inconsistente con nuestro conocimiento sobre la edad de nuestro universo o como los organismos vivientes se relacionan. San Agustín escribía que básicamente era imposible de entender lo que estaba siendo descripto en el Génesis. No se debía entender como un libro de ciencia. Debía entenderse como la descripción de quien era Dios y quienes somos nosotros y cual se supone que es nuestra relación con Dios. Agustín explícitamente nos advirtió contra una perspectiva muy estrecha que expondría nuestra fe a parecer ridícula. Si Usted da un paso atrás de esa estrecha interpretación, lo que la Biblia describe es muy consistente con el Big Bang. Dawkins: Los físicos están trabajando sobre el Big Bang y algún día pueden o no resolverlo. No obstante, lo que el Dr. Collins ha especificado…, ¿puedo llamarlo Francis? Collins: Por favor, Richard, hágalo. Dawkins: Lo que Francis estaba diciendo sobre el Génesis era, por supuesto, una pequeña discusión privada entre él y sus colegas fundamentalistas…. Collins: No es tan privada. Es bastante pública…(risas). Dawkins: Sería raro que yo interviniera, excepto para sugerir que se ahorraría mucho trabajo simplemente si no los considerara. ¿Por qué hacernos problema con estos payasos? Collins: Richard, no creo que adjudicarle nombres a gente sincera contribuiría a un diálogo entre ciencia y fe. Eso endurecería más la posición. En este aspecto, los ateos parecieran más arrogantes y caracterizar la fe como algo que solo un idiota defendería, no ayudaría en este caso. Time: Dr. Collins, la Resurrección es un argumento fundamental en la fe cristiana, ¿junto con el nacimiento virginal y los milagros no hacen mella a los métodos científicos, que dependen de la constancia de leyes naturales? Collins: Si Usted contesta que sí a un Dios fuera de la naturaleza, luego no hay nada inconsistente para Dios que en raras ocasiones elige invadir el mundo material de manera que pareciera milagroso. Si Dios hizo las leyes naturales, ¿por qué no podría el violarlas cuando fuera un momento particularmente significativo para que Él lo hiciese? Y si Usted acepta la idea que Cristo también es divino, que yo sí, luego su Resurrección no es en sí mismo un gran salto lógico. Time: La mera noción de los milagros, ¿desplazaría la ciencia? Collins: De ninguna manera. Si está en el campo que yo estoy, un lugar que ciencia y fe podrían aproximarse es la investigación sobre supuestos eventos milagrosos. Dawkins: Si hay algo que le cierra la puerta en la cara a la investigación constructiva es la palabra milagros. Para un labrador del medioevo, una radio sería un milagro. Todo tipo de cosas, que se podrían clasificar como milagros, pueden pasar a la luz de la ciencia actual, de la misma manera que en el medioevo apareciera un Boeing 747. Francis continúa diciendo cosas como ‘Desde el punto de vista de un creyente’. Una vez que Usted adopta la posición de la fe, te encuentras repentinamente perdiendo tu escepticismo natural y tu científica – realmente científica- credibilidad. Ruego me perdone mi descortesía. Collins: Richard, de hecho, estoy de acuerdo con la primera parte de lo que Usted dijo. Pero, le restaría su exposición sobre que mis instintos científicos son menos rigurosos que los suyos. La diferencia es que mi presunción sobre la posibilidad de Dios, y por lo tanto lo sobrenatural, no es cero, y la suya, sí. Time: Dr. Collins, Usted ha descrito el sentido moral de la humanidad no sólo como regalo de Dios, sino también como señal de que Él existe. Collins: Hay todo un campo de investigación que ha brotado en estos últimos 30 ó 40 años –algunos lo llaman psicología sociológica y evolutiva- relacionado con de dónde sacamos nuestro sentido moral y porqué valoramos la idea del altruismo, y localizando ambas preguntas en adaptaciones de conducta para la preservación de nuestros genes. Pero si Usted cree, y Richard ha sido claro en esto, que la selección natural opera sobre el individuo no en un grupo, luego ¿porqué el individuo arriesgaría su propio ADN haciendo algo desinteresado para ayudar a alguien, de tal manera que pudiera disminuir sus posibilidades de reproducción? Convenido, podríamos tratar de ayudar a miembros de nuestra propia familia porque compartimos nuestro ADN. O ayudar a alguien esperando que ellos nos ayuden recíprocamente. Pero cuando observamos lo que nosotros denominaríamos la más generosa manifestación de altruismo, ellas no se basan en selección de parentela o reciprocidad. Un ejemplo máximo podría ser el de O. Schindler arriesgando su vida para salvar a más de 1.000 judíos de las cámaras de gas. Esto es lo opuesto a salvar sus genes. Vemos versiones menos dramáticas todos los días. Muchos de nosotros pensamos que estas cualidades pueden provenir de Dios, especialmente desde que justicia y moralidad son dos atributos que rápidamente identificamos con Dios. Dawkins: ¿Puedo comenzar con una analogía? La mayoría de la gente entiende que el deseo sexual está relacionado con la propagación de los genes. La copulación en la naturaleza tiende hacia la reproducción y, por ende, a más copias genéticas. Pero en la sociedad moderna, la mayoría de las copulaciones involucran lo contraceptivo, diseñado precisamente para evitar la reproducción. El altruismo tiene sus orígenes igual que lo tiene la lujuria. En nuestro pasado prehistórico, hubiéramos vivido en familias numerosas, rodeados por nuestros parientes cuyos intereses hubiéramos deseado promover, porque compartíamos nuestros genes. Ahora vivimos en grandes ciudades. No estamos cerca de nuestros parientes ni con personas que serán recíprocos con nuestras buenas obras. No importa. De la manera que hay personas involucradas en sexo contraceptivo que ignoran el ser motivados por tener bebes, no cruza por nuestras mentes que la razón de hacer el bien está basada en el hecho que nuestros ancestros primitivos vivieron en pequeños grupos. Pero eso me parece alta- mente justificable para explicar, de donde proviene el deseo de moralidad y el deseo de la bondad. Collins: Que Usted argumente que nuestros más nobles actos son un fallo de la conducta darwiniana no hace justicia al sentido que todos tenemos sobre los valores del bien y el mal. La evolución puede explicar algunas fases de la ley moral, pero no puede explicar porqué debiera tener algún verdadero significado. Si sólo es una conveniencia evolutiva, no hay en realidad nada bueno o malo. Pero para mí, es mucho más que esto. La ley moral es una razón para considerar a Dios como plausible, no sólo un Dios que pone el universo en movimiento, pero un Dios que quiere a los seres humanos, porque parecemos únicos entre las criaturas en este planeta que poseemos este intenso sentido de moral. Lo que Usted dice es que fuera de la mente humana explicada por procesos evolutivos, el bien y el mal no tienen sentido. ¿Usted está de acuerdo con esto? Dawkins: Aún la pregunta que Usted me formula carece de sentido para mí. Bien y mal, Yo no creo que ande por ahí, en ningún lugar, algo que se llame el bien y algo que se llame el mal. Creo que ocurren cosas buenas y cosas malas. Collins: Creo que es la diferencia fundamental entre nosotros. Me alegra que la hemos identificado. Time: Dr. Collins. Se que Usted está a favor de la apertura de líneas de investigación sobre células madres. ¿Pero no es cierto que muchas personas, debido a su fe, no están a favor, creando así una percepción de que la religión está evitando que la ciencia salve vidas? Collins: Primero déjeme decir que al estar en desacuerdo hablo como un ciudadano privado y no como el representante de la Rama Ejecutiva del Gobierno de Estados Unidos. La impresión que la gente creyente se opone en forma uniforme a la investigación de las células madres no está documentada por medición alguna. De hecho, muchas personas de fuerte convicciones religiosas piensan que esto es una apertura con apoyo moral. Time: Pero al punto que una persona discute en base a su fe o a las Escrituras antes que razonar, ¿cómo pueden los científicos responder? Collins: Fe no es lo opuesto a la razón. La fe se apoya perfectamente sobre la razón, pero con el agregado de la revelación. De manera que tales discusiones entre creyentes y científicos ocurren fácilmente. Pero ni los científicos ni los creyentes incorporan los hechos en forma precisa. Los científicos pueden tener sus juicios nublados por sus aspiraciones profesionales. Y la pura fe, que Usted puede considerar como agua pura, es vertida en vasijas oxidadas llamadas seres humanos, de manera que muchas veces los buenos principios de la fe pueden ser distorsionados cuando se endurecen las posiciones. Dawkins: Para mí, cuestiones morales como la investigación de células madre, aparecen cuando hay causa de sufrimiento. En este caso claramente no lo hay. Los embriones no tienen su sistema nervioso. Pero eso no se discute pública- mente. El asunto es ‘¿Son humanos?’ Si es un moralista absoluto, Usted dice ‘Estas células son humanas y, por lo tanto, merecen algún tipo de tratamiento moral’. La moral absoluta no necesariamente proviene de la religión, pero por lo general sí. Matamos animales no humanos en mataderos y ellos sí tienen sistema nervioso y sí sufren. Gente de fe no están interesados en su sufrimiento. Collins: ¿La moral de las vacas difiere de aquellas de los humanos? Dawkins: A lo mejor, los humanos tienen responsabilidad moral porque son capaces de razonar. Time: ¿Tienen ustedes algunas conclusiones finales? Collins: Solo me gustaría agregar, que como científico y creyente durante más de un cuarto de siglo, no encuentro absolutamente nada en conflicto entre lo acordado con Richard en prácticamente todas sus conclusiones sobre el mundo natural, y agregar que puedo aceptar y abrazar la posibilidad que hay contestaciones que la ciencia no puede proveer con respecto al mundo natural, las preguntas sobre porqué en lugar de las preguntas de cómo. Me interesan los porqués. Encuentro muchas de estas contestaciones en el campo espiritual. Eso de ninguna forma compromete mi habilidad de pensar como científico. Dawkins: Mi mente no está cerrada, como vos Francis muchas veces sugeriste. Mi mente está abierta al maravilloso campo de probabilidades futuras, que yo ni siquiera puedo soñar, ni Usted tampoco, ni nadie. Soy medio escéptico con la idea de que cualquier maravillosa revelación que aparezca en la ciencia del futuro resulte como una de las particulares revelaciones religiosas que la gente soñó. Cuando comenzamos y hablamos sobre los orígenes del universo y las constantes físicas, yo suministré lo que yo creí eran argumentos convincentes contra un diseñador sobrenatural inteligente. A mí me parece una idea digna. Refutable, pero no obstante grandiosa y suficientemente digna de respeto. No veo los dioses olímpicos, o Jesús abatido y muriendo en una cruz, como digno de esa grandeza. Me parece parroquial. Si hay un Dios, va a ser mucho más grande y mucho más incomprensible que los que cualquier teólogo de cualquier religión hayan propuesto. FUENTE PASATE POR MIS OTROS POST!!! Así vuela un Avión El Tao de la Fisica Magia Naturalis La Danza de los Maestros Relatividad y Cuantica en la practica La venganza de la tierra La trama de la vida El principio de integridad cientifica de Richard P Feynman Cesar Millan: El encantador de perros Ciencia vs Pseudociencia Carl Sagan, el maestro de millones (ACTUALIZADO) Carl Sagan y la Existencia de Dios ¿Geometria Plana o Curva?

La Biomecánica del pájaro carpintero Un pájaro carpintero puede taladrar el tronco de un árbol hasta hacer un agujero golpeándolo a un ritmo entre 18 y 22 veces por segundo con una desaceleración de 1.200 g, cientos de veces mayor que la que experimenta un astronauta, y sin sufrir daño alguno en su cerebro (el estadounidense Eli L. Beeding Jr. ostenta desde 1958 el récord mundial al soportar 82’6 g durante 0’04 segundos; después se pasó tres días en un hospital). Un nuevo artículo de Yoon y Park, de la Universidad de California en Berkeley, se inspira en el secreto del pájaro carpintero para desarrollar un sistema de amortiguación de vibraciones para dispositivos microfabricados móviles. Una de las claves es el hueso esponjoso que rodea y protege el cráneo de este pájaro, pero no es la única. El nuevo sistema de amortiguación bioinspirado puede soportar hasta 60.000 g (comprobado con una escopeta de aire comprimido con un calibre de 60 mm). La biomecánica del pájaro carpintero se ha descubierto gracias a un estudio mediante tomografía computarizada de rayos X que ha conducido a un modelo biomecánico de la amortiguación de lass vibraciones en su cráneo. El artículo técnico, de acceso gratuito, es Sang-Hee Yoon, Sungmin Park, “A mechanical analysis of woodpecker drumming and its application to shock-absorbing systems,” Bioinspiration & Biomimetics 6: 016003, Published 17 enero 2011. En el vídeo que abre esta entrada se observa a un carpintero de vientre rojo (Melanerpes carolinus) natural de América del Norte que golpea con insistencia un desagüe metálico, creyendo por error que se trata de un poste de madera. En la figura de arriba se muestra un detalle de la postura del animal durante un golpe rápido contra el desagüe (en el vídeo de youtube el carpintero alcanza hasta 20 golpes por segundo). Como se observa en la figura el carpintero hace palanca con su cuerpo y utiliza su cola para estabilizarse. Los autores del estudio han utilizado tomografía computarizada de rayos X para observar el cráneo del carpintero de frente dorada (Melanerpes aurifrons), pájaro natural de centroamérica y del sur de los EE.UU., como muestra la figura de abajo, que muestra el pico (beak), el hueso esponjoso (spongy bone), el hueso del cráneo (skull bone) y el hioide (hyoid). Los autores del artículo han desarrollado un modelo biomecánico simplificado del sistema de amortiguación de golpes del pájaro carpintero. La figura de arriba muestra el modelo cinemático del golpe; un carpintero de frente dorada puede alcanzar los 28 golpes por segundo y es capaz de golpear un árbol repetidamente entre 500 y 600 veces al día. En la figura de abajo se muestra un modelo biomecánico de parámetros concentrados para el sistema de amortiguación del carpintero (un modelo simplificado basado en masas, muelles y amortiguadores). Para modelar las propiedades del hueso esponjoso han desarrollado un modelo experimental que hace vibrar un cilindro metálico relleno de microbolitas de cuarzo de diferentes diámetros (68, 120, 375, 500, y 875 μm); gracias a este modelo han descubierto que el hueso esponjoso actúa como un filtro paso bajo para las frecuencias de vibración con cierto factor de atenuación. El mecanismo de amortiguación del pájaro carpintero sugiere que para mejorar la tolerancia a fuerzas G altas de dispositivos microfabricados hay que utilizar: 1_ Una capa externa de alta resistencia que proteja al microdispositivo de daños físicos (como deformaciones, fracturas, etc.), lo que en el pájaro carpintero es el pico. 2_ Una capa viscoelástica que distribuya uniformemente las vibraciones mecánicas, lo que en el pájaro es como el hioides. 3_ Una estructura porosa resiliente que filtre las altas frecuencias de vibración mecánica y evite su transmisión al microdispositivo, lo que en el carpintero es el hueso esponjoso; y 4_ Otra capa de alta resistencia que contenga a la estructura porosa, como el hueso del cráneo en el pájaro. Gracias a estas ideas, Yoon y Park han desarrollado un sistema de absorción de impactos para microdispositivos biológicamente inspirado, que aparece en la figura de abajo. Para demostrar que el nuevo sistema funciona han utilizado un rifle de aire comprimido con un calibre de 60 mm que permite acelerar los microdispositivos (recubiertos con su protección) hasta aceleraciones de 60.000 g. El sistema de protección, denominado BIRD-II, ha funcionado con una eficacia increíble. Sólo el 0’7% de los microdispositivos ha sufrido daños; con un sistema más convencional, también bioinspirado, llamado BIRD-I el número de microdispositivos que sufrieron daños fue del 26’4%. En resumen, la ingeniería bioinspirado y/o biomimética no para de ofrecernos sorpresas, demostrando que la colaboración entre biólogos e ingenieros puede conducir a grandes avances tecnológicos. FUENTE PASATE POR MIS OTROS POST!!! Multiverso y ser infinito avanses cicologicos Así vuela un Avión El Tao de la Fisica Magia Naturalis La Danza de los Maestros Relatividad y Cuantica en la practica La venganza de la tierra La trama de la vida El principio de integridad cientifica de Richard P Feynman Cesar Millan: El encantador de perros Ciencia vs Pseudociencia Carl Sagan, el maestro de millones (ACTUALIZADO) Carl Sagan y la Existencia de Dios ¿Geometria Plana o Curva?

La Gran Mortandad En comparación, lo de los dinosaurios no pasó de broma pesada. Hace 251,4 millones de años, algo mató al 96% de las especies marinas, al 70% de los vertebrados terrestres y a una inmensa cantidad de insectos y plantas. Fue el Gran Morir, y aún no tenemos claro por qué Impresión artística, científicamente rigurosa, de la vida a orillas de un río del Pérmico medio. Casi todo esto y muchas cosas más desaparecieron con el Gran Morir. Si los gorgonópsidos hubieran tenido noticieros como los nuestros, seguramente habrían puesto la noticia al final, justo antes de los deportes. O a lo mejor ni siquiera eso. Los volcanes son muy espectaculares y quedan guapos en la tele, pero esto comenzó más bien como una suave erupción de lava en la costa nororiental de Pangea. Ellos no tenían ninguna manera de saberlo, y sin embargo estaban ante el inicio de las temibles escaleras siberianas, el principio del acto final en el mayor proceso de extinción que se ha visto en el planeta Tierra jamás y que acabaría con ellos también. Los humanos, que no aparecimos por aquí hasta doscientos cincuenta millones de años después, la llamamos la extinción supermasiva del Pérmico-Triásico (P-Tr). Más brevemente, la Gran Mortandad. O el Gran Morir. Porque eso fue exactamente lo que pasó: muerte a una escala planetaria, sobrecogedora, general. Si mañana hiciéramos estallar a mala baba todo lo que guardamos en nuestros arsenales más devastadores y sofisticados, no provocaríamos (en principio) nada ni parecido; nos vendría justito para extinguirnos a nosotros mismos, algo no muy meritorio, y relativamente poco más. Puede que el invierno nuclear subsiguiente llegara a producir una pequeña extinción. En cambio, el Gran Morir aniquiló al 96% de las especies marinas, al 70% de los vertebrados terrestres y a tantas plantas e insectos que aún andamos contándolos, entre otras cosas porque apenas quedó rastro de todos ellos. Y matar a tanto insecto sí que tiene mérito: son los seres pluricelulares más resistentes que hay. Acabó con seres tan ubicuos y resistentes como los trilobites, que llevaban aquí 270 millones de años y ocupaban prácticamente todos los nichos ecológicos marinos. Al menos una tercera parte de los insectos desaparecieron, especialmente aquellos tan grandes típicos del periodo anterior. No hubo más escorpiones marinos, que dominaban el océano. Los blastozoos se fueron también. Los helechos con semilla se extinguieron y a las gimnospermas les costó una buena temporada reaparecer. No se generó carbón durante el periodo, a diferencia de lo ocurrido característicamente en el Carbonífero precedente, lo que invita a pensar que la práctica totalidad de las plantas turberas cayeron. Hasta el 60% de todas las especies vivas dejaron de existir. Puso un gigantesco punto y aparte a la historia de la vida en el planeta Tierra, al menos por encima del nivel de las bacterias y archaeas; tanto es así, que consideramos que el Paleozoico con toda su vida primitiva termina ahí. La recuperación fue muy lenta: más de treinta millones de años. Verdaderamente, la extinción supermasiva del Pérmico-Triásico fue el Gran Morir. Y, como suele ocurrir con la muerte, también el principio del Gran Vivir que permitió el surgimiento de las formas de vida avanzadas. Eso nos incluye, claro, a ti y a mí: una extinción nos abrió el camino y otra nos lo cerrará, a menos que aprendamos a impedirlo alguna vez. Mapamundi terrestre a finales del Pérmico, cuando sucedió el Gran Morir. Las escaleras siberianas entraron en erupción en la costa oriental de la región de aguas poco profundas situada justo al norte. Fuente: Dr. Ron Blakey, profesor emérito de geología en la Universidad de Arizona del Norte. Del Pérmico El Pérmico recibe su nombre por la ciudad de Perm, situada en Rusia a caballo entre Europa y Asia, alrededor de la que se encuentran una gran cantidad de fósiles de aquellos tiempos (sobre todo en los Montes Urales). Fue un periodo geológico con una duración de casi cincuenta millones de años (comenzó aproximadamente hace 299 millones de años y terminó hace unos 250, precisamente con esta extinción) en el que ocurrieron un montón de cosas interesantes, como la evolución claramente diferenciada de los saurópsidos –que darían lugar a los reptiles, incluyendo a los dinosaurios y luego a las aves– y los sinápsidos –donde se originaron los mamíferos, o sea, nosotros–. En tiempos pérmicos, la deriva continental estaba empujando a todos los continentes contra sí mismos hasta constituir uno solo: un supercontinente gigantesco donde se concentrarían casi todas las tierras emergidas del planeta Tierra, al que llamamos Pangea. Este supercontinente estaba –lógicamente– rodeado por un superocéano aún mayor, que bautizamos como Panthalassa. Para cuando sucedió el Gran Morir, una región insular separatista a la que llamamos Cimmeria había comenzado a desprenderse, desarrollando el Océano Paleo-Tetis; mientras que, al norte, Siberia terminaba de formar la Pangea una y grande precipitándose hacia el sur. El clima pérmico varió significativamente a lo largo de tanto millón de años, desde las glaciaciones del Carbonífero final, que había provocado el colapso de la pluviselva tropical, hasta la dislocación térmica masiva que coincidió con la gran extinción. Pero la presencia de un supercontinente tan grande como Pangea hizo que se mantuvieran algunas tendencias a lo largo de todo el periodo. Por ejemplo, el clima del interior de Pangea tendía a ser supercontinental, con veranos muy calurosos, inviernos gélidos y pocas precipitaciones, lo que daba lugar a un entorno muy seco. Esto estaba matizado por fortísimos monzones, con lluvias muy intensas pero muy estacionales, más importantes cerca de las costas. Con gran probabilidad, los vientos debían ser bastante más fuertes que en la actualidad, debido a las elevadas diferencias térmicas entre el interior de Pangea y las costas y mares de Panthalassa. Estratos de arenisca del límite Pérmico-Triásico fotografiados en Runcorn Hill, Reino Unido La presencia de oxígeno atmosférico, que había llegado al 35% a finales del Carbonífero, descendió durante todo el Pérmico y cuando ocurrió el Gran Morir era del 16%, un poco menor que la actual (20%); seguiría descendiendo hasta bien entrado el Triásico, llegando a caer hasta el 12%. Se sospecha seriamente que esta variación del oxígeno atmosférico está estrechamente relacionada con los complejos fenómenos planetarios que condujeron a la catástrofe, y que bien podían haberse puesto en marcha mucho tiempo atrás. Un paisaje típico de Pangea a finales del Pérmico podría estar constituido por un bosque de coníferas, helechos con semillas y gimnospermas donde revoloteasen grandes blatópteros, libélulas o caballitos del diablo, sin mariposas ni aves. Tampoco había flores aún. Por entre el follaje medrarían seres como los gorgonópsidos, los dicinodontes o los primeros arcosauriformes que antecedieron a los dinosaurios. Al fondo, algunos de los grandes pareiasaurios herbívoros. Seguramente a esas alturas ya no quedaban dimetrodontes, pero sí batracosaurios y temnospónlidos. Debido al bajo nivel de oxígeno, respirar nos resultaría tan difícil como en lo alto de una gran montaña de hoy en día o cosa parecida; por lo demás, no hay ninguna razón por la que no pudiéramos sobrevivir en el lugar. Seguramente las bacterias y virus de aquel tiempo no nos afectarían, dado que no habrían tenido ocasión de co-evolucionar con nosotros. En cambio, sería de lo más razonable evitar a cualquier cosa capaz de tirar bocados, que no eran pocas. Así era nuestra Tierra vieja cuando lentamente comenzó la catástrofe ecológica más grande de todos los tiempos. Al parecer hubo varios pulsos de extinción consecutivos a lo largo de los veinte millones de años anteriores que habrían dejado a la vida en un estado convaleciente relativamente frágil. Pero el Gran Morir se concentró sobre todo en el último, de aproximadamente un millón de años de duración o puede que incluso menos. De hecho, muchos animales pudieron desaparecer en apenas 10.000 – 60.000 años, con la mortandad disparándose masivamente a partir de un determinado instante radiodatado hace 251.400.000 años, teniendo en cuenta un margen de error de treinta milenios arriba o abajo. A las plantas les costó un poco más, unos pocos cientos de miles de años. Y parece que hubo varios sub-pulsos, separados 730.000 y 1.220.000 años entre sí. Pero todo apunta a que se trató de un evento súbito, una gran catástrofe repentina en términos geológicos. Y no hay muchas cosas que le puedan hacer semejante mal, tan deprisa, a algo tan feraz, tan absurdamente resistente como la vida. Mapamundi de la deriva continental terrestre a lo largo de 800 millones de años (650 conocidos del pasado y 150 proyectados hacia el futuro). La escalera siberiana Las escaleras siberianas en la actualidad. Foto: Mikhail Maksimov Las hipótesis sobre las causas del Gran Morir son muchas y variadas, pero para ser admisibles, deberían explicar algunos de los fenómenos observados durante este proceso. Y en el Gran Morir se produjeron varios fenómenos muy singulares, que ninguna de ellas explica hoy por hoy en su totalidad. El primero de estos fenómenos observados en los estratos geológicos del periodo es una notabilísima alteración de las proporciones globales entre los isótopos carbono-12 y carbono-13. En algún caso, el descenso de carbono-13 con respecto al carbono-12 llega al 42 ‰. ¿Y esto qué significa? Bueno, resulta que como ocurre con todos los átomos, se presentan en la naturaleza con una determinada proporción entre sus distintos isótopos. El carbono-12 constituye el 98,93% del carbono presente en el medio ambiente terrestre, mientras que el carbono-13 representa el 1,07%. Sin embargo, los seres vivos tienden a fijar una proporción menor del isótopo 13, y cada ser vivo lo hace además en unas cantidades determinadas; estas variaciones constituyen la llamada firma isotópica. Pero también, de manera muy característica, la presencia masiva de este carbono extremadamente bajo en isótopo 13 resulta típica en las grandes erupciones volcánicas y ciertos depósitos de gases subterráneos con origen orgánico. Extraer una conclusión directa de esta variación de las proporciones entre el carbono-13 y el carbono-12 sería muy aventurado, pero hay algo que indica con claridad: el ciclo del carbono terrestre quedó brutalmente alterado durante la extinción supermasiva del Pérmico-Triásico. Estas alteraciones del carbono-13 se puede medir en los estratos geológicos correspondientes a todas las extinciones, pero en el caso del Gran Morir resulta espectacular: es del 2,5 – 10 ‰ a nivel global y en algunos puntos llega hasta el 42 ‰. Entonces, inevitablemente, todo el mundo mira en la dirección de otro fenómeno monumental sucedido exactamente en ese mismo momento. Hace 251 millones de años comenzaba una de las mayores erupciones volcánicas de la historia terrestre, en las orillas del continente ancestral que ahora forma parte de lo que llamamos Siberia. Como apunté al principio, no se trató de una gran explosión, sino de la efusión rápida de grandes cantidades de lava caliente y poco viscosa a lo largo del siguiente millón de años. Por las formas características que forma la lava al solidificarse en estos casos, que recuerdan a una escalera, se denominan con la palabra sueca trapp (que significa eso mismo). Y por eso a esta enorme erupción se la conoce en todo el mundo como siberian trapps (en ruso original: Сибирские траппы), que a veces se ve (erróneamente) traducido al castellano como trampas siberianas pero en realidad quiere decir escaleras siberianas. Extensión de las escaleras siberianas en un mapa actual. Las escaleras siberianas son una de las dos erupciones más grandes ocurridas en aguas poco profundas o en la superficie terrestre de las que queda alguna pista (las hubo mayores, pero ocurrieron en el fondo oceánico, lo que matiza sus efectos). Se estima que proyectó entre uno y cuatro millones de kilómetros cúbicos de lava basáltica, cubriendo unos siete millones de kilómetros cuadrados de terreno, más una cantidad aún indeterminada pero extraordinariamente grande de gases de efecto invernadero entre los que se encontraba el CO2. Para hacernos una idea, la erupción explosiva conocida más potente de todas las épocas (Guarapuava – Tamarana – Sarusas, durante las escaleras de Paraná y Etendeka, hace unos 130 millones de años) proyectó al exterior unos 8.600 km3 de material. Es decir: entre cien y cuatrocientas cincuenta veces menos. Digámoslo: es imposible pensar en una gran extinción, con un descenso acusado del carbono-13, y no pensar instantáneamente en una de las mayores erupciones de la historia de la Tierra que sucedía en ese mismo momento exacto. Sin embargo, tenemos un problema, y es que ni siquiera esa inmensa erupción basta para explicar una caída tan grande en el isótopo carbono-13, por varios órdenes de magnitud. Casi con total seguridad, ambos fenómenos tienen que estar relacionados de algún modo. Sería una casualidad extraordinaria, absurda, si la mayor extinción de la historia de la Tierra coincide exactamente en el tiempo con una de las mayores erupciones volcánicas conocidas y ambos hechos no tuvieran vínculo alguno. Pero no es suficiente. Hace falta algo más, algo mucho mayor para explicar lo que ocurrió. Avalancha de eventos a nivel de extinción Extinciones durante los últimos 542 millones de años, representadas como el porcentaje de géneros de un determinado periodo que no se encuentra en el registro geológico del siguiente. Puede observarse cómo el Gran Morir (P-Tr) destaca nítidamente sobre todas las demás. Otra de las ideas que vienen inmediatamente a la cabeza, sobre todo desde que sabemos que a los dinosaurios se los cargó un meteorito, es que el Gran Morir fuera causado por otro de estos objetos que caen de los cielos. El problema es que no hay ningún indicio claro al respecto, y de manera muy específica no hay una capa de material de origen extraterrestre (como el iridio presente en el de los dinosaurios) en el estrato de la extinción supermasiva del Pérmico-Triásico. En ausencia de esta clase de evidencia, la hipótesis meteorítica para el Gran Morir no pasa de suposición o conjetura. En estos momentos se postula un fenómeno en avalancha, que seguramente resultó activado por la erupción de las escaleras siberianas, pero que se amplificó enormemente debido a otros fenómenos. El primero de estos fenómenos, como ya hemos comentado, es que la vida terrestre estaba un tanto convaleciente de las miniextinciones precedentes y bajo presión por el constante descenso del oxígeno atmosférico a lo largo de todo el Pérmico. El segundo fue la formación del supercontienente Pangea, en el mismo periodo, que al concentrar las tierras emergidas en un solo lugar redujo la extensión y diversidad de las aguas poco profundas, que son las mejores para la vida. El tercero estaría relacionado con el punto exacto de erupción de las escaleras siberianas: en tierra, cerca de grandes depósitos de carbón y también de clatratos de hidratos de metano fijados al suelo. Así, la lava basáltica producida en la gran erupción de las escaleras siberianas habría incendiado este carbón, emitiendo grandes cantidades de CO2 a la atmósfera. Pero no sólo eso: también habría liberado los hidratos de metano como un fusil de clatratos. Este fenómeno –que, por cierto, podría estar repitiéndose ahora mismo– sí bastaría para explicar el enorme incremento de carbono pobre en isótopo 13 registrado durante el Gran Morir. También puede liberar, de una manera análoga, cantidades significativas del muy tóxico sulfuro de hidrógeno. Tanto el metano como el sulfuro de hidrógeno son potentes gases de efecto invernadero, con lo que la temperatura terrestre habría comenzado a ascender significativamente. Animales como el Listrosaurio sobrevivieron al Gran Morir y sus descendientes evolutivos, también a la extinción de los dinosaurios. De ellos surgieron los mamíferos modernos, como tú y yo, por ejemplo. La liberación del metano presente en los clatratos, además, puede tener otro efecto devastador para la vida cuando se produce en aguas relativamente poco profundas. Al burbujear a través del agua, le roba el oxígeno, produciendo anoxia oceánica que el incremento de la temperatura ocasionado por el calentamiento global empeora aún más (y que también ha sido medida en los estratos del Gran Morir). Así, lo que tendríamos en marcha es una especie de máquina natural de eventos a nivel de extinción que se retroalimenta a sí misma sin parar. Pudieron producirse otros sucesos paralelos más. Estos modelo de causas múltiples y orígenes distintos pero encadenadas en torno a un elemento común, que se suelen llamar modelos del asesinato en el Orient Express, son los que probablemente expliquen mejor un fenómeno tan complejo y tan enorme como el Gran Morir. Ningún agente reconocible en ese momento y lugar pudo causar semejante mortandad por sí solo y tan rápidamente; en cambio, una sucesión de causas-efectos concatenados sí habría sido capaz. De esa forma, un fenómeno insuficiente pero poderoso –como la erupción de las escaleras siberianas– disparándose en el contexto adecuado habría puesto en marcha una máquina de la extinción a escala planetaria que sólo se detuvo cuando alcanzó un nuevo punto de estabilidad, un millón y pico de años después. Aunque ya tenemos datos muy sólidos, el mecanismo exacto que es capaz de matar a tanta vida aún se nos escapa. Sin embargo, el registro fósil no deja lugar a dudas: a lo largo de la historia de la vida, algo –o, más probablemente, varios algos distintos– fue capaz de provocar grandes catástrofes ecológicas que se realimentaron a sí mismas hasta exterminar a órdenes de la vida enteros. Desde mi punto de vista, las enseñanzas son (al menos) dos: Una, que no comprendiendo bien cómo sucedieron pero sabiendo que un suceso relativamente menor y lento puede activar un mecanismo aniquilador mucho más grande y veloz, resulta arriesgadísimo apostar a que algo –algo que hagamos, por ejemplo– será incapaz de poner en marcha un proceso así. Y la otra, que de la muerte siempre surge la vida, una y otra vez, y seguirá haciéndolo mientras este planeta siga orbitando en torno a un Sol mínimamente estable; algo más profundo de lo que a primera vista pueda parecer. FUENTE PASATE POR MIS OTROS POST!!! El debate Dawkins-Collins sobre Ciencia y Fe Así vuela un Avión El Tao de la Fisica Magia Naturalis La Danza de los Maestros Relatividad y Cuantica en la practica La venganza de la tierra La trama de la vida El principio de integridad cientifica de Richard P Feynman Cesar Millan: El encantador de perros Ciencia vs Pseudociencia Carl Sagan, el maestro de millones (ACTUALIZADO) Carl Sagan y la Existencia de Dios ¿Geometria Plana o Curva?