Vaporvixen

Usuario (Argentina)

La gravedad puede estar fugándose de los agujeros negros hacia una nube invisible de dimensiones curvadas. Esta teoría puede parecer extraña, pero algunos físicos piensan que pueden probarla creando agujeros negros diminutos en el LHC. Los agujeros negros parecen la respuesta de la ciencia a un hecho de ciencia ficción: curvando el propio tejido del espacio-tiempo y atrapando la materia y la luz en un agarre gravitatorio mortal, esperan allí, listos para tragarse flotas de naves espaciales y mundos enteros. Los científicos recientemente han dado a los agujeros negros un nuevo papel – como protagonista en una superproducción de un tipo distinto: ayudar a los físicos a evaluar la existencia de otro de los favoritos de la ciencia-ficción, las dimensiones extra ocultas del espacio. Para ello, ahora parece que los titanes astrofísicos de varias veces la masa del Sol, o los agujeros negros enanos menores que una partícula subatómica podrían proporcionar una prueba de la existencia de otras dimensiones. Los astrofísicos están mirando en el espacio con renovado entusiasmo, intentando ver si los grandes agujeros negros están colapsando en escalas de tiempo detectables por los telescopios modernos. En tal caso, podría significar que los agujeros negros están evaporándose hacia dimensiones extra. En el laboratorio, agujeros negros muchísimo más pequeños que nada que pueda ser observado con un microscopio, podrían ser producidos en el gran colisionador hadrónico (LHC) de Europa, ahora que está de nuevo operativo. La detección de dichos agujeros negros, que podrían evaporarse en un montón de partículas subatómicas en una fracción de segundo, podrían evidenciar la existencia de dimensiones extra ocultas. Lo que hace plausible cualquiera de esas ideas es una teoría propuesta hace tan sólo alrededor de diez años, que pretende explicar la debilidad de la gravedad suponiendo que parte de ésta se está escapando hacia dimensiones extra. (En realidad, que la gravedad actúa en más dimensiones de las conocidas). La gravedad puede parecernos fuerte porque hace difícil subir las colinas. Pero una de las paradojas fundamentales sobre la gravedad es que es de hecho muy débil: un imán de frigorífico puede levantar un clip, contrarrestando la fuerza gravitacional de la Tierra tirando de éste hacia abajo. Los físicos de partículas lo llaman “problema de la jerarquía”, refiriéndose al hecho de que el resto de fuerzas de la naturaleza son 30 órdenes de magnitud más fuertes. “Es difícil explicar un factor tan grande desde la matemática o debido a un principio físico”, dice Greg Landsberg de la Universidad de Brown en Providence, Rhode Island, en Estados Unidos. “Es un poco avergonzante para nuestro campo, porque significa que no entendemos la gravedad”. Isaac Newton enunció en el siglo XVII que la gravedad es proporcional al inverso del cuadrado de la distancia entre dos objetos. Si la luna estuviera dos veces más lejos de la tierra de lo que está, sentiría un cuarto de la gravedad que siente. Pero en 1998, los físicos teóricos Nima Arkani-Hamed, Savas Dimopoulos y Gia Dvali señalaron que la gravedad no había sido medida antes a distancias menores de un milímetro. Supón, sugirieron, que la gravedad difiere de lo esperado por la Ley de Newton a distancias muy pequeñas. Esto puede suceder si existen dimensiones espaciales extra accesibles a la fuerza de la gravedad. Estas dimensiones ocultas podrían tener la forma, por ejemplo, de la circunferencia de una manguera. A distancia, la manguera parece una línea, pero vista de cerca, tiene una segunda dimensión curvada. Arkani-Hamed, Dimopoulos y Dvali, cuyo modelo es conocido como ADD, la abreviatura de sus nombres, sugieren que podrían existir dimensiones extra de un milímetro de diámetro. “En principio, las dimensiones extra pueden ser muy pequeñas, billones y billones de veces más pequeñas que un milímetro, y esto es lo que la teoría de cuerdas predice”, dice el astrofísico teórico Dimitrios Psaltis de la universidad de Arizona en Tucson. Pero “si introduces dichas dimensiones extra, entonces la gravedad se debilita en cierto modo”. La gravedad puede extenderse en estas dimensiones extra mientras que las otras fuerzas conocidas y las partículas permanecen en las tres espaciales. Así, la gravedad podría ser tan fuerte como las otras fuerzas, pero sólo se sentiría con fuerza a distancias cortas. Las pequeñísimas dimensiones extra diminutas y curvadas no son la única posibilidad. En 1999, los físicos teóricos Lisa Randall y Raman Sundrum propusieron que una dimensión extra podría estirarse hasta el infinito. Si dicha teoría es cierta, implicaría también que a distancias muy pequeñas, la gravedad sería mucho más fuerte que lo predicho por la ley de la gravitación universal de Newton. La idea de dimensiones extra “grandes” revolvió a los físicos experimentales. Hasta ahora, los físicos han medido con dispositivos de pequeña escala la fuerza de la gravedad a distancias del orden de 50 micrómetros -el espesor de un cabello humano, y no han encontrado ninguna desviación de la ley de Newton. Pero continúan buscando. Los agujeros negros, dado que son los objetos más densos gravitatoriamente del universo, podrían proporcionar otra forma de poner a prueba la hipótesis de la existencia de dimensiones extra. Los agujeros negros saben algo de la gravedad. El truco reside en revelar sus secretos. En la década de 1970, el físico teórico británico Stephen Hawking encontró que los agujeros negros perdían masa. Esta masa desaparece con el tiempo en la forma de lo que ahora se conoce como radiación de Hawking. ‘Con el tiempo’ quiere decir en intervalos de miles de millones de años. Los agujeros negros más masivos tardan más tiempo en desaparecer. Pero si son pequeños, la tasa de evaporación se acelera. Y si hay dimensiones extra del tipo de Randall-Sundrum, los agujeros negros astrofísicos podrían emitir ondas gravitacionales en dichas dimensiones y evaporarse antes de lo previsto en caso de no existir dichas dimensiones. Así que Psaltis pensó que encontrando un agujero negro pequeño realmente viejo limitaría el tamaño de las dimensiones extra. “Si descubres que un agujero negro tiene una edad de 100 millones de años”, dice Psaltis, “significa que no se habría evaporado, que no habría perdido su masa muy muy rápido”. Pero hallar la edad y la masa de un agujero negro no es fácil a grandes distancias. Así que Psaltis probó de otra forma más indirecta. Encontró un agujero negro que parecía haber sido expulsado fuera del plano de la Vía Láctea por una violenta explosión supernova. Dado que el agujero negro habría nacido durante la explosión, Psaltis pudo estimar su edad midiendo la velocidad con la que éste y su estrella compañera se alejan de la galaxia, para encontrar entonces cuándo fue eyectado. Calculó que este agujero negro, J118+480, tenía al menos 11 millones de años. Usando dicha edad y una estimación de su masa, Psaltis encontró un límite superior de 80 micrómetros al tamaño de cualquier dimensión extra, publicado en Physical Review Letters en 2007. Tim Johanssen, estudiante de doctorado de Psaltis, tuvo la idea de medir si los agujeros negros pierden masa, que no depende de su edad. La mayoría de los agujeros negros unas pocas veces más masivos que el sol han sido detectados porque orbitan en torno a una estrella compañera. Las masas de la estrella y del agujero negro, así como la distancia entre ellos, determina cómo de rápido las dos rotan alrededor de sí mismos, como un par de patinadores olímpicos rotando alrededor cada uno alrededor del otro en una espiral mortal. Si la masa del agujero negro cambia, la tasa a la que orbitan él y su compañera, llamada período orbital, cambiará también. Johanssen calculó a qué velocidad debería perder masa el agujero negro para que el efecto en el período orbital fuera apreciable. “Los mecanismos astrofísicos normales doblan o reducen a la mitad el período en escalas temporales del orden de la edad del universo, esto es, miles de millones de años”, dice Psaltis. “Si existen dimensiones extra, y tienen un tamaño de décimas de milímetro, entonces esa escala de tiempo se reduce a algunos millones de años, lo que significa que si haces una observación durante un año, esperas un cambio en el período orbital de unas pocas millónesimas. Esto es pequeño, pero puede observarse en sistemas binarios”. Johanssen, Psaltis y el astrónomo Jeffre McClintock del Harvard-Smithsonian Centre for Astrophysics en Boston observaron detalladamente el sistema binario más estudiado, A0620-00, que ha sido observado durante una década. Hasta ahora, se ha encontrado un cambio en su período orbital. Lo que reduce la cota superior de la dimensión extra a menos de 161 micrómetros. Sus resultados aparecieron en febrero de 2009 en Astrophysical Journal. Otro investigador, Oleg Gnedin, de la universidad de Michigan, en Ann Arbor, extrapoló el trabajo de Psaltis. Gnedin se enteró de un descubrimiento reciente de un agujero negro en un cúmulo globular, que son de las agrupaciones estelares más viejas del universo. Los agujeros negros en los cúmulos globulares tienen del orden de 10 000 millones de años. Su mera existencia limita el tamaño de la dimensión de tipo Randall-Sundrum a menos de tres micrómetros, dice Psaltis. Dicho trabajo fue publicado en Junio de 2009 en arxiv.org*, una colección en línea de artículos científicos mantenida por la Universidad de Cornell. Aunque el trabajo de los cúmulos globulares pone el límite más estricto en el tamaño de la dimensión extra, los investigadores admiten que el resultado está basado en muchas suposiciones. Psaltis pone sus esperanzas en observaciones de sistemas binarios porque, según él, “miden lo que le está pasando al agujero negro que estamos osbservando. No depende de su historia”. Dice que incluso aunque los investigadores no han observado ningún cambio en el período orbital hasta ahora, no significa que las dimensiones extra no existan, tan sólo que no las hemos encontrado todavía. Cualquier cambio en el período orbital, dice, pondría a prueba el modelo estándar actual. Pero incluso si las teorías con dimensiones extra son correctas, los observadores pueden que nunca encuentren dichas dimensiones en los agujeros negros astrofísicos. Una razón puede ser que las dimensiones extra sean de tipo ADD, pequeñas y curvadas, en cuyo caso no causan ninguna diferencia en los agujeros negros masivos en el espacio. La otra puede ser que los agujeros negros no se evaporen más rápido en otras dimensiones incluso si éstas existen, dice Randall, la físico teórica de Harvard que participó en la elaboración de dos populares modelos de dimensiones extra. “La gente ha sugerido que la tasa de desintegración de los agujeros negros podría ser una forma de diferenciar los modelos”, dice, pero ” ésto no está completamente resuelto”. La detección de un pequeñísimo agujero negro en el LHC situado en Suiza, cerca de Ginebra, constituiría una prueba de la existencia de dimensiones extra, porque si la gravedad es mucho más fuerte que lo esperado a distancias de unos pocos micrómetros, el LHC puede ser capaz de retener materia y energía suficientes en una región del espacio lo suficientemente pequeña que el sistema no soporta su propia gravedad, colapsando sobre sí mismo, y por tanto se convierte en un agujero negro. Pero antes de que nadie empiece a preocuparse de la desaparición de Ginebra en una singularidad que se trague el planeta, conviene recordar que se desintegraría antes siquiera de que su radio llegase al de un núcleo atómico. “En este sentido, estos agujeros negros son completamente ‘orgánicos’, dice Landsberg. “Podrías ponerlos en una ensalada, y no te enterarías de que existen porque inmediatamente desparecen”. Pero podrían mostrar su presencia en el LHC. A esto se dedica un número de físicos teóricos, incluído Glenn Starkman de la Universidad de Western Case en Cleveland. Starkman dirige un equipo que desarrolló un programa informático llamado BlackMax, que muestra los productos que podrían surgir de la desintegración de un agujero negro. Dentro del LHC, los protones colisionan a velocidades cercanas a la velocidad de la luz. Los protones tienen cierta extensión espacial, dice Starkman, y están hechos principalmente de partículas subatómicas llamadas quarks y gluones. Es extremadamente improbable que cualquiera de estas partículas colisione con otra frontalmente. Pero si dos quarks o dos gluones, o un quark y un gluón se acercan lo suficiente en sentidos opuestos, podría haber suficiente energía en una región del espacio lo suficientemente pequeña como para formarse un agujero negro – si, y sólo si, la gravedad es suficientemente fuerte como para ser la fuerza dominante. “Para que esto suceda”, dice Starkman, “tiene que haber más de tres dimensiones”. El agujero negro se evaporaría casi instantáneamente, quizás en un montón de partículas subatómicas lanzadas en todas las direcciones, como explotaría un petardo. O quizás los investigadores verían un evento en el que parte de la energía desaparece hacia otras dimensiones por el efecto de los gravitones – el invisible homólogo gravitacional del fotón. Lo bueno, desde el punto de vista de los físicos teóricos, es que si el LHC produce agujeros negros, hará muchos, del orden de uno por segundo, o 30 millones en un año. “Y 30 millones por año puede ser una postura muy optimista, pero quizás un millón…o incluso 10 000 no es imposible”, dice Savas Dimopoulos, de la Universidad de Stanford, la D intermedia de la hipótesis de dimensiones extra ADD. “Incluso si tienes 10 000 agujeros negros, ése ya es un buen número con el que hacer estadística, y comenzar a probar en detalle tanto la existencia del agujero negro como de dimensiones extra, en los distintos escenarios”. Randall, como muchos otros, es escéptica. “Es una idea bonita”, dice. Pero junto con Patrick Meade, entonces en Harvard y ahora en el Instituto de Estudios Avanzados en Princeton, Nueva Jersey, sostiene que el escenario es altamente improbable. Su trabajo fue publicado en mayo de 2008 en la publicación “Journal of High Energy Physics“. “Es virtualmente imposible que vayas a producir agujeros negros en el LHC porque la energía no es lo suficientemente alta”, dice Randall. “Podrías ver alguna evidencia de fenómenos gravitacionale en dimensiones extra en términos de la dispersión de unas partículas con respecto a otras…pero parece muy improbable que puedas tener realmente un agujero negro”. Todavía hay muchas incertidumbres, y hasta que el LHC no funciona a la máxima energía, nadie lo sabrá realmente. Dimopoulos, por comentar a uno, permanece optimista. Pero tiene sus preferencias. Además de dimensiones extra grandes, apuesta por otras dos teorías para solucionar el problema de la jerarquía, tecnicolor y supersimetría. Estas dos no se basan en dimensiones extra – y podrían aparecer en el LHC. Sin embargo, “la naturaleza puede elegir una ruta completamente diferente, diferentes a las soluciones al problema de la jerarquía pensadas hasta ahora”, admite. “Y éste puede ser el escenario más excitante, aún por descubrir”. *: En arxiv.org se pueden encontrar artículos científicos antes de que aparezcan publicados en las revistas científicas, una vez que han pasado el proceso de revisión por pares. Por otro lado, también se pueden encontrar artículos que no serán enviados a publicaciones científicas.

Físicos de Hong Kong dicen haber demostrado que un fotón aislado obedece la teoría de Einstein de que nada puede viajar más rápido que la velocidad de la luz – demostrando que, fuera de la ciencia ficción, el viaje en el tiempo es imposible. El equipo de investigación de la Universidad de Ciencia y Tecnología de Hong Kong, liderado por Du Shengwang dijo que habían demostrado que un fotón aislado, o la unidad de luz, “obedece las leyes de tráfico del universo”. “Einstein afirmaba que la velocidad de la luz era la ley de tráfico del universo, o en un lenguaje más simple, nada puede viajar más rápido que la luz”, dice la universidad. “El estudio de Du demuestra que un único fotón, el cuanto fundamental de luz, también obedece la ley de tráfico del universo igual que las ondas clásicas EM (electromagnéticas)”. Einstein tenía razón La posibilidad de viajar en el tiempo se propuso hace 10 años, cuando los científicos descubrieron una propagación superlumínica – o más rápida que la luz – de pulsos ópticos en algunos medios específicos, dice el equipo. Más tarde se vio que era un efecto óptico, pero los investigadores pensaron que podría aún ser posible que un fotón aislado superase la velocidad de la luz. Du, sin embargo, creía que Einstein estaba en lo cierto y determinó el final del debate midiendo la velocidad final de un fotón aislado, lo que no se había realizado con anterioridad. “El estudió, que demostró que un fotón aislado también obedece al límite de velocidad c, confirma la causalidad de Einstein; es decir, un efecto no puede suceder antes que su causa”, dice la universidad. “Demostrando que los fotones aislados no pueden viajar más rápido que la velocidad de la luz, nuestro resultado cierra el debate sobre la verdadera velocidad de la información transportada por un único fotón”, dice Du, profesor asistente de física. “Nuestros hallazgos también tendrán potenciales aplicaciones dando a los científicos una mejor descripción de la transmisión de información cuántica”. El estudio del equipo se publica en la revista estadounidense revisada por pares Physical Review Letters.

La teoría de la relatividad extendida más allá de la velocidad de la luz de Hill y Cox En matemáticas se llama prolongación de una función a la extensión de su dominio más allá de sus singularidades, que se comportan como frontera entre el dominio original y el extendido. Normalmente, la prolongación requiere incluir algunos cambios de signo en la definición de la función extendida para evitar que aparezcan valores imaginarios puros u otros números complejos. La matemática de la teoría de la relatividad puede ser aplicada a partículas que se mueven a una velocidad mayor que la de la luz (llamadas taquiones) si aceptamos que la masa y la energía de estas partículas pueden adoptar valores imaginarios puros. Fórmula relativista de adición de velocidades. El problema es que no sabemos qué sentido físico tienen estos valores imaginarios. Un nuevo artículo ha copado algunos medios por presentar una extensión de la teoría de la relatividad a sistemas de referencia superlumínicos basada en una prolongación de sus ecuaciones. El artículo de Hill y Cox no ofrece ninguna justificación física y obviamente no existe ningún experimento que puede refutar sus ideas (por tanto, no se trata de una teoría en el sentido de Popper). Sin embargo, creo que merece la pena dedicarle una entrada en este blog para aclarar estas ideas, pues hay cierta confusión al respecto en los medios que se han hecho eco de la noticia. El artículo técnico es James M. Hill, Barry J. Cox, “Einstein’s special relativity beyond the speed of light,” Proc. R. Soc. A, published online 3 October 2012. Hay tres cosas a tener en cuenta a la hora de realizar una prologación de la teoría de la relatividad especial de Einstein a velocidades superluminínicas. Lo primero, hay que prolongar varias funciones que presentan diversas singularidades, por ello, no existe una única solución; Hill y Cox presentan dos posibles prolongaciones y comentan los argumentos por los que prefieren una de ellas (sus argumentos son matemáticos, no físicos). Lo segundo, la prolongación de una función requiere extenderla hasta el infinito y hay que imponer una condición de cierre (una condición de contorno en el infinito) que normalmente introduce algún parámetro libre, cuya valor es arbitrario; en la primera versión de la teoría de Hill y Cox se selecciona el momento de la partícula para velocidad infinita, cuya única ventaja es que la masa de la partícula es un número real a todas las velocidades, y en la segunda se selecciona un valor finito para la masa de la partícula a velocidad infinita. Y lo tercero, la prolongación de una función requiere algún tipo de guía, siendo lo habitual preservar algún invariante; en el caso de Hill y Cox se ha utilizado la fórmula de adición de velocidades de Einstein que no es singular cuando se aplica más allá de la velocidad de la luz. Fórmula relativista de adición de velocidades indicando las regiones donde el resultado es superlumínico (naranja y amarillo). La prolongación de la teoría de la relatividad para velocidades 0 ≤ v ≤ c, a velocidades c < v < ∞, requiere una condición matemática para v = ∞. Hill y Cox utilizan como guía la fórmula de adición de velocidades de Einstein, U = (u+v)/(1+uv/c²), que para v = ∞ implica que uU=c². La razón que esgrimen es que esta fórmula no es singular para v=c, como otras fórmulas de la teoría de la relatividad; ello no quita que presente una singularidad para uv=-c² (las dos hipérbolas que se observan en la figura que abre esta entrada). El resultado de esta fórmula es superlumínico |U|>c, en ciertas regiones del plano (u,v), indicadas en naranja y amarillo en la figura de arriba, siendo sublíminico |U|<c, en el resto del plano, regiones indicadas en azul y verde. La idea de Hill y Cox es que la prolongación del resto de las fórmulas de la relatividad de Einstein se ha de realizar de tal forma que se preserve como invariante la relación uU=c² para v = ∞. Esta idea matemática no tiene una interpretación física clara, siendo el argumento más firme en contra de la nueva teoría. La fórmula más emblemática de la teoría de la relatividad de Einstein es E=mc², para p=v=0 (donde m es la masa y p es el momento lineal). ¿Qué fórmula proponen Hill y Cox para v = ∞? La prolongación analítica se puede realizar de muchas formas pero Hill y Cox nos ofrecen dos posibilidades diferentes. La primera, que es la que más les gusta a ellos, se basa en la siguiente idea. Si la masa m es una propiedad intrínseca de la partícula que caracteriza su energía en reposo, entonces debe haber un valor fijo del momento p∞ que caracteriza su energía a velocidad infinita. Por tanto, E=p∞c para v = ∞. Esta fórmula ad hoc implica que en la fórmula E(v)=m(v)c², la “masa” m(v) es un número real para todas las velocidades dado por m(v)=m(0)/(1-(v/c)²)1/2, para 0 ≤ v ≤ c, y m(v)=(p∞/c)/((v/c)²-1)1/2, para c < v < ∞. Por el contrario, la segunda posibilidad se basa en asumir que además de la masa en reposo m, la partícula se caracteriza por un valor de la masa m∞ para velocidad infinita, con lo que la segunda fórmula cambia a m(v)=(m∞v/c)/((v/c)²-1)1/2, para c < v < ∞. En resumen, se trata de un artículo matemático curioso que extiende la teoría de la relatividad de Einstein a sistemas inerciales que se mueven a velocidad arbitraria, menor, igual o mayor que la velocidad de la luz. No hay una justificación física de las fórmulas que se presentan, pues no hay ningún experimento físico que sirva de guía (Hill y Cox confiesan que el origen de este artículo fue la noticia de los neutrinos superlumínicos en OPERA). Considerar la fórmula de adición de velocidades de Einstein como válida a todas las velocidades no parece un mal principio, pero los autores no discuten qué significado físico pueden tener las singularidades que aparecen en dicha fórmula para uv=-c². Por cierto, quizás te lo estés preguntando, ¿viola la causalidad la nueva teoría? Los autores no lo discuten en su artículo y nos indican en sus conclusiones que será tema de futuras investigaciones. Pero como es obvio no hay que pensar mucho para darse cuenta de que la causalidad es violada en las regiones naranja y amarilla de la figura de arriba. ¿Permite la nueva teoría los viajes en el tiempo hacia el pasado? Obviamente, los permite (basta recordar el antiteléfono de Tolman, 1917, para ver que no está prohíbido). ¿Quiere esto decir que se puede descartar la teoría desde un punto de vista físico? Pues así es, al menos en mi opinión. Pero, recuerda, el artículo de Hill y Cox no discute estos escabrosos asuntos de su teoría (los relega a líneas futuras de investigación). ¿Por qué no? Quizás para que no fuera rechazado por un revisor sin más. Evitando acercarte al veneno que puede matarte quizás logres sobrevivir a sus efluvios.

Se demuestra la falsedad de una interpretación común del principio de incertidumbre de Heisenberg. Contrariamente a lo que se enseña a muchos estudiantes, la incertidumbre cuántica puede no estar siempre en el ojo del que mira. Un nuevo experimento demuestra que medir un sistema cuántico no siempre introduce necesariamente incertidumbre. El estudio derroca una explicación común en las aulas sobre por qué el mundo cuántico parece tan difuso, pero el límite fundamental a lo conocible en las menores escalas sigue sin cambios. En las bases de la mecánica cuántica se encuentra el principio de incertidumbre de Heisenberg. Expresado simplemente, dicho principio afirma que existe un límite fundamental a lo que se puede conocer acerca de un sistema cuántico. Por ejemplo, cuanta mayor precisión se tenga sobre la posición de una partícula, menos se sabrá sobre su momento, y viceversa. El límite se expresa como una ecuación simple que es fácil de demostrar matemáticamente. Heisenberg a veces explicó el principio de incertidumbre como un problema al realizar medidas. Su experimento mental más famoso implicaba la fotografía de un electrón. Para tomar la imagen, un científico tendría que hacer rebotar una partícula de luz sobre la superficie del electrón. Esto revelaría su posición, pero también impartiría energía al mismo, provocando su movimiento. Conocer la posición del electrón crearía una incertidumbre sobre su velocidad; y el acto de la medida produciría la incertidumbre necesaria para satisfacer el principio. Los estudiantes de física aún aprenden esta versión de medida-perturbación del principio de incertidumbre en las clases introductorias, pero resulta que no siempre es cierto. Aephraim Steinberg de la Universidad de Toronto en Canadá y su equipo han realizado medidas sobre fotones (partículas de luz) y demostraron que la medida puede introducir menos incertidumbre de la requerida por el principio de Heisenberg1. La incertidumbre total de lo que podemos saber sobre las propiedades del fotón, sin embargo, sigue por encima del límite de Heisenberg. Medidas delicadas El grupo de Steinberg no mide la posición y momento, sino dos propiedades interrelacionadas distintas del fotón: sus estados polarizados. En este caso, la polarización a lo largo de un plano está intrínsecamente ligada a la polarización del otro, y por el principio de Heisenberg, existe un límite a la certidumbre con la que podemos conocer ambos estados. Los investigadores realizaron una medida ‘débil’ sobre la polarización del fotón en un plano – no lo suficiente como para perturbarlo, pero suficiente para producir un cambio apreciable en su orientación. Luego midieron la polarización en el segundo plano. Realizaron una medida exacta, o ‘fuerte’, de la primera polarización para ver si se había visto perturbada por la segunda medida. Cuando los investigadores realizaron múltiples veces el experimento, encontraron que las medidas de la polarización no siempre perturbaban el otro estado tanto como predecía el principio de incertidumbre. En el caso de la medida fuerte, la incertidumbre inducida fue menos de la mitad de la predicha por el principio de incertidumbre. No te entusiasmes demasiado: el principio de incertidumbre aún se mantiene, dice Steinberg: “Finalmente, no hay forma de que puedas medir con precisión [ambos estados cuánticos] a la vez”. Pero el experimento demuestra que el acto de la medida no es siempre lo que provoca la incertidumbre. “Si ya hay una gran cantidad de incertidumbre en el sistema, entonces no hay necesidad de ruido para la medida”, dice. El último experimento es el segundo en hacer una medida por debajo del límite del ruido de incertidumbre. A principios de año, Yuji Hasegawa, físico de la Universidad Tecnológica de Viena en Austria, midió grupos de espines de neutrones y derivó los resultados muy por debajo de lo que se predeciría si las medidas insertaran toda la incertidumbre al sistema2. Pero los últimos resultados son el ejemplo más claro de por qué la explicación de Heisenberg era incorrecta. “Esta es la prueba experimental más directa de la incertidumbre medida-perturbación enel principio de incertidumbre de Heisenberg”, dice Howard Wiseman, físico teórico en la Universidad de Griffith en Brisbane, Australia. “Esperemos que sea útil para los escritores de libros de texto ya que ahora saben que el ingenuo argumento de la relación medida-perturbación es incorrecto”. Sacudirnos de encima la vieja explicación de medida-incertidumbre puede ser difícil, no obstante. Incluso tras realizar el experimento, Steinberg aún incluye una cuestión sobre cómo las medidas crean incertidumbre en un reciente trabajo encargado a sus estudiantes. “Solo cuando estaba empecé a evaluarlo me di cuenta de que el trabajo que había encargado era incorrecto”, dice. “Ahora tengo que ser más cuidadoso”.

Quizás hayan escuchado o leído últimamente acerca de Betelgeuse, una estrella supergigante roja que brilla en nuestro firmamento en la constelación de Orión y que parece haberse sumado al equipo de catástrofes que destruirá nuestro planeta a finales del próximo año. Como si fuera poco con la desestabilización del eje de la Tierra, la colisión con el planeta X y las terribles erupciones solares (todas patrañas desmentidas en este artículo) parece que también Betelgeuse y sus mortales rayos gamma quieren atacarnos. Bueno, en realidad no tenemos que preocuparnos (más que de la mala prensa) pues ésta noticia es solo el producto de un “malentendido” periodístico. El infeccioso virus a partir del cual comenzó a contagiarse esta falsa noticia es un periódico llamado The Huffington Post, al que el astrónomo Phil Plait llama “el bastión de la anti-ciencia”. La noticia original no era tan grave en realidad: una entrevista realizada al científico Brad Carter donde se hablaba de la estrella Betelgeuse y sus posibilidad de volverse supernova y estallar. Esa es una realidad: Betelgeuse se encuentra en la etapa final de su vida y próximamente va a explotar en una magnífica explosión; el problema radica en lo que consideramos como “próximamente”. Cuando se habla de tiempo en astronomía, decir “próximamente” o “dentro de poco” puede representar cientos de miles de años. Tengamos en cuenta que la vida de una estrella común se calcula en miles de millones de años; en esas escalas, cientos de miles de años es realmente un corto periodo de tiempo. Betelgeuse podría volverse supernova y estallar el día de mañana, o podría hacerlo dentro de 100.000 años; realmente no lo sabemos. Lo que sí sabemos es que con tan amplio margen de tiempo, es realmente muy poco probable que vaya a suceder el año que viene. Izquierda: Tamaño de la estrella comparado con el tamaño de la órbita de la Tierra y de la órbita de Júpiter. Derecha: la constelación de Orión, donde se encuentra Betelgeuse. Es aquí donde se presentó el problema principal: el artículo de The Huffington Post sacó de contexto intencionalmente a las palabras de Carter, para crear una ficticia conexión entre la explosión de Betelgeuse y todas las apócrifas profecías apocalípticas del año 2012. Y como sabemos, los conspiranoicos aman unir sus pseudociencias con toda patraña exagerada que encuentren por ahí, de modo que en pocos minutos Internet desbordaba de noticias apocalípticas increíblemente estúpidas citando a la prueba definitiva de nuestra destrucción en el 2012: la explosión de Betelgeuse. Pero seamos buenos y usemos (demasiado) la imaginación por unos segundos. Supongamos hipotéticamente que lo improbable sucede, que Betelgeuse explota a fines del año 2012. ¿Significaría dicha explosión nuestro fin y el de nuestro planeta? Definitivamente no. Pero entonces, ¿cuánto daño ocasionaría la explosión de la estrella a nuestro planeta? La respuesta es: ninguno. Betelgeuse se encuentra a aproximadamente 650 años luz de distancia de nuestro planeta, y esto es demasiado, realmente demasiado lejos como para poder ocasionarnos algún problema; una supernova debería encontrarse a menos de 25 años luz para ocasionar algun daño significativo a la Tierra. De modo que, aunque a fines del año próximo presenciemos el agonizante final de esta gigantesca estrella (cosa que no va a ocurrir) absolutamente nada le sucederá a nuestro planeta. Otra cosa que se ha dicho en relación con esta noticia es que cuando Betelgeuse se vuelva supernova la explosión será tal que veremos en el cielo literalmente dos soles, como sucedía en aquellos bonitos ocasos en el planeta Tatooine de las películas Star Wars. Aunque sería una fantasía cumplida para todos los amantes de la ciencia ficción y nos brindaría un gran espectáculo para apreciar, lamentablemente esto tampoco va a suceder. Este paisaje con dos soles, aquí recreado por un artista, NO va a suceder con la explosión de Betelgeuse. Dado que se encuentra a una distancia de 650 años luz, la explosión será realmente muy brillante, pero de ninguna forma tanto como para componer un segundo Sol en nuestro cielo. Ni siquiera llegará a alcanzar el brillo de la luna llena, aunque probablemente si sea más brillante que el planeta Venus. Será un espectáculo increíble, sobre todo para los astrónomos amateurs que pasaran noches enteras sin separarse de sus telescopios; pero definitivamente no habrá dos soles en el cielo como muchos medios están divulgando por aquí y por allí. Solamente para dejar las cosas claras y simples: la estrella Betelgeuse se convertirá en supernova y estallará en algún momento del período que abarca desde el día de hoy hasta dentro de 100.000 años. Su explosión no tiene ninguna relación con el año 2012, las imaginarias catástrofes, la civilización maya, ni ninguna otra tontería por el estilo. Su explosión no representará daño alguno para nuestro planeta y será brillante, tanto como para verla durante el día por semanas, pero de ninguna forma tendrá el mismo brillo que el Sol. Por último, me gustaría comentar los aspectos científicos positivos de esta colosal explosión (si, hablar un poco de ciencia real hace bien después de desmentir tantas patrañas). Durante muchos años los astrónomos han estudiado las supernovas, tratando de comprender estos magníficos fenómenos estelares, pero todas las observadas hasta el momento se han producido extremadamente lejos. En cambio, Betelgeuse se encuentra realmente muy cerca (en distancias astronómicas) como para poder apreciar la explosión con gran detalle. Sin duda alguna esto nos permitirá aprender muchísimo acerca del fenómeno de las supernovas.

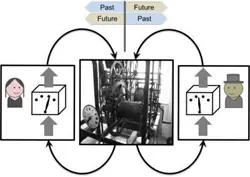

Proponen que es posible encontrar sistemas cuánticos en los que el orden de los eventos puede ser a su vez indefinido. Uno de los conceptos más básicos de la ciencia y de la vida cotidiana es el de causalidad. Es decir, la idea según la cual una causa en el presente produce un efecto en el futuro. Si el evento A produce el efecto B, entonces B no puede ser la causa de A. Ahora unos físicos teóricos de las universidades de Viena y Libre de Bruselas han mostrado sobre el papel que según la Mecánica Cuántica (MC) es posible concebir una situación en la que un evento puede ser a la vez causa y efecto de otro. Aunque todavía no se sabe si esta posibilidad se puede dar en la Naturaleza, el trabajo puede ser importante por las posibles implicaciones sobre los fundamentos de la MC, gravedad cuántica y computación cuántica. En la vida cotidiana y en la Física Clásica los eventos están ordenados en el tiempo y una causa sólo puede provocar un efecto sobre el futuro, no sobre el pasado. Imaginemos que una persona llamada Alicia entra en una habitación y encuentra un papel. Después de leer lo que pone en él Alicia borra el mensaje y escribe su propio texto sobre ese papel. Otra persona, llamémosle Bartolo (nombre siempre mejor que “Borja”) entra después en la misma habitación en otro momento y hace lo mismo. Si Bartolo entra después que Alicia podrá leer lo que ha escrito ésta, sin embargo, Alicia no tendrá ninguna oportunidad de leer lo que escriba Bartolo. En este caso, lo escrito por Alicia es la “causa” y lo que lee Bartolo es el “efecto”. Cada vez que los dos repiten el procedimiento sólo uno será capaz de leer lo que ha escrito el otro. Incuso si no tiene relojes y no saben quién entró en la habitación primero pueden deducirlo por lo que escriben y leen sobre el papel. Así por ejemplo, Alicia puede escribir “Alicia estuvo aquí hoy” y cuando Bartolo leyera el mensaje sabría que entró a la habitación después. Según las leyes de la Física Clásica el orden de los eventos está fijado: o bien Bartolo o bien Alicia entra en la habitación y deja un mensaje para el otro. Pero si la MC entra en juego entonces el panorama cambia drásticamente. Según la Mecánica Cuántica los objetos pueden perder sus bien definidas propiedades clásicas y por ejemplo que se dé la superposición de estados. Un equipo internacional liderado por Caslav Brukner ha mostrado que incluso el orden causal de eventos puede estar en una superposición. Si Alicia y Bartolo usan un sistema cuántico en lugar de un papel para enviarse mensajes pueden terminar en una situación en la que cada uno de ellos pueda leer una parte del mensaje escrito por el otro. Esto sería una superposición de dos situaciones: “Alicia entra en la habitación primero y deja el mensaje para Bartolo” y “Bartolo entra en la habitación primero y deja el mensaje para Alicia”. Esta superposición, sin embargo, no había sido considerada en la formulación estándar de la MC porque la teoría asumía siempre que el orden causal de los eventos estaba bien definido. “Pero si creemos que la MC gobierna todos los fenómenos es natural esperar que el orden de los eventos puede ser a su vez indefinido, de manera similar a la velocidad y localización de una partícula”, dice Fabio Costa, de la Universidad de Viena. En trabajo da un paso importante hacia la comprensión de que el orden causal puede que no sea obligatorio en la Naturaleza. “El desafío real es averiguar en dónde debemos mirar para encontrar una superposición de órdenes causales”, dice Caslav Brukner.

Han conseguido mantener durante mucho más tiempo la coherencia cuántica de qubits superconductores. La metáfora-chiste del icónico gato que inventó Schrödinger da mucho juego. Fue propuesta para criticar el absurdo al que podemos llegar cuando asumimos que un estado cuántico superpuesto puede darse en el mundo macroscópico. No obstante, puede usarse para explicar ciertos conceptos de Mecánica Cuántica (MC). Obviamente la decoherencia cuántica hace imposible tener objetos como los gatos en una superposición de estados. No hace falta abrir una caja con un gato real porque el estado ya colapsó hace mucho tiempo y no hay superposición de estados. Pero incluso con partículas también es así. Según la MC pueden existir estados que sean la superposición de varios. Así por ejemplo, podemos tener un electrón con dos estados de spin a la vez. Una vez medido, la función de ondas del electrón colapsaría a uno en concreto. Siguiendo con la analogía, el gato está vivo y muerto a la vez hasta que abrimos la caja y lo comprobamos. El acto de abrir la caja sería el acto de la medición. Esquema del sistema empleado. Ahora nos podemos plantear si es posible la realización de medidas débiles que permitan “abrir la caja” sin que colapsemos la función de ondas y “veamos” el gato vivo y muerto a la vez. Naturalmente esto se intenta hacer con partículas y otros sistemas cuánticos pequeños, no con gatos reales. La idea es mantener la coherencia cuántica durante el tiempo suficiente en los futuros computadores cuánticos. Un qubit no es más que una superposición de estados, cuantos más estados superpuestos mejor. El más sencillo es la superpoción dos estados de bit: (00), (01), (10) y (11). Un sistema computacional formado por qubits podría hacer operaciones con ellos de tal modo que el alto grado de paralelismo computacional (operamos todos los estados superpuestos a la vez) permitiría abordar problemas muy costosos computacionalmente, como la factorización de números muy grandes. Lo malo es que en la física del mundo real la decoherencia cuántica destruye los qubits al poco de formarse y no da tiempo a hacer casi ninguna operación. Parece imposible mantener la superposición durante un tiempo indefinido. Ahora, R. Vijay (Universidad de Berkeley) y sus colaboradores han conseguido mantener durante mucho más tiempo que hasta ahora la coherencia cuántica. Los qubits con los que han trabajado están implementados con un sistema Josephson superconductor acoplado a una cavidad de microondas, o lo que se llama un transmón. Hace unos 10 años se propuso sobre el papel un sistema capaz de mantener la coherencia. La idea se basaba en un bucle retroalimentado que usaba medidas débiles. Lo que ha conseguido este grupo de investigadores es precisamente la implementación física de esta idea. Sin ningún tipo de control un sistema de estos colapsa al cabo de unos pocos microsegundos y desaparece la superposición si ésta existe. Pero con el sistema de retroalimentación han conseguido mantener la coherencia cuántica durante 20 milisegundos gracias a 10000 medidas débiles (actuación del sistema de control). Las medidas introducen cambios aleatorios en el ritmo de oscilación del sistema que no pueden ser predichos y que finalmente destruyen la coherencia, pero estos investigadores fueron capaces de medir muy rápido e introducir un cambio equivalente pero opuesto que compensaba la alteración introducida de tal modo que es como si no se midiera. Haciendo estos muchas veces (10000 veces) han conseguido esta mejora del tiempo en el que se mantiene la coherencia. Es una sistema activo de control que trabaja de forma similar a como lo haría un marcapasos. Vijay y sus colaboradores han logrado todo esto gracias a que han conseguido fabricar un nuevo tipo de amplificador. Aunque por motivos técnicos estos investigadores sólo han conseguido esos 20 milisegundos, creen que se podría ampliar el tiempo durante el cual se mantiene la coherencia de forma arbitraria. Puede que mantener el gato superpuesto vivo y muerto durante 20 milisegundos a base de abrir diez mil veces la caja un poquito parezca poco, pero son varios órdenes de magnitud que cuando no se ejerce ningún sistema de control. La ciencia avanza así, poco a poco. O puede que sea como la fusión nuclear controlada, que cada veinte años nos prometen que en veinte años ya la tendremos. Quizás tengan razón los que sostienen que desde los años sesenta del pasado siglo no se ha avanzado significativamente en ciencia y tecnología.

Para conseguir el bit magnético más pequeño sólo se necesitan 12 átomos de hierro a muy baja temperatura. Reconstrucción infográfica de los 12 átomos. Sebastian Loth/CFEL. ¿Cuántos átomos son necesarios para almacenar un bit de información? No lo sabemos seguro, pero el record alcanzado por investigadores de centro Almadén de IBM, la Universidad de Hamburgo y un centro de investigación alemán dice que bastan 12 átomos, unos 96 para un byte. Un moderno disco duro usa, en comparación, unos 500 millones de átomos por byte. Estos investigadores construyeron un patrón regular de átomos de hierro alineados en dos filas de seis átomos sobre una superficie de nitruro de cobre. Un byte construido por 8 de estos bits ocuparía un área de 4×16 nm. Esto corresponde a una densidad de información cientos de veces superior a la de los modernos discos duros. El almacenamiento de información en este caso es magnético y la lectura y escritura de datos se efectuó con la punta de un microscopio de efecto túnel. Un impulso eléctrico sobre la sonda cambiaba la configuración de un 0 a un 1 cambiando en estado de imanación y un impulso más débil permitía su lectura. Para poder conseguir esto el grupo de átomos de hierro se mantuvo a 5 grados Kelvin. Como todo el mundo sabe la temperatura, que introduce desorden en todo sistema, es una gran enemiga del orden magnético. También hay que tener en cuenta los efectos cuánticos, pues si la escala es muy pequeña un bit puede cambiar de estado por efecto túnel, incluso al cero absoluto de temperatura. Sin embargo, los investigadores esperan que grupos de 200 átomos mantengan un orden magnético estable a temperatura ambiente, aunque se necesitarán años de desarrollo hasta llegar a productos comerciales. Por primera vez han conseguido usar antiferromagnetismo en lugar del ferromagnetismo empleado en los discos duros convencionales. En la interacción antiferromagnética los momentos magnéticos tienden a apuntar en direcciones antiparalelas y en la ferromagnética en direcciones paralelas. El uso del antiferromagnetismo permite un empaquetamiento más compacto y permite separar bits a sólo un nanometro unos de otros. En lugar de tratar de miniaturizar lo que ya existe, estos investigadores pensaron en dirección opuesta y partieron de lo más pequeño (un átomo) y comprobaron el mínimo conjunto de átomos en la configuración adecuada que permitía alcanzar el objetivo. Resultó ser un grupo de 12 átomos de hierro. El experimento también ha permitido sentar las bases de un posible estudio de la transición del mundo clásico al cuántico. Así, se podría usar para analizar los efectos físicos cuánticos a través del cambio del patrón formado por los átomos de hierro en el conjunto. ¿Cómo se comporta un imán en la frontera entre los dos mundos? ¿Qué hace diferente a un imán cuántico de uno clásico?

No se sabe bien si fué asteroide o meteoro, pero el sitio spaceweather dice: Un pequeño asteroide que explotó sobre el área de San Francisco Bay el 17 de octubre, sacudiendo las casas con su estampido sónico, podría haber dispersado pedazos de sí mismo en el suelo. Esa es la conclusión de Peter Jenniskens del NASA Ames Research Center. Él triangulado los datos de un par de cámaras de vigilancia de meteoros para determinar la trayectoria de la bola de fuego, denotado por la flecha negro en el siguiente mapa: Trayectoria preliminar calculado por Peter Jenniskens de Sunnyvale y San Mateo Colegio CAMS Observatorio datos. El sitio http://cams.seti.org/ dice: '' la traducción es de google, no es muy buena 2012, 18 de octubre - Sólo una de las tres estaciones de CAMS regulares cogido la bola de fuego, la NASA / estación CAMS Sunnyvale (Jim Albers). Para los otros dos sitios, la bola de fuego estaba justo fuera del campo de visión. Afortunadamente, gracias al programa de un solo CAMS correr por Dave Sammuels), hubo una sola cámara-CAMS colocarla en el Colegio San Mateo observatorio (Dean Drumheller). Esa cámara proporciona la segunda opinión para la triangulación. El video está muy florecido para el software de procesamiento de regular para trabajar, pero los cuadros medios muestran una racha agradable, que se utiliza para combinar con la parte de la trayectoria anticipada de Sunnyvale, utilizando AstroRecord y software FIRBAL. La trayectoria preliminar se representa en la imagen de arriba. La zona de caída de potencial es de la tierra. El asteroide entró a una velocidad de 14 km / s, típico, pero en el lado lento de otro meteorito cae en el cual se determinaron las órbitas. Buena oportunidad una fracción relativamente grande de esta roca sobrevivió. La zona de caída se encuentra en la Bahía Norte. La órbita en el espacio es también bastante típico: distancia de perihelio cerca de la órbita de la Tierra (q = 0,97 AU) y una órbita de baja inclinación (aproximadamente 5 grados). Resultados mucho más precisos que se derivan de un estudio completo de las grabaciones de vídeo. Ahora, esperamos que alguien se recupera de un meteorito en el suelo ... Imagen de San Mateo Colegio estudiante Paola Castillo, usando su teléfono celular mientras atrapado en el tráfico. Imagen de Rachel Fritz y Rick Nolthenius de Cabrillo College, Aptos Imagen de Wes Jones, Belmont fuente 1 fuente 2

Un dispositivo es capaz de detectar ondas de sonido con una amplitud mucho menor que el diámetro de un protón. Ilustración del dispositivo. El tamaño de las ondas aparece exagerado en el dibujo. ¿Cuál es el sonido más débil que se puede oír con la ayuda de algún dispositivo? ¿Y el más débil en producirse? El progreso tecnológico del ser humano ha ido acercando progresivamente el primero al segundo. En 2010 un grupo de la Universidad de California en Santa Bárbara (UCSB) demostró que se podían crear fonones individuales en un oscilador mecánico criogénico. Ahora Martin Gustafsson, de la Universidad tecnológica de Chalmers, y sus colaboradores han conseguido estudiar los ecos de ondas acústicas cerca del límite cuántico. Este grupo de científicos suecos y alemanes han conseguido crear un detector de sonido capaz de registrar los sonidos muy débiles permitidos por la Mecánica Cuántica. En el régimen alcanzado el dispositivo puede tanto emitir como detectar oscilaciones mecánicas (fonones) de la manera similar a cómo los dispositivos optoelectrónicos emiten y detectan fotones de luz. El sistema ofrece nuevas perspectivas a la hora de crear circuitos híbridos que mezclen elementos acústicos y electrónicos, además de iluminar nuevos fenómenos cuánticos. Este “micrófono cuántico” está basado en un transistor que sólo usa un solo electrón a la vez (este tipo de transistores ya se habían logrado crear en el pasado reciente). El chip de arseniuro de galio sobre el que va montado tiene unos trasductores en dos bordes opuestos que son los que generan las ondas acústicas. El arseniuro de galio es un material piezoeléctrico que, como otros similares, produce campos eléctricos al ser deformado mecánicamente o viceversa. Una deformación de este cristal causada por la presencia de una onda acústica induce una polarización eléctrica. Es precisamente esta polarización la que puede detectar el transistor. Obviamente todo el conjunto está enfriado a una temperatura muy baja: 0,2 K. Las ondas acústicas estudiadas por este equipo de investigadores se propagan por la superficie cristalina del microchip y recuerdan a las ondas que se forman en una charca cuando se arroja una piedra (son diferentes a las estudiadas por el grupo de UCSB). La longitud de onda es en este caso de 3 micras, pero el detector es incluso más pequeño y es capaz de sentir las “olas acústicas” según pasan. Sobre la superficie del chip fabricaron una cámara de eco de 3 mm de largo. Aunque la velocidad del sonido de este tipo de ondas es 10 veces superior a la del sonido en el aire, el detector mostró cómo los pulsos se reflejaban entre los muros de la cavidad, verificándose así la naturaleza acústica de las ondas. Las ondas eran generadas por un trasductor de un borde y se propagaban hasta rebotar en la pared opuesta, luego en la de procedencia y así sucesivamente. Este vaivén lo realizaban varias veces. Este tipo de ondas superficiales no son mecánico-cuánticas en comportamiento, pero son tan débiles que se les puede considerar casi en el límite cuántico. El detector es sensible a ondas cuya amplitud es sólo un pequeño porcentaje el diámetro de un protón. Esta intensidad de sonido es tan baja que el fenómeno debería de estar gobernado por las leyes de la Mecánica Cuántica en lugar de la Mecánica Clásica, pero los autores admiten que el régimen es clásico. En Física Cuántica se llama fonones a los cuántos de vibraciones sonoras. Se tienen muy en cuenta en Física del Estado Sólido a la hora de estudiar las propiedades de la materia. Así por ejemplo, la teoría BCS que explica la superconductividad se basa en la introducción fonones para la explicar la formación de pares de Cooper. La propagación del calor en los sólidos cristalinos se puede explicar usando fonones. Gracias a este tipo de dispositivo se podrán detectar pronto fonones individuales al igual que ya detectamos fotones individuales. La frecuencia de estas ondas es muy alta como para que la pudiera detectar el oído humano si tuviera la suficiente amplitud, en concreto es de casi 1 GHz, unas 21 octaves por encima de la nota “La”. Esto hace de este detector el más sensible del mundo en esa gama de frecuencias. Gustafsson cree que se puede usar esta aproximación para crear una versión acústica de los qubits basados en fotones de microondas en dispositivos superconductores.