drojas75

Usuario (Chile)

España, orígen de turismo sexual pederasta España es uno de los países consumidores de turismo sexual pederasta en todo el mundo, tal y como denuncia la coordinadora de derechos de la infancia de Save the Children, Liliana Orjuela, en declaraciones a Europa Press. Al tiempo, añade que hay destinos turísticos donde la legislación contra el turismo pederasta es más "relajada". Según datos de la organización, citados por la revista 'Vida Nueva', hasta 40.000 españoles realizan cada año este tipo de viajes. En esta línea, el responsable de derechos de la infancia de Unicef España, Gabriel González-Bueno, señala que según la encuesta 'Actitud de la sociedad española ante la práctica de la explotación sexual infantil en los viajes', realizada junto a la Asociación Catalana por la Infancia Maltratada (ACIM) en 2006, el 10 por ciento de los 1.200 encuestados conocía a alguien que había viajado a un país "para tener relaciones sexuales con menores de edad". Para luchar contra este problema, se elaboró en 1998 el 'Código de conducta del sector turístico para la protección de niños, niñas y adolescentes contra la explotación sexual en los viajes y en el turismo', concebido por la ECPAT-Suecia (parte de la Red internacional contra la prostitución y la pornografía infantil y el tráfico sexual de menores). Desde la creación del Código, "Unicef lo ha apoyado con recursos económicos y de otro tipo" y tres empresas turísticas españolas están adheridas: Hoteles Sol Meliá & Resorts, Hoteles Barceló & Resorts y Viajes Mogador, como informa ACIM. Unicef y Save the Children realizan trabajos conjuntos junto a los gobiernos de los países donde están presentes. Save the Children ha trabajado en campañas de prevención y de apoyo para la formulación de planes "de tal modo que a nivel estatal haya medidas específicas de sensibilización y protección, pero también la promoción del trabajo de cooperación policial mundial". Por su parte, Unicef ha trabajado con "eficacia" en algunos países como la República Dominicana --uno de los destinos preferidos de los pederastas españoles según indica Orjuela-- y ha contribuido a cambiar las leyes en países que históricamente "han tenido fama de ser destino de turismo sexual infantil, como por ejemplo, Tailandia". Asimismo, Unicef ha colaborado en la lucha contra el turismo pederasta en países no identificados habitualmente con este problema. Éste es el caso de Sudáfrica, un país en el que, como señala González-Bueno en declaraciones a Europa Press, se actuó de manera preventiva durante la celebración del Mundial de Fútbol y en el que, según unos estudios previos, había entre 28.000 y 30.000 menores de edad, la mayoría con edades comprendidas entre los diez y los catorce años, "que podían estar inmersos en temas de explotación sexual". Pero este problema no es ajeno a España. Según información de ACIM a la que ha tenido acceso Europa Press, durante el periodo 2002-2006, la Guardia Civil española "detectó 2.749 casos de tráfico de menores, de los que cerca de 750 fueron únicamente con fines de tráfico sexual" y en el pasado mes de julio "siete menores fueron rescatadas de redes de prostitución en Cataluña". "LA EXPLOTACIÓN SEXUAL DE LA INFANCIA ES UN DELITO" Un mensaje en el que tanto Save the Children como Unicef coinciden es que "la utilización de niños y adolescentes en actividades sexuales remuneradas y otras formas de explotación sexual son formas de vulneración de derechos de la infancia, y ante todo, son un delito". Además, González-Bueno recuerda que el objetivo de la campaña 'No hay excusas', de Unicef España, era "contribuir al conocimiento de la sociedad española sobre este problema y que la explotación sexual de menores de edad es un delito". Como asegura Orjuela, el turismo sexual infantil se define a nivel internacional como la explotación por parte de una persona o un grupo de personas que viajan fuera de su país con la intención de mantener relaciones sexuales con menores de edad que pueden implicar algún tipo de remuneración en dinero o en especies, y en muchas ocasiones el objetivo no es específicamente tener relaciones sexuales con niños". Por ello, González-Bueno explica que parte de las actividades de Unicef pretenden enseñar a los niños para que sean capaces de prevenir este tipo de situaciones, "explicarles lo que supone que un adulto se acerque a ellos, sus intenciones y las consecuencias que tienen la explotación y el abuso sexual". Asimismo, las ONG y ACIM recalcan que la explotación sexual y comercial infantil existe porque "hay oferta y demanda", y uno de los mayores problemas para indagar en el problema y solucionarlo, tanto en España como en el resto de países, es que se trata de una actividad clandestina. "No hay posibilidad de tener estimaciones muy fiables por parte de quienes pueden estar incumpliendo la Ley", afirma el responsable de Unicef. En este sentido, González-Bueno reconoce que se ha avanzado mucho en la lucha contra el turismo sexual pederasta en el ámbito y penal debido con la última reforma del Código Penal "se penaliza de forma expresa no sólo al proxeneta sino también al cliente". Liliana Orjuela también comenta que se ha avanzado mucho en las legislaciones de los países, aunque advierte de que el número de víctimas "no disminuye", por lo que considera necesario "seguir trabajando y cooperando a nivel internacional, llevar a cabo políticas y programas sociales que fortalezcan a las familias para que tengan capacidad de respuesta y trabajar en el replanteamiento de muchas actitudes patriarcales y las formas de ejercicio del que vulneran los derechos de la infancia". Asimismo, González-Bueno asegura que, por ejemplo, cuando se reforzó la persecución policial y judicial en Tailandia el problema se trasladó a países vecinos como Camboya y Vietnam, por lo que coincide con Orjuela y señala que aún es necesaria "una colaboración internacional y homogénea". En este sentido González-Bueno asegura que la corrupción instalada en las autoridades de algunos países "es un obstáculo en la lucha contra este problema". Asimismo, Orjuela asegura que el consentimiento familiar no se produce tanto por ser una costumbre, sino que está más asociado "a la desigualdad y a la pobreza". Por lo tanto, en coincidencia con González-Bueno, afirma que el retraso en el logro de los Objetivos de Desarrollo del Milenio --sobre todo el primero, la erradicación de la pobreza extrema y el hambre-- influye en la dificultad para erradicar la explotación y el comercio sexual infantil, aunque el responsable de Unicef España destaca que la relación entre pobreza y explotación sexual "no es lineal". Si sabes de alguien que tenga algun razgo de pederasta o conoces algún caso de un niño o niña que esté en peligro o esté siendo abusado no lo calles... le podrías salvar la vida. Hagamos de T! una comunidad que ayuda a los niños y niñas de nuestro continente. drojas75 (Daniel Rojas)

La Web 3.0 Se trata de una prolongación lógica de un proceso de evolución. Al igual que para el paso de la generación 1.0 (que daba el acceso a la información gracias a los “buscadores”) a la 2.0 (que permite la interacción), la 3.0 por medio de plataformas digitales de todo tipo permite un nuevo nivel de integración de datos y aplicaciones interoperables, haciendo los datos tan accesibles y enlazables como las páginas web. En otras palabras, en la práctica, al nacer la generación 3.0 no desaparece la 2.0 (ni tampoco la 1.0) pero con la 3.0, sí aparece un espectacular salto cualitativo: el paso de lo masivo a la especialización. Los intercambios crecen en calidad. Se acaban las búsquedas en Internet que devuelven miles de resultados inútiles, los anchos de banda estrechos, la conexión limitada a la computadora y al móvil. Si la web 2.0 se caracteriza por el auge de las redes sociales, el siguiente paso en la evolución del ciberespacio permite lograr un Internet inteligente, presente en cualquier lugar, que conozca a la persona y se adapte a ella. Este cambio cobra aún más importancia al considerar el uso estratégico que harán los portales con esta oportunidad. Es lo que Mark López, directivo del portal TERRA en Miami, comentó en una entrevista exclusiva para NEO en ocasión de su visita a México para el Día del Internet, organizado por la AMIPCI. El salto cualitativo El hombre es un ser social, y en la vida virtual como en la vida real los intercambios se manifiestan por millones. Tanto de orden privado como profesional, los intercambios de ideas, opiniones, música, fotos, videos se multiplican de forma exponencial. Con la 2.0, rápidamente se formaron “redes sociales”, expresión acuñada al observar la formación espontánea de comunidades alrededor de temas de interés. Los temas son tan variados y de naturalezas tan diversas que pueden ir del fútbol a la metafísica o de la búsqueda de amigos desaparecidos al comercio de guitarras eléctricas. Un arquitecto, piloto aficionado de coches de carrera, encontrará fácilmente a nivel mundial una comunidad de arquitectos pilotos de coches de carrera con quiénes intercambiará ideas, opiniones, fotos…Perfil extraño que, sin embargo, forma una comunidad o red social más allá de todas las fronteras (geográficas, políticas económicas, de sexo y de edad). Con la adopción masiva de la banda ancha, la mejora en tecnología inalámbrica, la explosión de los videos online y el dominio de Google como buscador, este afán natural de los internautas por buscar y crear sus propios caminos para lograr libremente a través del Internet satisfacción a sus inquietudes de “socialización”, hubiera podido amenazar la importancia de los portales tradicionales. La respuesta inteligente Como respuesta al reto, menciona López, los portales deben abrirse para adaptar su oferta, particularmente en cuanto a actualizar las plataformas de comunidad, con nuevas aplicaciones, integrar las tendencias de “social media” en la oferta de contenidos, distribuir los contenidos y los servicios de modo diferente y entender la importancia del Search Engine Marketing (SEM) y de la Search Engine Optimization (SEO). El SEM se refiere a la actividad que realizan los anunciantes para tener la compra de palabras claves en los buscadores, a través de las cuales, sus marcas salen en los resultados patrocinados. Terra utiliza el SEM para ofertar sus contenidos más exclusivos y lograr captar más usuarios que se encuentren buscando lo que Terra tiene para ellos. La SEO es la actividad que cada página, sitio, portal de Internet, debe llevar a cabo para obtener una mejor posición en los resultados orgánicos del buscador. El trabajo que ha hecho Terra recientemente en SEO ha dado resultados por demás sorprendentes, menciona el entrevistado. Es a partir de esas observaciones que se desprende la estrategia de portales que para constituirse una audiencia altamente satisfecha y, por tanto, fiel, se especializan en temas de interés que ofrecen a comunidades afines la posibilidad de intercambiar información pertinente. Lo que implica segmentación de mercado y satisfacción de perfiles cada vez mejor identificados con sus inquietudes, tendencias, hábitos y deseos. Enfatiza al respecto López: “Terra como compañía está muy bien posicionada para tomar ventaja en las siguientes versiones de la web porque todas estas redes sociales, su contenido y toda la información que se está compartiendo entre usuarios, al final gira siempre alrededor de unos puntos de pasión, de una afición, de amar algo. Y es lo que Terra hace bien; Terra crea contenidos específicos para que un grupo de usuarios se apasione. Como ejemplos de esto, Mark López nos adelanta la operación que su organización está instalando para cubrir las Olimpiadas a nivel regional así como las plataformas que se están abriendo. Dice: “Llevamos a más de 50 personas a Beijing para que cubran las Olimpiadas. “Para algunos países tenemos incluso derechos de transmisión a través de vías en línea y eso va a crear en sí una comunidad social de amantes del deporte; por otro lado, estamos desarrollando el Espacio Terra, una red social que vamos a integrar dentro de lo que se llama Open Social, una iniciativa abierta donde están colaborando otras compañías que tienen un sitio dentro de un sector dado, incitando a sus usuarios a participar y desarrollar sus aficiones a través de todos los sitios con una sola identidad”. La 3.0 conduce a la creación de pequeñas redes que compartirán información en función de los intereses de cada persona. Y por otro lado, al hacer compatibles todas las aplicaciones, la computadora, sin ser forzosamente la plataforma principal, al conectarse a cualquier aparato desde celulares hasta electrodomésticos, coches y reproductores mp3, formará parte de una red. El cambio más profundo Con esta estrategia de apertura, colaboración y convergencia, según el entrevistado, aquí en México, Terra podrá crear una aplicación alrededor, por ejemplo, del seguimiento de la Liga Mexicana de fútbol, en la que usuarios, a partir de una computadora o de cualquier móvil, podrán informarse de los últimos resultados y las últimas noticias relacionadas con sus jugadores sin tener que ir forzosamente a una página especifica de Terra “porque ellos tendrán una aplicación que se van a llevar con ellos como parte de su identidad… y la pueden ver en otras páginas de redes sociales que tendrán esos contenidos específicos para ellos”. Este poder, esta libertad que consigue el internauta y que el portal le otorga, constituye el cambio “más profundo” que caracteriza a la generación 3.0 porque “antes, lo que la web suponía era llevar tráfico a una propiedad (sitio, portal) pero ahora con lo que se está evolucionando es llevar contenido al usuario”. Por lo tanto el cambio no sólo es de contenido; se relaciona aún más con la definición de aplicaciones que permitirán otorgar al usuario una funcionalidad: “(es decir) para tu equipo favorito tendrás el poder de participar en un juego donde eliges el resultado a futuro, combinas a los jugadores u opinas cuál sería el mejor equipo para el siguiente partido”. Esta respuesta estratégica basada sobre el análisis del comportamiento de los internautas, en aras de satisfacer sus necesidades de “socialización” y su libertad de acción, “apunta a la creación de conjuntos de plataformas aliadas, con la finalidad de crear mayor tráfico y más horas en línea y, en consecuencia, ofrecer a los anunciantes un soporte publicitario, no solamente importante en cantidad sino en cuanto a targets perfectamente identificados en cuestiones de gustos, aficiones y otras características”. La 3.0 es el win-win por excelencia, todo el mundo gana, de la oferta a la demanda: el internauta en poder, el portal en eficiencia, los mensajes publicitarios en impacto y la web en calidad. Fuente

Diez tips para sacarle mejor partido a Gmail Aquí algunas herramientas para hacer de tu mail un complemento en tu vida diaria. Gmail no es solamente ahora uno de los servicios de correo electrónicos más populares a nivel mundial, sino que además de a poco ha ido integrando una serie de aplicaciones y herramientas que permiten hacer muchas tareas más fáciles. Sin embargo, la mayoría de los usuarios se quedan solamente en la función básica. Readwriteweb publicó una guía de diez trucos para sacarle trote a este servicio, y transformarlo en algo más que solamente una casilla de correo. - Centralizar varias casillas en una: Gmail permite recibir y enviar correos electrónicos de direcciones distintas, desde la misma página de webmail. Se hace en forma bastante simple, hay que ir a Configuración y luego Cuentas e Importación, y ahi seguir los pasos. Se puede, incluso, elegir que el correo predeterminado para enviar correos no sea el de Gmail, sino otro a elección. - Priority Inbox: funciona como filtro de spam pero al revés, es decir escogiendo los correos de los emisores que se han catalogado como de mayor importancia. Optimo para quienes revisan más de una cuenta en Gmail. Se configura en Configuración - Prioritarios. - Etiquetas: Permiten organizar los mensajes en diferentes grupos y, además, añadir más de una etiqueta a un mismo mensaje. Se colocan categorizando los remitentes en grupos, estos luego aparecen al lado como subcarpetas a las que se puede consultar directamente. En Configuración- Etiquetas. - Mensajes no leídos: cuando quedan muchos correos en el camino sin revisar, y se extravían en el mar de mensajes, se puede hacer una búsqueda especial. Hay que tipear label:unread en la ventana de búsqueda. - Google Docs: Es posible crear documentos en este servicio con cualquier cuenta de correo. Además, los documentos adjuntos pueden ser convertidos en esta aplicación. Se crean en Docs. - Google Calendar: agenda que permite crear eventos para recordar reuniones, aniversarios, citas y un largo etc. Lo útil es que se integra con el correo, y permite enviar avisos vía email a las direcciones que se indiquen. Además, quienes tienen smartphone con Android podrán tener recordatorios automáticos en el momento en que el evento está transcurriendo. - Mensajes SMS: Google Calendar puede enviar mensajes SMS con alertas de eventos. - Traducción de mensajes: el archi usado traductor de Google, de las herramientas de idioma que aparecen en el buscador, puede ser usado también para traducir mensajes de correo. - Google Maps: esta aplicación permite enviar un mapa con una dirección específica inserto en un mensaje de correo. Útil cuando se trata de dar indicaciones. - Imágenes: es posible arrastrar imágenes y otros archivos al correo directamente, y quedan insertos en el mensaje. Funciona automáticamente en Chrome y quienes usen Firefox pueden hacerlo con la extensión dragdropupload. fuente: www.123.cl

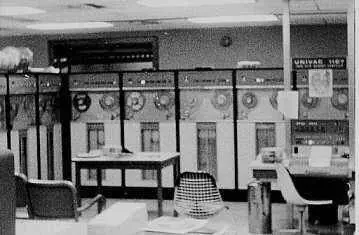

Megapost de Historia de la informática parte 2 1958: ALGOL, inicialmente llamado IAL (International Algebraic Language), es presentado en Zurich. 1958: Las primeras computadoras electrónicas son fabricadas en japón por la NEC: la NEC-1101 y NEC -1102. 1958: Frank Rosenblatt construye el Perceptron Mark I, usando un dispositivo de salida CRT (monitor de tubos de rayos catódicos). 1958: El lenguaje LISP es desarrollado para la IBM 704 en el MIT, bajo el mando de John McCarthy. 1958: Seymour Cray construye el CDC 1604, para Control Data Corp., el primer super computador totalmente transistorizado. 1958: Jack Kilby de Texas Instruments frabrica el primer circuito integrado. 1959 - 1964 LA SEGUNDA GENERACION DE COMPUTADORAS 1948 Los transistores Allá por 1945 la máxima limitación de los componentes de las computadoras eran la causa de su lenta velocidad de procesamiento. Los relés electro-mecánicos, la pobre disipación de calor de los amplificadores basados en tubos de vacío, motivaron a Mervin Kelly, por ese entonces Director de Investigación de los Laboratorios Bell, a conformar un grupo de investigadores que pudiesen concebir unos semi-conductores. El grupo fue conformado en 1946 por varios investigadores, entre los que destacaron John Bardeen, Walter Brattain y William Shockley quienes en 1948 inventaron el primer Transistor, sin presagiar que estaban a punto de lograr uno de los mayores descubrimientos de la era de la computación. En 1947, estos 3 científicos de la Bell, perteneciente a AT&T en New Jersey empezaron a experimentar con un tipo de semiconductor llamado "germanio", un elemento blanco grisáseo, que poseía un un lustre brillante metálico y una estructura cristalina, con un molde de la estructira de un diamante. Fueron John Bardeen, Walter Brattain y William Shockley quienes conociendo las propiedades del silicón hallado en las piedras de cuarzo, finalmente concibieron el Transistor. Sus componentes originales fueron muy simples. Cada uno de ellos estaba soldado encima de una tabla de circuitos que servía para conectar a otros componentes individuales. Un transistor contiene un material semi-conductor que puede cambiar su estado eléctrico cuando es pulsado. En su estado normal el semi-conductor no es conductivo, pero cuando se le aplica un voltaje se convierte en conductivo y la corriente leéctrica fluye a través de éste. En las computadoras, funcionan como un swicht electrónico o puente. 1958 Los Circuitos Integrados La computación empezó a tomar el interés de los científicos y estudiosos a partir del invento de los Transistores y no se pueden dejar de mencionar los siguientes hechos cronológicos: Fue en 1958 que Jack Kilby y Robert Noycea, de la Texas Instrument, inventaron los circuitos integrados, que eran un conjunto de transistores interconectados con resistencias, dentro de un solo chip. Fue a partir de este hecho que las computadoras empezaron a fabricarse de menor tamaño, más veloces y a menor costo ya que la cantidad de transistores colocados en un solo chip fue aumentando en forma exponencial. Vale decir de un puñado de ellos a decenas de milllones en tan sólo uno de ellos. Bajo el principio de que un impulso eléctrico viaje a menos distancia, más rápido llegará a su destino. A menor dimensión de los elementos, mas veloces son sus impulsos. Hoy día la velocidad es medida en billones o trillones de segundo. 1959: COBOL es definido en la Conferencia de Sistemas de Lenguajes de Datos (Codasyl), basado en el Flow-Matic de Grace Hooper. 1959: IBM introduce el modelo 1401. Más de 10,000 unidades serían vendidas. 1959: IBM despacha su primera computadora transistorizada o de segunda generación. Desde los modelos 1620 hasta el 1790. 1960: Benjamin Curley construye la primera minicomputadora, la PDP-1, en Digital Equipment Corporation. 1960: Control Data Corporation entrega su primer producto, una enorme computadora científica llamada la CDC 1604. 1960: DEC ships the first small computer, the PDP-1. 1960: Aparece en el mercado el primer disco remobible. 1961: La multiprogramación corre en la computadora IBM Stretch (de estiración). Varios conceptos pioneros se aplican, incluyendo un nuevo tipo de tarjeta de circuitos y transistores, con un caracter de 8 bits, llamado byte. La IBM Strech es 75 veces más rápida que los modelos de tubos al vacío, pero resulta en un fracaso comercial. Permaneció operativa hasta 1971. A pesar de que podía ejecutar 100 billones de operaciones por día, no cumple con las prdicciones de los ingenieros de la IBM, lo cual obliga a Thomas Watson Jr. a reducir el precio a casi la mitad. Sin embargo, muchas de sus innovaciones formarían parte de la existosa serie IBM 360. 1962: IBM presenta su modelo modelo 1311. Usando los primeros discos removibles y que por muchísimos años se convertirían en un estándar de la industria de la computación. La portabilidad de la información empezó a ser posible gracias a esta nueva tecnología, la cual fue empleada por los otros líderes del hardware, tales como Digital Equipment, Control Data y la NEC de Japón, entre otros grandes fabricantes de computadoras. Cada paquete de discos (disk pack) podía guardar mas de 2 millones de caracteres de información, (2 Megabytes de ahora), lo cual promovió la generación de lenguajes de programación y sus respectivas aplicaciones, ya que los usuarios podían intercambiar los paquetes de discos con facilidad. 1962: Por primera vez en la historia la IBM reporta ganancias anuales de 1 billón de dólares. Ross Perot nació en Texarkana, Texas in 1930. Después de trabajar en IBM en 1962 funda EDS (Electronic Data Systems), una empresa de servicios para computadoras. Durante la toma de rehenes en Irán en 1979, organizó una exitosa operación para rescatar a dos de sus empleados de una prisión. Vendió EDS a la General Motors en 1984, se diserfició en inmobiliarias, gas y aceite y más tarde empezó una nueva empresa de servicios de computadoras. Ross Perot nació en Texarkana, Texas in 1930. Después de trabajar en IBM en 1962 funda EDS (Electronic Data Systems), una empresa de servicios para computadoras. Durante la toma de rehenes en Irán en 1979, organizó una exitosa operación para rescatar a dos de sus empleados de una prisión. Vendió EDS a la General Motors en 1984, se diserfició en inmobiliarias, gas y aceite y más tarde empezó una nueva empresa de servicios de computadoras. En 1992 postuló a la presidencia de los Estados Unidos, como independiente, sin resultados positivos. 1963: DEC entrega la primera minicomputadora modelo PDP-5. 1963: Tandy adquiere Radio Shack, con sus 9 tiendas. 1964: IBM anuncia el lanzamiento de su Systema 360, la primera familia de computadoras compatibles. Fue el principio del uso de lenguajes amigables con comandos en inglés, tales como FORTRAN y COBOL, hasta ahora en uso, obviamente en versiones mucho más avanzadas. A pesar de ello hasta 1964 no se crearon equipos que se pudiesen nombrar como destacables. En 1964 John Kemeny y Thomas Kurtz desarrollaron la primera versión del popular lenguaje BASIC en el Dartmouth College y que permitió hacer más fácil la programación de las computadoras emergentes. 1964 - 1971 La tercera generación de computadoras Si bien los circuitos integrados fueron inventados en 1958, tuvieron que transcurrir algunos años más para que las grandes compañías los dispositivos que permitiesen desarrollar verdaderas computadoras, mas completos y veloces. En Abril de 1964 IBM presenta su generación de computadores IBM 360 Estos equipos, a pesar de que no fueron los únicos que se fabricaron en esta generación, la simbolizan debido a su enorme aceptación en el mercado de las grande instituciones estatales y privadas de todo el mundo. Las IBM 360 estaban basadas en circuitos integrados, la alimentación de la información era realizada por medio de tarjetas perforadas, previamente tabuladas y su almacenamiento se hacía en cintas magnéticas. IBM lanzó muchos modelos de esta serie como la IBM 360 20/30/40/50/65/67/75/85/90/195. Su sistema operativo simplemente se llama OS (Operating System) y los lenguajes que manejaron fueron el FORTRAN, ALGOL y COBOL. 1964: Control Data Corporation introduce la CDC 6000. Esta emplea palabras de 60-bits y procesamiento de datos en paralelo. Luego vino la CDC 6600, una de las más poderosas computadoras por varios años. Fue diseñada por Seymour Cray. 1964: BASIC (Beginners All-purpose Symbolic Instruction Language) es creado por Tom Kurtz y John Kemeny de Dartmouth. 1964: Honeywell presenta su modelo H-200 para competir con los sistemas IBM 1400. 1964: NCR introduce la 315/100. 1965: Digital Equipment despachas su primera minicomputadora la PDP-8. 1966: Honeywell adquiere Computer Control Company, un fabricante de minicomputadoras. 1966: Scientific Data Systems (SDS) introduce su modelo Sigma 7. 1966: Texas Instruments lanza su primera calculadora de bolsillo de estado sólido. 1967: DEC introduce la computadora PDP-10. 1967: A.H. Bobeck de los laboratorios Bell Laboratories desarrolla la memoria burbuja. 1967: Burroughs despacha el modelo B3200. 1967: El primer número de Computerworld es publicado. 1968: Univac presenta su computadora modelo 9400. 1968: Integrated Electronics (Intel) Corp. es fundada por Gordon Moore y Robert Noyce. 1969: El compilador PASCAL es escrito po Nicklaus Wirth e instalado en la CDC 6400. 1970: DEC lanza su primera minicomputadora de 16 bits. La PDP-11/20. 1970: Data General despacha la SuperNova. 1970: Honeywell adquiere la división de computadoras de General Electric. 1970: Xerox Data Systems introduce la CF-16A. 1970: IBM despacha su primer sistema System 370, computadora de cuarta generación. En 1971 se presentan los modelos 370/135 hasta el modelo 370/195. Ese mismo año IBM desarrolla e introduce los loppy disks son introducidos para cargar el microcódigo de la IBM 370. 1971: Intel Corporation presenta el primer microprocesador, el 4004. 1971 - 1981 La cuarta generación de computadoras 1971: El microprocesador Intel 4004 En 1969, la empresa japonesa Busicom solicitó a Intel que le fabricase un chip para un modelo nuevo de calculadora de escritorio, con cinta impresora, que deseaba producir masivamente. Un equipo liderado por Marcial Edward "Ted" Hoff, quien fue uno de sus primeros empleados desde 1986, desarrolló y terminó de fabricar en Marzo de 1971 un microprocesador, pero para uso general, al cual denominaron el chip 4000. Ted Hoff se proyectó a diseñar un microprocesador de capacidades o prestaciones mas completas que las solicitadas por la empresa japonesa, realizando el mismo esfuerzo, con la posibilidad de usos futuros. Luego de sus predecesores, Intel fabricó los modelos 4001, 4002, 4003 y 4004. Este chip de 4 bits, contenía 23,000 transistores que procesaban 108 kHz o 0.06 MIPS. Contaba con 46 instrucciones y 4k de espacio de almacenamiento. Posteriormente Intel lanzó el modelo 4004 al cual le agregó 14 instrucciones más y que tenía una capacidad de 8k de almacenamiento. Intel vendió el microchip a la empresa japonesa, pero después le recompró los derechos de propiedad intelectual por US $ 60,000, pues se dió cuenta que si bien el chip 4004 había sido fabricado para operar como cerebro de una calculadora, su versatibilidad como microprocesador de uso general le permitía ser tan poderoso como el ENIAC. 1971 La Kenbak I, primera PC Durante 1985 el Museo de Computación de Boston realizó un concurso con el objeto de registrar la historia de la computación. El museo estuvo publicitando este evento en todos los Estados Unidos, solicitando al público su contribución personal y como resultado de 316 muestras remitidas y ante la enorme sorpresa de todos, un modelo descontinuado y olvidado resultó haber sido la primera Computadora Personal, que inclusive precedió a la Altair. La Kenbak 1, fue fabricada en 1971 por John Blankenbaker de la Kenbak Corporation de Los Angeles, vale decir 4 años antes que la Altair fuese lanzada al mercado. Esta PC fue dirigido al mercado educacional y contaba con apenas 256 bytes (no kilobytes) de memoria Ram y su programación se realizaba por medio de palanquillas (switches). Solamente se comercializaron 40 equipos al costo de 750 dólares. 1973 Los discos Winchister Los discos duros Winchester son introducidos por IBM en los modelos 3340. Estos dispositivos de almacenamiento se convierten en el estándar de la industria. Provisto de un pequeño cabezal de lectura/escritura con un sistema de aire que le permite movilizarse muy cerca de la superficie del disco de una película de 18 millonésimas de pulgada de ancho. El 3340 duplica la densidad de los discos IBM cercano a los 1.7 millones de bits por pulgada cuadrada. 1974 8080, el primer CPU de Intel La verdadera industria de la computación, en todos los aspectos, empezó en 1974 cuando Intel Corporation presentó su CPU (Unidad Central de Procesos) compuesto por un microchip de circuito integrado denominado 8080. Este contenía 4,500 transistores y podía manejar 64k de memoria aleatoria o RAM a través de un bus de datos de 8 bits. El 8080 fue el cerebro de la primera computadora personal Mits Altair, la cual promovió un gran interés en hogares y pequeños negocios a partir de 1975. 1975 La Altair 8800 producida por Micro Instrumentation Telemetry Systems La primera computadora personal comercial fue la Altair 8800 fabricada por la empresa MITS en 1975, diseñada por Ed Roberts y Bill Gates. El primer modelo de estas computadoras no contaba con monitor ni teclado, tan sólo con luces LED y pequeñas palancas o switches para facilitar la programación. La información era almacenada en cassettes de las radio grabadoras y era visualizada en los aparatos de televisión. Su costo era de $395.00 con una memoria de 256 bytes. 1975 Fundación de Microsoft En 1975 William Henry Gates y Paul Allen forman Microsoft, en la ciudad de Albuquerque, Nuevo México, debido a que la sede de la MITS estaba en esa ciudad. Microsoft fue el proveedor de la versión del lenguaje BASIC para la computadora personal MITS Altair. Un par de años antes estos dos amigos de la Universidad de Harvard habían fundado TRAF-O-DATA una pequeña empresa que se encargó de desarrollar un software para la administración del tráfico en la ciudad de Seattle. William Gates estudió Economía pero abandonó sus estudios para incursionar en el desarrollo de software y los negocios. Podemos elegir a 1977 como el año del despegue de la computación personal con la aparición en el mercado de varios modelos de este tipo de máquinas. Estuvieron a la venta equipos tales como: Commodore (la cual utilizaba un televisor como monitor), un modelo de Radio Shack, Atari y por supuesto la de mayor éxito la Apple II de Woznizk y Jobs. Junto con estas máquinas aparece uno de los primeros sistemas operativos el CP/M diseñado por la Digital Research. 1975 CM/P, el primer sistema operativo estándar Gary Kildall y John Torode fundan en 1975 la Digital Research que ingresa exitosamente al mercado con su sistema operativo CPM. (Control Program for Microcomputers) escrito por Gary Kildall para las computadoras basadas en el microchip 8080 y las Z80 y que fuera muy popular en los finales de la década de los 70, pero con la aparición del MS-DOS virtualmente desapareció del mercado. Gary Kildall fue el creador del CP/M, primer sistema operativo estándar de la industria. Su vida está llena de anécdotas y colorido que forman parte del folclore, que unidos a sus inventos lo hacen ocupar un sitial de privilegio en la era de la computación. Siendo estudiante de secundaria, en su ciudad natal Seattle, estado de Washington, deseó convertirse en profesor de matemáticas y apenas concluido sus estudios llegó a enseñar en el Kildall College of Nautical Knowledge, de propiedad de su familia y que fuera fundado por su abuelo en 1924. Luego ingresó a la Universidad de Chicago y muy pronto se casó con su novia de la secundaria Dorothy McEwen, lo cual lo transformó en un estudiante aplicado, dejando atrás los años de rendimiento mediocre en sus notas estudios, los carros de carrera y las travesuras de la adolescencia. Estando en la facultad de matemáticas se interesó por las computadoras y al terminar su bachillerato decidió obtener una maestría en Ciencias de la Computación. Sin embargo ocurrió un incidente. Fue enrolado en la reserva de la Marina de Guerra de su país y se le dio a escoger entre ir a pelear en la guerra de Vietnam o dictar clases en la Naval Postgraduate School in Monterey, estado de California. La respuesta a la propuesta de la Marina de Guerra fue obvia y viajó a California. Fue en Monterrey que Gary creó el CP/M, cuyas siglas inicialmente se dieron para el Control Program Monitor, para posteriormente cambiarlo a Computer Program Monitor. Por el contrario de cualquier sistema operativo desarrollado antes o después, el CP/M no fue el resultado de investigación y desarrollo de un equipo de ingenieros sino la inventiva y el trabajo de un sólo hombre. Aunque su sistema operativo resultó ser un buen producto, por muchas razones técnicas el CP/M fue lanzado al mercado apenas un año antes de la aparición de las primeras micro computadoras comerciales. Gary Kildall falleció en 1994, debido a un trágico accidente automovilístico. Hechos notables La primera generación de computadoras personales, o microcomputadoras, como fueran renombradas posteriormente, usaron chips tales como el 8008, 8080, Zilog Z80 y el Motorola 6800. El primer número de la revista BYTE es publicado y meses después la cadena de tiendas BYTE SHOP COMPUTER empieza a crecer ráudamente. En 1976 IMSAI había comenzado a despachar las primeras computadoras en serie. La revista del Dr. DOBBS comienza a editarse y se celebra la primera conferencia mundial de ALTAIR. Bill Gates escribe su Carta abierta a los hobistas, la cual habla de la piratería de software (su versión de lenguaje Basic es copiado ilegalmente por la mayoría de usuarios). 1976 Los dos Steven y la Apple Computer Steven Wozniak y Steven Jobs fueron amigos desde la escuela secundaria y ambos se habían interesado mucho en electrónica y eran considerados por sus compañeros como personas controvertidas. Después de su graduación se mantuvieron en contacto y ambos consiguieron empleos en corporaciones de Silicon Valley. (Wozniak trabajó en Hewlett-Packard y Jobs en Atari). Wozniak se había dedicado un buen tiempo al diseño de computadoras y finalmente en 1976, construyó la que se convertiría en la Apple I. Steven Jobs con una visión futurista presionó a Wozniak para tratar de vender los equipos recién inventados y el 1o de Abril de 1976 nació Apple Computer. A pesar de la gran novedad que causó su presentación, no fue muy aceptada. En 1977, con el lanzamiento de la Apple II la compañía recién empezó a imponerse en el mercado norteamericano. Al siguiente año lanzaron la Apple Disk II, la primera disquetera y en 1980 la compañía fundada por Jobs y Wozniak ya contaba con varios miles de empleados. Emerge una forma de distribución masiva de software, a precios mas asequibles. 1977 La TRS-80 de Tandy/Radio Shack El primer modelo de esta computadora fue vendido el 3 de Agosto de 1977 por la suma de US $ 599.95 con 4k de memoria, pero muy pronto subió a 16k con el modelo de Nivel II y al cual se le agregó un teclado y posibilidad de expansión de memoria a 32 k. El microprocesador empleado fue el Z-80 de 1.77 Mhz, con sistema operativo BASIC grabado en un chip de 12k de memoria ROM. Se le podía agregar periféricos tales como un televisor de 12", casetera o un diskdrive de 89 o 102k, impresora con conexión RS-232 y hasta un sintetizador de voz. Esta computadora fue una de las más populares de la época. 1978 el microprocesador Intel 8086 En 1978 se produce un evento importante, la fabricación del microprocesador Intel 8086 el cual provocó una demanda masiva y motivó a la IBM a crear su flamante División de Computadoras Personales. El éxito de ventas alcanzado, hizo que Intel comenzara a figurar en el ranking de las 500 empresas más grandes del mundo, tal como lo publicara la revista FORTUNE 500 de Malcom Forbes, "la empresa No. 1 de las Exitosas de los Negocios de los 70s" Un microprocesador de la misma familia el 8088, utilizaría la IBM en su primera PC. En el mes de Julio de ese mismo año la revista Radio Electronics publica un interesante artículo, con diagramas y planos enseñando a construir la computadora Mark 8, basada en el microprocesador 8088 y a la que simplemente denominan "Su mini computadora personal". Muchas personas en los Estados Unidos fabricaron computadoras personales en sus propios hogares, lo cual incentivó aún más su uso. Steven Jobs visita los Laboratorios SPARC de la Xerox y obtiene ideas para desarrollar la Macintosh. MicroPro, una de las primeras grandes casas de software de la época lanza su procesador de textos WORDSTAR. El sistema operativo de la época es el CPM-86. La hoja de cálculos VisiCalc se convierte en software promotor de ventas de las computadoras personales provocando una verdadera revolución y record de ventas. VisiCalc resuelve en forma muy sencilla los problemas matemáticos de los usuarios. De allí su nombre 'Visual Calculator'. Muchísimas computadoras Apple se vendieron con el único propósito de correr el VisiCalc. Empieza la revolución del software. Todos estos grandes éxitos despertaron en la IBM la ambición de ingresar al mercado de las computadoras personales y participar en las suculentas ganancias que obtenían empresas como Apple, Tandy/Radio Shack, Commodore y hasta Spectrum de Inglaterra. Caben mencionar los siguientes hechos cronológicos: 1971: Computer Automation introduce la Alpha-16. 1971: IBM presenta las computadoras mainframes 370/135 y 370/195. 1971: NCR preenta el modelo Century 50. 1971: Sperry-Rand toma la línea de computadoras de la RCA. 1972: La primera calculadora de bolsillo es fabricada por Jack Kilby, Jerry Merryman, y Jim VanTassel de Texas Instruments. 1972: Gary Kildall escribe el PL/1, primer lenguaje de programación para el microprocesador Intel 4004. 1973: IBM enfrenta un juicio de Control Data, terminando por vender el Service Bureau Corporation (SBC) a Control Data. 1973: El lenguje PROLOG es desarrollado por Alain Comerauer en la Universidad de Marslla-Luminy, Francia. 1974: Zilog es formada para fabricar microprocesadores. 1975: Se forma el Homebrew Computer Club, considerado el primer grupo de usuarios de computadoras personales. 1976: Commodore International construye la Pet 2001. Con nuevo microprocesador 6502. La Pet fue la primera computadora personal con una pantalla incorporada, con 4k de memoria Ram, expandible a 32 K y un programa BASIC en memoria ROM (Read Only memory). Los programas se almacenaban en cassettes y su precio de venta fue de US $ 595 para el modelo de 4k y US $ 795 para el de 8k. Posteriormenta Commodore International compraría la MOS Technology, que fabricaba los chips 6502. 1976: NEC System 800 y 900 de propósito general son presentados. 1977: DEC introduce su primera superminicomputadora de 32 bits, la VAX-11/780. 1978: Se celebra la primera feria de COMDEX. 1979: El lenguaje Ada es desarrollado por un equipo dirigido por Jean Ichbiah en CII-Honeywell Bull (Francia). 1980: Commodore Inc. presenta la VIC-20, un modelo de computadora personal muy barata, dirigida a los principiantes y hobbistas. Usaba el microprocesador 6502 con una memoria de apenas 5k de Ram. El sistema estaba diseñado para ser conectado a un televisor y los programas se almacenaban en una casetera, la cual debía ser conectada a la VIC-20. 1980: Control Data Corporation introduce el supercomputador Cyber 205. 1981: La Commodore 64 reemplazó a la VIC-20. Se vendió al igual que su predecesora, a muy bajo precio. Este modelo empleó un microprocesador ligeramente mejorado al 6502 y que costaba US $ 20 al por mayor. La Commodore 64 usó el chip 6510 que permitía una capacidad de procesamiento de 64k y podía integrarse a un diskdrive fabricado por la misma empresa, para ejecutar los programas y el almacenamiento de la información. 1984: el Macintosh La compañía Apple lanzó una máquina que introduciría nuevamente una revolución: el Macintosh. Éste era el sucesor de un modelo llamado "Lisa" -pero que no tuvo aceptación debido a su costo y escasa capacidad- en que se introducía por primera vez el concepto de interfaz gráfica, la analogía del "escritorio" y un nuevo periférico: el "mouse" o ratón, como herramienta para controlar al computador. Existen además supercomputadores que en vez de funcionar a base de un sólo microprocesador utilizan miles de éstos, pudiendo así hacer un enorme número de operaciones simultáneas, llegando a los doscientos millones por segundo. El primer modelo fue desarrollado por Cray y comercializado hacia 1984. Realizaba 80 millones de operaciones por segundo. 1986: T-40.000 Floating Point Systems, compañía competidora de la Cray Research, lanzó su "T-40.000", con 16.384 microprocesadores coordinados por "transputadores", el cual es capaz de procesar a una velocidad de 262 millones de operaciones en punto flotante por segundo (Mflops). Hoy, algunos supercomputadores ocupan hasta 65.000 microprocesadores. 1991: Nanoelectrónica Un equipo de investigadores de IBM desarrolló el aparato más pequeño jamás creado por el hombre: un interruptor que mide el tamaño de un átomo. Es capaz de controlar el flujo de corriente eléctrica desplazando un átomo de xenón entre dos diminutos electrodos. Esta proeza es de suma importancia para el desarrollo futuro de computadores enanos ya que los componentes con dos posibles estados constituyen la base de los procesadores. Este mismo año, Digital Equipment (DEC) lanzó al mercado una familia de computadores basados en arquitecturas de paralelismo masivo: las máquinas van en un rango desde los 1.024 hasta los 16.384 microprocesadores que trabajan en forma paralela. En su configuración máxima (por un costo de unos 1.500.000 dólares) son capaces de realizar 26 mil millones de instrucciones básicas por segundo (26.000 MIPS). La firma NCR exhibió su nuevo microcomputador sin teclado, lanzado en diciembre de 1991 en los Estados Unidos. Se trata del "Notepad NCR 3125" que consiste en una caja del tamaño de una hoja carta y de 3 cm de espesor y un lápiz inalámbrico especial. Pesa menos de 2 kg, por lo cual podía ser usado como si fuese un bloc de apuntes. Tiene una pantalla sensible a los pulsos electrónicos enviados por el lápiz. Así, el accede al computador mediante símbolos, gráficos y escritura manual. Funciona con software de procesamiento de textos y bases de datos, gráfica, fax y comunicación con otro computador por teléfono. Es el predecesor de las actuales computadoras de mano. Gracias por visitarme.