horaciopopo

Usuario (Argentina)

Google ha decidido dejar de lado el flamante renderizador de sitios web, WebKit, ampliamente usado por Safari tanto en Mac como en teléfonos móviles, así también como ampliamente usado en Chrome -hasta ahora- y Chrome para Android, como el Navegador integrado en las versiones anteriores a Android 4.2.2. Con todo esto, WebKit era el amo y señor de los sistemas de renderizado de sitios web, al menos, hasta hoy, puesto que Google ha decidido hacer un fork -una clonación del código fuente- de WebKit para comenzar, desde esta base, a construir Blink: un motor de renderizado nuevo que, aseguran, corrigen una serie de problemas que han encontrado con WebKit en el camino. Esto llega como un balde de agua a WebKit, principalmente impulsado por Apple, quien tiene como motor número 1 a este renderizador, ya que supondrá la pérdida de Chrome para escritorios -que, dicho sea de paso, es el navegador web más usado en Sudamérica- y, probablemente a futuro, Chromebooks y teléfonos con sistema operativo Android, que tienen actualmente Webkit instalado en el Core de su sistema. Apple, en 2005 hizo el mismo proceso que Google está haciendo con WebKit: creó un fork de otro motor de renderizado llamado KHTML, desarrollado por el grupo KDE, conocidos por crear las interfaces de escritorio, del mismo nombre, en Linux. Desde esa fecha a la actualidad, WebKit ha sido el único motor en implementar mejoras tecnológicas mucho más rápido que los sistemas de la competencia, incluso que Firefox. Eso no sería todo sino también por un aviso de Opera, quienes también han reconocido públicamente que se pasarán a Blink, tanto en su aplicación de escritorio -siendo el cuarto navegador más usado en el mundo- como de su versión móvil de Opera -que es bastante usada tanto en sistemas antiguos como en teléfonos inteligentes-, lo que hará que Blink se haga, de entrada, con una cuota de usuarios enorme. Aunque para los usuarios de los navegadores este sea un cambio que pase prácticamente desapercibido, sí será un cambio -y una mejora- enorme para los desarrolladores de Sitios Web, ya que al haber más competencia, las tecnologías serán implementadas más rápido. Además, ya varios expertos indicaban que Webkit está matando la web, al acaparar la mayor parte de los desarrollos, haciendo que los desarrolladores se decanten por Webkit más que por ofrecer soporte a renderizadores de terceros.

La expresión “realidad virtual” evoca en los aficionados a la tecnología proyectos fallidos, experiencias simplonas, ciencia ficción que ha envejecido mal y algunas distopías sobre evasión de la realidad que todavía constituyen un sambenito recurrente de lo digital. Tras probar Oculus Rift en el pasado E3 creo que estamos ante el dispositivo que va a suponer un punto y aparte, la obligación de aparcar prejuicios y desdén hacia una realidad virtual que uno ha disfrutado, por fin, como una experiencia sensacional, tan bien ejecutada que uno se pregunta a qué esperan los grandes de la industria para hacer algo con Oculus. La historia de Oculus Rift La historia de Oculus Rift es la de un joven llamado Palmer Luckey, veintañero californiano que comenzó a crearlo como hobby, probablemente porque no sabía que la mayoría del sector tecnológico había dado ya la realidad virtual por muerta y enterrada. Tras varios prototipos aterriza en el E3 no sin antes enseñárselo a un viejo rockero de la industria del videojuego, John Carmack, que – si me permiten la expresión – flipa con el producto cuando lo prueba con una versión adaptada de Doom 3. A continuación se suma al proyecto gente con un bagaje lo suficientemente alto como para convertir Oculus en una empresa, con Brendan Iribe – ex Gaikai – como CEO. Como tantos proyectos la primera financiación de Oculus viene vía Kickstarter, donde piden 250.000 dólares y consiguen casi dos millones y medio: sí que había mucha gente pensando que era una buena idea dar una nueva oportunidad a la realidad virtual. Llegados a 2013 tenemos una compañía con un proyecto empresarial que ha dejado muy atrás la etapa de hobby de Palmer para alcanzar un prototipo sobre la mesa que hace las veces de kit para desarrolladores y de prueba de que la tecnología sí que está ahora preparada para la realidad virtual y de que Oculus apunta a ser la referencia de esta nueva etapa. Oculus en nuestra cabeza, Oculus en nuestra mente La versión que hemos probado es tosca, pero no tan aparatosa como puede parecer en fotos. Previamente a la prueba se nos explica el funcionamiento, se nos refuerza que avisemos si nos sentimos mareados y nos colocamos el Oculus en la cabeza, los auriculares también y cogemos un gamepad con cierto escepticismo respecto a lo que viene a continuación… …que es, sencillamente, fantástico. Empezamos a jugar a una versión adaptada del EVE de CCP, un juego en el que pilotamos una nave espacial y por grupos debemos combatir unos con otros. La resolución es baja, notamos un pelín de latencia, pero todo ello se desdibuja ante una realidad y una experiencias fabulosa. De repente estamos en la nave y a cada giro de nuestra cabeza divisamos lo que vería el piloto. No, no es eso, es que somos el piloto, estamos pilotando en el espacio y uno se siente desorientado a la par que empieza a disfrutar del vértigo de la velocidad. Bajamos la mirada y vemos nuestras piernas que no son nuestras piernas pero es lo que debería estar ahí, como están los brazos y los mandos de la nave. La experiencia fluye mientras pilotamos y nuestra nave se zafa en un combate espacial muy simplificado – el juego no deja de ser un combate sin elementos de simulador – y apenas uno se acuerda del “mundo exterior” cuando tiene que pensar en “cómo se hacía tal tarea con el gamepad”, nexo de unión entre la realidad virtual que uno experimenta y esa realidad que no deja de ser la de estar en una feria de videojuegos probando uno. No quiero imaginar como serían mis juegos preferidos de los últimos años si pudiese abordarlos bien integrados en Oculus, pienso en un Red Read Redemption o en ese “Last of Us” al que tengo tantas ganas o, ¿por qué no? Un Forza en el que de verdad sintiese la velocidad en su máxima expresión. Saber que se están adaptando Mirror’s Edge y juegos como Team Frotress, como muestra el vídeo siguiente, refuerzan mi esperanza de que Oculus no se va a quedar en “otro hype” más de la industria. link: http://www.youtube.com/watch?feature=player_embedded&v=P50fvL_EWYY ¿Y ahora qué? El próximo reto para Oculus es conseguir una versión para consumidores finales – a ser posible menos fea que el kit que hemos probado – a un precio razonable (el kit cuesta 300 dólares pero no está claro a cuanto pueden llegar para el mercado de consumo), algo que quieren tener durante 2014. Otro frente es de los desarrolladores y la necesidad de que comiencen a adaptar sus juegos. Esta va a ser la gran asignatura, después de todo no se trata de integrar un mando nuevo, se trata de que la experiencia esté reorientada a una bastante diferente. También está la la duda de que lo que funciona bien para jugar con teclado y ratón o gamepad lo haga con algo como Oculus. Tecnológicamente sus próximos pasos van encaminados a mejorar algunos de los puntos que recogemos en estas primeras impresiones. Una resolución de 1080 va a ser lo primero, además de que empiezan a hablar de experiencia con el cine. Luego sus necesidades en términos de “fps” lleva a que probablemente el lugar de integración natural de Oculus sea el PC y, si acaso, las consolas de nueva generación, One y PS4, aunque nada de esto está confirmado. Tengo dudas de que Oculus sea quien finalmente lidere el mercado de juegos y experiencias de realidad virtual, pero no las tengo respecto a que la madurez de la tecnología permite que ésta no sea el lugar común cuando nos queremos referir a planteamientos desenfocados. Cruzo los dedos para que en el próximo e3 no esté hablando sobre un proyecto que se quedó a medias sino sobre la ejecución mejorada de un producto, Oculus, que me ha impresionado como pocos en muchos años. http://www.oculusvr.com/

Mientras que algunos trabajadores de Microsoft han indicado que ya estarían trabajando en una nueva versión de la popular consola Xbox, no se sabía a ciencia cierta cuándo ésta estaría disponible. De acuerdo a un nuevo rumor, la “Xbox 720″ se presentaría en el 2013, en una fecha que concuerda con el masivo evento de tecnología electrónica para el entretenimiento, E3.Mientras que Microsoft decidió comenzar a trabajar en la próxima Xbox no mucho después de haber lanzado la versión anterior, decidió mantener en escueto trabajo qué es lo que se estaba haciendo en dicha consola. Todos los rumores apuntan a que la Electronic Entertainment Expo, E3, del año 2013, podría albergar el lanzamiento de esta nueva consola que introduciría algunas cuantas mejoras.El rumor viene de algunas compañías creadoras de ciertos procesadores de la Xbox y algunas empresas de software que trabajan en la producción de la siguiente Xbox. Además, dichos rumores sugieren que la consola se llamará Xbox 720, y que AMD estaría también trabajando para hacer que dicha consola tenga una excelente calidad de detalle, donde incluso la comparan a la cantidad de detalles de la versión HD de la película Avatar.

Nokia ha presentado su primera pantalla flexible para smartphones, conocida como Nokia Kinetic Device.La Expo Nokia World 2011 está empezando en Londres, donde a los jugadores se les ha dado su primera visión de los nuevos teléfonos del fabricante de Windows.Pero no todo es sólo de Windows. La compañía también mostró una pantalla flexible de 4 pulgadas que se encuentra actualmente en fase de prototipo.La pantalla, conocido como Nokia Kinetic Device, pueden ser doblados vertical y horizontalmente para ejecutar comandos diferentes. Por ejemplo, la flexión de la pantalla hacia usted hará que la pantalla acerque al instante la imagen que está viendo.Vea un video de él en acción aquí:Las pantallas flexibles han ido apareciendo por todos lados últimamente, pero la mayoría de ellas han sido trabajos de las universidades y las organizaciones militares como el Ejército de los EE.UU. El Nokia Kinetic Device es uno de los primeros prototipos que hemos visto dirigido directamente al mercado de consumo.

Procesador Nvidia Tegra 3 quad-core y 1,4 GHz, junto con 2 GB de RAMEl Asus Transformer Prime, la evolución del Eee Pad Transformer, es súper rápido. De acuerdo con Tech 2, en una prueba de velocidad muestra que el Procesador Kal-El quad-core Nvidia Tegra 3 está por encima de todos los dispositivos Android.No sólo es su CPU, que hace que el resto de los dispositivos parezcan hermanos del ZX Spectrum, pero también se dice que tienen el doble de memoria RAM de la Galaxy Nexus – 2 GB completos.Con una actualización confirmada del SO de Android Ice Cream Sandwich, un teclado delgado, pantalla de alta definición y velocidad de vértigo que todos esperábamos, estamos ahorrando nuestros centavos para el Asus Transformer Prime, cuyo lanzamiento podría ser tan pronto como el 9 de noviembre

Google ha hecho nuevos cambios en todas sus aplicaciones para ponerlas más a tono con las nuevas funcionalidades de Google Plus y para ‘agrupar’ un poco más los diseños de todos y cada uno de sus servicios. Youtube no es la excepción y hace unos días se lanzó no oficialmente la nueva versión de este sitio de vídeos. ¿Quieres ver el nuevo Youtube antes que nadie? Aquí te enseño cómo…El nuevo Youtube tiene integración total con Google Plus, pudiendo incluso tener un rápido acceso a todos los canales en Youtube de tus contactos en Google Plus, además de tener un excelente nuevo diseño, un nuevo ícono que sólo se compone de un “play” y un pie de página, aunque minimalista, útil.Para activar en tu equipo el nuevo Youtube, haz lo siguiente:1.Abre la consola de Javascript de tu navegador -en Firefox es Herramientas -> Desarrollador web -> Consola web, dejando activo sólo el botón JS; en Chrome es en el menú Herramientas -> Consola Javascript-2.En dicha consola, escribe: document.cookie="VISITOR_INFO1_LIVE=ST1Ti53r4fU"; -pone ojo, que WordPress cambia las comillas rectas, de código, por comillas tipográficas, si no funciona, escribe tu mismo el código-3.Recarga la página presionando CTRL+F5 en Windows/Linux y CMD+R en Mac.Eso es todo, con eso, al igual que nosotros, deberías estar disfrutando del nuevo diseño de Youtube y sus funciones sociales antes que el resto de los mortales. ¡Genial!

La primera Kinect ha sido un gran éxito para Microsoft. No solo rejuveneció la Xbox 360 y le dio nueva vida a la gran marca Microsoft, sino que mostró que los de Redmond no se habían petrificado por completo todavía.Teniendo en cuenta que, la especulación y las esperanzas se están calentando para el Kinect 2, la segunda generación de la línea de captura de movimiento, nuevos rumores señalan hoy a un futuro en el que el Kinect, ya elogiado por su capacidad tecnológica, adquiere un nuevo nivel de capacidad.De acuerdo con Eurogamer, una página web de juego informativa respetada, el Kinect 2 tiene el poder suficiente para “de manera precisa poder leer los labios.” Y, según la misma fuente. “La Kinect 2 vendrá con futuras consolas de Xbox.” Al hacer el Kinect una parte intrínseca de la experiencia de Xbox, mediante su inclusión en la consola, Microsoft va a llevar la tecnología a un número aún mayor de los consumidores.La fuente señaló además cómo Kinect 2 obtendrá más información para alimentar a la consola, “Puede ser cableado directamente a través de cualquier tecnología para tomar los datos de resolución extraordinariamente alta directamente al procesador principal y directo a la memoria RAM principal y preguntar, ¿qué quieres hacer con ella? “Esto también reduce el retraso entre la acción de un usuario, y afecta lo que está sucediendo en pantalla.Mejorar el rendimiento, junto con el reconocimiento de una gran expansión, pondrá al Kinect 2 no sólo por encima de su predecesora, sino también de todos los rivales previsibles. Aún más, ya que Microsoft está trabajando para llevar Kinect a la PC, las oportunidades que están a punto de ser abiertas para los desarrolladores y usuarios, son infinitas.

El ACTA (Anti-Counterfeiting Trade Agreement), ha estado recibiendo más atención de los medios de comunicación y público en general últimamente, gracias en parte a las protestas masivas de Internet en contra del proyecto de ley con base SOPA, PIPA. Al igual que SOPA y PIPA, ACTA fue escrita en parte para tratar de combatir la piratería en línea, pero los opositores han afirmado que es demasiado amplia por escrito y dará lugar a sitios web bloqueados. En enero, Polonia votó para aprobar ACTA, pero algunos legisladores de ese país eligieron protestar contra la aprobación con el uso de máscaras de Guy Fawkes en el Parlamento. Ahora parece que ACTA está empezando a perder el apoyo de la Unión Europea. ZDNet Reino Unido informa que Alemania ha optado por no votar sobre ACTA hasta después de que el Parlamento Europeo vote sobre la propuesta. Eso está previsto que ocurra en algún momento de junio. Además algunos otros países europeos, entre ellos Polonia, han firmado el ACTA, pero todavía tienen que ratificar el acuerdo. Las reglas del Estado de la Unión Europea dicen que si un solo país del sindicato no hace ambas, tanto firmar y como ratificar el ACTA, el tratado no puede aplicarse en la Unión. El hecho de que varios países están manteniéndose fuera de esas decisiones podría significar que ACTA ha muerto en el agua en Europa. Los EE.UU. y otros países ya han firmado el tratado ACTA.

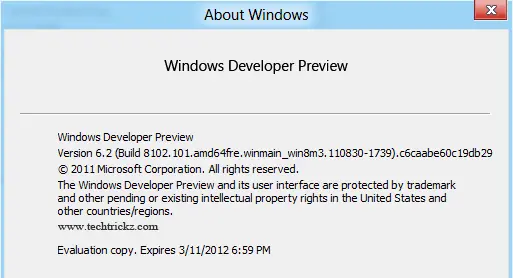

Hay disponible una actualización que permiirá seguir utilizando Windows 8 Developer Preview y de Windows 8 Server Developer Preview hasta el 15 de enero de 2013 La fecha de expiración inicial de Windows 8 Developer Preview es el 1 de marzo de 2012 mientras que el de Windows 8 Server Developer Preview es el 8 de abril de 2012. Tras instalar la actualización Windows se reactivará y la fecha de expiración se pospondrá hasta el 15 de enero de 2013. Se debe instalar antes de la fecha de caducidad y está disponible desde Windows Update (KB2671501). http://support.microsoft.com/kb/2671501

En la guerra y en el amor todo se vale, dice una famosa frase, y pues parece ser que la gente de Microsoft la sabe aplicar muy bien, dentro de la cantidad de características que han anunciado, esta sin lugar a dudas es la que me parece más preocupante. El problema según ha podido darse cuenta Matthew Garrett de Red Hat y como comentan en este artículo de IT World es que todas las máquinas que sean vendidas con la versión OEM de Windows 8 preinstalada tendrán un requerimiento especial, deberán venir con booteo seguro UEFI activado, una función que impide bootear con otro sistema operativo que no esté firmado y aprobado por una autoridad certificadora confiable. En Alt1040 se plantean 3 interesantes preguntas: ¿Es una maniobra por parte de Microsoft? ¿Es una jugarreta sucia? ¿O sólo una consecuencia de evolucionar hacia un bootloader más avanzado?, realmente podrían tomarse como 2, las 2 primeras se podrían unir, sin ser un linuxero extremos e intentando ser bastante imparcial, creo que las 2 tienen algo de cierto…. Para la mayoría de linuxeros novatos el arranque dual es una perfecta opción para ir incursionando en este mundo del software libre, ya que en el momento en que no puedan hacer algo en GNU/Linux pues simplemente reinician y arrancan con Windows. También podría tratarse de una evolución, una manera que busca Microsoft para evitar la pirateria e impedir que se propague tan fácilmente el malware como lo afirma Arie van der Hoeven, de Microsoft: La razón es que “un creciente tipo de malware tiene como objetivo atacar el proceso de booteo y muchas veces la única solución es reinstalar el sistema operativo. UEFI y el booteo seguro fortalecen el proceso de booteo y reducen la probabilidad de bootkits, rootkits y software de secuestro Aunque ya hay distros de Linux que soportan UEFI desde hace muchos años, el requerimiento de que tienen que estar firmados se convierte en una piedra en el zapato, la opción sería desactivar el booteo seguro en las configuraciones de UEFI antes de instalar un sistema operativo de código abierto, aunque esto dependerá mucho de lo que quiera hacer el fabricante de hardware. He leído en algunas páginas, y en algunas otras en español/castellano, que Windows 8 no permitiría el arranque dual, debido en lugar de utilizar la BIOS para arrancar Windows 8, se usaría el Unified Extensible Firmware Interface (UEFI), con una función de asegurar el arranque activado; es decir, que por un "problema de seguridad", se estaría obligado, por esa medida, a bloquear el arranque e instalación de otros sistemas operativos, esto es un ataque a libertad del consumidor. Quizás eso pronto sea resuelto, esperemos. Se aclara en los sitios que esta medida afectaría a plataformas de 64bits, que no son tan pocas como se cree. Van a haber problemas no solo con los gestores de arranque (GRUB), sino también con aquellos usuarios que les guste o deban hacer uso de su propio kernel, por alguna incompatibilidad, problema asociado,o por gusto. Aquí se dice que GNU/Linux puede crear su propio firmware, y hacer una "llamada" a si mismo, pero todavía tendría que necesitar obtener o poder tener sus claves incluidas en el firmware de Microsoft. Claro, existen leyes antimonopolio que quizás frenen esto "avance" de Microsoft, ya que se debe respetar la libre decisión de cualquier persona a instalar lo que se decida en "su equipo", por lo menos así debiese ser en todos lados. Por eso, también es bueno aclarar que, tras lo leído recientemente aquí, si se permitiría la instalación de otros SO, debiendo desactivar la UEFI (Unified Extensible Firmware Interface); ya veremos cuando estemos en esa situación.