matusalen123

Usuario (Costa Rica)

Opinión Dominar y someter En El Mago de Oz Dorothy fue encargada con la tarea más simple de la Historia del cine: sigue la senda de las baldosas amarillas. Ya te diremos cuándo has ganado. En Fable 2 una senda de polvos dorados me marcaba de forma muy similar hacia dónde tenía que ir para repartir caña, y en Black Ops 2 un punto siempre se aseguraba que supiera a quién tenía que seguir o matar porque supongo que si me dejas por mi cuenta acabaré metiéndome lápices en el cerebro. Los videojuegos han crecido en popularidad en sus últimos años, eso no tiene discusión. Este medio se abre a cada vez más gente y en respuesta los estudios intentan a cada nuevo juego abarcar un público mayor (la tan odiada “audiencia de Call of Duty”). La ley dicta que cuando una obra, producto o medio se abren al gran público, se pierde algo por el camino. Como decían en Men in Black: “el individuo es listo. La masa es un animal miedoso, idiota y peligroso”. El auténtico motivo por el que los frikis en ocasiones somos tan cerrados es porque no queremos que se corrompa aquello que amamos. Los memes eran algo bonito hasta que Cuanto Cabrón, 9gag y Reddit los redujeron a las imágenes y cómics de reacción. Cuando algo se vuelve popular se baja la barrera para permitir que mucha más gente pueda entrar al círculo. Ahora todos somos ganadores. En Call of Duty si matas a dos personas seguidas tienes un radar que localiza a toda la gente en tu mapa, y si matas a un par más tienes un helicóptero a tu servicio, pero el otro día un amigo mío causó una masacre en Unreal Tournament 3, de tono más añejo, y la única recompensa que tuvo fue saber que él era el mejor. Aunque la campana de Gauss asegure que el denominador común es mediocre en el sentido más halagador de la palabra, si es que se puede decir de tal manera, parece que los desarrolladores piensan que el gran público es retrasado mental y, bueno, lápices en el cerebro y todo eso. Lo demuestra el sistema de combate absurdamente simplista de Assassin’s Creed, lo demuestran las ayudas para moverse en un escenario no lineal de Hitman: Absolution y Tomb Raider y lo demuestra Portal 2 al reducir exponencialmente la dificultad de sus puzles. La gran ironía es que prácticamente todos los lanzamientos AAA están dirigidos a un público adulto o casi adulto y que el gamer promedio tiene lo que se dice pelos ahí abajo, así que debería saber perfectamente que con el botón de abajo se salta, con el gatillo izquierdo se dispara y creo que ya sabéis de qué hablo. Me equivoco: la ironía suprema, reina de todas las ironías, es que los gamers de la vieja escuela eran niños cuando jugaron a Contra, Metroid o Quake. La inmensa mayoría tienen recuerdos de su infancia de esos juegos y llegaron lejos: los dominaron y avanzaron. Mientras, hoy día la youtuber de incomprensible fama iJustine no logra poner un portal en una pared blanca claramente señalada en la secuela de la aclamada obra de Valve. Asco de vida. Los estándares han cambiado. Como Egoraptor señaló en su magnífica Sequelitis, Megaman utilizaba el diseño de niveles y el posicionamiento de los enemigos para enseñar al jugador a desenvolverse en su universo. Los desarrolladores ponían empeño en enseñar a dominar el juego, invitaban al jugador a mejorar en él y aumentar sus capacidades. Esas afirmaciones de que los videojuegos mejoran la capacidad ojo-mano son precisamente por exigencias de este tipo. Pero cuando en New Super Mario Bros. U muero unas pocas veces y el juego me dice que si quiero que Luigi me pase el nivel porque soy un poco tolfo, no estoy mejorando en nada. Y aunque juegue para completar, me gusta dominar un juego. Algunos de los mejores momentos a los mandos de una consola los he tenido al ver que dominaba algo. Skate y especialmente Dark Souls son los grandes testigos de este placer. Con todas las frustraciones que pueda causar, cuando haces algo tan simple como saltar por unas escaleras sin que tu skater se quede sin dentadura te sientes Dios. Sin embargo hoy día los estudios no nos exigen nada. Los juegos no son un desafío a superar: son una secuencia de botones a pulsar para que nos ofrezcan contenido. Los juegos están sometidos a nuestra voluntad, y como si fueran nuestros siervos, fingen que se esfuerzan pero en el fondo quieren perder. Porque si no las consecuencias serán catastróficas. Puede ser catártico el pillar a un matón en el Sleeping Dogs y contraatacar con todas tus fuerzas, pero no se compara a la satisfacción de acabar con tu primer caballero negro en Lordran. Y no es sólo que la dificultad haya bajado: es que todo se ha simplificado. La interfaz nos especifica qué debemos hacer, adónde hemos de ir y por dónde se va. En Skyrim una flecha nos señala constantemente dónde están nuestros objetivos, y en GTA IV un GPS nos indica el camino cuando subimos a un coche. En Call of Duty un marcador nos dice cuál es nuestro objetivo, y en Final Fantasy XIII un pasillo lineal impide que nos perdamos y que lleguemos a nuestro objetivo sin importar nuestra incompetencia. Personalmente me siento un poco estúpido cuando juego a Bioshock y una flecha aparece para orientarme porque realmente no sé orientarme. He perdido esa costumbre. Dicen que nunca hay que jugar al ajedrez con alguien peor que tú porque bajarás al nivel de esa persona, y la generación actual lo demuestra. Nos hacemos más estúpidos, más simplones y dependientes. Volvemos a aquella referencia de Doraemon que hice al hablar de la Xbox One. Vivir relajados es fácil ¿para qué intentar enlazar combos y jugar con gracilidad si simplemente puedo quedarme quieto y machacar un botón? Pero luego la otra cara de la moneda no facilita las cosas. Leí hace años en la sección “lenguas de trapo” de Micromanía que un desarrollador había descrito cómo ser el diseñador de los últimos niveles es horrible: sabes que casi nadie llegará a ese punto. Una encuesta que IO hizo hace unos pocos meses aseguraba que una cifra que rondaba un absurdo 20% de los jugadores llegaban al final de los juegos. La cultura gamer, una vez más, no es la más coherente del mundo: deseamos con todas nuestras fuerzas que los juegos sean respetados y considerados un arte, pero lo tratamos como un producto. En la Edge de este mes una cita de Christopher Sondberg decía que “cuando te pasas un juego en diez u ocho horas, yo también lo devolvería”. El pensamiento de que el idiota incapaz que muchos piensan que es el jugador promedio se sienta frustrado y a los pocos minutos deje de jugar y venda la obra en la que llevas trabajando tanto tiempo es uno que debe aterrar a los estudios, y como con todo en este mundo, han decidido tomar la ruta fácil. Claro que pueden hacer que el juego enseñe a través de sus mecánicas a dominarlo. Claro que pueden hacer una obra más desafiante al mismo tiempo que accesible. Muchas de esas personas hacían juegos cuando yo todavía era un espermatozoide. Pero no quieren porque es más fácil poner un tutorial de media hora explicando que el stick izquierdo por enésima vez nos hace desplazarnos y que el stick derecho, gran sorpresa, gira la cámara. Es más fácil hacer que tengamos vida regenerativa, que quita la necesidad de estudiar los mapas y poner empeño en la ubicación de botiquines. Es más fácil señalar con una flecha adónde ir en lugar de utilizar la luz y el color para señalar el camino. No digo que los juegos deban ser todos como una obra de Terry Cavanagh. Jesús, no soy un masoquista. Pero es una pena que por simple y pura pereza los estudios hayan decidido cortar de cuajo uno de los aspectos más interesantes y que más se han explorado de este nuestro medio: la posibilidad de ser bueno jugando.

Se trata del supuesto ataque de un OVNI sobre un campamento talibán en Afganistán. No queda muy claro si Obama ha conseguido que una raza alienígena se alíe con los Estados Unidos para exterminar a los extremistas en aquel país, o si la tecnología es propia (o cedida por algún ser gris). Por otro lado, a nadie le sorprendería que los americanos dispusiesen de una nueva nave con características asombrosas, ya que durante las ultimas fechas se han podido ver naves triangulares en los cielos de norteamérica, dejando estelas de condensación, por lo que al parecer no se mueven por complejos y alienígenas sistemas antigravitatorios o de curvaturas espacio temporales. Sin más preámbulos veamos el video: link: https://www.youtube.com/watch?feature=player_embedded&v=YQWqiI0jlQc La secuencia está firmada con el logo “Section 51” que es un canal de youtube de un creador de CGIs. No lo dice expresamente, pero es algo evidente, ya que su canal es un arsenal de videos similares: OVNI ataca a Rangers americanos en Afganistán link: https://www.youtube.com/watch?feature=player_embedded&v=_OuhJ0Y11nA Marines americanos sorprendidos por un OVNI link: https://www.youtube.com/watch?feature=player_embedded&v=kZnY-dj_86U Marines americanos luchando contra un OVNI gigante en Afganistán link: https://www.youtube.com/watch?feature=player_embedded&v=G89_7FYynt4 Etc, etc, etc. Por si eso no os parece prueba suficiente, aquí os dejo el video original utilizado por este “artista” para montar su circo y captar la atención. Para evitar una identificación rápida con las herramientas de búsqueda de imágenes, ha espejado horizontalmente la secuencia. Las explosiones están originadas por bombas JDAM, unas bombas de caída libre con un sistema de guía inteligente que moviendo los alerones de cola puede dirigir con mayor precisión la carga explosiva hasta un objetivo prefijado. link: https://www.youtube.com/watch?feature=player_embedded&v=Y6ylAfGBAr4

bienvenidos a mi segundo post, un día buscando idioteces en Internet me encontré con un articulo muy interesante que proponía la teoría de que los rayos cósmicos causaba el calentamiento global. decía : Científicos del Centro Nacional Espacial de Dinamarca aseguran que nuestras emisiones de dióxido de carbono a la atmósfera tienen un efecto mínimo en la transformación del clima terrestre en comparación con otro factor, mucho más radical pero natural: los rayos cósmicos procedentes de la explosión de estrellas y que llegan a la atmósfera de la Tierra con mayor o menor intensidad dependiendo del campo magnético del Sol, que puede repelerlos a su vez con mayor o menor fuerza antes de que nos alcancen. Mediciones de dos décadas vía satélite han demostrado que existe un vínculo directo entre la intensidad de dicha incidencia de rayos cósmicos y el clima terrestre, que se vuelve más frío o más cálido en función de la cantidad de nubes que se forman. Otras investigaciones recientes refuerzan el descubrimiento danés, que ha suscitado cierta polémica en la comunidad científica. Por Vanessa Marsh. El calentamiento global podría estar ocasionado no sólo por el aumento del dióxido de carbono en la atmósfera, sino también y principalmente por los cambios en la intensidad de los rayos cósmicos que llegan a la Tierra, y que alteran la nubosidad de nuestro planeta, señala un estudio realizado por científicos del Centro Nacional Espacial de Dinamarca. Experimentos desarrollados por este equipo han demostrado que los electrones liberados por los rayos cósmicos ayudan a la formación de los llamados aerosoles (conjunto de partículas suspendidas en un gas) que forman los núcleos de condensación de las nubes. Por otro lado, las tendencias climáticas anómalas que se dan en la Antártica confirman el papel de las nubes en el cambio climático, informa dicho centro danés en un comunicado. Entorno galáctico influyente Se sabe que los rayos cósmicos y la actividad magnética del Sol influyen en las fluctuaciones climáticas en escalas temporales de décadas, siglos o milenios. En intervalos de tiempo aún más largos, las transformaciones del entorno galáctico han llegado a tener consecuencias tan drásticas como la que refleja la teoría geológica “Tierra bola de nieve”, que señala que en un pasado remoto nuestro planeta estuvo totalmente cubierto por hielo, incluidos los océanos. Las investigaciones acerca de los rayos cósmicos y su influencia en el clima llevadas a cabo en el Centro Nacional Espacial de Dinamarca, lideradas por Henrik Svensmark, señalan que el clima está gobernado principalmente por las partículas atómicas procedentes de estrellas que han explosionado. Estos rayos cósmicos ayudan a formar las nubes corrientes. En caso de que haya un nivel más alto de rayos cósmicos, se forman más nubes y el mundo se oscurece, enfriándose. Por el contrario, los intervalos temporales de climatología más suave se originan por la disminución de la cantidad de rayos cósmicos que inciden en la atmósfera, y la consecuente disminución de nubosidad. Formación de nubes Los científicos han explicado su descubrimiento en un artículo titulado Cosmoclimatology: a new theory emerges (cosmoclimatología: emerge una nueva teoría), publicado el mes pasado en la revista Astronomy & Geophysics. En este artículo señalan que las mediciones llevadas a cabo por satélite durante los últimos 20 años han demostrado que la formación de nubes de baja altitud se da poco después de que haya variaciones en los rayos cósmicos. El Centro Nacional Espacial de Dinamarca ha estudiado esta relación a través del experimento SKY, que utilizó muones (partículas subatómicas diminutas cuya carga eléctrica puede ser tanto positiva como negativa) naturales capaces de penetrar hasta la sede de dicho centro. El experimento descubrió que la actividad solar es en la actualidad es la más alta de los últimos mil años, lo que según los científicos daneses explica el calentamiento global por causas naturales y no artificiales. La hipótesis de los investigadores, verificada por el experimento, es que los electrones liberados en el aire por los muones de los rayos cósmicos aceleran significativamente la formación de grupos moleculares de ácido sulfúrico y moléculas de agua, que dan lugar al núcleo de condensación de las nubes. Es en este núcleo donde el vapor de agua se condensa para producir las nubes. Campo magnético solar La intensidad de los rayos cósmicos cambia en función de la variación del campo magnético del Sol, que repele los rayos cósmicos que llegan del resto de la galaxia, antes de que éstos alcancen la Tierra. El carbono 14 radioactivo y otros átomos poco comunes originados en nuestra atmósfera por los rayos cósmicos proporcionan un registro de la intensidad de estos rayos durante los últimos 12.000 años. Si la reacción del Sol ante dichos rayos fue débil y, por tanto, la intensidad de la incidencia de los rayos en nuestro planeta fue alta, en la Tierra se dieron condiciones climáticas frías (por el aumento de las nubes). La más reciente de estas situaciones fue la Pequeña Edad de Hielo, que culminó a mediados del siglo XIX. Alrededor de 1850, el clima del mundo empezó a calentarse de nuevo y puede decirse que la Pequeña Edad de Hielo se acabó en ese momento. Algunos científicos creen que el clima de la Tierra todavía se está recuperando de la Pequeña Edad de Hielo y que esta situación se suma a las preocupaciones del cambio del clima causado por el hombre. Efecto humano, ¿nimio? En escalas de tiempo mucho más largas, la intensidad de los rayos cósmicos varía de forma más radical por la influencia de los cambios en la galaxia. Durante los pasados 500 millones de años, la Tierra ha atravesado cuatro periodos extremadamente calurosos, con escasez de hielo y niveles océanicos elevados, y cuatro episodios extremadamente fríos. Los científicos del centro danés vinculan estos cambios al recorrido del Sol y de nuestro planeta por la Vía Láctea, que presenta diversos niveles de incidencia de rayos cósmicos sobre la Tierra. Por tanto, como concluye Svensmark, resulta evidente que los vientos estelares y el magnetismo son factores cruciales en el origen y la viabilidad de la vida. En comparación con ellos y su capacidad de influenciar en el clima, las emisiones humanas de dióxido de carbono a la atmósfera parecen literalmente insignificantes, señala Svensmark. Polémica científica La tesis expuesta por Svensmark ha generado una cierta polémica en la comunidad científica, que en parte la considera un atentado a otras investigaciones, como la que difundió el pasaso febrero el IPCC, en la que han participado 600 científicos de 40 países. En este informe se dice que con una certeza del 90%, las actividades humanas han provocado el calentamiento global durante los últimos 50 años. The Times, por ejemplo, se hace eco de esta polémica, al tiempo que señala que la ortodoxia debe ser modificada antes estas evidencias. Pero no es una voz solitaria. Nature había anticipado algo de esta polémica el pasado septiembre. Por su lado, Space Science Reviews acaba de publicar otro artículo en el que 14 investigadores señalan a lo largo de 140 páginas la influencia de la astronomía, el Sol y los efectos cósmicos sobre la Tierra y el clima de nuestro planeta. Asimismo, la revista Dendrochronologia señala en otro artículo recién publicado que el polvo interestelar puede desempeñar un papel rector en el cambio climático. Finalmente, la European Organization for Nuclear Research (CERN), con sede en Ginebra, anunció el pasado octubre que el proyecto conocido como CLOUD (Cosmics Leaving OUtdoor Droplets) ha comenzado a reunir datos para determinar la influencia que podrían tener los rayos cósmicos galácticos sobre la formación de las nubes y el clima de la Tierra, según informó en un comunicado. El CERN empleará por primera vez el acelerador de la física de alta energía para estudiar la atmósfera y el clima, si bien, como explíca en este artículo, desde el año 2000 investiga la influencia de los rayos cósmicos para corroborar o rectificar las investigaciones de sus colegas daneses.

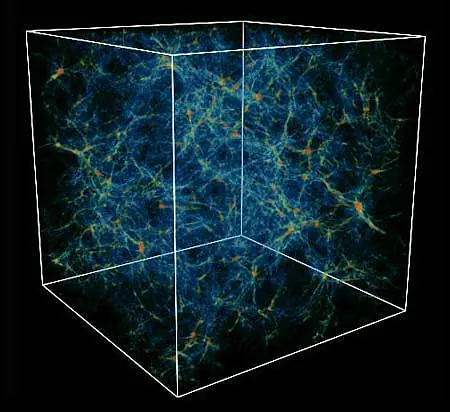

Bienvenidos a mi nuevo post, en este hablare sobre la materia osura. Hay una fuerte evidencia, mediante una gran variedad de observaciones, de la existencia de una gran cantidad de materia oscura en el universo. El término "materia oscura" alude a materia cuya existencia no puede ser detectada mediante procesos asociados a la luz, es decir, no emiten ni absorben radiaciones electromagnéticas, así como no interaccionan con ella de modo que se produzcan efectos secundarios observables; esta materia ha sido inferida solamente a través de sus efectos gravitacionales. Hay también una extensa evidencia circunstancial de que al menos alguna cantidad de esta materia oscura es de naturaleza no bariónica, es decir, compuesta de partículas elementales distintas a los protones, neutrones y electrones (los bariones son todas aquellas partículas compuestas por tres quarks, tales como el protón o el neutrón; el electrón no es un barión sino un leptón, pero por simplicidad siempre que nos referimos a los bariones cuando hablamos sobre materia oscura se sobreentiende que incluimos a los electrones como si de un barión más se tratase). La evidencia más fuerte de materia oscura está en las curvas de rotación de las galaxias espirales. En estas observaciones, la velocidad azimutal de las nubes de hidrógeno rodeando la galaxia es medida (mediante desplazamiento Doppler) en función de la distancia al centro de la galaxia o radio galáctico. Si no hubiese materia oscura, a distancias suficientemente alejadas del centro o bulbo de la galaxia encontraríamos que la velocidad es inversamente proporcional al radio o distancia galáctica. Sin embargo, observaciones de muchas galaxias espirales indican una velocidad que es independiente de la distancia a grandes distancias. En otras palabras, el movimiento de la materia que compone la estructura de una galaxia espiral no verifica las leyes de Kepler. Otras indicaciones de la presencia de materia oscura vienen de observaciones del movimiento de galaxias y gas caliente en cúmulos de galaxias. Ninguna de estas observaciones nos da una indicación directa de la naturaleza de la materia oscura. Si es barionica, las formas que puede tomar están severamente restringidas, ya que la mayoría de las formas permitidas de este tipo de materia oscura emite y absorbe fotones en por lo menos una banda de frecuencia observable. Algunas posibles excepciones incluyen remanentes (de enanas blancas, estrellas de neutrones, agujeros negros) de una temprana generación de estrellas masivas u objetos más pequeños que nunca iniciaron la combustión nuclear (y podrían por lo tanto tener masas menores que aproximadamente la décima parte de la masa solar). Hay también una extensa evidencia circunstancial de que al menos un porcentaje de la materia oscura es de naturaleza no bariónica, es decir, está compuesta por partículas elementales distintas a los electrones, protones o neutrones, y que no interactúan fuertemente con la materia normal. Se supone que podría tratarse de neutrinos u otras partículas mucho más pesadas, denominadas WIMPs (Weakly Interacting Massive Particles, o partículas masivas de interacción débil) que han sobrevivido desde el Big Bang, y por lo tanto, son extremadamente estables o bien tienen tiempos de vida que exceden la edad actual del Universo. Los candidatos a dar cuenta de la materia oscura no bariónica son varios: neutrilinos, axiones, monopolos, cuerdas cósmicas, racimos de quarks, y una larga lista de posibilidades exóticas. Sin embargo, a excepción de los neutrinos, muchas de tales partículas elementales existen solamente en el campo teórico, ya que hasta el momento su existencia no ha sido detectada. Además, por tratarse de materia no convencional, que no absorbe ni emite radiación electromagnética (luz, ondas de radio, etc.), su detección parece fuera de nuestro alcance por el momento. Materia oscura y Universo Cualquiera que sea la naturaleza de la materia oscura, ésta es sin duda la fuente principal de las fuerzas gravitacionales en el Universo, y por ello resulta al menos parcialmente responsable de la formación de todas sus estructuras. Puesto que la totalidad de la materia visible resulta sólo una pequeña fracción de la masa total del Universo, conocer con cierta exactitud la cantidad de materia oscura existente nos ayudará a determinar el futuro evolutivo del mismo. (Los cosmólogos se refieren a la masa total del Universo en términos de un parámetro denominado Omega.) Si no hay suficiente materia oscura como para ligar gravitacionalmente al Universo (es decir, si el valor de Omega resulta menor que 1), este podría continuar expandiéndose infinitamente. En cambio, si existiera la suficiente masa (es decir, si el valor de Omega resulta mayor que 1), el Universo podría finalmente frenar su expansión, detenerla y comenzar a contraerse, para eventualmente colapsar. Un universo infinitamente en expansión, implicaría un valor de Omega igual a 1. Gracias a importantes avances tecnológicos, tanto en los instrumentos astronómicos disponibles como en la potencia de las computadoras dedicadas a la investigación astrofísica, la coincidencia de los resultados observacionales con las investigaciones teóricas se ha vuelto no sólo posible, sino crucial para el progreso en la resolución del misterio de la materia oscura, una de las claves para descubrir el origen, la evolución y el destino de nuestro Universo. El nombre que se le da a este tipo de materia proviene del hecho de que se trata de una materia no detectable en ninguna banda del espectro electromagnético: ni en la banda gamma ni en la radio, pasando por todas las zonas intermedias, incluyendo la banda del visible (incurrimos en un abuso del lenguaje cuando sustituimos no detectable por 'no visible', aunque sobreentedemos, sin embargo, a qué nos referimos). La materia oscura, aunque no se 'vea' (esto es, se detecte electromagnéticamente), es abundante: se calcula que aproximadamente el 90% de la materia total del Universo es materia oscura (sólo el 10% residual es materia detectable por su radiación electromagnética). Las Galaxias por ejemplo, estarían incluidas dentro de este 10%, e irían simplemente 'viajando' en un fluido 'oscuro'. La materia oscura puede agruparse gravitatoriamente en grumos gigantescos del tamaño de Galaxias e incluso del tamaño de Cúmulos de Galaxias. Se presume que la materia oscura jugó un papel muy importante en la formación de las galaxias (podemos decir que se trataría de materia oscura galáctica) y se sabe también que está extendida además por todo el Universo (podemos decir que se trataría de materia oscura no acumulada).

La sensación de déjà vu desde el principio de la entretenidísima cinta sci-fi Al filo del mañana, es apabullante. Casi desde el primer segundo, no dejo de preguntarme por qué me resulta tan familiar la secuencia que constituye el núcleo de la historia, a saber: el (anti) héroe se despierta la víspera del día D en un campamento militar, pasa la noche en capilla antes de la batalla, es arrojado (literalmente) a una Omaha todavía más sangrienta que la original, en la que los aliados pierden la batalla, la chica muere a los treinta segundos de aparecer y él no dura ni cinco minutos bajo el fuego enemigo… Un final entre trágico y predecible, más trivial que triste. Lo cierto es que el no-héroe es cobarde, inexperto y nunca tiene oportunidad alguna. Rebobinamos. Un instante después de su muerte, el héroe se despierta exactamente en las mismas circunstancias de la víspera. Sabe lo que le aguarda y trata de arreglar el desaguisado, pero todo es en vano. Como a la pobre Casandra, nadie le hace caso cuando intenta avisar a los mandos de la escabechina que les espera. Acaba de nuevo en la sangrienta playa, intenta salvar a la chica de su destino y lo único que consigue es llevarse un balazo en el pecho. Rebobinamos. La tercera vez, el héroe lo hace un poco mejor, aunque tampoco llega muy lejos. Ni la cuarta, ni la quinta, ni la sexta… pero el bucle sigue y sigue y al cabo de los mil intentos, el tipo cobarde e inexperto del principio de la historia se ha transformado en un superhombre, capaz de realizar auténticas proezas, cuya técnica ha adquirido a base de palmarla cada vez que se equivoca y verse condenado, como Sísifo a empujar su piedra, montaña arriba, una y otra vez. Déjà vu, déjà vu. Hasta que de repente se cae en cuenta. Recuerda las horas muertas frente a los videojuegos, la forma en que uno aprendía los trucos para pasar de nivel, tres pasos a la izquierda, dos a la derecha, agáchate para evitar la bomba, voltereta lateral para esquivar la ráfaga que nos disparan al final del pasillo, apuñala al enemigo que te ataca por la espalda (no vale la pena girarse a mirar, ataca siempre en el mismo sitio, justo al final de la cuarta escalera del segundo salón) párate y cuenta tres antes de salir del refugio si no quieres que te sorprenda Terminator… uno aprendía los trucos a base de paciencia y repetición. La clave del superhombre no era poder especial alguno, sino, precisamente, la maldición de Sísifo. Si en lugar de una sola vida contáramos con millones de ellas, si recordáramos todos y cada uno de nuestros errores, podríamos tratar de corregirlos en el siguiente intento. ¿O no? De hecho, esa es la clave de la historia, más allá de la estupenda aventura y los magníficos efectos especiales. ¿Y si uno pudiera repetir? ¿Dónde se escondería César aquella mañana de marzo? ¿Se darían cita todavía Francesca de Rímini Y Paolo Malatesta, demasiado enfermos de amor para remediar su desdicha? ¿Qué haría Héctor si tuviera que enfrentarse otra vez a Aquiles? ¿Se acobardaría tras los muros de Troya, sabiendo que el Pélida va a vencerlo, o por el contrario se atrevería de nuevo a plantarle cara? Y después de morir mil veces frente a la muralla… ¿No habría aprendido lo bastante como para derrotarle? Pero volviendo Al filo del mañana, la razón por la que el héroe regresa al mismo punto cada vez que muere es la existencia de un bucle temporal, cortesía de los aliens. La física de cómo se crea el bucle y la motivación de los malvados pulpos invasores para crearlo es bastante discutible, pero démoslo por hecho y entretengámonos un instante con la paradoja. Para empezar, el bucle temporal está mejor construido que en otras versiones de la misma idea, ya que está muy bien definido cuándo se cierra (cuando muere el héroe). Así, en cada versión de la historia suceden cosas ligeramente diferentes y a medida que nuestro Sísifo se va volviendo más hábil, inteligente y valeroso, la extensión de su aventura aumenta y se van añadiendo novedades. Si lo pensamos bien, estamos asistiendo a un universo en el que el tiempo también avanza, pero en el que cada instante se ramifica en infinitas posibilidades que el condenado recorre una y otra vez. Instante uno, se lanza a la playa (cae mal). Instante uno (versión dos), se lanza a la playa, cae bien. Instante dos (versión uno), una bala perdida mata a su amigo. Versión dos, salva al amigo pero el intento le cuesta la piel. Versión tres salva al amigo, pero los matan a ambos un segundo más tarde. Versión cuatro, deja morir al otro y sigue adelante. Instante tres, corre hacia la trinchera (aquí se suceden otras mil versiones, cada una de las cuales se ramifica en otras mil). Encuentra a la chica, se asocian, intentan salvar a la humanidad y en la aventura la ve morir miles, millones de veces. Al final la ama con una pasión que supera en mucho a la de Orfeo, a fin de cuentas ha perdido a su Eurídice muchas más veces y en todas ellas ha querido rescatarla en vano del Hades. Todas las posibilidades se dan en cada segundo, casi todas trágicas. Y siempre, cuando llega el inevitable final, rebobinamos. El videojuego empieza de nuevo. Hace un siglo, los padres de la mecánica cuántica se devanaban los sesos tratando de entender la más profunda de las paradojas de la nueva física. En su versión más popular, esa paradoja se concreta en el destino del gato de Schrödinger. Un desafortunado felino es encerrado en una caja, en cuyo interior, un elemento radioactivo, al desintegrarse, dispara un veneno capaz de matarle. Abandonamos al animal a su suerte y, en la habitación contigua, especulamos sobre su destino. En el siguiente minuto, digamos, existe una probabilidad entre tres, de que se dé esa desintegración. Si se produce, el gato muere. En otro caso, el gato vive. Pero la probabilidad del 30 %, que tiene un sentido fácil de explicar si realizamos el experimento cien veces (en ese caso treinta de los mininos acabarían patitiesos) es más difícil de interpretar cuando se trata de un solo experimento. La función de onda cuántica que describe el estado del elemento radioactivo no se «colapsa» en una estado concreto hasta que se realiza la medida. De ahí que, según la interpretación canónica de la mecánica cuántica, mientras dura el experimento, el gato se encuentra en un curioso «estado mezcla» 30 % muerto y 70 % vivo. Ese estado mezcla solo se resuelve, en oros o bastos, cuando abrimos la caja. Esa es la llamada interpretación de Copenhague, que por cierto, nunca me entusiasmó. Mucho más atractiva es la hipótesis de Everett, también llamada teoría de los muchos mundos, según la cual, cada posible estado de la función de onda da pie a un universo diferente. Así, cada instante temporal se ramifica en infinitos cosmos. En uno de ellos no es Cristo, sino Judas quien muere en la cruz. En otro los troyanos escuchan a Casandra y queman el caballo de la infamia con todos los aqueos dentro. En un tercero Hitler gana la gran guerra y en otro Ettore Majorana no salta de su barco, aquella noche, camino de Palermo. Pero en otros, la Tierra no está habitada por hombres, sino por ángeles, o centauros. O no existe la Tierra. En millones de universos el sol explota antes de que el sistema solar pueda formarse. En otros nunca se encienden las estrellas. Las combinaciones son inagotables y las tragedias innumerables. Casi ninguna historia, se sabe, termina bien. Everett, entonces, nos proporciona un hilo director mucho más rico para entender nuestra historia. El héroe recorre, trabajosamente, cada uno de los posibles mundos en los que se ramifica la función de onda a cada instante. Y en cada paso sufre y muere. La siguiente vez llega algo más lejos, sufre aún más, muere de nuevo. Pero al final del camino, es más valiente, más sabio, más humano. Sísifo es un héroe clásico y los griegos no se podían quitar el destino de encima. Nunca dejó de empujar la piedra y de verla rodar, impotente, montaña abajo. En cambio, el protagonista de Al filo del mañana, es un héroe moderno, que no se limita a sudar y sufrir, intenta cambiar las cosas una y otra vez. Si los aliens ostentan el poder de los dioses, entonces, sostiene, los dioses tienen que morir para que seamos libres. No contaré si lo consigue o no, so pena de ser acusado de spoiler, pero sí diré que, vencedor o vencido, este héroe moderno que se revela contra la tiranía de Omega goza de todas mis simpatías. Tiene a su favor, cierto, el recuerdo de los errores pasados, pero quizás, dentro de lo que cabe, todos nos hemos equivocado y a todos, alguna vez se nos ha dado la oportunidad de empezar de nuevo. La lección aquí está clara. Hay un universo posible mejor que este y puede construirse entre todos. Quizás la historia de la conciencia es similar a la que nos cuenta esta estupenda película, con una ligera diferencia. Imaginen que cada uno de nosotros somos héroes en nuestra particular Odisea. En cada instante suceden cosas que pueden matarnos y cuando eso ocurre el bucle temporal se cierra y regresamos al instante de nuestro nacimiento. En una vida, nuestro primer amor nos traiciona y nuestro yo adolescente muere de un exceso de anfetaminas. En la siguiente lo superamos, apretando los dientes y estudiando para el examen de Álgebra, pero nos atropella un coche camino de la facultad. Un millón de vidas más tarde se cae el avión en que viajamos camino de una conferencia, cien millones de vidas después se nos lleva por delante un tumor a deshora… pero quizás, a medida que el bucle gira y gira, encontramos a la mujer o el hombre de nuestra vida, alguien descubre un antídoto para la vejez y una cura contra el cáncer y seguimos adelante, viviendo y olvidando, olvidando y viviendo. Quiero creer que cada uno de esos intentos nos hace mejores. Quizás, en algún momento, alcanzamos la perfección. Y con ella llega el nirvana y la memoria total, el recuerdo de todas las vidas, la punzada última que nos traspasa el corazón evocando cada uno de nuestros amores, y las infinitas versiones de nuestros padres y nuestros hijos, nuestros triunfos y fracasos, nuestros cielos e infiernos. Todo explota en una sola chispa de luz con la que se nos concede la redención última, la última absolución. Después, por fin, el olvido.

número atómico o de protones del ununseptio es 117. Hace cuatro años el científico ruso Yuri Oganessian del Joint Institute for Nuclear Research de Dubna, en su país, junto a colaboradores del Oak Ridge National Laboratory de EE UU, descubrieron el elemento 117 de la tabla periódica. Lo crearon al hacer colisionar isótopos de calcio-48 (tiene 20 protones y 28 neutrones) contra otros de berkelio-249 (con 97 protones y 152 neutrones). De esta forma se generó el nuevo elemento con 117 protones, lo que marca su posición en la tabla y su nombre provisional: ununseptio. Sin embargo, según las normas de la Unión Internacional de Química Pura y Aplicada (IUPAC) el reconocimiento oficial requiere que al menos otro laboratorio independiente pueda repetir el experimento, algo extremadamente difícil cuando se trabaja con elementos tan inestables y pesados como este, un 40 % más que el plomo. Pero un equipo internacional lo ha conseguido lanzando un haz de núcleos de calcio-48 por el acelerador lineal del centro GSI, en Alemania, contra un objetivo de berkelio-249 radiactivo suministrado también por el Oak Ridge National Laboratory. El resultado han sido varios átomos de ununseptio, según publican en la revista Physics Review Letters. Durante el complicado proceso se ha generado, además, un nuevo isótopo, el laurencio-266 (266Lr), descubierto a partir de una forma desconocida hasta ahora de desintegración o decaimiento alfa (donde un núcleo atómico pierde partículas alfa) del isótopo dubnio-270. Según los científicos, el experimento en su conjunto ha supuesto toda una proeza en la investigación de elementos superpesados, ya que ha requerido generar una minuciosa cadena de decaimiento alfa en siete pasos –con tiempos de desintegración muy cortos y diferentes–, seguidos por la fisión espontánea del recién descubierto 266Lr. El ununseptio es el segundo elemento más pesado de los sintetizados hasta ahora en el laboratorio, tras el ununoctio (con 118 protones y situado en esa posición de la tabla periódica). Todos los elementos con número atómico superior a 82 (plomo) son inestables. La vida media de los más superpesados dura escasos milisegundos, pero aun así, los científicos piensan que ‘sobreviven’ unos instantes gracias a ‘islas de estabilidad’ temporales entre los protones y neutrones.

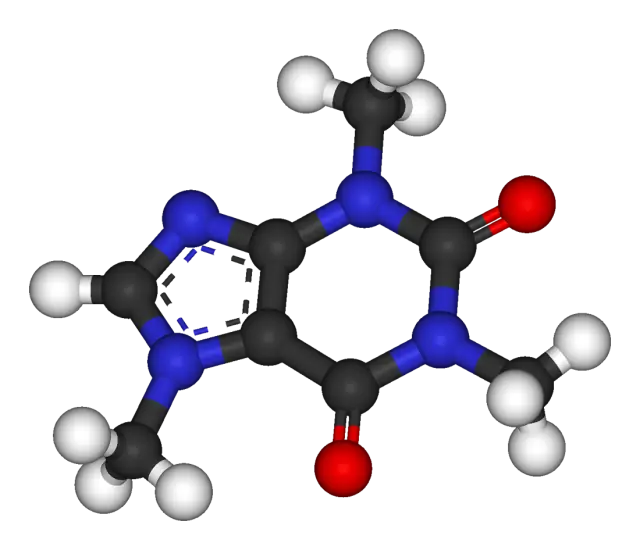

No pocas veces nos hemos podido encontrar con afirmaciones como las que exhibe la imagen que encabeza este post. Cada cierto tiempo, la red se ve inundada por noticias o anuncios que prometen que ha sido hallada una cura para la diabetes en Stevia rebaudiana, un tratamiento para el cáncer basado en oler limones o un remedio contra el ébola en alguna exótica planta de la familia de las Clusiáceas. Una gran parte de las veces se escudan en afirmaciones como que la medicina moderna tiene su origen en las plantas, o que a la malvada mafia de la industria farmacéutica no le interesa que tal o cual remedio salga al mercado. Incluso en ocasiones, como el del sonado caso de cierta presentadora de un programa matinal de la televisión pública española, sustenta sus aserciones en un supuesto estudio científico que dice que así son las cosas. Pero parece que, en realidad, las cosas no son tan sencillas. Empecemos por el principio. El principio activo. El principio activo es una molécula que interactúa con ciertos receptores moleculares del organismo y genera una respuesta farmacológica activa. En otras palabras, el principio activo es esa molécula que hay en todo medicamento, y que de algún modo, previene, alivia los síntomas o cura una enfermedad. Es cierto que muchos principios activos se extraen de plantas. Sin ir más lejos, algo tan sencillo como el café contiene un principio activo conocido por todos, denominado “cafeína”, que produce efectos farmacológicos también muy bien conocidos. El problema viene cuando intentamos determinar la cantidad de principios activos que hay en una planta. En el caso del café, ya preparado, hay una enorme cantidad de variables que pueden modificar la concentración final de cafeína que haya en esa taza. (http://blogs.20minutos.es/el-nutricionista-de-la-general/2015/01/20/concretar-la-cantidad-de-cafeina-en-el-cafe-tan-facil-como-acertar-en-el-trile/) Los más obvios no cabe duda de que son el método de preparación del café y el tipo de café empleado. Sin embargo, hay muchas otras variables que pueden influir en esa concentración final. Los principios activos no dejan de ser moléculas del metabolismo secundario de la planta, que tienen sus propias funciones para el organismo, muy habitualmente defensivas. Tanto el momento de desarrollo en que haya sido recolectado el café, como cosas tan incontrolables como la cantidad de agua que haya habido disponible para el cafeto, la cantidad de organismos que hayan atacado a la planta o incluso si cuando lo recolectaron hacía o no sol pueden influir en mayor o menor medida en la concentración final de cafeína que haya en esa tacita de café. En el caso del ejemplo, siendo un café de 50 ml de la variedad arábica hecho en una cafetería tiene aproximadamente unos 35 mg de cafeína. Pero como ya hemos dicho, es un valor muy variable. La dosis mínima efectiva de un principio activo se define como la más baja administrada que puede producir un efecto farmacológico medible en una persona, y se mide en función del peso corporal y del efecto que se está estudiando. Siendo la dosis mínima efectiva de la cafeína para producir efecto excitante para una persona de 60 kg, unos 8,5 mg de cafeína, podríamos decir que si tomásemos ese café ideal promedio, una dosis inferior a 12 ml de café no produciría efecto farmacológico alguno. Otra cosa que debemos tener en cuenta es que todo producto químico, incluso aunque sea de origen natural, puede causar problemas de toxicidad e incluso la muerte, según la dosis a la que se administre. Con el café es difícil llegar al extremo del fallecimiento, sin embargo hay muchas plantas que son realmente peligrosas. La dosis letal—50, que se define como aquella que mata a la mitad de las personas que lo consuman, para el taxol, que es uno de los principios activos del tejo, es de tan solo 2,3 gramos para una persona de 60 kg. (http://onlinelibrary.wiley.com/doi/10.1111/j.2042-7158.2012.01471.x/abstract) Pero además, y volviendo con el ejemplo del café, la cafeína no es lo único que lleva. Si el lector ha tomado alguna vez un café hecho con agua demasiado caliente habrá notado que al sabor habitual se le suma una sensación de aspereza que permanece en la lengua. Esa misma sensación que deja un plátano o un caqui que está demasiado verde, la piel de las uvas tintas, o un té negro cuya bolsita se ha quedado demasiado tiempo en el agua. Las moléculas responsables de ese efecto son otro tipo de principios activos llamados taninos, que son altamente astringentes y además tienen la peculiar manía de hacer que las proteínas precipiten. Esto puede tener sus aplicaciones en un momento dado, pero también pueden suponer un problema si lo que deseas es perseguir un efecto dado y evitar posibles daños colaterales. Si deseas tener ese efecto excitante del café, los taninos no son de ayuda: las moléculas que hacen que la cafeína se adsorba (https://es.wikipedia.org/wiki/Adsorci%C3%B3n) son precisamente proteínas, las mismas que si se ven atacadas por los taninos, quedan inutilizadas. Un café con muchos taninos produce, por lo tanto, un efecto menor en cuanto a excitación se refiere. En una droga determinada, la cantidad de principios activos presentes puede ser realmente impresionante, y cada una de esas moléculas actúa de un modo distinto. Como hemos visto, un principio activo puede reducir los efectos de otro, pero puede haber otros que lo potencien, que lo modulen, que lo inhiban, que lo modifiquen, etcétera. Este tipo de interacciones se pueden eliminar muy bien de un modo: extrayendo el principio activo y aplicándolo aislado. De este modo, el resto de posibles moléculas que estaban ahí, nos dejan de fastidiar el efecto. Y la extracción y aislamiento de ese principio activo nos da otra ventaja importante: ahora podemos cuantificar con precisión cuál es la cantidad de principio activo que tenemos, y por tanto dosificarlo adecuadamente en función del efecto deseado y el peso del paciente. Así se produce un medicamento a partir de una planta. Así se produjo hace más de cien años la aspirina a partir de un principio activo extraído de la corteza del sauce blanco. ¿Y qué tiene que ver todo esto con que si la guanábana es cien veces más efectiva que la quimioterapia, con que si oler limones prevenga el cáncer o con que si comer hojas de Kalanchoelo cure? Fácil. Que en el mundo real, las cosas no son tan sencillas. En primer lugar, para que una planta como Kalanchoe daigremontiana cure determinados tipos de cáncer, tiene que tener principios activos que sean eficaces contra esos tumores. Algo que no se ha encontrado hasta el momento. Sin embargo sí que es cierto que se han encontrado unos principios activos, llamados bufadienólidos, que in vitro sí que parecen ser, y cito textualmente, potenciales agentes quimiopreventivos del cáncer. Claro que tan solo hay un artículo científico en el que soportar esa afirmación (http://www.ncbi.nlm.nih.gov/pubmed/11388478). Suponiendo que eso sea cierto, aún queda mucho para poder afirmar que esta planta sea un remedio eficaz. En primer lugar, el principio activo tiene que ser adecuadamente ensayado in vivo, primero en animales no humanos y, si supera los controles necesarios, después en personas. Un resultado in vitro no significa que automáticamente vaya a ser eficaz en un enfermo real. Pero el siguiente problema viene dado por lo que he estado explicando sobre el café. Incluso aunque descubriéramos que esos principios activos, esos bufadienólidos, sean eficaces in vivo, y conozcamos cuál es su dosis mínima efectiva y su dosificación óptima, y que su relación entre el riesgo de medicarse y el beneficio aportado sea aceptable, no hay manera conocida de saber qué cantidad de principios activos hay en una planta viva, y tampoco sabemos si existen otras moléculas que estén entorpeciendo o aportando unos efectos indeseados. El proceso correcto para desarrollar un producto que realmente sea eficaz sería hallar una ruta metabólica que permita producir el principio de forma sintética —porque no importa que el origen sea natural o artificial, el principio activo es el mismo y su efectividad también lo es—, y si eso no es posible, que a veces pasa, el método a seguir es cultivar la planta en condiciones lo más controladas posible, y realizar una adecuada extracción, aislamiento, cuantificación y dosificación del principio activo. Y lo que la malvada mafia de la industria farmacéutica querrá no será sino ser la primera en hacer precisamente eso. Si se descubriera que una planta como Kalanchoe daigremontiana cura el cáncer, cualquier cáncer, todos los tipos de cáncer de forma eficaz, o que en el limón o en la guanábana hay un principio activo que representa una solución miles de veces más eficaz que la quimioterapia, y suponemos que con menos efectos secundarios, a las empresas farmacéuticas se les saldrían los ojos de las órbitas y entrarían en una trepidante carrera por descubrir los entresijos de la síntesis o extracción del principio activo, su cuantificación y su óptima dosificación. La primera empresa farmacéutica que consiga llegar a la meta tendrá el privilegio de explotación del medicamento. Podría patentar el nuevo medicamento y los protocolos de su producción, y lo podría vender al precio que le saliera de sus enriquecidos epidídimos. Su eficacia sería, sin duda, superior al de la planta en bruto, porque en todo momento se conocería la cantidad exacta de fármaco que se está metiendo al cuerpo del enfermo y se podría mantener bajo el estricto control médico, algo que es imposible de realizar en una planta cuya concentración de principios activos es muy variable, dependiente de una enorme cantidad de factores ambientales y además en la que las interacciones mucho mayores. Además la gente va a seguir teniendo cáncer, eso no va a cambiar, así que se seguiría vendiendo ese fármaco; la empresa farmacéutica que se hiciera con ese descubrimiento podría forrar su sede central con billetes morados sin despeinarse, y el equipo de investigación encargado ya podría ir buscando sus mejores galas, pues tendría una cita con el Nobel ese mismo año. Así pues, cada vez que alguien diga que tal planta es beneficiosa para cual enfermedad, tenemos que pensar en muchas cosas: cuál es el principio activo que hace que eso sea así, qué otras moléculas también presentes pueden modular el efecto, hasta qué punto su efectividad está comprobada por vía experimental, cuál es la concentración media de principio activo en la planta y cuál es su posible variabilidad en función de las condiciones ambientales, cuál es la dosificación idónea para conseguir el mejor efecto al menor riesgo, cuál es el método idóneo de obtención y cuantificación del principio activo, etcétera. Si nos paramos a pensar, hay una serie de datos que nos dan una pista bastante fiable para saber si estamos ante algo real o ante una afirmación pseudocientífica cuando nos hablan de plantas medicinales. Por supuesto son simples directrices y aunque algo parezca fiable, siempre conviene comprobar la bibliografía científica y las revisiones, pero como un primer filtro puede servir. 1. Si nos hablan de “un principio activo presente en” una planta, es mucho más fiable que si nos hablan directamente de la planta. 2.Si nos plantean que “puede ser un remedio para” lo que sea, es mucho más fiable que si nos afirman con rotundidad que “es un remedio”. 3.Si nos aportan estudios clínicos u otros tipos de artículos científicos es, siempre, mucho más fiable que si no lo hacen. 4.Si nos especifican el nivel de experimentación en que se encuentran (in vitro, ensayos en animales o en humanos) es mucho más fiable que si no lo hacen, o incluso que si camuflan lo que en realidad es un resultado in vitro y provisional y lo hacen pasar como una aplicación definitiva para humanos. Las plantas han sido desde los tiempos del hombre de Ötzi una fuente de remedios a una enorme cantidad de dolencias. La ciencia ha descubierto el origen de los beneficios de esas plantas y muchas de ellas han sido las precursoras de una enorme cantidad de fármacos modernos altamente eficaces. Existen muchísimos organismos vegetales aún desconocidos, lo que significa que probablemente haya muchas moléculas útiles en esas plantas que aún no hemos encontrado. exhibir la clara diferencia entre la farmacognosia científica y la charlatanería de herbolario es algo muy importante Considero que exhibir la clara diferencia entre la farmacognosia científica y la charlatanería de herbolario es algo muy importante por dos frentes. El primero, para evitar que la población sea engañada por desalmados que solo pretenden vender sus kalanchoes a personas que necesitan ayuda médica. El segundo es evitar que, ante resultados reales, las voces críticas se “pasen de frenada” y que la investigación en una molécula potencialmente beneficiosa quede descartada a causa de la mala fama que aquellos desalmados hayan podido esparcir.