saradomin

Usuario

Aparentemente las webcam incluidas dentro de las computadoras HP son racistas. Así lo comprobaron dos compañeros de trabajo que pusieron a prueba la tecnología de seguimiento de rostros incluida en la HP MediaSmart, demostrando que la cámara no sigue a personas negras. Claro que no podían dejar de compartir el descubrimiento con el resto del mundo, por lo que decidieron grabar un video que realmente lo demuestre. De esa manera vemos como al principio del mismo aparece Desi, un hombre de color al que la cámara no parece hacerle ningún caso mientras charla con nosotros, hasta que aparece Wanda, una mujer blanca a la que la cámara parece amar y seguir a donde sea. Para que no queden dudas, Desi vuelve a aparecer en escena y efectivamente la cámara deja de realizar cualquier tipo de movimiento al verlo. La idea de Desi y Wanda al postear este video es que justamente Hewlett Packard note el problema y lo solucione, aunque particularmente creo que puede solucionarse iluminando un poco más la cara de Des. De igual manera es bastante probable que los que desarrollaron esta tecnología sean blancos, de lo contrario no hubiese tenido ese problema. Graba tus videos en con la Zx1 link: http://www.videos-star.com/watch.php?video=t4DT3tQqgRM Fuente: http://www.dotpod.com.ar/2009/12/24/las-webcam-hp-son-racistas/

El “Burj Dubai” ya es el rascacielos más alto del mundo, aunque su construcción no ha finalizado. Este edificio originalmente se iba a situar en Australia con el nombre de “Grollo tower”, e iba a ser un prisma con la punta iluminada, de acuerdo al diseño del arquitecto americano Adrian Smith. El modelo fue trasladado a la ciudad de Dubai en los Emiratos Árabes, se modifico el diseño basándolo en los arcos árabes y la forma de una flor que se cultivaba en los Emiratos y la India llamada “Hymenocallis genu´s spidery”, se prevé que la torre mida aproximadamente 818 metros de altura y tenga 189 pisos, aunque existen rumores de que pueda pasar los 900 metros. Su construcción se comenzó en Febrero de 2005 y piensa terminarse para 2009. Recordemos que Dubai es una gran potencia petrolera pero el oro negro esta escaseando por lo que el gobierno esta invirtiendo una cantidad de recursos para que su nuevo eje económico sea el turismo. Por eso la construcción de este hotel, de las islas en forma de vela y en forma de mapamundi, al igual que muchas atracciones más. Este es parte de un complejo llamado “Burj Dubai Downtown”, el cual incluye el centro comercial más grande del planeta, un lago artificial de 12 hectáreas, un hotel y 19 torres residenciales. El rascacielos albergará en sus primeros 37 pisos un hotel, del 45 al 108 serán 700 departamentos de lujo, del 109 al 122 oficinas, el 123 un mirador y el 124 un observatorio. Este rascacielos aunque aún no esta finalizado, pero ya ha roto varias marcas como: * El edificio más alto del mundo, la cual la tenía el “Taipei 101” de 448 metros de altura; * Edificio más alto con antenas, anteriormente el record lo tenía la torre Sears con 527 metros; * Estructura más alta sostenida sin cables, la cual la tenía la torre CN de 553 metros; * Estructura más alta actual, marca establecida por la antena KVLY-TV, 628 metros; * Estructura más alta construida por el hombre, marca establecida por la torre de radio de Varsovia, 646 metros. Entre los datos curiosos de este rascacielos están sus elevadores los cuales viajaran a una velocidad aproximada de 65 km/h, probablemente use alrededor de 36,000 KW de electricidad, 946,000 litros de agua diariamente y la luz de su antena podrá ser vista hasta 95 kilómetros de distancia. http://www.burjdubai.com/ http://www.fersamex.com.mx/ciencia/2007/noviembre15_07.htm

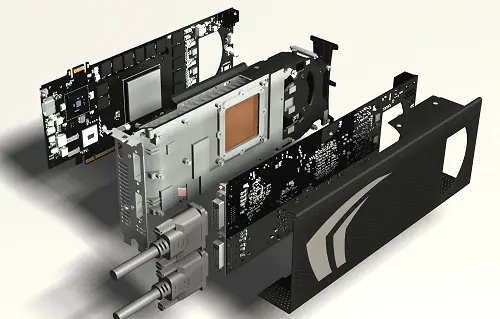

Registrate y eliminá la publicidad! Nvidia presenta una nueva grafica de alto rendimiento basada en una solución de doble chip GTX 200. Una combinación que permitirá a Nvidia competir más adecuadamente con el 4870X2 de ATI. Introducción. Las tarjetas graficas duales tienen sus pros y sus contras. Por un lado en el espacio que ocupa una grafica conseguimos el rendimiento de dos y por otro lado dependemos precisamente de esas tecnologías de agrupación de rendimiento que están lejos de ser 100% efectivas. La ventaja es que la guerra actual ha alejado a estas tarjetas de esas soluciones "hipercaras" que solo unos cuantos podían permitirse. Ahora podemos encontrar competencia también en los “monstruos de dos cabezas”. Nvidia GTX 295. Esta nueva tarjeta de Nvidia ha tenido que esperar a la reducción del proceso de fabricación para poder colocar dos chips GTX 200 en la misma solución compartiendo el mismo sistema de refrigeración. Está basada en las soluciones habituales de Nvidia, heredadas de su experiencia en soluciones térmicas para SLI en portátiles, donde dos PCBs forman el “pan de un Sandwich” donde el disipador es el “jamón y el queso”. La comunicación entre ambas se realiza por un chip SLI dedicado por lo que no es necesaria una placa compatible con SLI para que funcione correctamente. Los chips utilizados están a camino entre un GTX 260 y un GTX 280. Por un lado tenemos las 240 unidades o Streamprocessors de un GTX 280 pero por otro tenemos el bus de memoria de una GTX 260 con un bus de 448-Bit, frente a los 512-Bit de una GTX 280 o 285, y 896MB de memoria por chip grafico. Esto hace de la GTX 295 una solución hibrida con el potencial de shaders de una GTX 280 pero con el bus de memoria recortado de una GTX 260. Toda esta combinación de prestaciones hace de la GTX 295 una tarjeta realmente especial y espectacular en sus números. Dispone de 480 unidades de shaders que trabajan a una frecuencia de 1242MHz. Sus GPUs trabajan a una frecuencia de 576MHz y sus 1792MB de memoria se reparten en dos buses de 448-Bit y trabajan a una frecuencia de 2GHz, son del tipo GDDR3. En todos los modelos de referencia de la GTX 295 encontraremos dos salidas de video DVI combinadas con una salida HDMI que en esta hace de “canalización” SPDIF sin proceso interno pero manteniendo las propiedades digitales del sonido hasta ser procesados por el decodificador pertinente. ATI si que dispone de DSP en sus tarjetas gráficas por lo que si es capaz de procesar el sonido. Nvidia GTX 295 de Zotac. Aspecto, tamaño y calor. La tarjeta que hemos tenido la oportunidad de probar para realizar esta “review” es una Zotac ZT-295E3MA-FSP. Un modelo de referencia al que Zotac añade un buen conjunto de conectores, incluido cable HDMI, y un juego bastante actual como es GRID. Dispone además de un precio muy competitivo. Estas tarjetas nuevas de Nvidia son, en mi opinión, más manejables que la 4870X2 aunque son prácticamente igual de grandes, de hecho por volumen la GTX 295 será algo más grande. La diferencia es que la carcasa donde esta “embutida” la tarjeta la hace muy compacta y cómoda de instalar y colocar. Ofrece también unos acabados notables en cuanto a estética. Otra de las ventajas del modelo de referencia es que nos indicara con un led cuando tenemos eléctricamente bien alimentada la tarjeta. Este modelo, salvo excepciones de placas muy concretas, requiere de dos cables de alimentación PCI Express, uno de 8 contactos y otro de 6 contactos. Hay que tener en cuenta que su consumo en carga ronda los 300W. Otra de las opciones que nos ofrece esta tarjeta es la de montar un SLI con otra hermana para lograr un total de cuatro GPUs en el mismo sistema. Necesitaremos una fuente capacitada y una placa base compatible ya sea con chipset Nvidia o con alguna placa X58 de Intel que este certificada por Nvidia. Otra de las ventajas de este nuevo modelo y los últimos drivers de Nvidia, es que podemos tener hasta tres monitores conectados de forma simultánea aunque el SLI solo estará activado en uno de ellos. Hemos medido de diferentes modos la temperatura de trabajo de estos chips y los resultados son bastante interesantes. La tarjeta en si es más fresca de lo que esperábamos y no es ruidosa, al menos no trabajando, su temperatura exterior ronda los 50-55 grados en todo momento y las de trabajo también se ajustan bastante a esta temperatura mediante la regulación progresiva de la turbina de ventilación. Sus diodos internos marcan una temperatura de 72-75 grados cuando sometemos a carga el motor grafico. Las temperaturas no son uniformes, como es lógico, ya que una de las tarjetas, la principal, siempre tendrá más carga que la secundaria. Nvidia “Graphics Plus”. CUDA, PhysX y 3D. Nvidia ha sacado del olvido su sistema de drivers estereoscópicos, que datan por los tiempos del Geforce 2 y 3, para añadir otro valor añadido a sus motores gráficos. Personalmente no me veo volviendo a esos tiempos de dolores de cabeza y problemas de drivers y parches de juegos así que me quedo con lo realmente interesante de lo que Nvidia llama “Graphics Plus”. Esto es por un lado el sistema CUDA de proceso general en streamprocessors. Este tipo de programación de computo general usando los potentes motores de shaders de las tarjetas graficas ya empieza a dar sus frutos. Sobretodo en aplicaciones graficas y multimedia y como no, en el sistema PhysX de Nvidia que se basa en este mismo sistema de programación. Aun así sobre PhysX todavía espero mucho más de lo que Nvidia por el momento nos ha proporcionado. El gran “Mirrors Edge”, ultimo hito en el mundo PhysX, no ofrece elementos de jugabilidad que se espera de él. Todavía seguimos con pequeños juegos estéticos, como romper cristales en pedacitos o romper banderolas (sin duda esto es jugabilidad pura y dura) que no aportan nada nuevo al juego. Esperemos que dentro de poco la física aplicada al juego sea algo estándar, quizás DX11 ayude a ello, y podamos ver verdaderos juegos donde la física sea fundamental a modo de interferir de forma dinámica en el juego haciendo cada partida algo más realista y también más impredecible. Quizás en juegos como Cryostasis encontremos un uso mas elaborado para estas técnicas. Nuestra combinación para las pruebas. En nuestro montaje de pruebas hemos querido ver cómo se comportan las soluciones dedicadas de física de Nvidia combinando nuestra GTX 295 con una 9600GSO. La 9600GSO se dedicara únicamente a la carga de procesos de física mientras que la GTX 295 se centrara en el proceso grafico. La 9600GSO tiene una ventaja notable sobre la 9600GT para esta tarea ya que aunque están muy parejas en rendimiento, por diferencias de buses y frecuencias, la 9600GSO tiene más streamprocessors que la 9600GT siendo, por tanto, mejor opción para este trabajo. Tambien podemos optar por dedicar uno de los chips de la GTX 295 a fisica pero sinceramente creo que la mejor opcion y teniendo en cuenta el coste de esta tarjeta, es usar la solucion dedicada que nosotros proponemos. Vamos a comparar a esta nueva creación de Nvidia con su competidora directa tanto en rendimiento como en rangos de precios. La Radeon 4870X2 ya lleva algún tiempo con nosotros, casi seis meses, y es una tarjeta de gran potencia que pondrá en apuros a esta nueva creación de Nvidia. Hemos utilizado los drivers 181.20 para las tarjetas Nvidia y el 8.12 para las ATI. El resto de piezas utilizadas son las siguientes: Procesador: Core i7 965 3.2 @ 4.4GHz. Placa base: Asus P6T Deluxe Memoria: 6GB Crucial DDR3 1333 @ 1600MHz. 8-8-8-24 1.64v. Disco duro: Intel M25 80GB, 2xSeagate 7200.11 1.5TB RAID 0. Refrigeración: Custom Vapochill LS. Fuente: Power PC & Cooling Silencer 750W. Y las pruebas utilizadas son las siguientes: 3DMark 2006. 3DMark Vantage. Devil May Cry 4. World in Conflict. FarCry 2. Crysis. X3 Terran Conflict. Los resultados Nuestro objetivo es probar ambas tarjetas en situaciones de estrés con resoluciones elevadas de 1920x1200 puntos y siempre calidades máximas de calidad en cada juego. De hecho la verdadera comparativa empieza prácticamente al usar modos de FSAA a pantalla completa de hasta 8x. Todas nuestras pruebas se han basado en estos niveles de calidad ya que entendemos que estas tarjetas están pensadas para este tipo de tratamiento. 3DMark 2006. Empezamos con resultados muy parejos en 3DMark 2006. Ambas tarjetas se muestran muy sueltas en una aplicación que esta fantásticamente preparada para trabajar tanto con procesadores de múltiples núcleos como dos o mas núcleos gráficos. 3DMark Vantage A 3DMark Vantage le gusta un 20% más la solución de Nvidia. Hemos obviado resultados globales ya que el sistema de física de Nvidia los desvirtua. Los resultados de GPU hablan por si solos y en este caso la solucion GTX 295 de Nvidia aventaja a la solución 4870X2 de ATI. Devil May Cry 4. En Devil May Cry hemos aprovechado el Benchmark de la demo con la mas alta calidad disponible para realizar una comparativa a nivel de FSAA. Ambas tarjetas logran resultados notables que nos permitirán disfrutar, en cualquier caso, de la espectacularidad visual y la acción de este título. La Nvidia sigue en cabeza aunque le pesa bastante el usar niveles de FSAA muy elevados. Llegados a 8x la caída de rendimiento es notable y le hace perder el liderato en este apartado de la prueba. World in Conflict. En World In Conflict la Nvidia Geforce GTX 295 consigue una ventaja notable en rendimiento con respecto a la Radeon 4870X2. Su rendimiento se mantiene en todo momento por encima de los 70FPS mientras que la Radeon roza los 61FPS cuando usamos FSAA de 4x. FarCry 2. FarCry 2 Benchmark. Calidad "Very High". En calidad muy alta el FarCry pasa más factura a la ATI en niveles de FSAA elevados. La GTX 295 se hace con los resultados más importantes con autoridad y con niveles de rendimiento siempre por encima de los 60 FPS. FarCry 2 Benchmark. Calidad "Ultra High". Lo mismo ocurre en el apartado de calidad "ultra High". Ambas tarjetas se resienten pero la ATI es la única que cae su rendimiento por debajo de los siempre interesantes 60 FPS. Crysis 1.2. Crysis Benchmark calidad "High". En calidad alta la Nvidia se impone en todos los resultados salvo en el de FSAA 8x. Ahí pierde algo de terreno, curiosamente la ATI lo recupera, y queda adelantada por tan solo 1 FPS. Aun así sorprende el buen rendimiento de ambas tarjetas. Crysis Benchmark calidad "Very High". En la calidad "Very High" la pelicula se repite. La ATI cae en todos los apartados salvo en el FSAA de 8x donde se pone por delante con un par de FPS de ventaja. X3 Terran conflict. Esta es la única prueba donde la ATI cobra ventaja de forma clara con respecto a la Nvidia. Este simulador espacial, comportándose bien con ambas tarjetas, parece tener predilección por los motores ATI. Análisis y Conclusión. Mirando los resultados por su valor real y no por si una u otra gana en una u otra prueba, la verdad es que ambas dos son tarjetas magnificas para disfrutar de la mejor calidad de juego delante del PC. Tambien hay que decir que los resultados aunque mirados uno a uno dan algo de ventaja a la Geforce GTX 295 la verdad es que son muy parejos. Sinceramente creo que estamos ante dos grandes tarjetas que logran un empate técnico. También tiene diferencias funcionales y por ahora diferencias de precios que pueden hacernos optar por una o por otra según nuestras preferencias. Personalmente me encanta la idea de tener una de estas tarjetas duales y una de gama baja para otras funciones trabajando en paralelo como es el caso de la Nvidia. La ATI también tiene sus "extras" como el stream o un soporte de reproducción de video fantástico que la convierten también en una opción excelente. Al final nos quedamos con que son dos grandes tarjetas que reducirán precios en gama alta gracias a esta competencia tan directa. FUENTE: http://www.hispazone.com/Articulo/383/Nvidia-GTX-295-Vs-Radeon-4870X2--.html

Registrate y eliminá la publicidad! ¿Cuántas veces nos hemos encontrado en las especificaciones de escáneres e impresoras una característica llamada “DPI”? Algunos nos explican que hacen que las imagenes se vean más grandes o más chicas, otros dicen que influye en el detalle, otros en la calidad. Agarramos una de nuestras cámaras digitales, una impresora y un escáner para realizar una serie de pruebas que permitirán que puedan entender el tema y sacar sus propias conclusiones. Así como se actualmente existe una guerra no declarada sobre megapíxeles de los sensores de imagen que montan las cámaras digitales en la actualidad, también hay una carrera para vender impresoras, monitores y escáneres con más y más DPI. Expliquemos este a veces oscuro concepto, y luego veamos que tan necesario es tener un dispositivo de 1,234,567,890 DPI enchufado en el escritorio. Como dijo Jack, vamos por partes. DPI es un acrónimo para Dots Per Inch, que en correcto español significa “Puntos por Pulgada”. Tal como el nombre lo indica significa cuántos puntos irán en una pulgada. La pregunta que cae de cajón es qué diablos es un punto; para que lo tengan claro, un punto es una especie de equivalente del pixel en el mundo análogo, es decir mientras más DPI en una imagen quiere decir que en una pulgada (unidad de longitud) habrá más puntitos que constituyan la imagen por lo que eventualmente la imagen podría tener más definición. Y decimos eventualmente porque esta medida es “física”, o sea no tiene nada que ver con la calidad de la imagen que vayamos a escanear / imprimir. Si la imagen tiene un nivel de detalle / resolución alta, imprimir a alta resolución mantendrá el nivel de detalles de la imagen original, pero si la imagen es de una resolución muy baja imprimiendo a un millón de DPI el resultado final no mejorará en nada la imagen original. Para esto, necesitamos entender que tal como la impresora nos dará una impresión que tenga una determinada cantidad de puntos por pulgada, la imagen digital que tengamos en nuestro computador tiene aparte de su tamaño en píxeles, una resolución asociada (dato que ustedes pueden cambiar en su programa de edición de fotos favorito) y que la relación entre ambas cifras es la que dará el tamaño que tendría la imagen impresa a la resolución que hayamos escogido. Ejemplo práctico: Una impresión de 20×30 cms a 300 DPI tiene un tamaño de 3543×2362, mientras que una impresión a 72 DPI del mismo tamaño mide en pixeles sólo 850×567. Yendo a la inversa, si tengo una imagen de 1600×1200 y la quiero imprimir a 300DPI, lo podré hacer a un tamaño máximo de 13.5×10 cms. Si quisiera imprimirla a 72 DPI, el tamaño máximo al que podría imprimirla sería más grande (ya que necesitamos menos puntos por cada pulgada que queramos imprimir), de aproximadamente 56×42 cms. Entonces, teniendo en cuenta los números de arriba, podríamos pensar de inmediato que lo que más conviene es tener una cámara de fotos que nos dé imágenes de muchos píxeles por muchos píxeles (o sea de muchos Megapíxeles) y una impresora de millones de DPI para que podamos imprimir las fotos muy grandes y con mucho detalle (porque finalmente, si tengo más puntitos por pulgada lo que significa es que puedo acceder a una imagen más detallada). Pero esto no es tan cierto. Bueno, los que quieran botar su dinero y comprar algo a lo que probablemente nunca le sacarán partido, OK: compren su impresora de 5000DPI y su cámara de 20MP. Los que tengan dos dedos de frente y quieran comprar algo bueno pero conveniente a la vez, sigan leyendo Otro factor que entra en juego a la hora de evaluar cuantos DPI necesito en mi imagen final es la distancia a la cual se verá la impresión. ¿Se han fijado que cuando se acercan a una gigantografía pueden ver todas sus imperfecciones y hasta los colores individuales que usaron para realizar los colores de ésta? Esto ocurre porque como esa gigantografía está hecha para ser vista a varias decenas de metros y no a 5 centímetros de distancia, usar una resolución de impresión alta no tiene sentido y se vuelve nada más que una pérdida de tinta. O sea, si quieren imprimir una fotito chiquita que aún siendo chiquita sea muy detallada viéndola muy de cerca es conveniente usar una resolución más alta. En cambio, si quieren imprimir algo que va a ser apreciado de una distancia mayor, entonces con 300 o 600 DPI está bien. Y si va a ser una gigantografía como la del ejemplo, entonces 50 o 72 DPI son suficientes, sobretodo porque las imágenes de origen en general tampoco están a una resolución tan alta que permita imprimir a esos tamaños. La idea siempre es gastar la menor tinta necesaria, y si no se justifica imprimir una imagen con un nivel de detalle asombroso, mejor ahorrarse esas gotitas de tinta adicionales, que cuestan bastante dinero. Para recapitular, se podría decir que pocos DPI cubrirán un área más grande con la misma cantidad de pixeles. Hagan la comparativa con un galón de pintura y la cantidad de manos que rinde. Pintando con 3 manos podemos cubrir 30 metros cuadrados, pero si bajamos a dos podemos cubrir 40 por ejemplo. Nosotros hicimos pruebas en nuestros laboratorios imprimiendo a 300, 600 y 1200 DPI; luego escaneamos las impresiones a una alta resolución para que puedan ver las imágenes de “cerca”. Aquí están los resultados: Imagen original capturada con la cámara fotográfica Acercamiento de la imagen impresa a 300 DPI Acercamiento de la imagen impresa a 600 DPI Acercamiento de la imagen impresa a 1200 DPI Como pueden ver en las imágenes, entre 300 y 600 DPI hay una diferencia notoria, pero entre 600 y 1200DPI las imágenes son casi idénticas. Tenemos que considerar además que estamos haciendo un “acercamiento” a las imágenes, o sea algo así como verlas muy, muy de cerca. Ahora probemos imprimiendo unas imágenes pequeñitas a ver si distintas resoluciones nos dan más detalle. Imagen impresa a 300 DPI Imagen impresa a 600 DPI Imagen impresa a 1200 DPI Aquí nuevamente se ve que más de 600DPI no se justifican; la imagen se ve casi exactamente igual a 600 y 1200 DPI; la impresión a 300 DPI de una cierta distancia también se ve igual pero al ser imagenes pequeñas uno trata de verlas de cerca y ciertamente a 300 DPI hay menos detalle que a 600 DPI. Caso aparte es el de los escáneres. Si queremos trabajar con la imagen de alguna u otra manera, y luego tener a nuestra disposición una imagen de mayor tamaño que el original físico, es conveniente tener un escáner de la mayor resolución posible; en cambio si sólo queremos escanearle las fotos de infancia a una tía de tercer grado para que las ande trayendo en su celular usar la resolución mínima del escáner es más que suficiente. ¿Y los monitores? ¿Quién no ha visto alguna vez en el panel de control de Windows la cantidad de DPI que quieres usar para el texto? Como dije al principio los puntos son el equivalente análogo a los pixeles, por lo tanto, si mi monitor tiene una resolución medida en pixeles, por qué utilizo DPI? Por comodidad, tal como llamamos conector VGA al conector D-Sub 15, llamamos DPI a lo que en monitores debiera llamarse PPI (Pixels Per Inch). Un monitor común y corriente tiene la mísera suma de 72 PPI, mientras que los monitores profesionales tienden a partir en los 100 PPI+. El único contra de tener tanta resolución en tan poco espacio es que el texto e imágenes (que están optimizados para 72DPI en el mundo del internet) se ven muy pequeños, aunque un pequeño ajuste en las configuraciones soluciona el problema. Ustedes, ¿que resolución consideran adecuada para imprimir? ¿Y para escanear? ¿Cuál es la resolución máxima de tus dispositivos? ¿Las ocupas a menudo? FUENTE: http://www.madboxpc.com/el-mito-de-los-dpi/

Una pregunta típica que alguien se plantea cuando dan el salto de un CRT a un LCD es el por qué ahora todas son rectangulares y no cuadradas como antes. Datos curiosos después del salto. Hasta la llegada de la televisión de alta definición teníamos básicamente tres relaciones de aspecto. 3:2 para fotografía (y 5:4 para ciertos usos publicitarios), 4:3 para televisión y 2.35:1 para cine entre las más importantes. A principios de los 80′ la SMPTE (Society Of Motion Picture And Television Engineers) creó un comité para buscar un estándar para contenido en alta definición con Kerns Powers como jefe de investigación. Cuenta la historia que Powers un día se sentó y dibujó el área que utilizaban todas estas relaciones de aspecto llegando a la siguiente conclusión: Era posible colocar todas las relaciones de aspecto en un área común asegurando que todas se mostraran de la manera más eficiente y no hubiera pérdida de contenido, algo que alegró muchísimo a la SMPTE y se adoptó como el estándar inmediato para el contenido en alta definición. Como dato rosa cabe destacar que el propósito de esta investigación nunca fué encontrar un estándar para monitores o televisores, sino que estaba centrado única y exclusivamente en la producción electrónica de las películas. En la siguiente galería podemos ver cómo se proyectará el contenido en un televisor widescreen: ¿Y los monitores de PC? Tal como se buscó un estándar para “optimizar” el espacio en el contenido de alta definición en la industria del cine los fabricantes de PC’s no quisieron quedarse atrás. 16:10 es el golden ratio que ganó por sobre 4:3 (1280×800 por ejemplo), 3:2 (1200×800 por ejemplo) o 5:4 (1280×1024 por ejemplo). La razón de esto es que puede mostrar dos páginas de información lado a lado sin problema alguno. Lamentablemente los fabricantes de monitores están ofreciendo muchísimos monitores con relación de aspecto 16:9 prometiendo que son lo mejor para ver películas y jugar, algo que está lejos de la verdad. Si bien al utilizar un monitor 16:9 versus uno 16:10 series o películas para TV en alta definición no presentarán barras negras arriba y abajo estas barras seguirán apareciendo al ver contenido estándar (4:3) o películas en formato ancho como 2.35:1. Ves alguna optimización para películas?

Algunos o la mayoría cuando van a comprarse una nueva pc, no tienen ni la mas palida idea de lo que les estan vendiendo, confiando en el vendedor que la mayor parte de las veces no te ofrece lo que es mejor para uno. No es raro que nos ofrezcan una con 4gb ram, un procesador de alto rendimiento, la placa de video de la nasa, ¿pero será eso lo que yo necesito en realidad? ¿Entonces como poder elegir entre tanta variedad lo que me va a servir y que mi dinero rinda por lo que estoy comprando? Lo Básico Desde la perspectiva más simple, un computador estará compuesto de: * Un Procesador, Microprocesador, Micro o CPU, llamado así por el término en inglés “Central Processing Unit” * Una Placa Madre, Tarjeta Madre, Motherboard, Mother o Placa Base (Todos sinónimos de la misma cosa) * Uno o más módulos de Memoria RAM (Random Access Memory - Memoria de Acceso Aleatorio) * Uno o más Discos Duros o discos rígidos. * Una Fuente de Poder o PSU (del inglés Power Supply Unit) * Un Gabinete, caja, carcasa o torre. * Un Monitor o pantalla. * Unidades ópticas (CDR - CDRW - DVDR - DVDRW - Bluray R - Bluray RW) para poder leer y/o grabar información a discos ópticos de almacenamientos como CDs, DVDs o discos Bluray. * Teclado - Mouse - Impresora - Parlantes: Todas esas cosas que se “enchufan a la compu” y que tienen el nombre de Periféricos. En rigor estricto, el monitor es un periférico también. El Procesador Es el cerebro de nuestro computador por ponerlo de una forma. Actualmente es quién ejecuta la gran mayoría de los procesos que conforman el sistema operativo (hay unos pocos que están a cargo del chip de video). Es por esto que su importancia no es menor, ya que de no disponer un procesador adecuado al sistema operativo que estemos usando (como por ejemplo usar un procesador que salió hace 6 años atrás para correr el sistema operativo más actual) podremos observar que la experiencia de uso de nuestra máquina se degrada bastante. Actualmente para el mercado de computadores de escritorio existen tres grandes fabricantes de procesadores para equipos de escritorio: AMD, Intel y VIA. Por un lado tenemos a AMD e Intel enfocados principalmente en lo que son productos de alto rendimiento, mientras que VIA se dedica exclusivamente a lo que son CPU de bajo consumo, ideales para minicomputadores tipo HTPC o cosas de ese tipo (Intel y AMD también tienen procesadores para esos propósitos también). Empecemos derribando un gran mito: la velocidad “bruta” (es decir, la frecuencia o ese número que va delante de “Megahertz” o “Gigahertz”) NO lo es todo, de hecho se puede dar (y ha ocurrido) que un procesador por ejemplo de 3GHz sea en realidad más lento que otro de 2,4GHz. Esto se debe a que lo que determina el rendimiento de un procesador es su arquitectura, que en palabras sencillas es como están dispuestos y relacionados todos los circuitos dentro del CPU para poder procesar las instrucciones que reciban. Poniéndolo de manera más gráfica, es como si para entregar el mismo paquete a un cierto punto, dispusiéramos de un automóvil por un lado y de una bicicleta por otro: mientras que la bicicleta puede pasar por callejones y otros pasos angostos y puede describir una línea relativamente recta para llegar a destino, el automóvil tiene que seguir el trazado de las calles y la dirección que estas tengan, siendo ésta en algunos casos una ruta más larga que la descrita por la bicicleta, lo que implicará que puede existir el caso en que la bicicleta cumplirá antes con el recorrido a pesar de tener una velocidad “bruta” a la del automóvil. Por otro lado también tenemos procesadores de más de un núcleo (core en inglés, no confundir con la marca Core de Intel), siendo el máximo disponible al momento los CPU con 4 núcleos dentro de ellos. Esto opera en la práctica de una manera muy similar a lo que es tener dos procesadores “físicos” en nuestra computadora (como ocurre muchas veces en el caso de los servidores o estaciones de trabajo profesionales). Ahora también tenemos que derribar otro mito bien común respecto a estos procesadores de más de un núcleo: el que un procesador corra a 2GHz pero tenga 2 núcleos no significa que esto equivalga a un procesador de un núcleo con una velocidad de 4GHz. Esto es porque todo depende de como esté hecho el software que aproveche al procesador. Imagínense que tenemos a nuestro cargo dos trabajadores en una construcción y les tenemos que decir que tarea realizar. Tenemos dos posibilidades: decirles a los dos que hagan la misma tarea (como por ejemplo pegar ladrillos para hacer un muro) o decirles a los dos que hagan tareas diferentes. En el primer ejemplo, idealmente los dos trabajadores se demorarán cerca de la mitad de lo que se demoraría uno solo en hacer la pared; en el segundo, el primer trabajador se demorará lo mismo en armar la pared (no mejorará su velocidad) pero verá que al terminar la pared también están instaladas las cañerías (en lo que trabajó el segundo personaje). Esto finalmente significa que el comportamiento de un procesador de dos o más núcleos dependerá de como estén hechos los programas (software). Algunos programas saben darle instrucciones a los varios núcleos por lo que su rendimiento mejora mucho con un procesador de esas características; otros programas saben darle instrucciones que aprovechan sólo un poco estas características (con lo que el rendimiento mejora pero sólo un poquito) y otros lisa y llanamente no aprovechan para nada tener varios núcleos disponibles por lo que un procesador de 1, 2, 3 o 4 núcleos no hará ninguna diferencia en cuanto a rendimiento. De todas maneras, en lo que siempre ayudará tener varios núcleos es en la “simultaneidad”: aunque un programa sólo sepa usar un núcleo del procesador, los otros quedarán disponibles para que simultáneamente yo pueda correr otros programas, sin que el computador se me pegue tanto como cuando hago algo así en un equipo que tenga un procesador con sólo un núcleo. ¿Alguien ha visto que pasaba en un computador muy muy antiguo (de un sólo núcleo) cuando tratabas de hacer un archivo zip y al mismo tiempo correr el antivirus y navegar por internet? El rendimiento se caía al suelo, andando todo muy lento y causando a veces que incluso el computador se pegara, siendo necesario que lo apagáramos y lo volviéramos a encender. Esto ya no sucede tanto con procesadores de varios núcleos, bajando el rendimiento un poco pero manteniéndose dentro de un margen muy aceptable. Otra cosa con la que uno se encuentra en la descripción de un procesador es la llamada memoria Cache. Esta no es más que una memoria de muy alta velocidad (mucho más rápida que la memoria RAM de la que hablaremos unas páginas más adelante), la cual viene distribuida en varios niveles, dos por lo general, L1 y L2 (Level 1 y Level 2 respectivamente), que sirven para almacenar datos que el procesador ocupa frecuentemente con lo que se evita ir a buscar ese dato a la memoria RAM o al disco duro (que son mucho más lentos) a cada rato. Su importancia es esencial, pero no debemos guiarnos por la cantidad de memoria cache exclusivamente para elegir un procesador, ya que uno que tenga 2MB de cache no andará a la mitad de la velocidad que uno de 4MB y éste no andará mucho más lento que uno de 6MB. El rendimiento cambia pero no de manera drástica y no en todos los programas, ya que algunos dependen mucho del cache y otros casi nada o nada. La Placa Madre Es el hardware que sirve de conexión entre todas las piezas: en ella pondremos el procesador, las memorias y la tarjeta de video; a ella conectaremos la fuente de poder, los discos duros y todos los periféricos. Esto deja bastante clara su importancia, ya que el no disponer de una buena placa nos puede llegar a imponer una importante limitación a la hora de la elección del resto de los componentes de lo que será nuestro PC, ya que cada placa soporta que le enchufemos cosas diferentes: algunas procesadores AMD, otras Intel; algunas tienen dos ranuras para ponerles memoria RAM y otras cuatro, etc. Un componente que podemos encontrar en la placa madre que es fundamental para el funcionamiento de nuestra máquina es el chipset, que es el encargado de hacer de “puente” entre el procesador y el resto de los componentes electrónicos de nuestro computador (en el caso de los procesadores AMD, exceptuando la memoria RAM que se comunica directo con el procesador debido al controlador de memoria que traen integrados los procesadores de esa marca. La próxima generación de procesadores Intel también incluirá esta característica que permite que la comunicación del procesador con la memoria sea directa y sin intermediarios). Actualmente en el mercado existen 5 grandes empresas fabricantes de chipset, VIA (que se acaba de retirar de la industria de los chipsets para otros procesadores, ahora fabricará chipsets sólo para sus propios procesadores VIA), SiS, AMD, Intel y NVIDIA. Tanto AMD como Intel y ahora VIA sólo producen chipsets para sus propios procesadores y plataformas, mientras NVIDIA y SiS fabrican para ambos. Aquí hay que mencionar que mientras Intel, AMD y NVIDIA fabrican chipsets de todo rango, (desde económicos, con pocas características hasta muy caros) SiS y VIA tienen productos de un perfil más bajo, siendo muy económicos pero en general de más bajo rendimiento y prestaciones que las otras marcas, o bien orientados a entornos empresariales. Lo habitual es encontrar el Chipset dividido en dos piezas, el Northbridge (Puente Norte - NB para abreviar) y el Southbridge (Puente Sur - SB). El primero es el que se lleva la parte más importante siendo el responsable de comunicar el procesador con las memorias (en caso de que el procesador no tenga controlador de memoria integrado, como en el caso de AMD), chip de video integrado (en caso de haber) y las tarjetas de expansión (AGP, PCIe que se ocupan para conectar tarjetas de video y otras tarjetas). Mientras el SB es el que genera el puente con el resto de las conexiones, léase puertos PCI (para conectar tarjetas), SATA y/o IDE (para conectar discos duros y/o unidades de almacenamiento óptico como CDRW o DVDRW) y USB (donde hoy enchufamos teclados, mouse, pendrives y toda esa horda de chucherías USB que venden por internet en las tiendas geek). Ahora siguiendo con el tema, marcas de placas madres existen muchas; sólo por nombrar algunas tenemos a: Abit, Asrock, ASUS, Biostar, DFI, ECS, eVGA, Foxconn, Gigabyte, Intel, MSI, PC-Chips, Sapphire, Tyan, XFX. Dada la gran variedad tenemos una amplia gama de elección, desde placas económicas que rinden lo justo y necesario hasta las de gama más alta con grandes disipadores y componentes de muy alta calidad pensados directamente en una de las actividades favoritas de muchos lectores de esta página: el Overclock. Otro punto importante a tomar en cuenta respecto a la placa es el formato de esta, es decir el tamaño, que en jerga técnica se conoce como el factor de forma. Lo más común es ver de dos tipos, del estándar ATX o µATX (se lee micro-ATX). Esto influirá mucho en la distribución interna de los conectores, siendo mucho más complejo la instalación de un disipador de gran tamaño para procesador en una placa µATX, dado que es más factible que tope con alguna pieza cercana como pueden ser los módulos de memorias RAM por ejemplo. Lo común en las placas actuales es que integren también tanto tarjeta de red como tarjeta de sonido, habiendo también un tipo de placas madre que además incluyen en su chipset un GPU (que hará las funciones de tarjeta de video, con lo que no será imprescindible comprar una tarjeta de video por separado=). Estas placas madres son conocidas en la jerga técnica como “placas integradas” y en general son las de precio más económico. La potencia del chip de video integrado en estas placas es mucho menor que la de una tarjeta separada de alto precio, pero nos permitirá ver películas en alta definición y jugar varios juegos 3D (aunque reduciendo el nivel de detalles de estos para que la experiencia de juego sea aceptable). Memoria RAM Durante la ejecución de un cierto comando al realizar ciertas operaciones es necesario almacenar de manera temporal uno o más datos, y es aquí donde entra a jugar su función la memoria RAM. En un principio los primeros computadores no poseían este tipo de memoria, pero al aumentar la capacidad de los procesadores se cayó en cuenta de que la velocidad de acceso de un disco empezaba a ser un cuello de botella. Es de esta necesidad que surgió la memoria RAM, siendo una memoria de menor capacidad, pero de un menor tiempo de acceso y mayor velocidad, lo cual elimina el mencionado cuello de botella. Ahora después de un tiempo se volvió al mismo problema, esto debido a que los procesadores seguían ganando velocidad más la memoria RAM empezaba a quedarse atrás. Es de aquí de donde surge la memoria cache, una memoria también de tipo flash la cual sacrifica de nuevo la capacidad por una aun mayor velocidad. En la actualidad no se dan de más de 7-8MB por CPU (esto claramente obviando todo tipo de procesador multi-núcleo no monolítico, es decir que sean producto de “pegar” dos procesadores). De todo esto es fácil concluir que los factores más importantes a tomar en cuenta para elegir la memoria a usar son la capacidad de esta(s), su(s) latencias y su velocidad. Podemos comprender estas tres características de la siguiente forma: • Capacidad: Nos define la cantidad de datos que podemos almacenar, de ser superada se pasa al siguiente nivel de memoria (de L1 a L2, de L2 a RAM y de RAM a memoria virtual). * Velocidad: Define la cuantía de datos que podemos mover por unidad de tiempo. * Latencias: Es el tiempo que se demora en realizar cierta operación. Por ende queda claro que en lo ideal es conseguir memorias de la mayor velocidad y menores latencias posibles, mientras la cantidad la definirá el uso. También cabe mencionar que dado el volumen de datos que son capaces de manejar las tarjetas de video poseen su propia memoria RAM, o en el caso de venir está integrada en la placa madre la tarjeta revise una cierta cantidad de la RAM del sistema (repartición que se realiza mediante la BIOS). En la actualidad tenemos dos estándares de RAM, DDR2 y DDR3. DDR3 posee mayores velocidades a costa de mayores latencias, pero esto último se ve compensado con creces por lo primero. Respecto a fabricantes de memorias la variedad es muy amplia, habiendo para todos los gustos y bolsillos. Entre algunas podemos mencionar a: A-Data, Buffalo, Corsair, Crucial, G.Skill, GeIL, Kingston, Mushkin, OCZ, Patriot, Super Talent, etc. Tarjeta de Video La tarjeta de video es el componente que se encarga de procesar toda la información que corresponda a gráfica en nuestro sistema, tanto 2D como 3D. Además le entrega la señal de video al monitor que es el que finalmente desplegará la imagen que veremos. Se compone básicamente de un GPU (Graphics Processing Unit o Unidad de procesamiento gráfico) y memoria VRAM (que en el caso de una tarjeta de video integrada es la misma memoria que ocupa el CPU, que se comparte entre ambos procesadores)*. En cuanto al funcionamiento de estas partes, tenemos que el GPU es un procesador especializado, de una arquitectura completamente distinta a la de los CPU ya que sirve para realizar cálculo paralelo y no serial. Los GPU actuales, que hoy en día son diseñados o por NVIDIA o por AMD están compuestos de muchos “mini procesadores” que realizan cálculos simples, por lo que la fortaleza de estos diseños es la realización de muchos cálculos paralelos. De igual manera la VRAM cumple una función similar a la de la RAM común y corriente pero está dedicada únicamente al almacenamiento de los datos generados por la GPU. Y al igual que con la RAM, la VRAM existe en varios sabores. Tenemos actualmente DDR, DDR2, GDDR3, GDDR4 y GDDR5, estando esta lista en orden ascendente de velocidad (y de precio, lógicamente). Ahora que conocemos el nombre de los distintos tipos de memoria de video, tenemos que aclarar una duda que muchas veces se erige como un mito completamente falso: ¿entre más VRAM tenga una tarjeta de video mejor?. Esto NO es así; la realidad es que dependerá del volumen de datos generados por la GPU cuanto provecho le saquemos a la capacidad de almacenamiento. Si la GPU que tenemos es incapaz de procesar grandes cantidades de información sin colapsar, el utilizar 1GB en vez de 512MB de memoria significará ganar muy poco o absolutamente nada de rendimiento. Obviamente el poner más memoria en la tarjeta influye en el precio, por lo que si compramos una tarjeta que tenga memoria “de adorno” pagaremos más de lo que corresponde por el rendimiento que entrega. Otro punto donde también a veces hay confusiones está en el puerto de conexión que utiliza una tarjeta de video para enchufarse al computador. Hoy existen tres tipos diferentes: PCI (Peripheral Component Interconnect - Interconexión de Componentes Periféricos), AGP (Advanced Graphic Port - Puerto de Gráficas Avanzadas) y PCIe (PCI Express). Del primer tipo (PCI) ya es muy difícil encontrar, ya que está casi en desuso por su antigüedad y por no ser capaz de ofrecer una velocidad suficiente para el poder que tienen las tarjetas de video actuales. AGP es una interface que también está técnicamente obsoleta, pero los fabricantes de tarjetas de video de cuando en cuando sacan uno o dos modelos con interface AGP ya que no olvidan que mucha gente aún tiene equipos muy antiguos y no tienen ni las ganas ni el presupuesto para actualizar la plataforma completa. En último lugar tenemos al estándar PCIe, el que usa la gran mayoría de los modelos comerciales disponibles hoy, y del que existen dos versiones, 1.x y 2.0 (que ofrecen distintos anchos de banda máximos, siendo mayor el de PCIe 2.0), las cuales son compatibles entre sí en ambos sentidos, ya sea una tarjeta 2.0 en una placa madre 1.x o una tarjeta 1.x en una placa madre 2.0. Ahora otro aspecto a considerar sobre las tarjetas de video es que las de gama alta de las últimas generaciones consumen mucha energía (para poder entregar todos los FPS que dan en los juegos), por lo que no hay que perder de vista la capacidad y calidad de la fuente de poder a usar. Respecto a las marcas, hay que hacer la distinción entre fabricantes y ensambladores. Fabricantes son aquellos que producen las GPU y el diseño de la tarjeta en sí. Dentro de esta categoría entran dos grandes compañías, AMD a través de su división de gráficos ATI y por el otro lado tenemos a NVIDIA. Ambas producen chips gráficos para tarjetas discretas (las que se venden por separado) e integradas (las que como hemos dicho vienen incorporadas en algunas placas madre). Fabricantes de chips de video integrado también son Intel y VIA, aunque a un nivel menos competitivo en rendimiento que AMD o NVIDIA. Respecto a las ensambladoras, están son las encargas de producir la tarjeta de video que llegará a nuestras manos utilizando una serie de componentes, como GPU, memorias, condensadores, etc. Compañías que ensamblan tarjetas de video hay varias y algunas de ellas son: BFG, Chaintech, eVGA, PNY, XFX, Zotac, Gecube, HIS, Powercolor, Sapphire, ASUS, Gigabyte, MSI, Palit, Foxconn, ECS y otras. Dos puntos más que hay que aclarar para evitar confusiones: la memoria de la tarjeta de video es absolutamente independiente de la memoria del sistema; es decir es irrelevante si la placa madre usa DDR2 y la tarjeta de video GDDR5, no se generarán incompatibilidades. Lo otro que es irrelevante es la marca del chipset de la placa madre vs el GPU de la tarjeta de video. O sea, tampoco genera incompatibilidades el que el chipset sea por ejemplo NVIDIA y la tarjeta de video sea AMD o al revés. Tarjeta de Sonido Una de las grandes olvidadas a la hora de comprar un computador, es la responsable de generar todos los sonidos que se reproducen. Por ende es clara su importancia en lo que respecta a la calidad del sonido. Se podría decir con un buen grado de seguridad que todas las placas que se producen y aquellas incluso con varios años de antigüedad traen incorporada una tarjeta de sonido. Ahora del mismo modo que el video integrado, no es de la mejor calidad, dejando mucho que desear si uno lo que busca es un buen sonido. Ahora tampoco se logrará una buena calidad de reproducción por mucho que se tenga la mejor tarjeta del mercado si los parlantes/audífonos que se usan no están a la par. Este par de componentes quizás sean los que cuya necesidad de ser vistos como un conjunto es más fuerte. Mientras una buena t. de video garantizará el poder jugar de buena manera sin tener demasiado cuidado en el resto de las características del PC (aunque tampoco hay que exagerar), una tarjeta de sonido para lograr su mejor desempeño requerirá de un sistema de salida de igual calidad. Actualmente quien domina el mercado de tarjetas de sonido discretas por mucho es Creative, que posee una amplia gama de productos, aunque también hay otros ensambladores más pequeños en cuanto a participación en el mercado, como ASUS con su gama Xonar, también M-Audio posee unas cuantas tarjetas dedicadas a la entretención. Ahora a diferencia de los componentes anteriormente mencionados, el evaluar la calidad de una tarjeta de sonido es algo mucho más complejo, siendo la mejor idea hacerse asesorar por alguien entendido en el tema. Disco Duro Quizás el componente del que mejor se entiende su función, algo tan sencillo como guardar datos. Mas no por eso deja de ser una pieza importante. Sabiendo esto no es difícil entender la importancia de tres factores: la capacidad del disco, las velocidades de escritura y lectura, y el tiempo de acceso. Otro punto a tener en cuenta que en la actualidad, existen dos tipos de discos duros, los de platos magnéticos y los SSD (Solid State Disk - Disco de Estado Sólido), sobre las diferencias entre ambos hablaremos más adelante, mientras nos dedicaremos a los más comunes, los de platos. La capacidad es el concepto más sencillo, el cual nos indica cual es cantidad de datos que podemos almacenar en nuestro disco duro. Esto se mide en bytes, ahora cabe señalar que las empresas fabricantes de discos duros señalan la capacidad de sus discos asumiendo que la equivalencia es de 1000:1 entre un prefijo y el siguiente (por ejemplo entre Kilo y Mega), cuando en realidad es de 1024:1, por ende en la practica un disco de 250GB no es tal sino que en la realidad corresponde a 232,83GB aproximadamente. Las velocidades de lectura y escritura, que tal como dice su nombre, son las cantidades de bytes grabados y leídos por segundo. Se puede deducir sin mucho razonamiento que a mejores velocidades mejor el rendimiento del sistema en general. Ahora bien hay varios factores que afectan estas velocidades, siendo quizás las más importantes la densidad de los platos (la cantidad de bytes que hay por unidad de superficie) y la velocidad de rotación de los platos. Sobre la densidad a mayor sea esta, mayor la cantidad de datos que se podrán leer y escribir utilizando la misma proporción de energía en el movimiento, siendo más efeciente discos con una mayor densidad, mientras la velocidad de rotación nos indica el área que se cubrirá, mientras mayor velocidad mayor área del plato se cubrirá, abarcando una mayor cantidad de datos. El último factor es el tiempo de acceso, el cual es determinado por lo mismo que las velocidades, es decir la densidad y velocidad de rotación, esto porque mientras una mayor densidad significa que en un mismo movimiento puede revisar más datos, mientras que la velocidad afecta pudiendo llegar más rápido a un punto cuando más rápido gire. Ahora veamos las diferencias entre un disco SSD y otro de platos. Primero partamos por el hecho de que mientras uno de platos funciona conteniendo uno más platos (valga la redundancia), que rotan a altas velocidades, por ejemplo en uno de 3,5” y 7200RPM el punto más externo del plato sufre una aceleración de 25.000 m/s2 aproximadamente (si la gravedad fuese así de intensa, una persona pesaría 2500 veces más de lo que pesa en la superficie terrestre), además de poseer varias piezas móviles, y generar no pocas cantidades de ruido y calor, en especial tratándose de discos de altas velocidades de rotación. Es a partir de estas problemáticas de donde surge la idea de usar memorias de tipo flash (el mismo tipo que la RAM), con lo cual se solucionan los problemas antes mencionados, dado que se eliminan todas las piezas móviles, lo cual a su vez elimina todo el calor y ruido generado por esto, también dado el funcionamiento el tiempo de acceso es mucho menor, además de alcanzar unas velocidades de lectura y escritura mucho mayores porque ya no hay cabezales que tengan que ir de un punto a otro, sino que se depende solo del tiempo en que demore el sistema en acceder a donde este almacenado el dato buscado. Sus dos desventajas son primero el hecho de que por ahora están disponibles en capacidades reducidas respecto a los de platos, en discos tradicionales hace ya un tiempo que se llego a capacidades de 1TB, sumado al segundo contra que es la relación capacidad de almacenamiento vs costo por mega, teniendo los discos SSD un indice muyo mayor, o sea muchisimo más caros por mega almacenado. Respecto a los fabricantes de discos duros, entre los más grandes contamos Hitachi, Samsung, Seagate y Western Digital. Ahora de todos estos solo Samsung se ha aventurado al incipiente mercado de los discos SSD, el cual es dominado fuertemente por compañías relacionadas a las memorias RAM (dado que en si sus componentes y funcionamiento son muy similares). Fuente de Poder Otra de las grandes olvidadas. La fuente de poder tal como lo dice su nombre es la encarga de suministrarle la corriente eléctrica necesaria para todos los otros componentes de manera que estos funcionen correctamente. Por ende no es difícil considerar la importancia que reviste la elección de la fuente, por ende el problema es el cómo evaluar que fuente se ajusta a lo que necesito. Los factores importantes a tener en cuenta son los siguientes: * Amperaje indicado en la(s) línea(s) de +12V * Presencia o no de PFC (sea activo o pasivo) * Modelo y Marca de la fuente Nótese el hecho de no haber mencionado la cantidad total de vatios que entregue la fuente, esto es porque de las distintas líneas de voltaje la responsable de suministrar a las piezas más demandantes (como el procesador y al tarjeta de video) son nuestras líneas de amperajes. Entonces se hace evidente que por mucho que una fuente señale que entregua 650W en total, lo relevante será cuantos de esos Watts entregan cada línea y por ejemplo de esos la línea de amperes +12v cuanto aporte indivudualmente, esta es una de las líneas de amperaje más demandadas, tanto por Video o CPU, si no se tiene cuidado en la elección podríamos llegar a un punto en que nuestra fuente será incapaz de mantener el correcto funcionamiento de las piezas de nuestro computador, es más, también se puede presentar el caso en que sencillamente no de abasto incluso como para iniciar el sistema. Muchas veces cuesta detectar cuando tenemos problemas de estabilidad en nuestros equipos, cual es el factor que los produce, a ciencia cierta podemos señalar que siempre se debe descartar la fuente de poder en una etapa inicial, Por ende es de vital importante que la fuente proporcione los suficientes amperes a través de esa(s) línea(s) para el total de Watts que señala. Si quieres saber aproximadamente cuanta fuente de poder necesitas, acá te dejamos un excelente link. Calculadora para fuente de poder Otro punto de interés será la existencia o no de PFC Activo o Pasivo, este es un tema que ya hemos tratado y se refiere al % de eficiencia de tu fuente de poder, por lo que te sugerímos leer este artículo. ¿Que es el PFC? además para ahondar aún más Guía fuente de poder Respecto a las marcas de fuentes, entre las de mejor calidad encontramos a Antec, Enermax, HEC, Mushkin, Tagan, Topower, Cooler Master y Thermaltake, en estos dos últimos considerando idealmente desde la gama media hacia arriba. Gabinete Es donde pondremos todas las piezas, y lo que les proporcionará protección de posibles daños causados por agentes externos. Es importante mas no es prioridad en base a nuestro presupuesto. Lo más importante a la hora de fijarse es en la refrigeración y el tamaño. Ahora no deja de ser importante mencionar que para muchos la estética es también un factor a considerar. Otro punto que se puede tomar en cuenta es la calidad de los materiales, esto porque por lo general los gabinetes más baratos cuentan con terminaciones de menor calidad y materiales más delgados que pueden ocasionar el más rápido deterioro de nuestro gabinete o una menor protección e nuestras piezas, además de bordes afilados que más de algún corte pueden producir. No podemos olvidar que muchos gabinetes incluyen fuentes de poder, revísenlas siempre, dado que estas fuentes por lo general están orientados a bojos usos de consumo como una solución económica. Otro punto a considerar en el caso de traer accesorios nuestro gabinete, como a veces es normal para los más económicos, mouse, teclado, parlantes, que estos sean de buena calidad, ya que no queremos llegar a la casa tener todo listo y que nuestro teclado o mouse no funcionen. Sobre marcas de gabinetes no vale la pena entrar a comentar, esto dado que sencillamente la oferta es tan gigantesca y con un gran número de fabricantes de calidad, que intentar hacer una lista sería imposible sin dejar a muchas afuera. Bueno, y ahora que conozco cada pieza, ¿Qué me compro? Para la elección de las piezas a comprar se deben considerar tres aspectos: * Presupuesto * Piezas que necesito * Uso que se le dará al PC Centrémonos en lo último, pues es esto lo que definirá a que piezas darle prioridad. Para esto haremos una clasificación general de los usos más comunes de un PC (nótese que se pueden dar combinaciones de dos o más categorías, caso en el cual abra que tomar en cuenta las necesidades de todas las funciones a desempeñar): • Gamer: jugar, jugar y seguir jugando hasta que las teclas WASD estén totalmente gastadas, lo que prima en todo PC en el que se quiera jugar es la tarjeta de video, el procesador y la memoria RAM, siendo la primera la más importante. A tener en cuenta que es quizás esta configuración la más demandante de fuente, por ende esta pasa a tener un lugar importante en nuestra cotización. • Ofimática: si pasar tu día leyendo correos, viendo la página del banco o de MBPC y usando msn, este es tu grupo. Lo relevante acá es el procesador y la cantidad de memoria RAM, aunque tampoco necesitas lo último en tecnología, de hecho esta categoría es la más económica de todas dado su bajo consumo de recursos. • Edición Grafica/Video/Audio: en esta categoría es rey el que tenga el mejor procesador, disco duro y una enorme cantidad de RAM, además de los implementos necesarios para el trabajo (una tarjeta con entradas MIDI o de 1/4 para grabación por ejemplo). Por lo general un arreglo RAID (0 o en lo ideal 0+1 o 1+0 o lo que alcance con tu presupuesto) es muy recomendable, junto con un buen procesador que este cuente con la mayor cantidad de núcleos posible, quizás por núcleo no sea el más rápido pero para estos trabajos el multitasking es algo endémico ya. • HTPC: si quieres convertir tu futuro PC en el centro de tu sala de estar, conectado a una gran pantalla LCD Full HD para poder disfrutar la última película que haya salido en Blu-Ray, lo que debe importarte es la elección de una tarjeta de video con todas las salidas necesarias (HDMI, DisplayPort, DVI, etc.), una buena tarjeta de sonido con un buen subwoofer (si lo que quieres es disfrutar del audio) y un disco duro de gran tamaño nunca esta demás (no queresmos ver que no te alcanza el disco para guardar la disco grafía de tu grupo favorito), un gabinete mATX vendría bien si no quieres un PC demasiado visible, y sería aconsejable cambiar el cooler del procesador por uno que genere poco ruido (después de todo tu quieres escuchar la película, no el molesto ruido de los ventiladores) • Server: las necesidades de esta categoría son muy similares a la de un PC para edición, lo importante es tener un buen procesador, con hartos núcleos, mucha memoria RAM, y una gran cantidad de discos de gran capacidad en uno o varios arreglos RAID, y seguramente querrás invertir también en una buena refrigeración, después de todo querrás que tu server funcionar 24/7 no? Quedan todavía dos categorías, pero por su naturaleza van siempre de la mano a alguna de las otras, siendo necesario elegir entre una y la otra, estas son: • Con Overclock: para lograr sacarle hasta el último MHz a tu procesador requerirás de una placa de buena calidad, que permita una serie de configuraciones especiales, con unas memorias que no te dejen tirado a mitad de camino, una buena fuente, y claro esta la mejor refrigeración que puedas pagar, como vas a subir el voltaje de todas las piezas a las que se las puedas subir hará que las cosas se pongan realmente calientes en algunos casos. • Sin Overclock: en este caso la placa pasa a tomar un rol muy secundario, basta que cumpla con lo que quieras (que tenga x número de puertos SATA por ejemplo) y con un buen chipset, las memorias tranquilamente pueden ser de las más económicas, aunque siempre recomendamos que sean de alguna marca, y no requerirás una fuente muy poderosa. Ahora queda una última recomendación, lee muchos reviews, no hay mejor manera de saber que pieza es mejor que otra, a través de esa forma, en el caso de que no te convenzan los resultados y respuestas, no te preocupes somos muchos los dispuestos a responder tus preguntas en nuestro foro. saludos y espero que les sirva

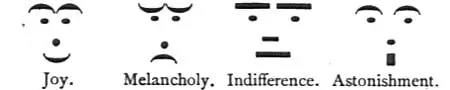

--->¿Quién los uso por primera vez en Internet? --->¿Cuál es el más usado? ¿Qué son los asscons? ¿Sabías que algunos datan del siglo de XIX? --->Los emoticonos han traspasado las fronteras de la mensajería instantánea, su gran impulsora. Seguro que los usas al escribir en mensajería instantánea, correos electrónicos y SMS's, pero ¿sabías que, pese a que oficialmente son muy ‘jóvenes', algunos existían ya desde 1800? Aquí tienes diez curiosidades, recogidas por el blog Neatorama, sobre esas caritas llamadas emoticonos. 1. Los emoticonos más viejos: Los primeros emoticonos fueron publicados el 30 de marzo de 1881 por la revista satírica Puck (EE UU): 2. El emoticono de Abraham Lincoln: En 2004, un equipo de investigación de la compañía especializada en archivos digitales Proquest estimó que la existencia de estas caritas podía llegar a datar de 1862, aunque seguramente de manera accidental. Al estudiar la transcripción de un discurso del presidente de EE UU Abraham Lincoln se encontraron con lo que hoy interpretaríamos con un guiño (en emoticono). 3. El primer emoticono en Internet: El 19 de septiembre de 1982 un equipo de investigación de la universidad Carnegie Mellon introdujo caritas sonrientes y tristes para diferenciar mensajes online serios de los que eran en tono jocoso. 4. Emoticonos orientales y occidentales, diferentes: también hay diferencias entre los emoticonos de oriente y occidente, y no sólo en que los segundos se pueden leer de lado, sino también en su forma. 5. Emoticonos más usados: En 2007 Yahoo! Realizó una encuesta entre 40.000 usuarios. Los resultados determinaron que los más usados eran la sonrisa y el coqueteo. Además, de estos usuarios, el 82% respondió que usaba con frecuencia esas caritas. El 57% también dijo que prefería expresar sus sentimientos con emoticonos que con palabras. 6. Su evolución: los programas de mensajería instantánea han sido los principales impulsores de los emoticonos. El de Windows, el de Yahoo! (con las caritas ocultas) e incluso de Gmail han ido evolucionando sus caritas. 7. Assicons y Boobiecons: ¿por qué limitarse a la cara? Han pensado algunos creadores de estas caritas. Cada vez son más populares los animales, gifs animados... e incluso los assicons (de ‘ass', que significa ‘culo' en inglés) y boobiecons (de ‘boob', que es ‘teta' en inglés), de manera que se pueden encontrar los siguientes. 8. Emoticonos registrados: En 2000, Despair Inc, quiso hacer suyo el emoticono triste L así como un empresario ruso llamado Oleg Teterin quiso apoderarse del guiño ;-). 9. Caritas para el coche: los emoticonos no son sólo cosa de Internet. Hoy ya existen enlaces que venden para que los lleves hasta en el coche . 10. El ‘hombre emoticono': también los hay que prefieren que en vez de texto sea una cara humana real la que actúe como emoticono a base de animaciones gif. http://www.20minutos.es/noticia/468687/0/emoticonos/curiosidades/messenger/

La gente de NetbookNews fué de paseo a la fábrica de Kingston donde hacen los Pendrives. Lamentablemente el equipo de investigación y desarrollo no está viendo la posibilidad de pendrives de queso, pero al menos tienen una fábrica bastante cool. Para quienes tengan problemas con el inglés, el viaje parte con un PCB doble al cual se le van colocando los chips de memoria. Luego de eso se le coloca el encapsulado, conectores USB y se corta el PCB doble para tener unidades normales. Al finalizar todo eso se empacan en los distintos tamaños y sabores y se les colocan los stickers que indican la capacidad para luego salir al mercado. fuente:

Transformers 2: La venganza de los Caídos es, sin duda, la película del invierno (o verano para quienes están en el hemisferio norte). Se trata de explosiones, robots gigantes, mujeres perfectas y más explosiones. Con 555 tomas de efectos especiales (lo que equivale a 1/4 de la película), el triple de robots que en la primera película (46 versus 14), y una estación de trabajo explotando, Transformers 2 es tan interesante en la pantalla grande como en el proceso de su producción. Pero, ¿cómo llegó a hacerse realidad? Bueno, como casi con todas las películas, todo parte en un bloc de dibujo, donde el director plasma su visión, lo que tiene en su cabeza para que poco a poco, y con la ayuda de otros artistas y técnicos vayan dando forma a los personajes. La gracia es que con Transformers 2, este proceso comenzó incluso antes de que existiera un guión. Michael Bay, el director, ya sabía qué personajes robots quería ver en la película, por lo que junto a un grupo de artistas realizó los primeros diseños y sólo después se los entregaron a los guionistas para que se inspiraran y crearan una película y a los especialistas en efectos visuales para que crearan los blueprints. De esta última parte estaba encargada Industrial Light & Magic, la empresa de George Lucas Muy bien. Después vino todo el trabajo de los actores… frente a la nada. Como, naturalmente, los robots gigantes no existen, todavía, los actores tenían que actuar frente a unas varas que podían llegar hasta los 30 pies de altura y que representaban a los robots, de modo que mirando la punta de las varas los actores eran filmados como si estuvieran hablando con un personaje metálico. Hasta ahí nada nuevo. El tema era que en cada toma tenía que haber un técnico de ILM fotografiando todo para que los supercomputadores pudieran reproducir cada una de las condiciones lumínicas para poder dibujar correctamente los robots. Ah, y en cuanto a los robots, los magos de ILM se demoraban 12 semanas en sólo dibujar un robot, luego otras 12 a 15 semanas para armar cada una de las estructuras y esqueletos que los sostienen. Y luego viene la pintura. Un trabajo de chinos. ¿Qué cuánto se demoraban en una secuencia de transformación de un robot de esas que no duran más de 2 segundos? Varias semanas. Y todo porque eran dibujadas cuadro por cuadro… a mano. Incluso, ILM tuvo que desarrollar software específico para esta película. Por ejemplo, las escenas de los robots bajo el agua necesitaron del desarrollo de un plug-in especial que permitiera recrear de manera realista la luz bajo el agua. De modo que el plug-in tomaba la animación y la transformaba para que se viera como si se hubiera filmado bajo el agua. Antes de esta película, ILM no contaba con dicho software. Un par de datos triviales: mientras la primera película sólo utilizó 20 terabytes, su secuela llegó a los 145 terabytes, lo que equivale a unos 35.000 dvd’s. Optimus Prime está compuesto de más de 10.000 piezas digitales y el Devastator… 80.000. El algoritmo diseñado por ILM controla cada una de esas piezas para lograr la transformación correspondiente. 72 horas se demoraban en renderizar un sólo cuadro de la versión IMAX de la película. En un PC de última línea se demoraría 3 años. Como los genios de ILM tuvieron que trabajar el doble para reproducir toda esa magia en pantallas IMAX, sus estaciones de trabajo y servidores sufrieron la carga. Tanto así, que una noche unos cuantos computadores explotaron! Ah, ¿quieres saber cuánto te demorarías en tu computadora renderizar toda esta película? 16.000 años . Poquito!.

Increible la placa que saco EVGA. Posee 4 puertos pci para hacer un SLI-Crossfirex con 4 placas, en 2do video se hace la comparacion entre las mejores placas de video en SLI y en Crossfire. LINK LINK LINK saludos