skape_

Usuario (Argentina)

5 alternativas gratuitas a AutoCAD Podemos afirmar, sin miedo a equivocarnos, que AutoCAD es el referente –casi el estándar—, en lo que a diseño asistido por ordenador en 2D y 3D se refiere. La enorme potencia y versatilidad de esta herramienta la han convertido en la favorita de ingenieros, diseñadores, arquitectos y un largo etcétera de profesionales que necesitan plasmar y acotar de forma precisa sus diseños para su producción. Lógicamente, a este tipo de programas se les puede sacar un gran rendimiento comercial ya que es el más utilizado por las empresas e industria en general. Esto hace que el precio de la licencia de AutoCAD para un uso anual se dispare hasta más allá de los 2.000 dólares. El coste de esta licencia es casi inalcanzable para un gran número de pequeñas empresas y PYMES, así como para trabajadores autónomos o estudiantes de alguna de las ramas profesionales antes mencionadas. Buscar alternativas a programas profesionales tan asentados como AutoCAD es siempre una ardua tarea y, en muchas ocasiones, las alternativas no cubren todas las necesidades. Por suerte, el software libre cuenta con un buen número de opciones y alternativas a AutoCAD que te permitirán utilizar funciones y herramientas de diseño muy similares a las que puedes encontrar en AutoCAD, ofreciéndote la posibilidad de importar y exportar archivos con el formato de archivo DWG nativo de AutoCAD. La posibilidad de estos programas CAD gratuitos de ahorrar costos es una las mayores ventajas de este tipo de alternativas. Vamos a revisar algunas de las 5 mejores alternativas libres y gratis a AutoCAD. QCad Es una de las bases sobre las que se basan diversos desarrollos alternativos de herramientas de diseño asistido por ordenador en 2D gracias a la liberación de su código fuente. Es sencillo de utilizar gracias a su sencilla interfaz que ofrece un espacio de trabajo incluso más intuitivo y comprensible que el que ofrece el entorno de AutoCAD. Esta alternativa gratuita a AutoCAD cuenta con una experiencia de más de 10 años de desarrollo a sus espaldas, por lo que es una de las alternativas más conocidas en el mundo y, además, es multiplataforma por lo que podrás utilizarlo indistintamente en sistemas Windows, OS X o GNU Linux. La parte negativa de QCad es solo ofrece soporte completo para diseños en 2D aunque, en contrapartida, ofrece un soporte total para la importación o exportación de archivos DXF y DWG nativos de AutoCAD. Encontrarás más información en su página oficial: QCad. DraftSight Es una herramienta profesional de diseño asistido por ordenador en 2D gratuito para uso personal, pero que cuenta con una versión de pago para uso profesional que añade algunas características extra. La versión gratuita de DraftSight es absolutamente operativa y permite crear, abrir, editar y guardar archivos en formato DXF y DWG nativos de AutoCAD. Además, permite exportar los proyectos a otros formatos de archivo (.wmf, .jpeg, .pdf, .png, .sld, .svg, .tif, y .stl) y general PDF multipágina, lo cual lo convierte en una herramienta con una amplia compatibilidad con otros programas y formas de utilizar los diferentes archivos de los proyectos. Hasta no hace mucho tiempo, DraftSight estaba disponible únicamente para plataformas Windows, pero ya puedes utilizarlo en sistemas GNU Linux y OS X, aunque por el momento estas últimas versiones todavía están en fase desarrollo y depuración. Además, DraftSight está disponible en diferentes idiomas. DraftSight es sin duda alguna una de las 5 mejores alternativas libres y gratis a AutoCAD. Encontrarás más información en su página oficial: DraftSight LibreCAD Es una de las 5 mejores alternativas libres y gratis a AutoCAD más extendidas y la que cuenta con una comunidad de apoyo y desarrollo más activa. Es una herramienta de diseño asistido por ordenador 2D que, además, es multiplataforma. Por lo que podrás utilizarla en tanto en sistemas Windows, GNU Linux y en ordenadores Mac. LibreCAD es un desarrollo paralelo (fork) que se basa en el código fuente otra herramienta de diseño asistido por ordenador de software libre llamada QCad Community Edition. Entre sus principales características destaca la de ser bastante ligera, por lo que podrás utilizarla en ordenadores antiguos o con recursos limitados. LibreCAD cuenta con una interfaz muy similar a la de AutoCAD, de modo que si ya has utilizado AutoCAD no te costará adaptarte a su entorno. La parte negativa es que sólo permite diseño 2D y solo es compatible con formatos de archivo DXF y CXF. Encontrarás más información en su página oficial: LibreCAD. FreeCAD. Esta herramienta de diseño asistido por ordenador ofrece una experiencia de uso y un entorno de trabajo increíblemente similar a la de AutoCAD, por lo que te será muy sencillo encontrar las herramientas y navegar por los distintos menús. FreeCAD es una herramienta de software libre de propósito general de modelado 3D CAD, MCAD, CAx, CAE y PLM basada en OpenCascade, un núcleo de geometría muy potente, y programada en Python. Esto le permite ser multiplataforma y estar disponible para sistemas Windows, OS X y GNU Linux. Esta alternativa gratis a AutoCAD está eminentemente dirigida a la ingeniería mecánica y al diseño de productos, ya que ofrece gran variedad de herramientas para asistir en el diseño de elementos mecánicos, aunque también se hace extensiva para un amplio rango de campos de diseño y otras ingenierías. Encontrarás más información en su página oficial: FreeCAD BRL-CAD. Esta herramienta de diseño asistido por ordenador fue desarrollada por el ejército americano en colaboración con la NASA, por lo que estamos seguros de que ofrecerá respuesta a la gran mayoría de tus necesidades de diseño y modelado tanto en 2D, como en 3D. BRL-CAD ofrece soporte multiplataforma, más de 400 utilidades, aplicaciones y librerías prediseñadas que te servirán para los propósitos más diversos. Desde crear modelos 3D, renderizar escenas, tratamiento de datos y análisis geométricos, etc. La parte negativa de BRL-CAD es que ofrece un sistema de trabajo algo diferente al que encuentras en AutoCAD, por lo que el proceso de adaptación a sus herramientas puede ser algo más complejo que en el resto de alternativas a AutoCAD. En su favor, más de 30 años de desarrollo durante los cuales se ha generado una cantidad enorme de documentación, que te permitirá resolver cualquier tipo de duda o problema que te pueda surgir. Encontrarás más información en su página oficial: BRL-CAD

Como cualquier otro componentes de nuestro ordenador, los discos duros pueden dejar de funcionar. Aunque es siempre recomendable realizar una copia de seguridad de nuestros datos, también resulta útil reconocer los síntomas que predicen la “muerte” de nuestra unidad de disco. De esta forma, podremos anticiparnos unos días al fatídico evento, y podremos realizar una copia completa de nuestros datos y prepararnos para llamar al servicio técnico en caso de que el disco todavía sea recuperable. Antes de continuar leyendo este artículo, tenemos que dar dos noticias: como siempre, una es buena y la otra no lo es tanto. La “mala” es que no siempre podremos predecir que algo está funcionando mal en nuestro disco duro, por lo que si no tenemos cuidado, simplemente dejará de funcionar y tendremos que contar con los servicios de una cara empresa especializada en la recuperación de datos. La buena es que en la mayoría de los casos sí que existen ciertas pistas que nos anuncian que algo no funciona todo lo bien que debiera. Algunos síntomas que nos indican que a nuestro disco duro no le queda mucho tiempo son los siguientes: Ruidos extraños Si escuchamos ruidos extraños provenientes de nuestro ordenador, podemos empezar a preocuparnos. Muchas veces, estos ruidos se producen cuando uno de los cabezales del disco duro se ha estropeado. Otra posibilidad es que no esté funcionando correctamente el motor que hace girar los discos. Si los ruidos son muy frecuentes y se suceden a gran velocidad probablemente no tengamos mucho tiempo. De hecho, cabe la posibilidad que el ordenador no vuelva a arrancar una vez lo hayamos apagado. Desaparición de documentos Uno de los síntomas más indicativos de que algo está fallando es cuando tenemos problemas a la hora de guardar y leer documentos. Normalmente el proceso comienza cuando nos damos cuenta de que algunos documentos que hemos guardado en días anteriores ya no están. El siguiente paso es que directamente la unidad de disco de vez en cuando no nos dejará guardar algún documento. Incluso que puede que algún programa que siempre ha funcionado con normalidad de repente deje de funcionar. Normalmente esto debería encender todas las alarmas. Algunos virus producen daños similares a los indicados pero en la mayoría de los casos conviene realizar una rápida copia de seguridad de todo lo que nos gustaría conservar y consultar con un técnico. Nuestro ordenador no reconoce una unidad de disco Si nuestro equipo deja de reconocer una de nuestras unidades de disco, probablemente la causa principal esté en la unidad misma, y no en otros componentes del ordenador. Una forma de comprobar esto es instalar la unidad de disco que no se reconoce en otro ordenador. Nuestro ordenador falla a menudo Si nos hemos acostumbrado a ver como el ordenador se bloquea, apareciendo la famosa “pantalla azul de la muerte” o se reinicia sin motivo aparente o incluso se apaga mientras estamos trabajando, muy probablemente el error que nos está haciendo perder tiempo y trabajo se halle en una de nuestras unidades de disco. Tiempos de acceso muy lentos Si tardamos mucho más tiempo del habitual en acceder a nuestro explorador de archivos o media hora en vaciar la papelera de reciclaje, seguramente algo en nuestro disco duro está funcionando muy mal. En el mejor de los casos, nuestra unidad de disco dejará de funcionar en el tiempo de uno o dos meses. Programas Para analizar y Optimizar tu Disco Duro: Todos los componentes de nuestro ordenador tienen un tiempo de vida más o menos limitado, debido a la obsolescencia programada. Pero tal vez el que más deba preocuparnos es nuestro disco duro, donde almacenamos toda nuestra información que no queremos perder. Además de ser uno de los componentes con peor fama de estropearse, ya que en él participan mecanismos móviles. Por ello, hoy os traemos una serie de herramientas para comprobar el estado de nuestro disco duro y que no se nos muera sin previo aviso cuando más lo necesitemos. CrystalDiskInfo Con esta herramienta podemos acceder a la información S.M.A.R.T, la temperatura, las horas que ha estado funcionando y demás parámetros de identificación como el número de serie o el fabricante. También analiza los discos duros externos que conectemos y tiene una función de advertencia para cuando uno de tus discos se calienta demasiado. Una de sus grandes ventajas es que es Open Source, y tiene una versión portátil para utilizarlo en cualquier ordenador desde un USB. http://crystalmark.info/download/index-e.html HDDScan Es un programa portátil, por que tampoco requiere de instalación y podrás llevarlo siempre contigo. La interfaz es bastante antigua, pero agradable a la vista y es una de las mejores herramientas que puedes encontrar a día de hoy. Sobretodo por las gráficas, que te muestran la información de una manera sencilla y entendible. Te avisa sobre excesos de temperatura, muestra la información S.M.A.R.T y tiene diversos tests de verificación, lectura y borrado de datos. Además cuenta con una función interesante, como es elanálisis de daño de transporte, para comprobar que el disco duro sigue en buen estado tras un viaje. Pero debéis tener en cuenta que para que los análisis sean correctos, ejecutadlos sin otras aplicaciones haciendo uso del disco duro. http://hddscan.com/ EASIS Drive Check Esta es la herramienta con la interfaz gráfica más sencilla. No requiere conocimientos técnicos para entender los análisis, ya que muestra los resultados de una forma muy visual. De hecho, es tan sencilla que apenas tiene 2 opciones: realizar un análisis de los valores S.M.A.R.T o un test de superficie El primero es el más rápido, durando apenas unos segundos y mostrará los datos como se observa en la imagen. Las zonas en rojo son las que te indican en qué factores puede estar flojeando tu disco duro. El de superficie es mucho más detallado y puede llevarte unas horas, pero sabrás con todo lujo de detalles si hay sectores defectuoso. http://www.easis.com/easis-drive-check.html Hard Disk Sentinel Se encarga de que tu disco duro esté en unas condiciones óptimas, avisando al momento de problemas como el sobrecalentamiento, vibraciones y otros. Además, tiene la ventaja de que puede estar en segundo plano todo el tiempo sin apenas consumir recursos. Aunque no es un programa extremadamente avanzado, sirve para cumplir con las cosas básicas sin demasiadas complicaciones. http://www.hdsentinel.com/download.php HDD Health Es una herramienta de lo más sencilla que también se queda trabajando en segundo plano. Posee un icono en la barra de herramientas que al pasar el ratón, nos da información sobre el estado de nuestros discos duros. Haciendo doble click sobre este, se nos abrirá la aplicación con una interfaz de lo más visual, mostrando indicadores de salud, temperatura y la opción de analizar sus parámetros S.M.A.R.T. También te permite configurar notificaciones cuando quede poco espacio en el disco o su salud esté muy deteriorada. http://panterasoft.com/hdd-health/ DiskCheckup Otra herramienta poco potente, pero de lo más sencilla con la que hacer los diagnósticos básicos del disco duro. Posee notificaciones para temperaturas altas, monitorización del estado del disco e información S.M.A.R.T. Su interfaz es de lo más sencilla, pero si incluye un test de escritura y de lectura para que sepas cómo está rindiendo. Es decir, cumple su función para que sepas si las cosas van bien o no. http://www.passmark.com/products/diskcheckup.htm Acronis Drive Monitor A pesar de su anticuada interfaz y sus pocas posibilidades, es uno de los más faciles de entender de la lista. Se muestran tus discos y su estado de salud, con detalles como la temperatura y el tiempo que llevan funcionando. Al lado tendremos otras dos pestañas para acceder de forma sencilla a los parámetros S.M.A.R.T y para los eventos de errores que pudiese suceder. http://www.acronis.com/en-us/personal/hard-drive-health/

Excel más fácil y sencillo, lo que debes saber si comienzas a usarlo. Como crear tablas, gráficos, dar formato y un estilo personal a tus documentos de forma rápida. Como insertar la fecha, hora, imágenes. Las combinaciones de teclas más útiles e imprescindibles. Excel es un programa para crear y procesar hojas de cálculo. Está incluido en la suite o paquete de programas Office de Microsoft. Con Excel podemos crear tablas, listas, gráficos, y procesar todo tipo de datos ya sean numéricos o alfanuméricos (letras). Se utiliza mucho en el sector empresarial en tareas de economía, contabilidad, estadística, financieras, ventas, así como por investigadores, científicos, estudiantes y por cualquiera que necesite crear informes o guardar datos de forma ordenada en un documento. En la vida real la gran mayoría de los que abrimos una hoja de cálculo de Excel no somos especialistas en lo absoluto y solo necesitamos usarlo esporádicamente como una herramienta auxiliar en nuestro trabajo, estudio o en el hogar. Trucos para usar y aprovechar Excel al máximo Para esa gran mayoría va dirigido este artículo que de forma modesta resume las cosas más útiles que debemos saber sobre Excel. Existen muchos trucos desconocidos que teniéndolos a mano nos facilitan hacer nuestras tareas mucho más sencillas o rápidas. Lógicamente ninguno de nosotros tiene el tiempo para leerse el manual completo de la aplicación. Excel es un programa que posee la virtud de la sencillez y al mismo tiempo es tan complejo, que conocerlo a fondo requiere años de experiencia y dedicación. Repetimos este artículo no es un tutorial sobre cómo usar Excel, es solo una colección de cosas que pueden resultarles útiles a los que comenzamos a usarlo. Todos los trucos, funciones y métodos del teclado en este articulo, funcionan en las últimas versiones de Excel (2007-2010). Las acciones elementales en Excel Copiar el contenido de una celda Para copiar el contenido de una cela a otras adyacentes rápidamente, da un clic en el pequeño cuadrado del vértice inferior izquierdo y sin soltar el botón arrastra sobre las celdas donde se quiere pegar. Es posible pegar el valor, pero también solo el formato, para eso da un clic en el icono que aparece de "Opciones de autorrelleno" y selecciona lo que se necesite pegar. Otras opciones son: • Copiar el valor de una celda superior: CONTROL + J • Copiar el valor de la celda a la izquierda: CONTROL + D Escribir el mismo valor en varias celdas Podemos insertar el mismo valor en varias celdas al mismo tiempo. Haz lo siguiente: • Selecciónalas arrastrando el cursor o usando la tecla CONTROL si no están adyacentes. • Escribe el valor. • Presiona las teclas CONTROL + Enter. Cambiar el formato de las celdas Algunas combinaciones de teclas permiten cambiar el formato de una celda rápidamente: Poner en negritas: CONTROL + 2 (También Control + N) Poner en cursiva: CONTROL + 3 (También Control + K) Subrayar: CONTROL + 4 (También Control + S) Tachado: CONTROL + 5 Insertar una nueva hoja en un libro de Excel Al crear un libro nuevo este tiene tres hojas que se pueden seleccionar por las pestañas en la parte inferior izquierda. Para agregarle otra usa las teclas MAYUS + F11, se agregará y ocupará el lugar de la primera. Crear una nueva línea en una celda Cuando agregamos texto en una celda texto y sobrepasa sus límites, hay dos formas de lograr que se muestre correctamente: Usar la opción Ajustar texto. Da un clic en el botón "Ajustar texto" de la herramienta Alineación.Crear un salto de línea. Para crear un salto de línea da un clic donde terminará una de ellas y usa las teclas ALT + ENTER. El resultado parece el mismo pero son totalmente diferentes, lo que puede comprobarse dando más ancho a la columna temporalmente. Crear tablas y gráficos mas fácil en Excel Crear una tabla en Excel con los valores de las celdas seleccionadas Crear una tabla en Excel seleccionando los datos es algo sencillo, se puede escoger entre varios estilos y posteriormente personalizarla. Para crear una tabla selecciona las celdas que contienen los valores. En la sección Estilos de la ficha Inicio da un clic en: "Dar formato como tabla". En el menú escoge uno de los estilos. Si no quedas satisfecho usa las teclas CONTROL + Z y vuelve a comenzar.Guíate por la siguiente imagen de ejemplo: Usar el formato condicional en las tablas de Excel El formato condicional es simplemente darle un formato diferente a cada celda, de acuerdo a su valor. En la siguiente imagen de ejemplo se muestra cómo usarlo en una columna de una tabla, para mostrarnos de color verde los valores óptimos (en este ejemplo) y en una escala que va hasta el rojo con los valores mínimos, las otras celdas. Crear un gráfico en Excel con los valores de las celdas seleccionadas Para crear un gráfico rápidamente que se abra en una nueva pestaña, solo selecciona las celdas que contienen los valores y presiona la tecla F11. Prueba varias combinaciones seleccionando áreas diferentes. Posteriormente para personalizar el grafico a tu gusto usa la ficha: "Herramientas de gráficos". Una opción aún más sencilla es incrustar un gráfico en la misma hoja, para eso usa las teclas: ALT + F1. Crear una página web con el gráfico También tienes la opción de crear una página web con el grafico hecho. Para eso usa el menú: "Archivo -> Guardar como..." En Tipo selecciona: "Pagina web". Marca en Guardar: "Selección gráfico" y presiona el botón: "Publicar". Si solo te interesa la imagen creada, recupérala de la carpeta auxiliar de la página en la ubicación donde se guardó. Las combinaciones de teclas más usadas y útiles de Excel Es posible hacer todo tipo de cosas usando las teclas o combinaciones de ellas. Es casi imposible aprendérsela todas ni hace falta, solo necesitamos aprender las elementales que se aplican a nuestras tareas. La lista de todas las combinaciones se puede encontrar en el archivo de ayuda de la aplicación, que se abre con F1. Insertar la fecha en Excel Para que se muestre la fecha en cualquier celda seleccionada usa las teclas: CONTROL + , (coma). Insertar la hora en Excel Para que se muestre la fecha en cualquier celda seleccionada usa las teclas: CONTROL + ; (punto y coma). En los dos casos los datos que se muestran son estáticos, es decir seguirán siendo los mismos cada vez que se abra la hoja. Puedes usarlos por ejemplo para mostrar una fecha y hora determinada. Para mostrar la fecha y hora de forma dinámica, es decir que refleje exactamente la actual, independiente de cuando se abra la página, es necesario usar las funciones AHORA, HOY y HORA Es algo sencillo solo da un clic en la celda donde se desean mostrar los datos y en la barra de fórmulas escribe cualquiera de las siguientes funciones y presiona la tecla Enter: AHORA() Se mostrará: 09/07/2013 12:36 HOY() Se mostrará: 09/07/2013 ¡Ojo! estos ejemplos lógicamente son estáticos. Para conocer todas las funciones disponibles en Excel presiona la tecla F1, escribe en el cuadro de búsqueda: "lista de funciones por categorías" y presiona Enter. Repetir la última acción realizada Al usar la tecla F4 Excel repite lo último que hicimos. Por ejemplo si le dimos un color determinado al texto en una celda, posteriormente seleccionamos un rango de ellas y presionamos la tecla F4, quedarán idénticas a la primera. Otras teclas útiles para los que comienzan en Excel F10Activa la sugerencia de teclas. Se muestran los nombres de las teclas que se pueden usar conjuntamente con ALT para abrir las fichas y funciones del programa.F7Abre el corrector ortográfico. Otros trucos para Excel Como darle el mismo ancho a varias columnas en Excel A menudo queremos que varias columnas queden exactamente del mismo ancho, pero hacerlo manualmente es muy tedioso, se puede hacer de forma sencilla. Da un clic derecho en la cabecera de la columna que posee el ancho deseado, en el menú selecciona: "Copiar". Selecciona las que se desean igualar. Da un clic derecho encima de cualquiera de los encabezados y el menú selecciona: "Pegado especial > Ancho de las columnas". Como introducir números fraccionarios en Excel Al tratar de escribir la fracción de un número, por ejemplo 1/2, Excel devolverá una fecha, en este caso: "01-feb" ya que el carácter / (barra inclinada) se usa para fechas. Para solucionarlo es necesario especificar en Formato de celdas la opción "Fracción". Es más sencillo hacerlo de la siguiente forma. Antecede un cero u otro número entero dejando un espacio. Por ejemplo: 0 1/2 se mostrará en Excel: ½ Capturar e insertar imágenes de páginas web En Excel 2010 al igual que en Word es posible hacer capturas de pantalla de aplicaciones en el equipo y también de imágenes existentes en páginas de internet, sin tener que descargarlas. Para eso en la ficha Insertar da un clic en "Captura". Mira un ejemplo a continuación:

Como todos sabemos 2015 es el año del 4K, entonces ah todo esto, nos preguntamos ¿Cuanta VRAM precisamos para jugar a 1080p, 1440p o 4K? En la red circulan muchos informes, informes que son muy contradictorios, es mas ahora con el ingreso de la memoria HBM de AMD, que realizara un balance de ancho de banda y que viene en un paquete de 4 GB de memoria HBM, vamos a tener que empezar a hacer cuentas. hora si vemos la mayoría de las tarjetas gráficas tope de gama vienen con 4 GB de memoria, pero si vemos la Titan X viene con 12 GB, y si nos movemos mas a lo nuevo tenemos la Geforce GTX Ti con 6 GB de VRAM. AMD hara las cosas a la inversa, la grafica Fury que sera la tope de gama vendrá con 4 GB de memoria HBM, mientras que la Radeon R9 390X contara con 8 GB de memoria GDRR5. Pero.. para jugar en 4K lo que necesitamos realmente son 6-12 GB? Es por eso que TweakTown realizo un informe muy preciso de cuanto precisamos. Para las pruebas utilizaron una NVIDIA GeForce GTX 980 Ti en un monitor 4K para hacer todas las pruebas y para ver cuánto se utiliza de VRAM en tres diferentes resoluciones: 1080p, 1440p y 4K. Los gráficos muestran cuantos pixeles se utilizan en cada configuración (resolución): Bien si vemos que en 1080p, el numero de pixeles es de 124 millones, (recordemos que las consolas de ultima generación que van a unos 720p – 900p, prestan unos 55 millones de píxeles por segundo), ahora si subimos a 1440p el salto es de unos 221 millones. La cosa empieza a ponerse seria cuando vemos que a los 4K los pixeles por segundos saltan a unos 497 millones @ 60 Hz. Ahora vamos con las pruebas en juegos y programas de Benchmark. Configuración utilizada: CPU : Intel Core i7 5820K w / Corsair H110 refrigeradorMotherboard : GIGABYTE X99 Gaming G1 Wi-FiRAM : 16 GB Corsair Vengeance 2666MHz DDR4Almacenamiento : 240 GB SanDisk Extreme II y 480 GB de SanDisk Extreme IIChasis : Lian Li T60 del boxPSU PSU Corsair digitales AX1200i:Software : Windows 7 Ultimate x64 Las pruebas se realizaron bajo una configuración normal, y grabaron su uso promediando el uso de VRAM en Megabytes (1400MB = 1,4 GB). Vamos con todas las pruebas: 3DMark Ungine Heaven – 4K Surround Battlefield 4 Metro Last Light Shadow of Mordor Grand Theft Auto V Theif BioShock Infinite Resultados: 1080p: En 1920×1080, vemos un promedio de alrededor de 1,5 GB a 2 GB de VRAM siendo utilizados, el GTA V estuvo todo el camino a 3.7GB, mientras que Shadow of Mordor llego a 3.3GB. 1440p :Ahora a una resolución de 2560×1440, vemos como GTA V consume un total de 3,9 GB VRAM y Shadows of Mordor, utiliza 3,5 GB de VRAM. Thief se mantiene en los 2,9 GB de VRAM, mientras que Battlefield 4 en el preset Ultra, solamente está consumiendo 2.2GB de VRAM. 4K : En 4K vemos que Thief y GTA V, utilizan 4.3GB de VRAM, mientras que la Shadow of Mordor no se queda atrás con 3.9GB siendo utilizados, todo a 4K . Battlefield 4 sólo utiliza 3 GB de VRAM, que es bastante sorprendente. Conclusiones: Podemos ver que 4 GB de VRAM son mas que suficientes para la mayoría de las tarjetas de vídeo, incluso a 4K. En estas pruebas no se han tomado en cuenta el anti-aliasing. Lo que ha demostrado TweakTown con esta prueba es que 8 GB de VRAM es bastante inútil en este momento, “simplemente no hay necesidad”. Claro esta que si permitimos el anti-aliasing el consumo de VRAM va a dispararse por encima de los 4 GB, por lo que se ha demostrado que la mayoría de los videojuegos, no consumen mas de 4GB de VRAM, así que al momento de comprar una tarjeta podemos confiar en que los 4GB o 6GB de memoria serán mas que suficientes para correr la mayoría de los juegos en 4K.

Primero veremos los Requisitos a cumplir por la fuente de alimentación en función de la tarjeta gráfica: El consumo del equipo es una cuestión crucial para los usuarios de PCs. A medida que ha ido aumentando la capacidad de procesamiento de las tarjetas gráficas, la demanda de energía para hacerlas funcionar se ha visto igualmente incrementada. Mientras que los fabricantes de microprocesadores están dirigiendo sus investigaciones en conseguir CPUs cada vez más eficientes, las tarjetas gráficas actuales tienden a consumir cantidades ingentes de energía, convirtiéndose como consecuencia en el componente determinante a la hora de elegir la fuente de alimentación para nuestro equipo, ocupando el segundo puesto de la lista el microprocesador. Así pues, los fabricantes de fuentes de alimentación han ido sacando al mercado productos cada vez más potentes para satisfacer las necesidades de nuestros equipos. El cuello de botella, sin embargo, lo produce la conexión PCI-Express x16, que se limita a suministrar a la tarjeta gráfica un máximo de 75W, insuficiente a todas luces para muchos modelos actuales. Para solventar este problema, las tarjetas gráficas toman la energía que necesitan para funcionar a través de conectores PCIe adicionales, los cuales pueden ser de 6-pin (75W) o de 8-pin (150W), por lo que hemos de tener en cuenta a la hora de comprar una fuente de alimentación, no solo si será capaz de suministrar toda la potencia que vamos a necesitar, sino también si nuestra nueva fuente de alimentación viene con todos los conectores que vamos a necesitar. Los conectores (6+2)-pin PCIe están diseñados de esta manera para que puedan ser utilizados como conectores de 6-pin o de 8-pin según se necesite. Así pues, el objetivo de este artículo es ayudar a alcanzar un mejor conocimiento sobre la fuente de alimentación que se necesita en cada caso dependiendo del componente más ávido de energía en un PC: la tarjeta gráfica. El valor de “Fuente de alimentación recomendada” recoge el consumo del ordenador en su conjunto, no solo el de la/s tarjeta/s gráfica/s. Las recomendaciones aquí ofrecidas están basados en todo nuestro mejor conocimiento. Complementariamente, consideramos oportuno utilizar la siguiente herramienta, que nos va a permitir recoger información adicional sobre el consumo que va a tener nuestro equipo: Calcula cuanta energia consume tu pc: http://extreme.outervision.com/psucalculatorlite.jsp ¿Que consumo tiene cada placa? Otros post que te pueden interesar: http://www.taringa.net/post/info/18776866/Como-elegir-una-fuente-de-poder-PSU-para-nuestra-PC.html http://www.taringa.net/post/info/18756334/Como-elegir-una-motherboard-para-nuestra-PC.html http://www.taringa.net/post/info/18720307/Que-microprocesador-elegir-para-nuestra-pc.html http://www.taringa.net/posts/info/18722080/Cuanta-VRAM-precisamos-para-jugar-en-1080p-1440p-y-4K.html

Los griegos votaron este domingo en un referendo que muchos consideraron clave para el futuro del país, pero también para el del euro y de la misma Unión Europea. El resultado fue un contundente rechazo a las exigencias de la "Troika" del Fondo Monetario Internacional, el Banco Central Europeo y la Comisión Europea, que pedían más ajuste fiscal para la extensión de un programa de ayuda financiera. Con 100% de los votos contados, el 61% de los electores en Grecia votaron por el "No" en el referendo. Pero, ¿qué votaron exactamente los helenos y por qué fue tan importante la votación para el resto del continente? Y, tal vez más importante, ¿cómo se llegó ahí? Les presentamos las respuestas a estas y otras preguntas fundamentales paraentender la crisis griega en esta guía de BBC Mundo. 1. ¿Cuál es la causa de la crisis griega? La base de la crisis griega es una deuda de aproximadamente 320.000 millones de euros (unos US$358.000 millones), que el país simplemente no está en condiciones de pagar. La explicación más simple para la misma es que durante muchos años el país estuvo gastando más dinero del que producía y financiando ese gasto a través de préstamos. Grecia ya hacía eso antes de adoptar el euro. Y la llegada de la moneda común en 2001 no cambió las cosas, como en teoría debía suceder. El gasto público, por ejemplo, aumentó un 50% entre 1999 y 2007, mucho más que en otros países de la eurozona. Y sumado a problemas de corrupción y evasión fiscal, reconocidos por la propia Grecia, esto terminó provocando un déficit muy superior al 3% del PIB contemplado en las reglas de moneda común. Préstamos no declarados a la eurozona, por su parte, también llevaron a que la deuda excediera significativamente el 60% acordado como límite por los países de la eurozona: actualmente se estima en 177% del PIB. El problema, sin embargo, solo se volvió urgente cuando la crisis financiera global limitó el acceso griego al crédito, lo que motivó la intervención de los otros países de la eurozona temerosos del impacto de una cesación de pagos odefault. Aunque, para muchos economistas, las medidas de austeridad impuestas como condición para financiar un rescate financiero, o bailout, terminaron agravando la situación. 2. ¿Qué se ha estado haciendo para salir de la crisis? El primer paquete de ayuda financiera a Grecia fue aprobado por la Unión Europea y el Fondo Monetario Internacional en mayo de 2010. En ese momento se pusieron a disposición del gobierno griego 110.000 millones de euros (unos US$120.000 millones) para que honrara sus compromisos con sus acreedores, en ese momento en su mayoría bancos privados de la región. Pronto, sin embargo, se hizo evidente que ese monto no sería suficiente, por lo que un segundo rescate elevó la cifra total a 240.000 millones de euros. Y, en ambos casos, como condición para facilitar el dinero se identificaron una serie de medidas de austeridad. Estas han incluido drásticos recortes del gasto público, mayores impuestos y reformas al sistema de pensiones y el mercado laboral. Pero el actual gobierno griego, que llegó al poder a inicios de año con una plataforma anti-austeridad, ha estado intentado renegociar algunas de esas condiciones de cara a un nuevo paquete de rescate estimado en 29.100 millones de euros adicionales. 3. ¿Cuál ha sido el impacto de las medidas anti-crisis? ¿Han funcionado? Para saber si las medidas asociadas al rescate financiero han funcionado, primero hay que ponerse de acuerdo sobre el principal objetivo del mismo. Si lo que se buscaba era proteger el euro, por ejemplo, entonces parecen estar funcionado. Aunque sólo sea por el momento. ronto, sin embargo, se hizo evidente que ese monto no sería suficiente, por lo que un segundo rescate elevó la cifra total a 240.000 millones de euros. Y, en ambos casos, como condición para facilitar el dinero se identificaron una serie de medidas de austeridad. Estas han incluido drásticos recortes del gasto público, mayores impuestos y reformas al sistema de pensiones y el mercado laboral. Pero el actual gobierno griego, que llegó al poder a inicios de año con una plataforma anti-austeridad, ha estado intentado renegociar algunas de esas condiciones de cara a un nuevo paquete de rescate estimado en 29.100 millones de euros adicionales. Efectivamente, los préstamos coordinados por el FMI, la Comisión Europea y el Banco Central Europeo –la denominada troika– han ayudado a reducir el impacto de la crisis griega sobre la moneda común. Pero economistas de la talla de Paul Krugman y Joseph Stiglitz –ganadores del premio Nobel de economía en 2008 y 2001, respectivamente– consideran que las medidas no han hecho nada por mejorar la situación o las perspectivas de Grecia. De hecho, se estima que la economía griega se ha reducido en un 25% desde el inicio de los programas de austeridad, lo que ha acentuado su dependencia en créditos externos. Y el impacto de las medidas sobre el pueblo griego ha sido brutal: su tasa de desempleo del 26% es la más alta de toda la Unión Europea y entre los jóvenes ya supera el 60%. Ya son millones los ciudadanos griegos que están viviendo bajo la línea de pobreza. Esta situación fue, de hecho, lo que llevó al poder a Syriza, el partido que mejor supo recoger el descontento generado por las medidas de austeridad. Y los intentos del actual gobierno de izquierda por renegociar las condiciones son los que han llevado la crisis a lo que parece ser –con el perdón de la redundancia– su momento más crítico. O, al menos, a un momento de definición que podría tener importantes consecuencias para el futuro de la moneda común. 4. ¿Cuál es la situación actual? El escenario más temido al inicio de la crisis –una cesación de pagos– empezó a hacerse realidad el pasado 30 de junio por la noche, cuando Grecia no logró honrar un pago de unos 1.500 millones de euros (US$1.780 millones aproximadamente) adeudados al FMI. Grecia se convirtió así en el primer país desarrollado en entrar en mora con el FMI y su impago en el más grande en la historia del organismo multilateral, aunque técnicamente todavía no ha sido declarada en default. Y el mismo martes 30 también se venció el último programa de ayuda financiera, luego de que el gobierno griego no aceptara la última serie de condiciones de la troika por considerarla "humillante". Aunque ya antes el gobierno de Alexis Tsipras había anunciado que dejaría la decisión final en manos de la ciudadanía, para lo que convocó al referendo. Las últimas encuestas adelantaban que la mayoría de los griegos se inclinarían por rechazar más medidas de austeridad. Aunque la ventaja del "No" pareció reducirse después de que Atenas impusiera un"corralito financiero" con el que intentar evitar retiros masivos que agraven la situación. El primer ministro griego, sin embargo, dejó claro que para él la posibilidad de una negociación –y por consiguiente de un acuerdo de última hora– se mantiene abierta. Pero hasta antes del referendo sus contrapropuestas habían sido consideradas insuficientes. Y la canciller alemana, Angela Merkel, dijo que había que esperar el resultado del referendo -un abrumador no- antes de pensar en reabrir una negociacióncon el gobierno de Atenas. 5. ¿Cuáles son los puntos más contenciosos? En su última contrapropuesta, el gobierno griego prácticamente aceptó la mayor parte de las demandas de la troika. Pero, entre otras cosas, solicitó más tiempo para implementar la reforma del sistema de pensiones –una de las principales exigencias de sus acreedores– y pidió mantener excepciones para el cobro del IVA en sus islas, que son uno de los principales destinos turísticos del país. Los líderes de la eurozona, sin embargo, no se mostraron dispuestos a reabrir negociaciones incluso después de lo que algunos analistas presentaron como una capitulación. Y eso ha hecho que muchos concluyan que las principales diferencias ya no son tanto técnicas, sino políticas. O, dicho más sencillamente, que los principales líderes de la eurozona quieren botar al gobierno de Tsipras para evitar que su postura anti austeridad contagie a otros países de la región. 6. Y entonces, ¿sobre qué votaron los griegos? La pregunta sometida a referendo fue tremendamente específica, redactada en unlenguaje bastante técnico, no particularmente fácil de comprender. "¿Debe ser aceptado el acuerdo propuesto, que fue presentado por la Comisión Europea, el Banco Central Europeo y el Fondo Monetario Internacional en el Eurogrupo del 25.06.2015 y consiste de dos partes, las que constituyen su propuesta unificada?", se leía en la boleta, en la que luego se especificaban los títulos de los documentos en cuestión. Y luego se ofrecían dos simples opciones: sí o no. Los puntos centrales de la propuesta ahora rechazada eran una ampliación de la base del IVA y una reducción drástica del número de personas que pueden optar a un retiro anticipado. Y los acreedores también demandaban más acciones para reducir la evasión fiscal y acabar con la corrupción. El gobierno griego, sin embargo, ha sostenido que las demandas específicas de la troika además de poco efectivas son humillantes y por lo tanto inaceptables. Y para ellos la cuestión es mucho más simple: es si los griegos deben seguir padeciendo más medidas de austeridad o no. Esta decisión podría además decidir la continuidad del gobierno de Tsipras, quien ya dijo que en caso de victoria del "sí" respetará la decisión de los griegos pero no se quedará para implementar la propuesta del Eurogrupo. Por el momento, ya renunció el ministro de Finanzas de Grecia, Yanis Varufakis. Anunció su dimisión a primera hora de este lunes. Por su parte, los líderes europeos, empezando por Merkel, insistían en que la pregunta era otra, aunque igualmente sencilla. Afirmaban que lo que los griegos debían decidir el domingo era si quieren que su país siga siendo parte del euro o no. 7. ¿Es inevitable una salida del euro ahora que ganó el "No"? La verdad es que nadie lo sabe con certeza. No existe ningún precedente y el mismo vicepresidente del Banco Central Europeo, Vitor Constancio, dijo en abril pasado que no había ninguna ley que ordenara la expulsión de la eurozona en caso de default. El gobierno griego insiste además en que no está intentando abandonar la moneda común e incluso insinuó que podría iniciar procesos legales en caso de que los otros países de la eurozona intenten expulsarlo del club. Los principales líderes europeos, sin embargo, lo han dicho claramente: la votación del domingo era sobre conservar el euro o no. Y si no existe voluntad política para mantener a Grecia en el euro, lo que digan las actuales leyes y reglamentos de la Unión Europea podría no importar. Efectivamente, si el Banco Central Europeo decide detener completamente el crédito hacia Atenas, las autoridades griegas no tendrían más opción que empezar a imprimir su propia moneda para intentar mantener su economía funcionando. Y el "Grexit", como se ha dado en llamar a la salida de Grecia del euro, sería una realidad. 8. ¿Cuáles serían las consecuencias de una salida griega del euro? La UE ha estado trabajando duro para intentar aislar al euro y la eurozona de los problemas de Grecia y de una eventual salida de la moneda común. En el fondo, casi todo depende de la voluntad política de los líderes europeos.Pero el mismo FMI advirtió que "los riesgos y vulnerabilidades aún no han desaparecido" y es difícil predecir el comportamiento de los mercados si el escenario más temido por todos se hace realidad. Una posibilidad es que los compradores de bonos de las naciones de la eurozona con más problemas empiecen a exigir pagos más altos para compensar los riesgos de su inversión. Eso afectaría negativamente a la moneda europea y aumentaría la inestabilidaden países con un peso mayor en la economía global. Y una Grecia insolvente implicaría importantes pérdidas de dinero para varios países europeos. Además, también está el riesgo de un contagio político. Efectivamente, si la salida del euro se muestra como una opción viable –e incluso beneficiosa para Grecia– otras naciones podrían verse tentadas a seguir el ejemplo. Y eso podría poner en riesgo a la misma Unión Europea, que ha puesto a la moneda común en el centro de su proyecto de integración. La salida del euro podría además forzar la salida de Grecia de la UE. Pero, como sucede con muchos de los otros escenarios, todo dependerá de la voluntad política e imaginación que muestren los líderes europeos. Actualizado el 6 de julio de 2015.

como elegir una motherboard para nuestra PC En esta guía nos centraremos en que mother elegir en base al microprocesador que es de nuestro interés y del uso que le vamos a dar. El motherboard están importante como el microprocesador a la hora de conseguir el máximo perfomance posible de muestra PC, al igual que los microprocesadores estas también se dividen en gamas y usos específicos, pero aquí es donde termina sus similitudes a la hora de elegir la correcta, a estas dos características debemos sumar, socket, chipset, numero de puertos USB 3.0 o 2.0, numero de puertos PCI-E 16x 3.0 o 2.0, numero de fases de poder (vrm), entre otras cosas. Socket ¿Que es? Pregunta común, muchas veces se confunde o se usan como sinónimos socket y plataforma, cuando en realidad son cosas diferentes, socket no es mas que la interface que une al microprocesador con la motherboard, y como vemos hay una gran variedad, mas por el lado de AMD, am3+, fm2+, am1 como las actuales (algo muy similar pasa en Intel, pero por suerte en esta suelen mantener un socket por al menos dos años o dos generaciones estos socket), no son compatibles, así que no podemos usar un micro am3+ en un socket am1 y viceversa, estos es algo que se debe tener en cuanta cuando queremos hacer un upgrade de solo micro procesador o elegir una motherboard adecuada. Qué es? ¿Para que sirve? ¿Influye en el rendimiento? Dudas que ha algunos se les pasa por alto o no le dan importancia. ¿Que es y para que sirve el chipset? El chipset es el controlador principal de las funciones del Motherboard ( chips de audio, puertos USB, puertos PCI, etc) y nexo o puente de estas con el microprocesador, al igual que el microprocesador, tiene una frecuencia base denominada bus que determina la capacidad de datos que puede transmitir del microprocesador a los demás componentes, esta se denomina en AMD HTlink y en Intel BCLK, esto no influye en el rendimiento general de la PC, o si lo hace, es completamente imperceptible. Existen 2 tipos de chipset, el southbridge y northbridge (principal), cada uno tiene una función y controla distintos sectores del Motherboard. Nota: Intel comenzó a incorporar el Northbridge desde el lanzamiento de la segunda generación de core I dentro del DIE del microprocesador. Puertos usb Estas son unas de las conexiones mas comunes y que muchas veces no influyen en la compra de un Motherboard, ya que en todas las gamas tenemos un buen numero, este número está determinado por el Chipset Southbridge(AMD no posee de forma nativa USB 3.0, el numero de este puerto depende de chips de fabricantes externos). Puertos PCI-E 16x 2.0 o 3.0 Este es un punto que a más de unos suele confundir, puesto que actualmente se encuentran conviviendo las diferente generaciones (1.0, 2.0 y 3.0), por suerte este puerto es retro compatible, no hay problemas a la hora de compartir periféricos entre una generación y otra. Pero esto influye en el rendimiento (vgas)?. Como ya sabemos entre las distintas generaciones de PCI-E 16x se duplico el ancho de banda para la transmisión de datos, pero no se vio como un gran cambio entre la generación 2.0 y 3.0, ya que actualmente no existe VGA que sature el ancho de banda que brinda la segunda generación. Como el grafico lo demuestra. Ancho de banda: como ya se dijo, al día de hoy no existe VGA que sature el ancho de banda de la segunda y tercera generación de este periférico. Crossfire/SLI: si estamos buscando armar una configuración con estas características debemos tener en cuenta el número de líneas pci-e que puede manejar el Chipset de la Mother que vamos a elegir, ya que una Motherboard que cuenta con pocas líneas podría influir en el rendimiento final, como verán en gráfico anterior sobre el ancho de banda, a menor cantidad de líneas ( 16x, 8x, 4X, 2x, 1x) menor será el ancho de banda, en el PCI-E 3.0 no tendremos este problema, o por lo menos no seria notorio, pero en el 2.0 ya existe una pérdida de rendimiento a partir de una entrada X4. Entonces, ¿que Chipset es ideal para usar esta configuración, Crossfire/SLI?. En conclusión podemos decir que para este tipo de configuración son ideales las chipset 990FX por el lado de AMDy el chipset serie Z97 por el lado de Intel. Nota: solo Intel cuenta con PCI-E 3.0 en toda su gama, en AMD solo los APU serie 7000 cuentan con PCI-E 3.0. Fases de poder o VRM Las fases de poder o VRM, son uno de los elementos más importantes dentro de nuestra Motherboard, estos regulan y mantienen un voltaje al microprocesador, ya que un sistema de VRM que no cumple con los requerimientos de alimentación de nuestro microprocesador podría generar una caída de rendimiento del mismo, sobre calentamiento o dañar la misma Motherboard por una sobre carga ( estos problemas ya no son muy comunes, pero aún se presentan en algunas Mothers de gama baja para los Fx), además estos son fundamentales si queremos realizar Overclock a nuestro microprocesador, lo ideal para ellos es un sistema de fases de mínimo 6+2, 6 para el microprocesador y 2 para la alimentación de las Rams, para un uso básico en sistema de 4+1 (para AMD) o 3+1 ( para Intel) es más que suficiente. para concluir: Existen varios formatos entre los que destacan mini-ITX, micro-ATX, ATX, EATX (por orden de tamaño). Por norma general, a mayor tamaño posibilitan mayor capacidad de expansión tanto en slots PCI Express como en puertos SATA/USB.Las placas que permiten usar las gráficas integradas, incorporan salidas de video en su zona trasera (D-Sub/VGA, DVI, HDMI, DisplaPort, Thunderbolt).Es importante que una placa nueva disponga de puertos USB 3.0 ya que es un estándar en expansión y cada vez más adoptado para la conexión de periféricos.Algunas placas incluye una tarjeta Wifi y/o Bluetooth, ya sea integrado junto a los conectores traseros (realmente un dispositivo USB) o como tarjeta PCI Express.Debemos comprobar que es compatible con el sistema multi-gráfica de la marca elegida si tenemos interés en ello. Es decir, que soporte Nvidia SLI o AMD CrossFire en función de la gráfica que adquiramos.Las placas de AMD no incorporan PCI Express 3.0 pero está demostrado que las gráficas actuales no requieren más ancho de banda que el ofrecido por PCI Express 2.0.La gran mayoría de placas actuales incorporan BIOS UEFI (con interfaz gráfica) y Dual BIOS (dos BIOS por si una falla arrancar desde la alternativa).Se suele integrar una controladoras para ampliar la capacidad de expansión tanto en puertos SATA (no ofrecen el mismo rendimiento) como USB.Todas (¿) las placas integran tarjeta de sonido de al menos 5.1 canales, pudiendo encontrarlas con 7.1 canales y salidas digitales. Además integran tarjeta de red Ethernet habitualmente Gigabit (10/100/1000).ASRock, Asus, Gigabyte y MSI son marcas de gran calidad, pudiendo seleccionar entre ellas indistintamente.Un aspecto que se traduce en “mejor placa” es un mayor número de fases VRM o la inclusión decondensadores sólidos, chokes de ferrita y disipadores para estos componentes.Las placa base tope de gama rara vez compensan lo que cuestan. Son para presupuestos muy muy muy holgados.Las fases del VRM reparten la potencia entregada al procesador entre el número de estas. A mayor cantidad, más precisa será la entrega de potencia. El problema es que las fases de una placa no tienen por qué ser comparables a las de otra, siendo posible que 4 fases de alta calidad sean mejor que 6 fases de calidad “normal”. Por lo general, podemos decir que a mayor número de fases mejor entrega de potencia al procesador y mayor capacidad de overclock.

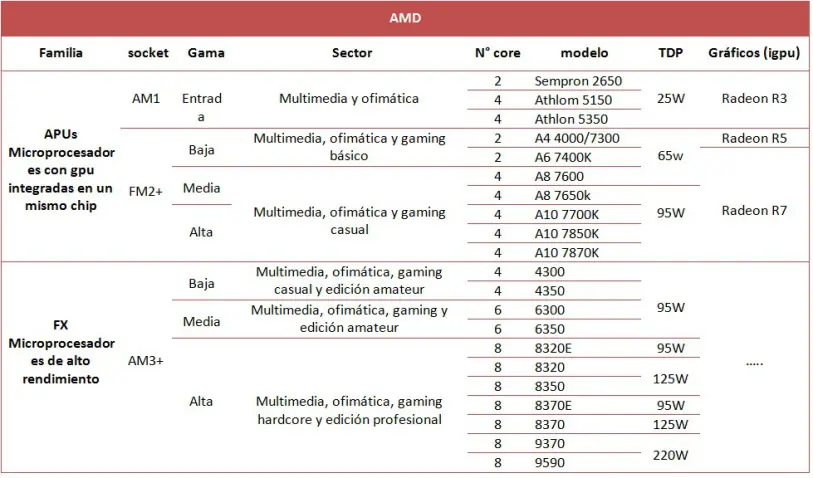

Para comenzar a elegir los componentes de nuestra futura PC, hay un componente que nos genera más dudas a la hora de elegirlo, el micro procesador, si bien es cierto que solo hay dos marcas a las que podemos recurrir, ambas tiene una gran variedad de modelos para ofrecer, desde los más básicos, solo para multimedia, hasta los más potentes y con mayor capacidad de cálculo, perfectos para actividades productivas. Esta guía va ir orientada a ayudar a elegir este componente, que es crítico, de acuerdo a nuestras necesidades, para no desperdiciar nuestro preciado presupuesto. Antes que nada debemos conocer que nos ofrece el mercado y a que gama y uso están dedicados Como se ve en los cuadros cada microprocesador tiene una nicho y segmento determinado, estos bien aclarados en las páginas oficiales de los fabricantes, un poco más claro en la página de AMD que de Intel , pero está, y esto va ser una de las principales cosa que vamos a tener en cuenta a la hora de elegir un microprocesador. Ojo, esto no quiere decir que no se puedan usar un microprocesador de una gama para una tarea pensada para otra, lo va hacer, pero con un poco menos de rendimiento. Entonces: ¿Un micro de 4ghz es mejor que uno de 3.2ghz? No, en si la frecuencia hace referencia al número de ciclos que hace el procesador por segundo, y en cada ciclo se realizan un cierto número de cálculos, que es lo que realmente importa, y los microprocesadores Intel duplican el número de cálculos por ciclo a los micros AMD, por eso vemos como micros de 3.2ghz de Intel pueden tener el mismo rendimiento a micro AMD de 4ghz. En si la frecuencia no va es una determinante precisa de rendimiento. ¿Más core/núcleos es mejor? Si y no, hoy por hoy, el multiproceso o multitarea se está haciendo más común, puedes ser muy útil cuando usamos muchos programas al mismo tiempo, cuando nos gusta tener más de un antivirus activo, en juegos (los últimos motores gráficos están aprovechando más las bondades de los micros multicore, en el pasado quedo lo de “los juegos solo usan máximo 2 core”), etc. Entonces un FX 83xx es mejor que un I5? Volvemos a pregunta anterior, un I5 puede que tenga menos core, pero este realiza el doble cálculos de instrucciones por ciclo de reloj a un AMD, entonces, aunque tenga menos core, este puede realizar el mismo número de tareas que uno de mas core. ¿Qué socket es mejor? Pregunta común, muchas veces se confunde o se usan como sinónimos socket y plataforma, cuando en realidad son cosas diferentes, socket no es mas que la interface que une al microprocesador con la motherboard, y como vemos hay una gran variedad, mas por el lado de AMD, am3+, fm2+, am1 como las actuales, estos socket no son compatibles, así que no podemos usar un micro am3+ en un socket am1 y viceversa, estos es algo que se debe tener en cuanta cuando queremos hacer un upgrade de solo micro procesador o elegir una motherboard adecuada (próximo tema a tratar), Que plataforma es mejor? Por suerte los fabricantes ya nos dijeron eso y para que sirve cada plataforma en los cuadros de más arriba. ¿Qué marca me sugieren? Durante este tema vimos como Intel parece ser mejor que AMD, pero eso no quiere decir que AMD no sea una buena elección, es más, es la que mejor relación precio rendimiento muestra, ambas marcas son muy recomendables para cualquier uso terrenal que le demos, pero si aspiramos a algo profesional, productividad pura, dejo de lado la imparcialidad, les sugiero Intel . ¿para gaming que micro es mejor? Bue, un I7 no, miren aqui , los juegos no depende muchos del micro procesador, aun asi muchos juegos actuales usan y aprovechan el multiproceso, asi que cuando mas core es mejor, al dia de hoy, hay motores gráficos como el CRYengine, frostbite 3 que en la medida que haya mas core, su rendimiento es mejor. Resumiendo Muchos usuarios compran procesadores de gama alta y no aprovechan su rendimiento. Además, no siempre lo más caro es lo mejor para nuestros intereses.Los juegos actuales hacen mayor uso de la gráfica que del procesador, pero esta tendencia va cambiar en sentido de que mayor cantidad de cores podría significar un mayor rendimientoMás núcleos no significa mayor potencia. El número de instrucciones por ciclos de reloj (IPC) afecta en gran medida al rendimiento del procesador provocando que los procesadores de 4 núcleos Intel i5/i7 obtengan un rendimiento a la par de los 8 núcleos AMD FX.El HyperThreading es una tecnología de los procesadores Intel de gama alta (léase i7) que permite simular la existencia del doble de núcleos adelantando parte del procesamiento de la siguiente instrucción durante la ejecución de la actual. Explicado de forma fácil de entender, si vamos a hacer la compra y el cajero/la cajera espera a que el cliente anterior al nuestro pague para comenzar a pasar los artículos… no utiliza HyperThreading Las gráficas integradas en los procesadores no tienen una potencia equiparable a las gráficas dedicadas. Las Intel HD 2500/3000/4000 ofrecen un rendimiento muy básico solo útil para tareas de escritorio y reproducción multimedia. AMD sin embargo ofrece con sus procesadores FM1/FM2 una potencia suficiente para juegos no demasiado exigentes (léase Battlefield, Dirt, etc.) o algunos de estos a una resolución HD (1366×720).Los procesadores que su nombre de modelo viene acabado con la letra “K” indican que disponen del multiplicador desbloqueado (facilitan/permiten su overclock).En este tema hablamos de cómo elegir nuestro futuro micro procesador, como se habran dado cuenta solo tomamos los micros que actualmente se encuentran en el mercado, pero en si, las recomendaciones siempre van a ser las mismas, mas alla de que haya no diferencia de potencia entre una nueva y vieja generación, la mejor forma de elegir, saber que uso le vamos a dar la pc y de cuanto dinero disponemos para ello. Espero que les haya gustado y les sirva de ayuda, ya la semana que viene seguiremos con otra guía de cómo elegir una motherboard apropiada para nuestras necesidades y nuestro microprocesador. saludos, que tengan un bonito dia

Por qué Firefox es el mejor navegador. Hoy es casi imposible concebir una PC o Mac sin conexión a la red, internet ha logrado un cambio en prácticamente todos los aspectos de nuestras vidas, desde la comunicación hasta la forma de hacer negocios, y la manera en que hacemos todo eso es básicamente a través de la web. La principal herramienta con la que hacemos uso de ese vasto mar de información es el navegador, o browser, es cierto que hoy en día nuestra forma comunicarnos a evolucionado bastante, la llegada de aplicaciones específicas (Twitter, facebook, whatsapp, etc) y los dispositivos móviles han modificado el panorama, pero la “aplicación” por excelencia a la hora de surfear por la web sigue siendo y será por mucho más tiempo el navegador. Es por eso que las grandes corporaciones de software tienen su propia versión de navegador web, Apple conSafari, Google y su Chrome, Microsoft con su jubilado IE y su reemplazante Edge pero afortunadamente existen otros renegados que se niegan a ceder el poder a los gigantes: hablamos de Firefox y Opera. El Zorro de Fuego un poco de Historia. El proyecto Mozilla Firefox fue creado por David Hyatt y Blake Ross como una rama experimental del proyecto Mozilla. Está licenciado como software libre, tiene como principios proteger la libertad y la privacidad de sus usuarios además de avanzar en el desarrollo de la web. Se lanza allá por el 9 de noviembre del 2004, y ya antes de eso era conocido entre los internautas como “Phoenix” alcanzando gran popularidad en sus inicios por su increíble velocidad estabilidad y por ser una alternativa tangible al vetusto IE de Microsoft (cosa que Opera no lograba conseguir del todo), siendo precisamente el “boca a boca” de la web lo que ayudaría al despegue del navegador, algo similar a lo que ocurrió con el buscador de Google. Características. Al principio Firefox copio algunas cosas de Opera (un software muy innovador como lo fue en su momento el fallecido Netscape), la capacidad de gestionar pestañas algo que hoy en día todos la tienen, su velocidad de renderizado de páginas y gran capacidad de personalización de la interfaz gráfica junto con su enorme comunidad de desarrolladores (debido a que es una software libre) lograron generar una cantidad inmensa de plug-ins y complementos que hacen las delicias de quienes desean añadir características extras a su navegador. No podemos dejar de mencionar su eficiente gestión de memoria RAM. Versiones. Está disponible en estas versiones, siendo la Estable las versiones para usuarios finales junto con las versiones de prueba Beta y Nigthly, la versión Aurora para desarrolladores y la versión ESR que esta pensada para entornos universitarios, empresariales, etc. Gestión de memoria RAM. Grupos de pestañas abiertas. Si queremos ocultar de la vista o si lo que buscamos es un mayor orden al trabajar podemos agrupar pestañas. Personalización de la interfaz. Firefox es total y completamente adaptable al gusto del usuario gracias a su enorme galería de temas y capacidad de modificar iconos y herramientas.

en esta guía veremos uno de los componentes más subestimados o dejado de lado, las PSU (fuentes de poder). Este es uno de los componentes vitales de nuestra PC, o el más vital literalmente, por lo que su calidad de construcción y estabilidad tienen que ser evaluadas antes de la compra. ¿Qué es y cómo funciona una fuente de poder/ alimentación (PSU)? Antes de continuar debemos conocer que es lo que hace una fuente, que función cumple específicamente. Una fuente poder o PSU es un componente capaz de convertir la corriente alterna CA (220 V corriente normal de la red de distribución, 125 V en algunos países) en corriente continua CC que necesita nuestra PC. Las etapas de este proceso se determinan por los siguientes pasos: • Transformación: un transformador a bobina, como indica su nombre, transforma la corriente 220 V en 12 V. • Rectificación: como dijimos, esta corriente aún es alterna (CA), y todos los componentes de la PC necesitan corrientes continuas (CC) para su funcionamiento, por lo tanto, es el puente rectificador el encargado de modificar esa corriente. • Filtrado: como su nombre también lo indica, sirve para estabilizar la corriente, mediante condensadores que dejan pasar la corriente en forma plana, esto es, sin oscilaciones. • Estabilización: este proceso es el que nos permite mediante un regulador estabilizar la corriente por completo, incluso en pérdidas o sobrecargas en la entrada de corriente alterna (CA) del transformador. También es el encargado, mediante circuitos integrados PWM (Pulse Width Modulation), de verificar y proteger los voltajes haciendo que la fuente se reajuste en función de le energía requerida de acuerdo a los dispositivos conectados. Este es el funcionamiento general de cualquier PSU de PC. Pero su eficiencia varía de acuerdo a la calidad de los componentes, su refrigeración y la estabilidad de los voltios que entrega en cada línea. Como interpretar las etiquetas de las fuentes de poder Todas las PSU están catalogadas de acuerdo a la potencia máxima que pueden entregar. El problema surge cuando entre estas especificaciones la teoría no es completamente cierta y la PSU no puede entregar toda la potencia que indican sus especificaciones. Esto se puede deber a 3 motivos principales: Se etiqueta la fuente de poder con su máximo punto de alimentación: Debemos tener en cuenta que este problema surge cuando uno espera un rendimiento continuo de determinados watts de potencia y en realidad la etiqueta indica los picos de watts máximos que puede entregar el fuente de poder en tiempos muy breves. Su máxima potencia es medida de acuerdo a temperaturas ambientes ideales: A medida que la temperatura ambiente asciende, la temperatura dentro del gabinete también, por lo que la PSU pierde rendimiento. Este proceso físico se llama pérdida de potencia y sucede cuando los semiconductores se calientan y pierden su eficiencia, lo que causa una reducción de su capacidad para suministrar corriente. La variación de temperatura es un tema muy importante, dado que la merma de potencia debido a la temperatura es grande. Ejemplo: Como se puede ver en este último esquema, este transistor trabaja eficientemente en 25 ºC entregando 24 A. Cuando se lo somete a una temperatura de 100 ºC, este mismo transistor no puede entregar más de 15 A, por lo que la merma en la potencia es considerable. Teniendo en cuenta este concepto, es necesario saber cuántos watts máximos entrega la PSU, pero también a qué temperatura. Hay casos en que las etiquetas no muestran la realidad. Esto sucede casi siempre en el caso de las PSU genéricas. Dicen una cantidad de watts que la PSU no puede entregar. En el caja de una fuente modelo antec se indica que es capaz de hacer 1000W a 50°C. El otro punto que siempre genera confusión es que no necesariamente la suma de todos los valores corresponde al total de la fuente. En teoría sí, pero en la práctica no. Tomemos el ejemplo de la imagen: En la línea de 3.3 V, tenemos como máximo un amperaje de 22 A. Estos amperes son lo máximo teórico que puede entregar la línea de 3.3 V, pero no necesariamente el máximo real que puede entregar esa línea, de acuerdo a los componentes en ella conectados. Para simplificar, como las líneas de 3.3 V y 5 V tienen un máximo teórico de 130 w, es menor que la suma de sus dos amperajes, esto es, 22 A + 22 A, que resultarían un total de 110 watts para la línea de 5 V y 72.6 watts para la línea de 3.3 V, sumando 182.6 watts. Por lo tanto, si bien cualquiera de las líneas soportan 22 A, la suma de los componentes conectados a ellas no pueden ser igual a 22 A. Lo mismo pasa con la línea de 12 V y con todas las líneas combinadas. Cuantos más componentes repartan esos voltajes y más amperes consuman, la combinación total no debe sobrepasar el máximo para esta línea, independientemente de la cantidad de amperes que pueda soportar determinada línea. Por lo tanto, cuando uno compra una fuente, lo que tiene que ver es que la capacidad máxima se encuentre en las líneas de 12 V y no así en las de 5 V o 3.3 V. Eficiencia La eficiencia de una PSU se mide entre la cantidad de potencia que es alimentada en corriente alterna CA y la cantidad de potencia que entrega en corriente continua CC. Esto se refleja en una formula simple: eficiencia = corriente continua / corriente alterna o simplificando, E=CC/CA Como ejemplo, si la PSU está consumiendo 500w de CA y está entregando 250 w de CC, la eficiencia seria del 50%. El ideal de la eficiencia es de al menos el 80%. Que ventaja sugiere esto? En primer lugar y lo que más nos importa es la generación de calor. Si esta fuente, en vez del 50%, tuviera una eficiencia del 80%, para entregar los mismos watts de corriente continua, esto es 250 w CC, necesitaría solo 350 w CA de la red domiciliaria. Estos 100 w de más deberán ser disipados por la fuente, por lo que siempre que la fuente sea más eficiente, menor será el calor a disipar y menor será el estrés que puedan sufrir sus componentes. El otro punto no menos importante es el consumo de la fuente con respecto a la factura de luz. Algo importante es que esta eficiencia no es continua, esto es, cuanto mayor sean los watts de CC que exija nuestra PC o mejor dicho, cuanto más nos aproximemos a los watts totales de entrega que tiene la fuente, menor será la eficiencia. n esta imagen se puede ver la curva de eficiencia de una fuente con certificación 80+ gold. No todas las fuentes tienen la misma curva de eficiencia. Las diferencias entre estas están catalogadas en la calificación 80 Plus, de acuerdo a la potencia entregada, la potencia recibida y la eficiencia mantenida en las diversas cargas a constante temperatura. En esta imagen se puede ver la curva de eficiencia de una fuente con certificación 80+ Bronze. Como se ve en estas últimas imágenes, la curva alcanza su mayor eficiencia cuando el consumo total de CC de la fuente no supera entre el 40% y el 60% del total de watts entregados por esta. Se destaca además que la fuente tiene mejor eficiencia cuando funciona en líneas de 220 V en vez de 125 V. Por lo tanto, como recomendación para una compra inteligente, tendremos que tener en cuenta los siguientes parámetros: Consumo: medimos el consumo total de nuestra PC en watts.Eficiencia: elegimos de acuerdo al consumo, una fuente que trabaje entre el 40% y el 60% del valor total de watts de consumo de la PC.Por ejemplo, si la PC consume un total de 400 w en plena carga, podremos elegir fuentes de 750 w de potencia para arriba. Esto se ve reflejado en los costos, pero al mismo tiempo tenemos garantías de una mejor eficiencia, menores temperaturas que afectan a todo el sistema, posibilidades de actualizaciones futura. Eficiencia y certificación: Ecos Plug Load Solutions es una empresa que mide la eficiencia de las fuentes y otorga a las que consiguen una eficiencia superior al 80% y un factor de potencia del 0.9% al 100% de su carga una certificación llamada 80 Plus. La certificación 80 Plus se hace bajo exigentes normas y se le otorgan distintas clasificaciones a cada uno de los productos testeados. Las empresas fabricantes de PSU envían sus productos para la certificación y se les otorga la certificación de acuerdo al porcentaje de eficiencia. La clasificación para la certificación es de la siguiente manera: Si bien existen muchas contras del sistema 80 Plus, como ser que en su laboratorio existe una temperatura controlada constante de 23º C, cosa impensada en la mayoría de los gabinetes, o que solo existen las tres condiciones de cargas, 20%, 50% y 100%, es la única certificación que provee información al consumidor en cuanto a la eficiencia de los productos disponibles en el mercado. Para más información de los productos testeados: http://www.plugloadsolutions.com/80PlusPowerSupplies.aspx Corrección del factor de potencia (PFC) Se habla mucho del PFC y es prácticamente una jugada más de marketing por parte de las empresas fabricantes de PSU. En realidad, el PFC se implementó de acuerdo a medidas energéticas estándares en Europa, pero se fue extendiendo hasta estandarizarse en el mundo. Entendamos primero qué es PFC. El factor de potencia es la diferencia entre la potencia activa y la potencia aparente de un circuito: Factor de potencia= potencia activa/potencia aparente No necesariamente tenemos que entender las diferencias entre estas potencias y la reactiva, pero sí tenemos que tener en cuenta que la relación de esta puede variar entre 0 (0%) y 1 (100%) y cuanto más cercano esté el valor a 1, el circuito absorberá menos potencia reactiva. Existen dos tipos de circuitos PFC, los pasivos y los activos. Mientras los pasivos utilizan componentes que no necesitan energía, son menos eficientes, por lo que se ajustan a valores de entre el 0.6 y el 0.8 (60% y 80%), los PFC activos usan componentes electrónico, por lo que son capaces de generar factores de potencia de más de 0.95 (95%). Las PSU sin PFC tienen un factor de potencia inferior al 0.6 (60%). No existe igualmente una relación con respecto a si una PSU con PFC activo o pasivo es mejor que otra. Lo que sí sabemos es que las PSU con PFC activo serán más eficientes en cuanto al consumo de potencia reactiva, pero no debemos confundir con la eficiencia de potencia que esta puede entregar, por lo que no es necesario buscar este estándar como algo necesario a la hora de comprar una PSU. Para concluir: La fuente de alimentación de un PC básicamente transforma la corriente alterna en corriente continua. Los voltajes a tener en cuenta son +3.3V, +5V, +12V, -12V y +5Vsb, aunque el determinante es +12V.Los distintos voltajes se ofrecen a través de los distintos conectores: ATX: Conector de 20+4 pines a placa.ATX 12V: Conector 4+4 pines a placa, alimentación del procesador.EPS: Conector 8 pines a placa, alimentación del procesador. (básicamente es un ATX 12V con los 8 pines indivisibles)PCI Express: Conector 6, 6+2 u 8 pines para tarjetas gráficas.SATA: Conector “moderno” de alimentación para unidades de almacenamiento SATA, aunque también podemos verlo en otros dispositivos.Molex: Conector “antiguo” de alimentación para unidades de almacenamiento IDE, aunque también es habitual en la conexión de ventiladores.Floppy: Conector para disqueteras aun incluido en muchos modelos. Un raíl es una línea por la que se ofrece un determinado voltaje. Habitualmente, se habla del número de raíles de una fuente como el número de líneas de +12V, siendo lo habitual 1 o 2. Esto implica un reparto de la potencia entre los distintos raíles, lo cual es bueno y malo según para que equipo. Un raíl único reduce los problemas de falta de potencia para gráficas de altas prestaciones.Un raíl doble reduce los problemas en caso de sobretensión. Al estar los componentes en líneas separadas no pueden producirse daños en todos si una sola línea se sobrecarga. El valor de potencia que muestra una fuente de alimentación no siempre es preciso. Esto se debe a que las unidades más económicas hacen las mediciones a una temperatura ambiente muy baja, mientras que las marcas más prestigiosas lo hacen a una temperatura ambiente de hasta 30ºC.Un modelo de fuente modular indica que su cableado puede ser desmontado. Cuando especifican semi-modular hacen referencia a que los conectores imprescindibles no son desmontables (ATX, ATX 4+4, 1 o 2 PCIe). Cuando especifican modular, puede indicar una cosa u otra. Nota:Antes de comprar un modelo modular, debemos reconsiderarlo sabiendo que las torres actuales permiten organizar y ocultar el cableado a la perfección. Puede ser más interesante invertir el sobrecoste de una fuente modular en una de mayor calidad. Los certificados 80+ habla de la eficiencia energética de la fuente. Básicamente indica que la diferencia entre la energía consumida y la ofrecida al PC está por encima del 80, o lo que es lo mismo, la perdida de energía por calor es inferior al 20%. Para otorgar estos certificados se mide la eficiencia con una carga del 10/20/50/100 % dando lugar a los siguientes niveles: Una mayor eficiencia no implica directamente una mejor fuente de alimentación, aunque lógicamente para una mayor eficiencia son necesarios componentes de mayor calidad y por ello suele estar estrechamente relacionado.Un indicativo de la calidad de una fuente de alimentación es su peso. Lógicamente no es algo 100% fiable, pero una fuente de alimentación pesada suele incluir componentes de mayor calidad o mayor cantidad de estos para mejores protecciones. El formato, o factor de forma, habitual es ATX, aunque existen modelos TFX/LFX (estrechas y alargadas), CFX (compacta y con forma de P) o Flex ATX (habitúan en barebones). Solo si vamos a elegir una caja de pequeñas dimensiones debemos tener muy en cuenta que formato de fuente aceptan.El PFC (Power Factor Corrected) es una mejora en la entrega de potencia. Influye en una potencia más estable y eficiente, por lo que afecta al consumo, generación de calor y ruido en gran medida. A la relación entre potencia consumida y ofrecida se le llama factor de potencia y en líneas generales podemos ver que: Sin PFC: Factor de potencia del 60%PFC Pasivo: Factor de potencia de entre 70% y 85%PFC Activo: Factor de potencia del 95%En la práctica, es siempre recomendable una fuente de alimentación con PFC activo y exceptuando los modelos más económicos suele venir incluido. Un factor a tener por algunos en cuenta es el ruido, básicamente generado por el ventilador. Existen modelos que controlan la velocidad de giro de este en función de la temperatura, manteniéndolo incluso apagado cuando la fuente esta en baja carga.Las protecciones más habituales, aunque no incluidas en todos los modelos, son: SCP: Corto circuitoOPP: SobrecargaOCP:Sobre-corrienteOTP:Sobre-temperaturaOVP:SobretensiónUVP: Sub-tensiónNota: En fuentes multi-raíl, cada uno cuenta con una protección OCP individual y de ahí la protección adicional.Hasta aquí llegamos con esta guía, espero que les haya gustado y servido, comenten opinen. Saludos gente…….!!! si les interesa los invito a visitar mis otros post: