Flea90

Usuario (Argentina)

![Todo memorias [Informacion sobre Memorias RAM]](https://storage.posteamelo.com/assets-adonis/assets/2016/05/12/6681FD5B0-W5ZMc2nZGCC.webp)

Hola Taringueros! Buen en este post voy a hablar de lleno sobre la memoria RAM de la PC. Vamos a tocar principalmente los siguientes temas: DDR, DDR2 y DDR3 (tecnología DDR, diferencias, overclock, etc.) RAM Timings. Dual Channel DDR vs. GDDR Esta dividido así para que sea mas entendible y fácil de leer. Todo el texto lo escribi yo en base a mis conocimientos y obviamente sacando informacion y textos de distintas fuentes. Esta ordenado por temas y como son conceptos bastante complejos esta simplificado al maximo y muchas veces se repiten ideas con distintos ejemplos para terminar de alcarar. Espero que les sirva! DDR, DDR2 y DDR3 Antes de comenzar a explorar las diferentes características debemos mencionar que las memorias DDR (en todos sus variantes) están basadas en SDRAM (Synchronous Dynamic Random Access Memory o Memoria Dinámica de Acceso Aleatorio con una interfaz Sincrónica). Básicamente y hablando en español significa que estas memorias utilizan una señal sincrónica (clock signal) para transmitir los datos. También cumplen con la característica de que cualquier posición puede ser leída en cualquier momento aleatoriamente (de ahí la denominación de random access). DDR son las iniciales de Double Data Rate, que se refiere a la capacidad de transmitir dos bloques de datos por cada pulso de reloj (debajo habrá un gráfico explicativo). De esta forma pueden transmitir el doble de información que una memoria SDRAM simple al mismo tiempo, doblando así el nivel de performance. Debido a esta característica las memorias DDR son etiquetadas con el doble de la frecuencia de la señal a la que realmente operan. Tenemos por ejemplo las memorias DDR2-800 realmente trabajan a 400 Mhz, las DDR3- 1066 a 533 Mhz y así con todas las variantes. En estos gráficos podemos observar simplificadamente como se transmiten dos bloques de datos por cada ciclo completo de la señal. Es importante notar que estos clock rates son los máximos a los que el módulo de memoria puede trabajar (garantizado por el fabricante). Esto no quiere decir que va a funcionar automáticamente a esta frecuencia. Pasamos a explicar para que quede mas claro: si por ejemplo instalamos un modulo DDR2-1066 en un motherboard que solo soporta DDR hasta 800 Mhz o que esta erróneamente configurado desde el BIOS las memorias efectivamente van a trabajar a esa frecuencia y no a su máxima posible. Lo mismo ocurre al efectuar un overclock, forzando a las memorias a trabajar a una frecuencia mayor a la establecida por el fabricante y pudiendo lograr así mayor rendimiento. Esto ocurre porque la señal de reloj (que define a que frecuencia van a funcionar las memorias y a que velocidad se van a transmitir los datos) es generada por el controlador de memoria ubicado en el Chipset (northbridge) del mother o en el microprocesador dependiendo del sistema, o sea que no esta determinado por el mismo modulo. Cuestión de nomenclaturas La nomenclatura definida por DDRx – yyyy (donde x determina la generación de tecnología DDR utilizada e yyyy se refiere a la frecuencia DDR de trabajo) en teoría se utiliza para denominar a los chips de memoria. Los módulos de memoria (circuito integrado donde los chips van soldados) utilizan una nomenclatura diferente: PCx – zzzz (donde x también se refiere la generación de tecnología DDR utilizada y zzzz es la máxima tasa de transmisión de datos que en teoría se puede alcanzar - Maximum theoretical transfer rate). Maximum theoretical transfer rate o Máxima tasa teórica de transferencia de datos (si bien la traducción al español no queda tan bien) es un valor de referencia que determina la cantidad de bytes que pueden ser transmitidos por segundo entre el módulo de memoria y el controlador. Esta tasa depende de dos factores: La frecuencia de trabajo y el ancho del bus por el cual se transmiten los datos. En este caso siempre se utiliza un bus de 64 bits entre el módulo de memoria y el controlador. La cuenta es la siguiente: DDR frecuency * ancho del bus / 8. Ya veremos unos ejemplos para que quede mas claro... Actualmente se utilizan ambas nomenclaturas indistintamente. Por ejemplo tenemos un módulo DDR-400 o PC-3200 (400 * 64 / 8 = 3200 MB/s ). Otro ejemplo: DDR3- 1333 o PC3 – 10600. Acá dejo una cuadro de referencia muy útil. Es importante comprender que estos valores máximos son totalmente teóricos y son rara vez alcanzados. Esto se debe a que para realizar estos cálculos matemáticos asumimos que la memoria y el controlador intercambian datos útiles constantemente sin interrupciones, cosa que en la práctica no ocurre así. El controlador de memoria y el modulo también intercambian comandos e instrucciones propias para el manejo de la información que no son necesariamente datos utilizables (por ejemplo instrucciones de lectura o escritura) y por lo tanto no deberían ser tenidos en cuenta para el cálculo. Diferencias Ahora nos vamos a meter un poco mas y vamos a comenzar a hablar de las diferencias que podemos encontrar entre las diferentes generaciones de la tecnología DDR. Velocidad Obviamente una de las principales diferencias es la velocidad. Quizás hablando correctamente el termino “velocidad” no es el mas adecuado, sino que es mas preciso hablar de “mayor volumen de datos transmitido por unidad de tiempo”. Podemos afirmar que con la evolución de DDR en DDR2 y posteriormente en DDR3 estos valores fueron creciendo posibilitando así que una mayor cantidad de información pueda ser transmitida en menos tiempo. Con el avance de la tecnología fue posible que los módulos trabajen a frecuencias mayores e incluso transmitan mayores cantidades de datos por pulso. (hablaremos mas profundamente de esto cuando toquemos el tema de latencias). Para comparar mejor las diferencias nos podemos remitir a la sección donde hablamos del “Maximum theoretical transfer rate” y a la tabla de referencia. Voltajes Los módulos de memoria DDR3 operan a voltajes menores que DDR2, quines a su vez funcionan a voltajes menores que los módulos DDR. Esto también deriva en que la tecnología DDR3 consume menos energía que DDR2 y esta a su vez menos que DDR. A continuación presentamos un cuadro donde podemos observar los voltajes típicos de cada tipo. Obsérvese que puede haber memorias que funcionen con voltajes mas elevados (principalmente aquellas destinadas al overclocking). Latencias - RAM Timings Bueno antes de comenzar a hablar de las conocidas latencias debemos mencionar que esta sea quizás una característica por la cual preocuparse a la hora de armar una PC de alto rendimiento (llámese high-end o gamer). Cabe aclarar que cuando hablamos de latencias nos referimos a tiempos en el orden de los nanosegundos (la mil millonésima parte de un segundo!). Con esto quiero decir que realmente no tiene mucho sentido preocuparse por las latencias si estamos frente a una PC hogareña o de oficina. Arrancamos diciendo que dentro de las memorias de buena marca, trabajando a iguales frecuencias la característica distintiva y crucial en el rendimiento son las latencias. Debido a las latencias, dos memorias con una tasa de transferencia de datos idéntica pueden alcanzar performances distintas. Veamos como puede ser esto... Las latencias en si son intervalos de tiempo que miden cuanto tarda el módulo de memoria en realizar alguna operación interna determinada. Para explicarnos mejor tomemos como ejemplo el parámetro mas conocido llamado CAS Latency (también llamado CL o Access time). Esté valor nos indica cuantos ciclos de reloj demandará el módulo para entregar un dato peticionado por la CPU. Entonces una memoria con CL 4 demorará cuatro ciclos de reloj para recuperar un dato mientras que una con CL 3 demorara tres ciclos. Asumiendo que ambas trabajan a la misma frecuencia evidentemente el módulo con CL 3 será mas rápido, porque le tomará menos tiempo realizar la operación y en consecuencia alcanzará una performance mayor. Las latencias generalmente se presentan como una serie de números, por ejemplo 2-3-2-6-T1 o 3-4-4-8. Cada numero de esta serie representa cuantos ciclos de reloj le tomara a la memoria realizar una operación determinada. Obviamente cada valor representa una operación distinta y siempre se presentan en el mismo orden. Cuanto menor sea el numero mas rápida será la memoria en ese aspecto. Veamos que representa cada valor. El orden es el siguiente: CL-tRCD-tRP-tRAS-CMD. Para comprender debemos considerar el clásico modelo de la memoria como una matriz de filas y columnas. Un grafico para facilitar la comprensión... CL: CAS Latency. Es el tiempo que transcurre entre que el procesador hace la petición de cierto dato y la memoria lo entrega. Es la mas común y a la que se refiere generalmente. tRCD: RAS to CAS Delay. Es el tiempo que transcurre entre la activación de la línea (RAS) y la columna (CAS) donde el dato esta alojado (recuerden el modelo de matriz de filas y columnas). tRP: RAS Precharge. Es el tiempo que transcurre entre que se deshabilita el acceso a una línea de datos y comienza el acceso a una nueva línea. tRAS: Active to Precharge Delay. Cuanto tiempo la memoria debe esperar hasta que el próximo acceso a la memoria pueda iniciarse. CMD: Command Rate. El tiempo que transcurre entre que el chip de memoria es activado y el momento en el cual el primer comando ya puede ser enviado a la memoria. A veces este valor es omitido. En otras ocasiones puede aparecer como T1 (1 ciclo de reloj) o T2 (2 ciclos de reloj). Generalmente se tienen dos opciones. Configurar el BIOS para que utilice las latencias que la memoria tiene por defecto (SPD o Auto) o configurarlos manualmente para usar latencias menores e intentar incrementar el rendimiento. No todas los motherboards permiten configurar las latencias manualmente y hacerlo en forma equivocada puede traer inestabilidad al sistema. Cuando se le hace overclock a las memorias una posibilidad es incrementar el valor de las latencias para lograr que el sistema corra estable. Luego es posible elevar la frecuencia de las memorias con un mayor margen antes de alcanzar la inestabilidad. Esta técnica permite llevar el overclock un poco mas lejos y mantenerlo estable. No esta demás decir que obviamente las memorias de marca y en especial aquellas destinadas al overclock tienen una mayor tolerancia y están preparadas para trabajar por encima de sus especificaciones. Bueno esto fue una idea general de las latencias y a que se refiere cada una. Dado que es el tema mas interesante en referencia a las memorias voy a profundizar bastante sobre las tres latencias mas importantes, el que no le interesa puede pasar al tema siguiente... CAS Latency (CL) Como ya mencionamos anteriormente este es el parámetro mas conocido a la hora de hablar de latencias. Nos indica cuantos ciclos de reloj demorara la memoria en entregar un dato previamente solicitado. Teniendo dos memorias trabajando a la misma frecuencia de reloj pero con un valor de CL distinto quien tenga el menor valor será la memoria mas rápida, ya que tendrá el dato listo para ser usado en un menor tiempo. Cabe aclarar que cuando hablamos de ciclos de reloj nos referimos a tiempos en el orden de los nanosegundos (la mil millonésima parte de un segundo!). Por esto reiteramos que preocuparse por las latencias solo tiene sentido en el armado de ordenadores de alta gama. En el siguiente gráfico podemos apreciar como CL funciona. Se proporcionan dos ejemplos utilizando un modulo de CL 3 y otro de CL 5. El comando "read" en azul simboliza cuando se realiza la petición de lectura de un dato. Podemos apreciar como la memoria de CL 3 responde a esa petición de lectura luego de tres ciclos completos mientras que la otra luego de 5 ciclos. Asumiendo que trabajan a la misma frecuencia el primer modulo presenta un rendimiento un 40% mayor respecto del segundo. Incluso profundizamos un poco mas y podemos calcular el tiempo transcurrido hasta que la memoria tiene del dato listo. El periodo de cada ciclo de reloj puede calcularse fácilmente por la formula T = 1/f . Tomemos como ejemplo un modulo DDR2-533 que trabaja realmente a 266 Mhz (es necesario usar el clock real que siempre es la mitad del efectivo). Aplicando la formula (1/f) obtenemos que el periodo es 3,75 ns (nanosegundos 1ns= 0.000000001 s). Entonces tenemos que esta memoria tardaría 18.75 ns (5 x 3.75) si fuera CL 5 o 11.25 ns (3 x 3.75) si fuera CL 3. RAS to CAS Delay (tRCD) Cada chip de memoria esta internamente organizado como una matriz. En la intersección de cada fila y columna tenemos un pequeño capacitor encargado de almacenar un dato (un 1 o un 0). Dentro de la memoria el proceso de acceder a los datos almacenados consiste en activar la fila y la columna donde el dato buscado se encuentra. Esta activación es realizada a través de dos señales de control llamadas RAS (Row Address Strobe) y CAS (Column Address Strobe). Cuanto menor tiempo transcurre entre estas señales es mejor, ya que el dato va a ser leído mas rápidamente. RAS to CAS Delay (tRCD) mide este tiempo. A continuación podemos ver un gráfico de una memoria con tRCD 3. Al igual que ocurre con el CAS, tRCD trabaja con el clock real de la memoria y cuanto mas bajo sea mejor, ya que se va a comenzar a leer o escribir en la posición de memoria antes. RAS Precharge (tRP) Luego de que un dato es recuperado de la memoria un comando llamado Precharge necesita ser emitido, cerrando la fila que acaba de ser usada y permitiendo que una nueva este disponible. RAS Precharge (tRP) es el tiempo que ocurre entre que el comando Precharge es emitido y el próximo comando para activar ("active" command) filas puede serlo. Como ya hemos dicho el active command comienza un ciclo de lectura o escritura. Resumiendo Poniendo todo junto y para ir cerrando la idea podemos decir que el tiempo transcurrido entre que se emite el Precharge command (para cerrar la operación anterior y dejar listo para la siguiente) y finalmente obtener el nuevo dato pedido es tRP + tRCD + CL. Comparando Latencias Esta sección es bastante interesante ya que podremos fácilmente comparar distintos módulos para saber cual tiene un mayor rendimiento a la hora de elegir. Vayamos despacio para comprender bien... Las memorias DDR3 tienen latencias mayores que las DDR2 quienes a su vez mayores que las DDR. Esto igualmente no quiere decir que sean mas lentas, ya que solo seria valido comparando tecnologías idénticas y a la misma frecuencia. Acá podemos ver un cuadro con las latencias típicas de cada tecnología. Cuando comparamos módulos de memoria que trabajan a la misma frecuencia es simple comparar las latencias, ya que cuanto mas bajas sean mejor. Ahora si estamos comparando módulos que operan a frecuencias distintas o incluso pertenecen a tecnologías distintas (DDR2 vs. DDR3) hay que hacer un poco de matemática para averiguar cual tendrá mayor rendimiento. Veamos... Si tenemos por ejemplo un modulo DDR2-800 CL 5 sabemos que será mas rápido que un modulo DDR3-800 CL 7. Esto es sencillo porque podemos comparar directamente las latencias debido al simple hecho que trabajan a la misma frecuencia (los periodos de las señales van a durar lo mismo). Hay que mencionar también que un modulo DDR3 consumiría menos energía que un DDR2. Veamos ahora el caso para frecuencias distintas. Recordemos que anteriormente vimos que el período de la señal puede calcularse fácilmente por 1 / frecuencia. Entonces es evidente deducir que cuanto mayor sea la frecuencia menor va a ser el periodo. Tomemos nuevamente una memoria DDR – 800, tenemos que cada ciclo de reloj (periodo) va a ser de 2,5 ns (recordar siempre usar el clock real de la señal 1/400 Mhz). Supongamos que esta memoria tiene CL 5. Entonces tenemos que demorara 12,5 ns en tener listo el dato. Ahora comparémosla con otro modulo DDR3-1333 CL 7. Aun teniendo una latencia mayor podemos ver que demorara 10,5 ns (1,5 x 7), alcanzando así un rendimiento mayor. Vimos como incluso una memoria DDR3 con un valor de latencia mayor (7 vs. 5) alcanza una mayor performance. Podemos decir entonces que no podemos fijarnos únicamente por las latencias sino que también debemos considerar la frecuencia de trabajo para hacer una comparación seria. Acá un cuadro comparativo con cada frecuencia y la duración del periodo. Aca una imagen de como presentan los fabricantes las latencias.... Prefetch Acá vamos a ver cual es la diferencia en el funcionamiento entre las tres tecnologías. Vamos a entender como se comportan externamente e internamente con un ejemplo bien claro. Las memorias dinámicas almacenan datos en una matriz de pequeños capacitores. Los módulos DDR transfieren dos bits de datos por ciclo de reloj desde la matriz hasta el buffer de entrada/salida (I/O). Esto se conoce como 2-bit prefetch. En la tecnología DDR2 este bus fue duplicado a 4 bits y en DDR3 nuevamente incrementado a 8. Esto le permite a DDR3 trabajar a frecuencias mas elevadas que DDR2, y esta a mayores que DDR. Cuando generalmente hablamos de la frecuencia de trabajo nos referimos a la cual el modulo usa para comunicarse con el exterior (con el controlador de memoria). Ahora nos estamos metiendo dentro del modulo, como trabaja internamente que por cierto es un poco diferente en cada tecnología... Para comprender mejor la idea imaginemos tres módulos, un DDR-400, un DDR2-400 y un DDR3-400 (sabemos que no existen pero imaginemos que si para entender el concepto). Estas tres memorias trabajan externamente a 200 Mhz transfiriendo dos bits de datos por ciclo de reloj, haciendo que el clock efectivo sea de 400 Mhz. Internamente la historia es distinta. El modulo DDR transfiere 2 bits de datos desde la matriz hasta el buffer de entrada/salida (pequeña porción de memoria que almacena los datos antes de ser enviados al procesador o almacenados). Para que todo sea armónico este bus interno debe trabajar también a 200 Mhz (2 bits por cada ciclo = 400 Mhz.). Como en DDR2 el bus interno es de 4 bits, puede trabajar a la mitad de la frecuencia y aun así alcanzar la misma performance. Entonces puede funcionar a 100 Mhz (4 bits por cada ciclo = 400 Mhz). Ocurre lo mismo nuevamente con DDR3 que tiene un bus de datos interno de 8 bits, permitiéndole trabajar a 50 Mhz (8 bits por cada ciclo = 400 Mhz). Acá un gráfico para aclarar todo... Al doblar el bus interno por el cual se transportan los datos dentro del modulo de memoria cada nueva generación de DDR puede doblar la máxima frecuencia alcanzada en la anterior. Tenemos por ejemplo que DDR-400, DDR2-800 y DDR3-1600 internamente trabajan a la misma frecuencia (200 Mhz). Diferencias Físicas Ahora nos vamos a centrar en las diferencias físicas que presentan los distintos módulos de memoria según la tecnología. Como dijimos y mostramos anteriormente un “módulo de memoria” es un circuito integrado que contiene los chips de memoria. Todos los módulos de una misma generación DDR presentan características físicas similares entre si, pero son distintos a las otras generaciones (no son compatibles). Por ejemplo no es posible instalar un modulo DDR2 en un socket para DDR3. Hay pocas (muy pocas) motherboards que soportan por ejemplo DDR2 y DDR3 a la vez, generalmente si se quiere cambiar de tecnología habrá que cambiar la placa entera. DDR tiene una conexión de 184 pines mientras que tanto DDR2 como DDR3 tienen 240 pines pero difieren físicamente por la posición una muesca ubicada en la parte inferior (key notch). Veamos unas imágenes para que quede mas claro... Todos los chips de los módulos DDR2 y DDR3 generalmente vienen empaquetados de una forma que se la conoce como BGA (Ball Grid Array) mientras que los chips DDR vienen en forma TSOP (Thin Small-Outline Package). Acá podemos ver como se ve cada uno... TSOP (Thin Small-Outline Package) BGA (Ball Grid Array) packaging Para cerrar la comparacion les dejo este video. Esta en ingles pero se entiende bien... link: http://www.youtube.com/watch?v=mZAQ4Y0tjts Dual Channel Introducción La realidad es que la memoria RAM al ser mucho mas lenta que el microprocesador evita que el sistema sea capaz de alcanzar la máxima performance posible. El procesador al ser notablemente mas veloz tiene que “esperar” que la memoria le entregue datos, y durante este periodo el procesador se encuentra inactivo (idle – esto no es estrictamente así pero en los términos de explicación es valido). En un ordenador perfecto la memoria debería ser tan rápida como el CPU y todo funcionaria a la misma velocidad. Como los costos de las memorias aumentan con su velocidad (por decirlo de alguna manera) es prácticamente imposible que hoy en día existan memorias tan rápidas y de grandes capacidades. Para solucionar esta diferencia de “velocidades” se emplean diferentes técnicas como por ejemplo el uso de memoria cache en el microprocesador. Una de estas técnicas es conocida como dual channel y consiste en doblar el ancho de banda de la comunicación entre la memoria RAM y el controlador de memoria, subiendo así la velocidad al doble e incrementando notablemente el rendimiento. Antes de empezar conozcamos un poco como se comunican los componentes del sistema. La memoria es controlada por un circuito llamado “memory controller”. El mismo puede encontrarse físicamente en dos lugares: en el chipset (mas precisamente el en el northbridge o MCH) o actualmente se encuentra dentro del microprocesador. La memoria se conecta con el controlador a través de lo que se conoce como “bus”, que es literalmente una serie de pistas de cobre a través de las cuales se transporta la información. Estas pistas se dividen en tres grupos: data bus, address bus y control bus. El bus de datos es el que efectivamente transporta los datos desde la memoria al controlador. El bus de direcciones es el que transporta la dirección (en que posición de la matriz que conforma la memoria) se encuentra el dato a buscar o donde se va a escribir. Finalmente el bus de control transporta comandos que implican diferentes acciones (Ej. lectura, escritura, tipo de operación, etc). Uno de los aspectos mas importantes del bus de control es el llamado “clock signal”, que determina a que frecuencia se van a comunicar ambos dispositivos. Aquí una figura explicativa basada en un sistema ya antiguo (nótese la presencia del chipset, ya mostramos que actualmente la memoria se comunica directamente con el microprocesador). El tipo de tecnología aceptada va a depender del Chipset en caso de que el controlador de memoria se encuentre allí o del microprocesador (esto determina si el sistema usara DDR, DDR2 o DDR3). Lo mismo ocurre con la frecuencia de trabajo (clock signal), quien es generada por el controlador de memoria. Supongamos por ejemplo que nuestro chipset solo puede generar una señal de 667 Mhz como máximo, entonces si instaláramos memorias DDR2 – 800 funcionarían a una frecuencia menor en este sistema en particular. Esta es una limitación física impuesta por el memory controller. Otro caso particular se da cuando se habla de la máxima memoria que el sistema puede reconocer. La cantidad que el microprocesador pueda direccionar dependerá del tamaño de su bus de direcciones (Ej. si es de 32 bits podrá direccionar hasta 4 GB si es de 36 hasta 16 GB). Pero como sabemos es el controlador de memoria quien va a acceder directamente a la misma por lo que nuevamente podemos tener limitaciones impuestas por el mismo. Por ejemplo Intel Chipsets p35 y G33 solamente podían acceder a 8 GB de RAM, limitando así la máxima potencialidad del microprocesador. Como todas las memorias disponibles en la actualidad son dispositivos de 64 bits el bus de datos es de ese tamaño. Lo que logra la tecnología dual channel es doblar el bus a 128 bits. ¿Qué es el dual channel? Es la habilidad de algunos controladores de memoria de expandir el bus de datos por el cual se comunican con el modulo de memoria de 64 bits a 128 bits. Asumiendo que todas las demás variables permanecen iguales (clock rate, latencias, etc) el volumen teórico de datos transmitidos por segundo aumenta al doble (ya vimos anteriormente como calcular este valor MTTR = real clock rate x data transferred per cycle x bits transferred per cycle / 8). Vayamos a un ejemplo: si tenemos dos módulos DDR2-800 con dual channel activado y calculamos el MTTR tenemos que 800 MHz x 128 / 8 = 12800 MB/s, o sea el doble que si no tuviéramos esta tecnología. Nótese que esto ocurre porque se transmite un volumen doble de datos que antes (64 bits vs. 128 bits). Es muy importante remarcar que todos estos valores son teóricos, y que quizás nunca sean alcanzados. Ahora veamos como funciona físicamente todo esto... Comencemos por un sistema sin dual channel. Cuando decimos que el bus de datos es de 64 bits realmente hay 64 pistas (como si fueran cables) conectando los sockets de memoria con el controlador. Estas pistas se nombran desde D0 hasta D63. Todo el bus de datos es compartido por todos los sockets. Veamos este gráfico... Ahora en sistemas que soportan dual channel, el bus de datos se expande a 128 bits. Esto quiere decir que ahora hay 128 cables (pistas de cobre) conectando el controlador con los sockets de RAM. Se denominan desde D0 hasta D127. Como cada modulo solamente acepta 64 bits por ciclo de reloj, se utilizan ambos módulos juntos para cubrir el bus completo de 128 bits. Entonces tenemos que para tener dual channel debemos tener un controlador de memoria que soporte esta característica e instalar una cantidad par de módulos de memoria. Todos podrán ser accedidos al mismo tiempo, debido a esto ambos módulos deben ser totalmente idénticos (misma capacidad, misma latencias y misma frecuencia). Veamos este grafico... DDR vs. GDDR Para ir cerrando tocamos este tema que muchas veces confunde a la gente. A veces se piensa que GDDR es lo mismo que DDR o que tienen que ser compatibles las memoria RAM de la PC con las de la placa de video... todo esto es erroneo y confuso tratemos de aclarar todo. La memoria RAM también es utilizada en las tarjetas de video para conformar el circuito de memoria. Antes se utilizaba exactamente la misma tecnología que en las memorias RAM para la PC. Con el correr del tiempo las tarjetas de video de gama alta comenzaron a necesitar chips de memoria mas rápidos entonces los fabricantes decidieron comenzar a implementar DDR2 y DDR3. Estas memorias utilizadas en las placas de video tienen algunas características distintas a las usadas en las PCS. Esta es la razón por la cual para diferenciarlas se anteponía la letra “G” que significa “graphics” (GDDR). La principal diferencia es el voltaje al cual trabajan y también suelen funcionar a frecuencias bastante mayores. Debido a esto puede llegar a levantar mayores temperaturas. Actualmente las últimas placas de video de alta gama utilizan GDDR5. Algunas placas de video de baja gama si utilizan chips de memoria DDR2 comunes, idénticos a los de la PC. Cabe aclarar que la memoria RAM de video es utilizada internamente por la misma placa, por lo que no tiene nada que ver con la memoria RAM del sistema. Es por eso que pueden ser totalmente distintas! El sistema puede utilizar memorias RAM DDR2 mientras la tarjeta de video utiliza GDDR5 son totalmente independientes. Principales Marcas Aca les dejo las pricipales marcas con sus respectivos sitios web... * OCZ ha dejado de fabricar memorias. Igualmente la incluyo en la lista porque todavía hay algunos modelos dando vuelta y son de excelente calidad. Bueno espero que les haya gustado Saludos! Fuentes: + http://www.hardwaresecrets.com/ + http://www.wikipedia.org/ + http://www.bit-tech.net/hardware/memory/2007/11/15/the_secrets_of_pc_memory_part_1/3

Anatomía de la PS3 Bueno gente de T! encontre esta info en una página en ingles y me pareció interesante traducirla y compartirla. La idea no es aburrir sino mostrar como es la consola de videojuegos mas popular (bueno o una de las mas populares!). Hay varias imágenes y algunas descripciones de los componentes. Aqui vamos... La Playstation 3 es la última consola de videojuegos de Sony. En este post vamos a desarmar completamente una consola (la versión de 80 GB lanzada al mercado allá por octubre del 2008) para mostrar todos sus aspectos internos y los componentes que utiliza. Comencemos por dar primero un pantallazo general de la PS3. Podría definirse como una consola de videojuegos de alta gama, pero que también cumple el papel de centro multimedia (Media Center PC). Entre sus principales características incluye: reproductor de Blu-Ray, salida HDMI (High Definition Multimedia Interface) para video digital soportando resolución full HD (1080p), salida óptica SPDIF para audio digital, dos puertos USB 2.0, Bluetooth 2.0, Wi-Fi (soporta 11 Mbps y 54 Mbps), un puerto Gigabit Ethernet y un disco rígido SATA de 2,5 pulgadas y 80GB. Aquí los puertos USB. Además de poder disfrutar de los videojuegos obviamente, reúne todas las características necesarias para convertirse en un media center. Se puede usar para reproducir películas y videos en DVD y Blu-Ray, reproducir música, mirar fotos, conectarse inalámbricamente con otros dispositivos (a través de bluetooth y wi fi), etc. No nos vamos a detener en todas sus características porque no es la idea del post aburrirlos... para conocer las especificaciones técnicas completas se puede visitar la página oficial de la PS3 (http://us.playstation.com/ps3/index.htm). Bueno empecemos a meternos un poquito por adentro y a ver los componentes... El Disco Rígido El Disco Rígido se encuentra en una bahía externa removible en el panel izquierdo de la consola (o la parte inferior si la vemos en forma vertical). En este caso la unidad utilizada es de la marca Fujitsu modelo MHZ2080BH (aquí la página oficial de la marca: http://www.fujitsu.com/emea/products/) de 2,5 pulgadas y una interfaz SATA-300. Su frecuencia de rotación es de 5.400 rpm y posee 8 MB de buffer. Cabe destacar que es muy similar a cualquier disco que podemos encontrar en una notebook. Dentro de la PS3 Aquí podemos ver la PS3 sin la tapa superior... La unidad negra que podemos divisar a la izquierda es la fuente, la unidad gris de la derecha es el lector Blu-Ray, el pequeño circuito impreso que podemos ver en la parte inferior izquierda se encarga de proporcionar tanto la conectividad inalámbrica (Wi – Fi y bluetooth) como los dos puertos USB. Debajo podemos ver el motherboard y mas abajo (no llega a verse) encontramos el sistema de enfriamiento. Aquí podremos ver todos sus componentes por separado. A continuación hablaremos un poco de cada uno. Cabe recordar que estos corresponden al modelo de 80 GB que salio a la venta a fines del 2008, por lo que pueden variar respecto a otros modelos posteriores. La Fuente La fuente de poder utilizada es una Delta (modelo EADP-260AP). Este modelo provee dos salidas, una a +12 V (hasta 21,5 A) y otra a +5 V (hasta 0,6 A). Puede brindar como máximo 261 W (de ahí la denominación 260 en el nombre del modelo). En las siguientes imágenes podremos apreciar la fuente por dentro. Como podemos ver no posee ningún cooler interno. Todos los capacitores utilizados son japoneses (de alta calidad) de las marcas Chemi-Con, Rubycon y Nichicon. El lector de Blu-Ray La unidad lectora incluida puede leer discos BD (Blu-ray Disc) a 2x (72 Mbps o 9 MB/s), DVDs a 8x (8,1 MB/s) y CDs a 24x (3,600 KB/s). Entre los chips utilizados en este dispositivo podemos encontrar: - Controlador principal (DSP, Digital Signal Processor): Sony CXD5065 - Controlador secundario (FEP, Front End Processor): Sony CXA2720 - Controlador de motor 1: Rohm BA5888FP. - Controlador de motor 2: Rohm BD7956FS, usados para controlar los motores. - Flash ROM: Spansion S29AL008D (8 Mbit, 1 MB), utilizado para almacenar el firmware. - RAM (buffer): ESMT M12L64164A-7TG (64 Mbit, 8 MB), dotan a la unidad de 8 MB buffer. El circuito de Radio/USB Este pequeño integrado contiene los circuitos de conexión inalámbrica en un lado y los puertos usb en el otro. Contiene 3 antenas, dos Wi-Fi y una bluetooth. El circuito de radio incluye los siguientes componentes: IEEE 802.11b/g wireless network y BlueTooth 2.0 EDR controller chip: Marvell 88W8580 y RAM (buffer): Nanya NT5SV8M16FS-6K (128 Mbit, 16 MB). Los puertos USB son controlados por un chip GL852. El motherboard El corazón de la consola son sus dos procesadores: Cell Broadband Engine (CXD2989) que es el CPU (procesador genérico) y RSX Reality Synthesizer (CXD2982) que es el procesador gráfico. La PS3 utiliza dos tipos de memoria de datos. Posee 256 MB XDR como RAM principal y 256 MB GDDR3 para memoria de video (estos están incluídos dentro de la GPU). Cell Broadband Engine, el CPU. RSX Reality Synthesizer, el GPU. XDR es una arquitectura de memoria desarrollada por Rambus, la cual transmite un numero menor de bits por ciclo pero puede funcionar a una frecuencia de clock mayor, proporcionando una alta tasa de transmisión. En este caso se utilizan cuatro chips Samsung K4Y50164UE-JCB3 corriendo a 3,2 GHz. Cada chip transmite 16 bits por ciclo de reloj, lo que resulta en una transmisión de 64 bits por ciclo de reloj (16 x cada chip). En teoría la tasa de transmisión maxima seria de 25,6 GB/s (3.2 GHz x 64 bits / 8). Cada chip es almacena hasta 64 MB de informacion, por lo que juntos proporcionan los 256 MB de RAM. Uno de los chips XDR de RAM. Otros chips que podemos encontrar en el mobo de la PS3 son: - Sony CXM4024 - Sony CXR714120 - Sony CXD2984 - Flash RAM: Spansion S29GL128N (128 Mbit, 16 MB) - Serial ATA bridge: Marvell 88SA8040 - Gigabit Ethernet controller: Marvell 88E6106 - HDMI controller: Silicon Image Vastlane Sil9132 - Clock generator (1): ICS 1493BG - Clock generator (2): ICS 9249AGLF Sistema de enfriamiento El sistema de enfriamiento esta situado debajo del motherboard. Utiliza un cooler y dos disipadores pasivos (uno para el cpu y otro para el gpu). Fuentes: + http://www.hardwaresecrets.com/ + http://us.playstation.com/ps3/index.htm Bueno esto ha sido todo!! Espero que les haya hustado esta visita al interior de la PS3. Comenten!

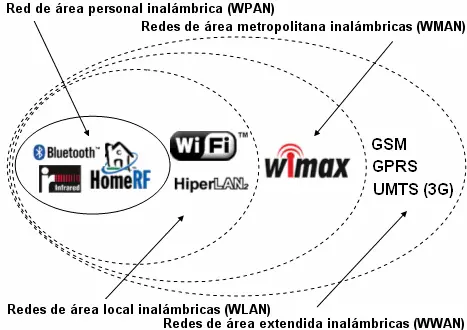

Bueno la idea de este post es mostrar un poco que es una red wi-fi, los dispositivos necesarios para crear una y un tema muy importante: seguridad... la idea no es aburrir sino hacer una pasada rapida por los temas. Espero que les guste! Aca vamos... ¿Qué es una red inalámbrica? Una red inalámbrica es, como su nombre lo indica, una red en la que dos o más terminales (por ejemplo, equipos portátiles, agendas electrónicas, etc.) se pueden comunicar sin la necesidad de una conexión por cable. Las redes inalámbricas se basan en un enlace que utiliza ondas electromagnéticas (radio e infrarrojo) en lugar de cableado estándar. Hay muchas tecnologías diferentes que difieren en la frecuencia de transmisión que utilizan, y el alcance y la velocidad de sus transmisiones. Las redes inalámbricas permiten que los dispositivos remotos se conecten sin dificultad, ya se encuentren a unos metros de distancia como a varios kilómetros. Asimismo, la instalación de estas redes no requiere de ningún cambio significativo en la infraestructura existente como pasa con las redes cableadas. Esto ha hecho que el uso de esta tecnología se extienda con rapidez y facilidad. Categorías de redes inalámbricas Por lo general, las redes inalámbricas se clasifican en varias categorías, de acuerdo al área geográfica desde la que el usuario se conecta a la red (denominada área de cobertura): Wi-Fi El estándar global para redes WLAN mas utilizado en la actualidad esta basado en las especificaciones de IEEE 802.11 y se llama Wi-Fi (el termino proviene del inglés Wireless Fidelity). Además también es una marca de la Wi-Fi Alliance (anteriormente la WECA: Wireless Ethernet Compatibility Alliance), la organización comercial que adopta, prueba y certifica que los equipos cumplen los estándares 802.11. El objetivo de la misma fue crear una marca que permitiese fomentar más fácilmente la tecnología inalámbrica y asegurar la compatibilidad de equipos. De esta forma en abril de 2000 WECA certifica la interoperatividad de equipos según la norma IEEE 802.11b bajo la marca Wi-Fi. Esto quiere decir que el usuario tiene la garantía de que todos los equipos que tengan el sello Wi-Fi pueden trabajar juntos sin problemas, independientemente del fabricante de cada uno de ellos. Igualmente esto no implica necesariamente que equipos que funcionen bajo el estándar IEEE 802.11 y no posean el logo Wi-Fi no sean compatibles. La norma IEEE 802.11 fue diseñada para sustituir el equivalente a las capas físicas y MAC de la norma 802.3 (Ethernet). Esto quiere decir que en lo único que se diferencia una red Wi-Fi de una red Ethernet es en cómo se transmiten las tramas o paquetes de datos, el resto es idéntico. Por tanto, una red local inalámbrica 802.11 es completamente compatible con todos los servicios de las redes locales (LAN) de cable 802.3 (Ethernet). Dispositivos Existen varios dispositivos que permiten interconectar elementos Wi-Fi, de forma que puedan interactuar entre sí. Entre ellos destacan los routers y puntos de acceso, para la emisión de la señal Wi-Fi y las tarjetas receptoras para conectar a la computadora personal, ya sean internas (tarjetas PCI) o bien USB. + Access Point (Punto de Acceso o AP): Funcionan a modo de emisor remoto (o repetidores), es decir, en lugares donde la señal Wi-Fi del router no tenga suficiente radio se colocan estos dispositivos, que reciben la misma por un cable UTP que se lleve hasta él o también capturan la señal débil y la amplifican (aunque para este último caso existen aparatos especializados que ofrecen un mayor rendimiento). + Routers (direccionador, ruteador): Dispositivos de hardware para interconexión de red de ordenadores. Realizan tanto la función de enrutador como la de Access Point. Permiten interconexión entre dispositivos de redes LAN cableadas con otros en redes no cableadas. Son los que reciben la señal de la línea ofrecida por el operador de Internet. Se encargan de todos los problemas inherentes a la recepción de la señal, incluidos el control de errores y extracción de la información, para que los diferentes niveles de red puedan trabajar. + Además de routers, hay otros dispositivos que pueden encargarse de la distribución de la señal, aunque no pueden encargarse de las tareas de recepción, como pueden ser hubs y switches. Estos dispositivos son mucho más sencillos que los routers, pero también su rendimiento en la red de área local es muy inferior. Wireless Hub + Tarjetas PCI: Son tarjetas de expansión que se colocan en los slots PCI del motherboard para posibilitar al ordenador conectarse a una red Wi-Fi de forma inalámbrica. Hoy en día están perdiendo terreno debido a las tarjetas USB, pero siguen siendo una alternativa en en las desktops. + Tarjetas PCMCIA: (Personal Computer Memory Card International Association) Son tarjetas de expansión destinadas a agregar funciones a los ordenadores portátiles. En este caso posibilitan que el ordenador se comunique de forma inalámbrica. Hoy en día están cayendo en desuso, debido a que en la actualidad prácticamente la totalidad de las notebooks que se comercializan incorporan una antena interna para este fin. La mayor parte de estas tarjetas solo son capaces de llegar hasta la tecnología B de Wi-Fi, no permitiendo por tanto disfrutar de una velocidad de transmisión demasiado elevada. + Adaptadores USB Wi-Fi: Son el tipo de tarjeta más común que existe y más sencillo de conectar a un PC, ya sea desktop o portátil, haciendo uso de todas las ventajas que tiene la tecnología USB. Además, algunas ya ofrecen la posibilidad de utilizar la llamada tecnología PreN, que aún no esta estandarizada. + También existen impresoras, cámaras Web y otros periféricos que funcionan con la tecnología Wi-Fi, permitiendo un ahorro de mucho cableado en las instalaciones de redes. Desventajas + Seguridad: Uno de los problemas de este tipo de redes es precisamente la seguridad ya que cualquier persona con una terminal inalámbrica podría comunicarse con un punto de acceso privado si no se disponen de las medidas de seguridad adecuadas. Dichas medidas van encaminadas en dos sentidos: por una parte está el cifrado de los datos que se transmiten y en otro plano, pero igualmente importante, se considera la autenticación entre los diversos usuarios de la red (por medio de una contraseña). En el caso del cifrado se están realizando diversas investigaciones ya que los sistemas considerados inicialmente se han conseguido descifrar. Para la autenticación se ha tomado como base el protocolo de verificación EAP (Extensible Authentication Protocol), que es bastante flexible y permite el uso de diferentes algoritmos. + Velocidad: Otro de los problemas que presenta este tipo de redes es que actualmente (a nivel de red local) no alcanzan la velocidad que obtienen las redes de datos cableadas. Además, en relación con el apartado de seguridad, el tener que cifrar toda la información, supone que gran parte de la información que se transmite, sea de control y no de información útil para los usuarios, por lo que incluso se reduce la velocidad de transmisión de datos útiles. Consideraciones importantes de seguridad A continuación detallare una serie de puntos importantes para tener en cuenta en relación al tema de seguriad. Algunas son mas avanzadas que otras y pueden requerir ciertos conocimientos en el tema para lograr implementarlas. Otras pueden resultar algo engorrosas a la hora de querer agregar un dispositivo nuevo a la red, pero son realmente muy efectivas. + Cambiar la contraseña por defecto: Todos los fabricantes establecen un password por defecto de acceso a la administración del router o Access Point. Al usar un fabricante la misma contraseña para todos sus equipos, es muy probable que el invasor la conozca. + Uso de encriptación WEP /WPA : Se debe activar en el router o Access Point la encriptación WEP (Wired Equivalent Privacy). En lo posible que sea de 128 bits. Algunos dispositivos permiten escribir una frase a partir de la cual se generan automáticamente las claves. Luego de configurar los dispositivos emisores se debe hacer lo mismo con los accesorios o dispositivos Wi-Fi receptores de la red. En éstos se deberá marcar la misma clave para que puedan acceder a la red. Algunos Puntos de Acceso más recientes soportan también encriptación WPA (Wi-Fi Protected Access), encriptación dinámica y más segura que WEP. Si se activa WPA en el Punto de Acceso, tanto los accesorios y dispositivos WLAN de la red como los sistemas operativos instalados en los mismos deben soportarlo. Hoy en día también es posible encontrar dispositivos que soporten WPA2, en remplazo de WPA. + Cambiar el SSID por defecto (Service Set Identifier): Es un código incluido en todos los paquetes de una red inalámbrica que permite identificarlos como parte de esa red. Es conveniente modificar el que viene por defecto por algún nombre poco llamativo. De esta forma hay menos posibilidades de que un invasor intente entrar en la red. + Actualizar el firmware del router o Access Point a la última versión: Con el objeto de corregir cualquier falla posible. + Desactivar el broadcasting SSID: El broadcasting SSID permite que los nuevos equipos que quieran conectarse a la red Wi-Fi identifiquen automáticamente los datos de la red inalámbrica, evitando así la tarea de configuración manual. Al estar desactivado se deberá introducir manualmente el SSID en la configuración de cada nuevo equipo que se quiera conectar, pero resulta útil a la hora de dificultar la tarea de alguien que pretenda entrometerse en la red. + Activar el filtrado de direcciones MAC: Activar el filtrado de direcciones MAC y guardar las direcciones de los dispositivos Wi-Fi que regularmente estarán conectados. Al activar el filtrado MAC sólo los dispositivos con las direcciones MAC especificadas tendrán acceso a la red Wi-Fi. + Establecer el número máximo de dispositivos que pueden conectarse: Si el AP lo permite, establece el número máximo de dispositivos que pueden conectarse al mismo tiempo al Punto de Acceso. + Desactivar DHCP : (Dynamic Host Configuration Protocol): Desactivar DHCP en el módem, router y en el AP. Esta configuración configura automáticamente todas direcciones IP de los dispositivos automáticamente. Al desactivarla se deberán introducir manualmente la dirección IP, la puerta de enlace, la máscara de subred y el DNS primario y secundario de cada dispositivo conectado, permitiendo configurar absolutamente todas las direcciones. + Cambiar las claves WEP regularmente: Existen aplicaciones capaces de obtener la clave WEP de una red Wi-Fi analizando los datos transmitidos por la misma. Pueden ser necesarios entre 1 y 4 GB de datos para romper una clave WEP, dependiendo de la complejidad de las claves. Cuando se alcanza este caudal de información transmitida es recomendable cambiar las claves. Recordar que se deberá introducir la misma clave WEP en el Punto de Acceso y en los dispositivos que se vayan a conectar a éste. Vocabulario y algunas definiciones interesantes + IEEE: Corresponde a las siglas de Instituto de Ingenieros Eléctricos y Electrónicos, una asociación técnico-profesional mundial dedicada a la estandarización, entre otras cosas. Es la mayor asociación internacional sin fines de lucro formada por profesionales de las nuevas tecnologías, como ingenieros eléctricos, ingenieros en electrónica, científicos de la computación, ingenieros en informática, ingenieros en biomédica e ingenieros en telecomunicación. Su creación se remonta al año 1884, contando entre sus fundadores a personalidades de la talla de Thomas Alva Edison, Alexander Graham Bell y Franklin Leonard Pope. En 1963 adoptó el nombre de IEEE al fusionarse asociaciones como el AIEE (American Institute of Electrical Engineers) y el IRE (Institute of Radio Engineers). + Hot spot (en inglés ‘punto caliente’): es una zona de cobertura Wi-Fi, en el que un punto de acceso (Access Point) o varios proveen servicios de red a través de un Proveedor de Servicios de Internet Inalámbrico (WISP). Los hotspots se encuentran en lugares públicos, como aeropuertos, bibliotecas, centros de convenciones, cafeterías, hoteles, etcétera. Este servicio permite mantenerse conectado a Internet en lugares públicos. Este servicio puede brindarse de manera gratuita o pagando una suma que depende del proveedor. + WEP (Wired Equivalent Privacy): “Privacidad Equivalente a Cableado", es el sistema de cifrado incluido en el estándar IEEE 802.11 como protocolo para redes Wireless que permite cifrar la información que se transmite. Proporciona un cifrado a nivel 2, basado en el algoritmo de cifrado RC4 que utiliza claves de 64 bits (40 bits más 24 bits del vector de iniciación IV) o de 128 bits (104 bits más 24 bits del IV). Los mensajes de difusión de las redes inalámbricas se transmiten por ondas de radio, lo que los hace más susceptibles, frente a las redes cableadas, de ser captados con relativa facilidad. Presentado en 1999, el sistema WEP fue pensado para proporcionar una confidencialidad comparable a la de una red tradicional cableada. + WPA: (Wi-Fi Protected Access - Acceso Protegido Wi-Fi) Es un sistema para proteger las redes inalámbricas (Wi-Fi), creado para corregir las deficiencias del sistema previo WEP. Los investigadores han encontrado varias debilidades en el algoritmo WEP (tales como la reutilización del vector de inicialización (IV), del cual se derivan ataques estadísticos que permiten recuperar la clave WEP, entre otros). WPA implementa la mayoría del estándar IEEE 802.11i, y fue creado como una medida intermedia para ocupar el lugar de WEP mientras 802.11i era finalizado. WPA fue creado por "The Wi-Fi Alliance". + WPA2: (Wi-Fi Protected Access 2 - Acceso Protegido Wi-Fi 2) Es un sistema para proteger las redes inalámbricas (Wi-Fi), creado para corregir las vulnerabilidades detectadas en WPA. + El SSID (Service Set IDentifier): es un código incluido en todos los paquetes de una red inalámbrica (Wi-Fi) para identificarlos como parte de esa red. El código consiste en un máximo de 32 caracteres alfanuméricos. Todos los dispositivos inalámbricos que intentan comunicarse entre sí deben compartir el mismo SSID. + DHCP (Dynamic Host Configuration Protocol - Protocolo Configuración Dinámica de Servidor): Es un protocolo de red que permite a los nodos de una red IP obtener sus parámetros de configuración automáticamente. Se trata de un protocolo de tipo cliente/servidor en el que generalmente un servidor posee una lista de direcciones IP dinámicas y las va asignando a los clientes conforme éstas van estando libres, sabiendo en todo momento quién ha estado en posesión de esa IP, cuánto tiempo la ha tenido y a quién se la ha asignado después. Fuentes: + http://es.wikipedia.org/wiki/Wikipediaortada + http://www.hardwaresecrets.com/ + http://www.pdaexpertos.com/ + http://es.kioskea.net/contents/wireless/wlintro.php3 Bueno esta fue una recopilación que hice yo mismo buscando info en varios sitios y tambien datos adicionales agregados por mi. Espero que les haya gustado!! NO TE VAYAS SIN COMENTAR!

La NASA apaga el último mainframe La NASA ha apagado el último ordenador central IBM Z9, dando carpetazo a un capítulo en la historia de la organización de las tecnologías de la información. Se trató de una pieza importante para calcular y resolver complicados problemas numéricos relacionados con los también muy complejos vuelos espaciales. Estos sistemas actuales (que destacaban por su seguridad y capacidad de procesar transacciones de datos muy rápidamente) han sido sustituidos en muchos casos por sistemas Linux y Unix más pequeños, más rápidos y baratos, que además son también más escalables y fáciles de manejar. No obstante, desde la NASA aseguran que a pesar de que las interfaces de usuario son torpes y poco flexibles, sigue existiendo la necesidad de mainframes. Y es que resultan, según un portavoz de la NASA, extremadamente fiables para alojar aplicaciones de negocio orientadas a transacciones seguras. El propio Gigante Azul sigue aglutinando en la actualidad más del 90% del mercado de mainframes.

El motivo de este post es una sencilla explicacion para poder eliminar los kernels antiguos y ya no utilizados por nuestro S.O. Como puede verse en la imagen, a medida que actualizamos sucesivamente el kernel de nuestro Ubuntu se iran agregando mas entradas a la lista del Grub. Esto puede resultar algo molesto y ademas los kernels ocupan espacio en el disco duro (cuando se elimina uno pueden llegar a liberarse alrededor de 90 Mb). Para esto hay dos soluciones que detallaremos a continuación... 1) COMENTAR LAS ENTRADAS VIEJAS Esto es simplemente para ocultar las entradas y que estas no sean monstradas en la pantalla del Grub (los kernels no son borrados del equipo) 1) Abrimos una terminal y escribimos: "gksudo nautilus". Se nos pedira la clave y se abrira una ventana en la cual podremos navegar por las carpetas del equipo con permisos de root. 2) Buscamos la carpeta boot/grub y alli localizamos el archivo de configuracion el Gub: grub.cfg 3) Entramos a las propiedades del mismo y en la pestaña permisos seleccionamos lectura y escritura para el root. De esta forma podremos modificar el archivo. 4) Dentro del archivo encontraremos todas las entradas de los sistemas operativos instalados. Para que alguna no apareza simplemente "comentamos" las lineas de código que pertenecen a esa entrada agregando "/*" antes de la misma y "*/" cuando finaliza. 5) Cerramos y guardamos los cambios. 6) No olvidar volver a quitar las propiedades de escritura en este archivo. (el hecho de que solo el root pueda modificar los archivos importantes de configuracion del sistema es una fuerte medida de seguridad de Ubuntu) 2) Eliminar Kernels antiguos De esta forma si se desinstalaran los kernels del equipo. IMPORTANTE Aqui una captura del Grub en la cual pueden verse 2 kernels instalados. Siempre es recomendable, al instalar uno nuevo, dejar el anterior o alguna version previa que funcione de forma estable por cualquier problema o inconveniente que pueda surgir. De este modo se podra iniciar la pc con el kernel mas viejo en caso de que el nuevo no arranque. 1) Abrimos una terminal y escribimos : "sudo dpkg -l | grep linux-image". Este comando nos mostrará una lista de los kernels archivados. 2) Ahora escribimos : "sudo apt-get remove --purge KERNEL". Reemplazando KERNEL por el nombre del kernel que queremos desinstalar. Por ejemplo: "sudo apt-get remove --purge linux-image-2.6.24-21-generic" 3) Listo!! El kernel indicado ha sido desinstalado!! 4) Para saber que Kernel se esta utilzando actualmente se puede usar el comando "uname -r". INFO ADICIONAL: Como seleccionar el sistema que bootea por defecto Para hacer esto tenemos dos formas: 1) Editando el archivo de configuracion del GRUB (grub.cfg) - Abrimos una terminal y escribimos: gksudo nautilus /boot/grub - Dentro de esa carpteta buscamos el archivo grub.cfg y en la parte de permisos lo habilitamos para poder editarlo como root (entramos a las propiedades del mismo y en la pestaña permisos seleccionamos lectura y escritura para el root). - Luego lo abrimos y en la parte donde dice SET_DEFAULT:'0' reemplazamos el 0 por la posicion donde se encuentra el SO con el cual queremos bootear. (Tengamos en cuenta que el primero es el 0, el segundo es el 1... o sea seria la posicion real -1). - Cerramos, guardamos los cambios y listo! 2) Instalando el Start-up manager - Abrimos una terminal y escribimos : sudo aptitude install startupmanager - Luego ejecutamos el programa y podremas cambiar varios aspectos de configuracion del inicio (es muy intuitivo y facil de usar) Espero que les sirva este post!! Un abrazo a todos los linuxeros!!