IceGames

Usuario (Argentina)

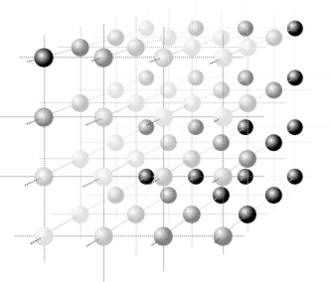

En esta ocasión, aprenderemos que es un Vóxel, Píxel y un Téxel Vóxel El vóxel (volumetric pixel o píxel volumétrico) es la unidad cúbica que compone un objeto tridimensional. Es la unidad mínima procesable (si es 1 vóxel) de una matriz tridimensional y es, por tanto, el equivalente del píxel en un objeto 3D. Representación tridimensional de voxels. Píxel Un píxel es la menor unidad homogénea en color que forma parte de una imágen digital, cómo una imágen, video, etc (Pero no gráficos Vectoriales). Ampliando lo suficiente una imagen digital en la pantalla de una computadora, pueden observarse los píxeles que componen la imagen. Los píxeles son los puntos de color (siendo la escala de grises una gama de color monocromática). Las imágenes se forman como una sucesión de píxeles. La sucesión marca la coherencia de la información presentada, siendo su conjunto una matriz coherente de información para el uso digital. El área donde se proyectan estas matrices suele ser rectangular. La representación del píxel en pantalla, al punto de ser accesible a la vista por unidad, forma un área homogénea en cuanto a la variación del color y densidad por pulgada, siendo esta variación nula, y definiendo cada punto en base a la densidad, en lo referente al área. En las imágenes de mapa de bits, o en los dispositivos gráficos, cada píxel se codifica mediante un conjunto de bits de longitud determinada (es la llamada profundidad de color); por ejemplo, puede codificarse un píxel con un byte (8 bits), de manera que cada píxel admite hasta 256 variaciones de color (28 posibilidades binarias), de 0 a 255. En las imágenes llamadas de color verdadero, normalmente se usan tres bytes (24 bits) para definir el color de un píxel; es decir, en total se puede representar un total de 224 colores, esto es 16 777 216 variaciones de color. Una imagen en la que se utilicen 32 bits para representar un píxel tiene la misma cantidad de colores que la de 24 bits, ya que los otros 8 bits son usados para efectos de transparencia. Para poder visualizar, almacenar y procesar la información numérica que se representa de cada píxel, se debe conocer, además de la profundidad y brillo del color, el modelo de color que se está utilizando. Por ejemplo, el modelo de color RGB (Red-Green-Blue) permite crear un color compuesto por los tres colores primarios según el sistema de mezcla aditiva. De esta forma, en función de la cantidad de cada uno de ellos que se use en cada píxel será el resultado del color final del mismo. Por ejemplo, el color magenta se obtiene mezclando el rojo y el azul, sin componente verde (este byte se pone en cero). Las distintas tonalidades del mismo color se obtienen variando la proporción en que intervienen ambas componentes (se altera el valor de esos dos bytes de color del píxel). En el modelo RGB lo más frecuente es que se usen 8 bits para representar la proporción de cada una de las tres componentes de color primarias. De esta forma, cuando una de las componentes vale 0, significa que ella no interviene en la mezcla y cuando vale 255 (28 – 1) significa que interviene aportando el máximo de ese tono, valores intermedios proveen la intensidad correspondiente. La mayor parte de los dispositivos que se usan con una computadora (monitor, escáner, etc.) usan el modelo RGB (modelo de reflexión o aditivo), excepto los que aportan tintes, como las impresoras, que suelen usar el modelo CMYK (modelo sustractivo). Profundidad de color Un píxel, comúnmente, se representa con: 8 bits (28 colores), con 24 bits (224 colores, 8 bits por canal de color) o con 48 bits (240 colores); en fotografía avanzada y digitalización de imágenes profesional se utilizan profundidades aún mayores, expresadas siempre en valores de bits/canal de color en lugar de la suma de los tres canales. Los primeros son los más utilizados, reservando el de 8 bits para imágenes de alta calidad pero en tonos de grises, o bien con 256 colores en paleta seleccionada para baja calidad colorimétrica; el de 24 bits es el más común y de alta calidad, se lo utiliza en la mayoría de las imágenes fotográficas. MegaPíxel Un megapíxel (Mpx) equivale a 1 millón de píxeles, a diferencia de otras medidas usadas en la computación en donde se suele utilizar la base de 1024 para los prefijos, en lugar de 1000, debido a su conveniencia respecto del uso del sistema binario. Usualmente se utiliza esta unidad para expresar la resolución de imagen de cámaras digitales; por ejemplo, una cámara que puede tomar fotografías con una resolución de 2048 × 1536 píxeles se dice que tiene 3,1 megapíxeles (2048 × 1536 = 3.145.728). La cantidad de megapíxeles que tenga una cámara digital define el tamaño de las fotografías que puede tomar y el tamaño de las impresiones que se pueden realizar; sin embargo, hay que tener en cuenta que la matriz de puntos está siendo distribuida en un área bidimensional y, por tanto, la diferencia de la calidad de la imagen no crece proporcionalmente con la cantidad de megapíxeles que tenga una cámara, al igual que las x de una grabadora de discos compactos. Téxel Un texel (texture pixel en inglés) es la unidad mínima de una textura aplicada a una superficie usada en gráficos por computador. De la misma forma que una imagen digital se representa mediante una matriz de píxeles, una textura se puede representar mediante un matriz de texels. Cuando se aplica una textura a una superficie 3D, en el proceso conocido como mapeado de texturas, se asignan texels a los píxeles correspondientes que aparecerán en la imagen final. Un texel puede corresponder a varios píxeles, o bien ser de tamaño inferior a uno, en cuyo caso podría no ser visible. El hecho de que un texel corresponda a varios píxeles no quiere decir que éstos vayan a tener un color uniforme. Fuente desde mi blog, ¡gracias por visitar!: http://geekmode.hol.es/explicacion-de-voxel-pixel-y-texel/

Hoy hago un benchmark de mi apestosísima, horrible y escupidam XFX HD6850 Double dissipation (no es la versión DD, la mía incluye solo un conector de 6 pines). Recordemos que esta versión tiene 775MHz en el núcleo y 1000MHz en las memorias, y yo la llevé a 980MHz en el núcleo y 1050MHz en las memorias (aunque soporta hasta 1275Mz en las memorias sin hacer artifacts, pero el rendimiento extra no justifica el excesivo voltaje que le tengo que poner). No obstante, a veces supero los 990MHz en el núcleo y empieza a tirar artifacts, así que no volví a esa frecuencia. Hice distintos OC's para poner una puesta en común y ver si se justifica el aumento de voltaje y temperaturas, o es mejor bajar un poco las frecuencias para obtener mejores temps; apenas bajando el framerate. Aviso: Tengan en cuenta que el circuito es Chicago The Loop (corriendo con el benchmark del GRID2, así que estubo siempre en 8º puesto xD), que no es un circuito cerrado, en esos estoy en un promedio de 56fps aprox. De todas formas, no es algo muy relevante para el ojo Equipo de pruebas - Intel Core i7 3770K @ 4.0GHz - Asus P8Z77-V - 2x4GB GSkill Ripjaws 2133MHz - SSD Kingston KC300 - HDD WD Caviar Blue (acá está instalado el GRID2) - XFX HD6850 Double Dissipation - Power Cooler PS550-SS Cabe aclarar, que probé mi GPU en un Phenom II x6 1090T @ 4.0GHz y tube el mismo rendimiento, al menos acá Si puedo hago un bench con el Tomb Raider GOTY, que ese si le dio una paliza a la GPU ¡Un saludo! En mi caso lo dejo con el OC más alto porque no sube muchos grados, teóricamente soporta unos 95º sin hacer Throttle, así que 75º están perfectos. Además me gusta el número 980

Perdón por el desorden de cables, no estaba preparado xD A diferencia del bench anterior que probaba el Battefield 3 Online, ahora corrí el benchmark de Tomb Raider con todo al máximo a una resolución de 1366x768, obteniendo una media de 34FPS. Descripción del hardware: - Intel Core i7 3770K @ 4.0GHz - Asus P8Z77-V - 2x4GB GSkill Ripjaws 2133MHz CL9 - XFX HD6850 Double Dissipation @ 950MHz | 1050MHz Sorpresivamente y gracias al frío, no pasó de los 69º con este OC, así que pienso hacerle un poco más

Más récord que review, pero se lo puede mirar de distintos puntos de vista Info térmica Temp. ambiente: 23ºcTemp. average GPU 1.05v: 65,7ºcTemp. average GPU 1.038v: 62,4ºcTemp. average GPU 1.025v: 62ºcRecordemos que hablamos de Furmark, una aplicación que estresa mucho más una GPU que un juego "promedio" (Far Cry 2, NFS Rivals, etc).A tener en cuenta que es un chip Barts de 40nm. PC Config Intel Core i7 3770K @ 4.1GHz XFX HD 6850 Double Dissipation @ 875MHz Core - 1000MHz Memory | 1.025v Capturas certificadas GPU 1.05v: 65,7ºc GPU 1.038v: 62,4ºc GPU 1.025v: 62ºc Gracias por leer ¿Alguna vez practicaste el Undervolt? ¿Que tal te fue? ¿Hiciste algún récord? (Personal o mundial)

Si están en el área de modelado 3D/edición con AI Suite o algún otro programa que utilice OpenCL/CUDA, es muy posible que se hayan armado o estén en plan de armarse una PC que pueda manejar un proyecto grande y renderizarlo en un tiempo razonable. Voy a hacer una configuración “modular” base a la que se le podrán agregar o cambiar la gpu, que es lo más importante a la hora de renderizar. Antes que nada, digo la razón de usar AMD+Nvidia: Es porque, básicamente, el precio de un i3 3240 (por ejemplo) es similar al de un FX 6300 que tiene mayor rendimiento. Cabe aclarar que el micro no importa mucho, más abajo explico el porqué. Además, uso Nvidia porque tiene mayor soporte de parte de empresas que desarrollan el software, por desgracia OpenCL a demostrado ser más rápido en comparación con CUDA pero no tiene soporte de muchos programas, por lo que descarto la opción de usar una GPU AMD. Cabe aclarar que las Quadro también soportan OpenCL, ya que es un proyecto de código abierto. La verdad que he visto algunos precios y GPU’s y la verdad, prefiero una Geforce GTX 770 para jugar y renderizar antes que una Nvidia Quadro K2000: La GTX vale $5500-$6000 y la Quadro K2000 vale $7500. Digamos que la GTX 770 es infinitamente mejor que la Quadro para jugar, pero si nos dedicamos solamente a renderizar, por más que la Quadro, en el papel parezca muy inferior a la GTX 770, les aseguro que un render de 2 horas, la Quadro K2000 la hace en 1 hora 25 minutos. Pueden buscar ustedes mismos en Google. Pasando al punto del procesador, dirán que también es importante, y realmente no lo es. CUDA hace todo o el 95% del trabajo. Y ese 5% que tiene que hacer el procesador lo hace en simultáneo con la GPU, así que pongas un Core 2 Quad Q9400, un Core i7 3770K, un FX 8320 o un FX 6300, es probable que con todos esos procesadores el render tarde lo mismo, ya que es más probable que la GPU se tarde más haciendo el 95% del render que el procesador haciendo ese 5% del trabajo Lo bueno de las Nvidia Quadro es que suelen tener un consumo muy inferior al de un equivalente en Geforce GTX, así que con una fuente de 550w estaremos asegurados para un SLI de Quadro K2000 o incluso un SLI de K5000, obteniendo 300w de consumo totales en el último caso. Eso sumado a un FX 6300 que no supera los 140w a 3.8GHz full load, no tendremos problemas. Sin contar el SSD+memorias que no consumen nada Atención: Corroborar que el programa que utilicen soporte la GPU que van a comprar. Render Machine – Low Entry – $15.600 ARG AMD FX 6300 @ 3.8GHz | $1400: Un procesador muy conocido por su buena relación precio/producto, con un rendimiento multihilo similar al del i5 4430. Me gustaría que lo dejaran a 3.8GHz para que el cooler no necesite ir a tan altas RPM (decisión suya). Asus M5A99X EVO R2.0 | $1900: Un motherboard muy lindo que nos dejará poner una segunda Quadro y hacer OC sobre los distintos componentes de la computadora. Si no tienen pensado hacer un SLI de Quadro K2000, diría que pueden economizar y comprar un M5A97 R2.0, reduciendo el precio de la PC a $21.000 ARG. 2x4GB GSkill Ripjaws 1600MHz | $1100: Si bien muchos dicen que la tardanza en los renders puede ser también por un ancho de banda bajo, todos cometen el error de comprar memorias de alta velocidad, y no un SSD. Crucial M500 240GB | $1600: Esto de verdad aumentará nuestra velocidad de ancho de banda. Si bien no es el mejor SSD que hay, cumple cualquier expectativa de un usuario que viene de un HDD mecánico, con 250MB/s de escritura y 500MB/s de lectura y 240GB. Nvidia Quadro K2000 | $6800: Después de buscar un tiempo, encontré una Quadro K2000 a un excelente precio en OCStore | Info NZXT Hale82 80+ Bronze 550w | $1300: Una fuente sobresaliente de parte de NZXT NZXT Phantom 410 | $1500 Render Machine – Medium Entry – $36.000 ARG AMD FX 6300 @ 3.8GHz | $1400: Un procesador muy conocido por su buena relación precio/producto, con un rendimiento multihilo similar al del i5 4430. Me gustaría que lo dejaran a 3.8GHz para que el cooler no necesite ir a tan altas RPM (decisión suya). Asus M5A97 R2.0 | $1400: Debido a que la Quadro K5000 es un misil, dudo que queramos poner otra en SLI, y si se queda vieja, no creo que no puedan comprar algo más nuevo y de la misma gama (si su situación económica va igual de bien, y ojalá que si). Además, así economizamos un poco y ajustamos más el presupuesto 2x4GB GSkill Ripjaws 1600MHz | $1100: Si bien muchos dicen que la tardanza en los renders puede ser también por un ancho de banda bajo, todos cometen el error de comprar memorias de alta velocidad, y no un SSD. Crucial M500 240GB | $1600: Esto de verdad aumentará nuestra velocidad de ancho de banda. Si bien no es el mejor SSD que hay, cumple cualquier expectativa de un usuario que viene de un HDD mecánico, con 250MB/s de escritura y 500MB/s de lectura y 240GB. Nvidia Quadro K5000 | $28000: Realmente, un monstruo del diseño 3D. Info NZXT Hale82 80+ Bronze 550w | $1300: Una fuente sobresaliente de parte de NZXT NZXT Phantom 410 | $1500 Render Machine – High performance – $69.000ARG AMD FX 6300 @ 3.8GHz | $1400: Un procesador muy conocido por su buena relación precio/producto, con un rendimiento multihilo similar al del i5 4430. Me gustaría que lo dejaran a 3.8GHz para que el cooler no necesite ir a tan altas RPM (decisión suya). Asus M5A99X EVO R2.0 | $1900: Un motherboard muy lindo que nos dejará poner una segunda Quadro y hacer OC sobre los distintos componentes de la computadora. 2x4GB GSkill Ripjaws 1600MHz | $1100: Si bien muchos dicen que la tardanza en los renders puede ser también por un ancho de banda bajo, todos cometen el error de comprar memorias de alta velocidad, y no un SSD. Samsung 840 EVO 500GB | $4000: Uno de los mejores discos que hay en el mercado. ¡Y de 500GB! Nvidia Quadro K5000 x2 | $56600: Realmente, un monstruo del diseño 3D. ¡En SLI no hay cosa que las detenga!. Info NZXT Hale82 80+ Bronze 550w | $1300: Una fuente sobresaliente de parte de NZXT NZXT H630 Black | $2700: Excelente gabinete ful tower, muy prolijo y con un flujo de aire sobresaliente. Editado: Algunas personas dijeron que prefieren Intel, así que personalmente para estos trabajos y si quieren mayor velocidad de procesamiento de parte del cpu, tendrían que comprar un i5 4670K/i7 4770K para notar una real diferencia de velocidad, que está por delante de un FX 8350 De más rápido a menos, la lista iría así: i7 4770K > i7 3770K > i5 4670K > FX 8350 > FX 8320 > i5 3570K > i5 3470 > FX 6300 > i5 4430 > i5 3330 > i3 4330 > FX 4300 > i3 3220. A un i7 4770K se le puede acompañar de un Asrock Killer H97 o algo más económico, como un Asus Vanguard B85. Un saludo a todos. ¡Cualquier duda me dicen! En la entrada original están los links a los productos La entrada es de mi autoria

Holaaa! A pedido de muchos, llega un benchmark con el BF3 Online, con 64 jugadores conectados (es un server brasileño conocido, tengo buenas latencias) y a 900p con todo en Ultra... ¿Se cocina o no se cocina? ¡A mi me parece que no! Les dejo los números Tomado de los primeros 4 minutos Seguramente el valor máximo de fps es un poco más con clocks stocks porque abré mirado para arriba para ascender un poco con el Hornet, particularmente no soy de ascender con el avión Saludos y disfruten sus máquinas!

Si si, ahora con fuente y gabinete nuevo (para levantarme lincesas) decido juntar todo y postear la nueva configuración de la computadora Aclaración: lo único que tuve "de arriba" fue la PC del 2011-2012 que aclaro que fue regalada, lo demás fue todo de mi guita a excepción de dos cambios minúsculos de hardware que fueron de onda por parte de mi viejo. Tengo 15 años y odio que me digan "miren la compu que le regalaron los papis" porque la verdad no fue así. Lo que tengo ahora fue fruto de laburo, esfuerzo y paciencia. Un saludo a todos. No puedo creer cuánto "creció" en... cuánto... ¿3 años y medio o 4? Dejo año por año que PC tuve y fotos Obviamente por cada plataforma voy a dejar la mejor configuración que tuve, ni en pedo pongo mes por mes las actualizaciones que le hacía 2011-2012 - La PC regalada Antes de las memorias Supertalent tuve 1x2GB 800MHz, no recuerdo la marca, pero si que, cuándo instalé el Dual channel de Supertalent la velocidad de carga era bastante mayor. Mi primera gpu en esta PC fue una XFX Geforce 8600GT 512MB DDR2 que jugaba al BF2: Bad Company a 1152x768 con todo bajo (no llegaba a jugar a 1280x720 que era la resolución mínima 16:9). Después de la 8600GT tuve una Sapphire HD6750 (la compré porque la 8600GT se había quemado) y 3 meses después mi viejo me la cambia por una Sapphire HD6770. Con la HD6750/HD6770 recuerdo jugar al BF3 cómo un campeón, ¡que tiempos! Y con 2GB de RAM, para esos que dicen que con 4GB no jugás a nada Me la habían regalado con un disco de 160GB que rápidamente reemplacé por uno de 500GB porque los SIMS 3 no me entraban más expansiones Antes de esta PC había tenido en el 2009/2010 (cuándo tenía 9 y 10 años, era un crío y apenas me insertaba en este rollo informático) un Pentium II que actualicé a Pentium III 833MHz @ 918MHz (una locura fue ocear eso, encima la Geforce 2 era un poco inestable a más de 920MHz el cpu porque si elevabas el bus del cpu, subían todos) y luego un Tual-latín de 1.13GHz El OC lo hacía mi viejo con el cooler stock, no cómo ahora que tenés que comprarle uno copado porque sino morís en el intento! El Core 2 Duo fue la primer PC que me puse a toquetear los clocks, aunque el con el Quad me metí seriamente. Intel Core 2 Duo E6320 1.8GHz @ 2.8GHz Big Typhon VX MSI P35 Neo 2x1GB Supertalent 800MHz WD Caviar Blue 500GB EuroCase Spacejam Vitsuba Master 500w Diciembre 2012 - La PC que salió de mi bolsillo Esta PC se la compré a mi papá, cuándo él upgradeo a un Phenom II x4 @ x6 1055T. Por esta época había comprado el SSD de 60GB y a mediados del 2013 compré el cross de XFX HD6850 DD que terminé quemando (1) con 1.65GHz en el core y waterblock. La que sufrió de semejante OC pude revivirla y vendí las dos juntas para después comprarme una XFX Double Fan HD6850. Para esta época mi viejo me quería y me hizo el canje por mi fuente que empezaba a pitar: me puso una Power Cooler PS-550SS, andaba cómo trompada hasta hace poco. La pc que le compré a mi papá venía con un P5Q, pero al toque se lo permuté por un P5Q-E con un pequeño problema en la Bios (a veces se le reiniciaba el OC). Intel Core 2 Quad Q6600 2.4GHz @ 3.4GHz Big Typhon VX Asus P5Q-E 2x2GB GSkill Super Pi 1000MHz XFX Double Fan HD6850 @ 950MHz Core - 1100MHz Memory 1.89v WD Caviar Blue 500GB Kingston KC300 60GB EuroCase Spacejam Power Cooler PS550-SS Finales de 2013 - Esfuerzo y paciencia El Core 2 Quad duró bastante poco. Estaba empezando a hacer renders más grandes y, sinceramente, el Quad no daba a basto para renderizar en un tiempo coherente y no me dejaba jugar a la vez, así que empecé a ahorrar... En 1 año exacto tuve la suerte de que mi viejo me seguía queriendo y encontró un tipo que quería vender su máquina. Era un i7 3770K, con un Asus P8Z77-V, crossfire de Sapphire Dual-X HD7950 (si, me la re acuerdo la pc) y una fuente bruta de 700w, no me acuerdo cuál Tenía un HAF 932 cómo Case Conseguí comprarle el i7+Asus P8Z77-V por $3000, una ganga... en esa época $3000 era el valor del i7 Estuve 3 o 4 meses con una memoria de 4GB que me prestaba mi viejo, hasta que compré el Dual Channel de 2133MHz Ripjaws. Intel Core i7 3770K Asus P8Z77-V 2x4GB GSkill Ripjaws 2133MHz XFX Double Fan HD6850 @ 875MHz Core - 1050MHz Memory 1.13v WD Caviar Blue 500GB Kingston KC300 60GB EuroCase Spacejam Power Cooler PS550-SS Ahora Ahora lo que hice fue permutar la HD6850 por TT V9 BlackX+$350 y comprar una XFX 850w Black Edition 80+ Silver, que está esperando una buena GPU La verdad que hoy (3/12/14) me separé del Spacejam (el gabinete) y siento algo de pena... era la última pieza que tenía en relación con mi primera PC, la que empezó todo. Realmente doy las gracias a mis viejos que me regalaron esa primera PC y me ayudó a poder ir escalando a la siguiente configuración, sinceramente si yo no vendía el C2Q ni loco llegaba al i7, y todo gracias al primer granito de arena que me dio mi familia. Además, vendí el equipo de audio y compré unos Edifier Encore X400. Para mi cumpleaños (27/10) me regalaron un volante Thurstmaster de 180° que cumple mis expectativas. Ahora tengo: Intel Core i7 3770K @ CM TX-3 (llega a 4.6GHz con 1.2v, tiene un batch increíble) Asus P8Z77-V 2x4GB GSkill Ripjaws 2133MHz Intel HD4000 WD Caviar Blue 500GB Kingston KC300 60GB XFX Black Edition 850w 80+ Silver Ojalá sepan apreciar sus compus y a toda la gente (si es que la hubo) que ayudó en el armado de la PC. Estoy agradecido con mi vieja, por las oportunidades que me dio en la vida y el aguante que me hace para cualquier decisión seria que tomo. Estoy agradecido de tener una buena familia fuera de las drogas, que a pesar de las trabas económicas podamos seguir unidos y contentos, porque por más que mi viejo me cague a puteadas y yo a él, se que es en alguien en quién se puede confiar, y viceversa. Gracias por leer gente! PD: Taringa! arreglame los emoticones que andan cómo el orto!

Lo que haré en esta entrada será seleccionar las preguntas más frecuentes que se hacen en Classic AMD Users y responderlas de la mejor forma posible, y sin preocuparme de que Taringa me corte el comentario a pesar de ser Elite y dejar mi virginidad por Taringa (? Bueno, ¡empecemos! Pregunta #1: ¿AMD FX o AMD APU? Yo soy de tirar más por el FX (o un Intel equivalente) por la siguiente razón: Las memorias para hacer funcionar bien a la iGPU del APU son algo más caras porque tienen que ser más rápidas y de más capacidad que con un FX. Mientras que el FX usa una GPU dedicada con su propia memoria de video GDDR5, tu APU preferido (6800K por ejemplo) va a necesitar al menos 1GB sólo para la iGPU, es decir, vas a necesitar 8GB 2133MHz o más para llegar al rendimiento de una R7 240 GDDR3, mientras que el FX alcanza y sobra con 4GB 1333MHz y su R7 250 1GB GDDR5, termina siendo apenas más caro el FX pero mucho más rendidor porque, además, el 6800K es un FX 4300 con iGPU básicamente, y por su contraparte con FX, podremos adquirir un FX 6300. Y esto, me lleva a la siguiente pregunta... Pregunta #2: ¿4GB para jugar alcanza? ¿Seguro? Una pena que no pueda comprobarlo porque ahora tengo Ubuntu y el Battefield 4 no corre por lógicas razones, pero cuándo tenía Windows 7 y 8.1, nunca vi juegos cómo el Battefield 4 consumir más de 1.5GB, y piden 4GB de requerimiento mínimo y 6GB de recomendado , y nunca, pero nunca (y eso que lo tenía en Ultra a 1366x768) lo vi superar 1.5GB, así que con 4GB de RAM tenemos espacio suficiente para dejar abierto Battefield 4 y Windows La velocidad, entre 1333MHz y 1600MHz no se nota diferencia (en benchmarks si, pero tu vida no es un benchmark, es el uso diario). Pregunta #3: ¿Intel o AMD? ¡Me dijeron que Intel es carísimo! Acá voy a decir algo que, ojalá, las personas que son de buen saber me apoyen en esto: Intel vale lo que cuesta. Si bien dicen que el i3 4330 vale cómo el FX 6300 y que éste último tiene 6 núcleos, hay que ver algunos benchmarks para darse cuenta que tener 6 núcleos es sólo un número, porque están parejos en rendimiento. Acá les dejo una comparativa confiable. ¡Están muy parejos! Y suele ganar el i3 4360... Ahora veamos cuánto vale cada uno: FX 6300 a $1500 + Asus M5A97 R2.0 a $1500 (NewH4rd / Gameron) o R2.0 EVO ($1900) Core i3 4360 a $1900 + Asus H97M-E a $1520 (NewH4rd / Gameron) Ambos mothers permiten overclock, soportan distintos tipos de RAID, tienen SATA III, USB 3.0, PCI-E 3.0, tu mamá 3.0, etc El Core i3 4360 se puede overclockear con ese mother, tal vez haciendo 37x105MHz FSB (no sé cuál es el multi máximo, abría que ver) llegue a unos bonitos 3885MHz Core, no es un mal número y superará al FX 6300 de una buena vez Ahora, recordemos que el i3 4360 tiene una HD 4600 integrada que el FX 6300 no posee... ¿que podremos jugar con esto? Calidad baja a 1280x1024 a más de 50fps en la mayoría de juegos, eso quiere decir que a 1280x720 vamos a poder jugar en Medio más que seguro a cualquier juego, con unas memorias estándard. Si no me equivoco, a todas las HD 4600 se les puede dar OC con el Intel Xtreme Tunning Utility, así que se las puede dejar entre 1350MHz a 1500MHz sin mucho drama Ya vimos que mal micro no es Y permite estirar la plataforma, comprando un 4790K y evitándonos el costo de comprar otro mother y procesador y, posiblemente, comprar DDR4. Así que ya saben, ¡a replantearlo! Siguienteee! Pregunta #4: Equivalencias de GPUs AMD Algunos piensan que las AMD Radeon R7/R9 Series son chips gráficos nuevos, y no es así a excepción de la R7 240 y la R9 290/290x. Las GPUs siguientes están ordenadas de menos potentes a más potentes, paso a explicar las equivalencias: R3 230 = HD 8400R7 240 = R7 240R7 250 = HD 7750 OCR7 250x = HD 7770 OCR7 260x = HD 7790 OCR7 265 = HD 7850 (menos cores)R9 270 = HD 7850 OCR9 270x = HD 7870 OCR9 280 = HD 7950 OCR9 280x = HD 7970 OCR9 290 = R9 290R9 290x = R9 290x Hay rumores de que la R7 365x / R9 370x va a ser una R9 280x renombrada y más económica (debido a su gran producción, el chip baja de precio). De todas formas la R9 390x supera con creces a la GTX 980Ti por lo que estuve viendo y, además, tiene una tasa de transferencia impresionante, corriendo sobre un Bus de 4096 Bits debido a su revolucionaria memoria. Ojalá el chip gráfico esté a la altura de la GTX 980Ti así AMD se vuelve a poner en la competición en cuánto High End se refiere, que por desgracia con las "antiguas" R9 290/290x se quedaron atrás frente a la GTX 970, y ni que hablar de la GTX 980 y 980Ti. Pregunta #5: ¿Cuánta más memoria en la placa de video, mejor? Cuándo dicen esto, sinceramente mijitos... me dan bronca, mucha bronca Se las perdono porque no saben Vi incontables veces gente recomendando, por ejemplo, la HD 6670 2GB GDDR3 antes que la HD 6670 1GB GDDR5... ¿por qué lo hacen? Una GPU depende mucho de su memoria interna, y por más que tenga 1GB de memoria más: Nunca se va a llenar ni siquiera 1GB de memoria porque el procesador gráfico no permite tener unos gráficos muy elevados, lo que se traduce cómo un render final de menor tamaño, por ende esos 2GB nunca se llenarán. De hecho, nunca se llenará 1GB si quiera.No depende tanto la capacidad de la memoria, sino su tipo. La memoria GDDR3 tiene mucha menor ancho de banda que la GDDR5 y va a suponer un cuello de botella para el chip gráfico. Por eso en placas de video cómo la HD 6770 1GB GDDR3, lo que más importa es overclockear las memorias, para poder sacar un poco el cuello de botella que está teniendo el chip gráfico debido al bajo ancho de banda de las memorias. Y adhiero al último punto, es un pecado y crimen ponerle memorias GDDR3 a tan buen chip gráfico Pregunta #6: ¿FX 8320 o FX 8350? La única diferencia es que el FX 8350 tiene turbo a 4.2GHz (base 4GHz) y el FX 8320 lo tiene a 4GHz (base 3.5GHz). Así que sin problemas podemos llevar nuestro FX 8320 a las mismas frecuencias que el FX 8350, y eso que "los 8350 overclockean más y mejor" no sé que tan cierto es, vi un par de FX 8320 llegando a 5GHz y 5.6GHz con voltajes lógicos Pregunta #7: ¿tope de gama de AMD o i7 4790K? Hablando de trabajos multimedia, el i7 suele ganar y por una buena diferencia. El problema es que lo normal, es asignar 2GB por núcleo en los trabajos de rendering de Adobe (por ejemplo), y con el FX de 8 núcleos tendríamos que tener 16GB de RAM mínimamente. Aunque en general y para trabajos pesados, prefiero realmente invertir en un i7 4790K con 16GB/32GB (depende los trabajos que se quieran hacer) antes que un FX 8320 y Water cooling custom para llevarlo a 6GHz, frecuencia en la cuál apenas supera al 4790K stock... de hecho, en rendering con Blender Cycles, el FX 9370 a 5GHz terminó el render con 7:49 Minutos, mientras que mi i7 3770K tuvo 7:39 Minutos con cooler stock a 4.2GHz La verdad, el valor de un H110 (el cooler que tenía el user del FX) + FX 9370 te podés comprar sin problemas un i7 4790K y tener menor consumo y un sistema más seguro y estable Lo que si, si estamos entre un FX 8320 ($2300-$2500 en ML) vs i5 4430 ($3000-$3200 en ML) prefiero el FX, que tiene un rendimiento similar y algo superior a 4.2GHz Pregunta #8: ¿Que tengo que tener en cuenta para un SLI / Crossfire? Antes que nada, considerá el SLI cuándo: Tu GPU siga siendo buena y sabés que con un SLI va a escalar y superar a la GPU que vos querés.Tengas una fuente que soporte tus dos placas de video trabajando a full load sin ningún problema.Tengas una buena ventilación en el gabinete. A lo que voy, es que no vale la pena por ejemplo hacer un SLI de GTX 650 Boost por ejemplo, pero si de GTX 660 (superan a una GTX 680 / 770), GTX 760/770/780/780Ti o las nuevas GTX 970 / 980. Además, un SLI de GTX 760 4GB rinde más que una GTX 780Ti y costaba menos, ahí conviene mucho. Si bien está "de moda" poner dos terribles placas en SLI/Crossfire, también están los que evalúan el mercado y se fijan: "uh mirá, un Crossfire de HD7970 usado que está acá rinde cómo una GTX 970 o poco más y vale 3k menos". Son cosas que se evalúan precio-rendimiento en el momento La verdad, sigue siendo buena opción hacer SLI de GTX 660 / 660Ti. Ya de por si una GTX 660Ti con OC le pisa los talones a la HD 7950 y supera a la R9 270x. Lo más conveniente sería hacer un SLI de GTX 760 / HD 7950 en adelante, pero cuándo no hay presupuesto y la gpu que tenemos no se puede vender, podremos montar un SLI/Crossfire si la fuente no es problema Lo que si, ¡atentos a la temperatura! Si las GPUs están muy cerca pueden ganar 4°-6°c más que estando solas, si éstas no tienen buena refrigeración y el gabinete no es descente pueden tocar temperaturas peligrosas en full load. Pregunta #9: Tengo un Phenom II, ¿actualizo a un FX o espero? Depende de donde vengas y a donde querés ir Si tenés un Phenom II x4 965 BE (por ejemplo) y querés ir a un FX 4300 realmente vas a perder rendimiento, y con un FX 6300 vas a tener un poquito más de rendimiento, que la verdad, por la movida que tenés que hacer, me quedaría con el Phenom II x4 y a darle rosquilla se a dicho Si venís de un Phenom II x6 1100T BE y vas al FX 8320, tampoco vale la pena... mejor overclockear el x6 (ya sea 1075T, 1090T, etc) hasta 3.8GHz y vas a tener mejor o similar rendimiento, ¡una lástima que sea así! Pregunta #10: ¿Que GPU es mejor? Hoy en día, la cosa viene así (ordenado de menos potente a más potente): Gracias @Aidenn por la corrección de algunas GPUs y sugerencias nuevas R7 240 GDDR3R7 240 GDDR5 / HD 6670 / HD 7730R7 250R7 250x / HD 7770 GHz Edition / HD 6850 / HD 6870GTX 560TiGTX 750 / R7 250x Boost / HD 7790 / HD 6870 / HD 6850 OCGTX 650 Ti Boost / HD 6950 / HD 6870 1GHz / HD 7790 OCR7 260xGTX 750TiR7 265 / GTX 650TI Boost / GTX 750TI OCHD 7850 (apenas superior que la R7 265) / R7 265 OC / R7 260x OC / GTX 750Ti OCR9 270 / HD 7850 OC / GTX 660R9 270x OC / HD 7870 OC / GTX 660TiGTX 760 / R9 270x OCR9 280 / HD 7950 / GTX 670R9 280xGTX 770 / R9 280x OCR9 290GTX 780 / TitanGTX 780 3GB SLI / GTX Titan ZGTX 970R9 290x / R9 270x 4GB CFXGTX 780Ti / SLI GTX 760 4GBGTX Titan BlackGTX 980GTX 980 OC / SLI GTX 770 4GBR9 295x2 / R9 290 4GB CFXGTX 980TiR9 390x (al parecer) Por ahora no se me ocurren más cosas, ¡iré agregando! Cualquier corrección es bienvenida. Soy ser humano y me puedo equivocar che... ¡Felices fiestas!

Lo que haré en esta entrada será seleccionar las preguntas más frecuentes que se hacen en Classic AMD Users y responderlas de la mejor forma posible, y sin preocuparme de que Taringa me corte el comentario a pesar de ser Elite y dejar mi virginidad por Taringa (? Bueno, ¡empecemos! Pregunta #1: ¿AMD FX o AMD APU? Yo soy de tirar más por el FX (o un Intel equivalente) por la siguiente razón: Las memorias para hacer funcionar bien a la iGPU del APU son algo más caras porque tienen que ser más rápidas y de más capacidad que con un FX. Mientras que el FX usa una GPU dedicada con su propia memoria de video GDDR5, tu APU preferido (6800K por ejemplo) va a necesitar al menos 1GB sólo para la iGPU, es decir, vas a necesitar 8GB 2133MHz o más para llegar al rendimiento de una R7 240 GDDR3, mientras que el FX alcanza y sobra con 4GB 1333MHz y su R7 250 1GB GDDR5, termina siendo apenas más caro el FX pero mucho más rendidor porque, además, el 6800K es un FX 4300 con iGPU básicamente, y por su contraparte con FX, podremos adquirir un FX 6300. Y esto, me lleva a la siguiente pregunta... Pregunta #2: ¿4GB para jugar alcanza? ¿Seguro? Una pena que no pueda comprobarlo porque ahora tengo Ubuntu y el Battefield 4 no corre por lógicas razones, pero cuándo tenía Windows 7 y 8.1, nunca vi juegos cómo el Battefield 4 consumir más de 1.5GB, y piden 4GB de requerimiento mínimo y 6GB de recomendado, y nunca, pero nunca (y eso que lo tenía en Ultra a 1366x768) lo vi superar 1.5GB, así que con 4GB de RAM tenemos espacio suficiente para dejar abierto Battefield 4 y Windows La velocidad, entre 1333MHz y 1600MHz no se nota diferencia (en benchmarks si, pero tu vida no es un benchmark, es el uso diario). Los programas se adaptan y configuran su compresión en tiempo real según la capacidad de tu RAM... por eso, si tenés 4GB de RAM puede que tarde más que teniendo 8GB ya que la aplicación tendrá que adaptarse y comprimirse más. Pregunta #3: ¿Intel o AMD? ¡Me dijeron que Intel es carísimo! Acá voy a decir algo que, ojalá, las personas que son de buen saber me apoyen en esto: Intel vale lo que cuesta. Si bien dicen que el i3 4360 vale cómo el FX 6300 y que éste último tiene 6 núcleos, hay que ver algunos benchmarks para darse cuenta que tener 6 núcleos es sólo un número, porque están parejos en rendimiento. Acá les dejo una comparativa confiable. ¡Están muy parejos! Y suele ganar el i3 4360... Ahora veamos cuánto vale cada uno: FX 6300 a $1500 + Asus M5A97 R2.0 a $1500 (NewH4rd / Gameron) o R2.0 EVO ($1900) Core i3 4360 a $1900 + Asus H97M-E a $1520 (NewH4rd / Gameron) Ambos mothers permiten overclock, soportan distintos tipos de RAID, tienen SATA III, USB 3.0, PCI-E 3.0, tu mamá 3.0, etc El Core i3 4360 se puede overclockear con ese mother, tal vez haciendo 37x105MHz FSB (no sé cuál es el multi máximo, creo que es x37) llegue a unos bonitos 3885MHz Core, no es un mal número y superará al FX 6300 de una buena vez Aunque si se overclockea el FX hasta 4.1GHz (se le puede hacer con el cooler stock según me dijeron) no tiene nada que envidiarle, y si se adquiere un CM 212+ cómo cooler, el FX 6300 puede llegar hasta 4.4GHz o incluso 4.5GHz, mientras que ocear al i3 por FSB será riesgoso y necesitará bastante voltaje para ser estable En cuánto al FX y si no me equivoco, su arquitectura es mucho mejor si se overclockea por FSB (no digo que no toquen el multi, pero no es como los Intel K por ejemplo que podés obtener 6400MHz con el multi en x64 y el FSB en 100MHz... su arquitectura permite eso, pero en AMD es diferente), obteniéndose mejores resultados de rendimiento si se ocea por FSB. Ahora, recordemos que el i3 4360 tiene una HD 4600 integrada que el FX 6300 no posee... ¿que podremos jugar con esto? Calidad baja a 1280x1024 a más de 50fps en la mayoría de juegos, eso quiere decir que a 1280x720 vamos a poder jugar en Medio más que seguro a cualquier juego, con unas memorias estándar (1600MHz, aunque recordemos que el Sweet Point de los Haswell son 2133MHz aunque en este caso no es tan importante tenerlas a dicha frecuencia aunque, cuánta más velocidad, mayor transferencia de ancho de banda tendrá la GPU y obtendremos más FPS, porque el cuello de botella de las iGPUs suelen ser la baja velocidad de la memoria del sistema). Si no me equivoco, a todas las HD 4600 se les puede dar OC con el Intel Xtreme Tunning Utility, así que se las puede dejar entre 1350MHz a 1500MHz sin mucho drama Ya vimos que mal micro no es Y permite estirar la plataforma, comprando un 4790K y evitándonos el costo de comprar otro mother y procesador y, posiblemente, comprar DDR4. Así que ya saben, ¡a replantearlo! Siguienteee! Pregunta #4: Equivalencias de GPUs AMD Algunos piensan que las AMD Radeon R7/R9 Series son chips gráficos nuevos, y no es así a excepción de la R7 240 y la R9 290/290x. Las GPUs siguientes están ordenadas de menos potentes a más potentes, paso a explicar las equivalencias: R3 230 = HD 8400R7 240 = R7 240R7 250 = HD 7750 OCR7 250x = HD 7770 OCR7 260x = HD 7790 OCR7 265 = HD 7850 (menos cores)R9 270 = HD 7850 OCR9 270x = HD 7870 OCR9 280 = HD 7950 OCR9 280x = HD 7970 OCR9 290 = R9 290R9 290x = R9 290x Hay rumores de que la R7 365x / R9 370x va a ser una R9 280x renombrada y más económica (debido a su gran producción, el chip baja de precio). De todas formas la R9 390x supera con creces a la GTX 980Ti por lo que estuve viendo y, además, tiene una tasa de transferencia impresionante, corriendo sobre un Bus de 4096 Bits debido a su revolucionaria memoria. Ojalá el chip gráfico esté a la altura de la GTX 980Ti así AMD se vuelve a poner en la competición en cuánto High End se refiere, que por desgracia con las "antiguas" R9 290/290x se quedaron atrás frente a la GTX 970, y ni que hablar de la GTX 980 y 980Ti. Pregunta #5: ¿Cuánta más memoria en la placa de video, mejor? Cuándo dicen esto, sinceramente mijitos... me dan bronca, mucha bronca Se las perdono porque no saben Vi incontables veces gente recomendando, por ejemplo, la HD 6670 2GB GDDR3 antes que la HD 6670 1GB GDDR5... ¿por qué lo hacen? Una GPU depende mucho de su memoria interna, y por más que tenga 1GB de memoria más: Nunca se va a llenar ni siquiera 1GB de memoria porque el procesador gráfico no permite tener unos gráficos muy elevados, lo que se traduce cómo un render final de menor tamaño, por ende esos 2GB nunca se llenarán. De hecho, nunca se llenará 1GB si quiera.No depende tanto la capacidad de la memoria, sino su tipo. La memoria GDDR3 tiene mucha menor ancho de banda que la GDDR5 y va a suponer un cuello de botella para el chip gráfico. Por eso en placas de video cómo la HD 6770 1GB GDDR3, lo que más importa es overclockear las memorias, para poder sacar un poco el cuello de botella que está teniendo el chip gráfico debido al bajo ancho de banda de las memorias. Y adhiero al último punto, es un pecado y crimen ponerle memorias GDDR3 a tan buen chip gráfico Pregunta #6: ¿FX 8320 o FX 8350? La única diferencia es que el FX 8350 tiene turbo a 4.2GHz (base 4GHz) y el FX 8320 lo tiene a 4GHz (base 3.5GHz). Así que sin problemas podemos llevar nuestro FX 8320 a las mismas frecuencias que el FX 8350, y eso que "los 8350 overclockean más y mejor" no sé que tan cierto es, vi un par de FX 8320 llegando a 5GHz y 5.6GHz con voltajes lógicos Pregunta #7: ¿tope de gama de AMD o i7 4790K? Hablando de trabajos multimedia, el i7 suele ganar y por una buena diferencia. El problema es que lo normal, es asignar 2GB por núcleo en los trabajos de rendering de Adobe (por ejemplo), y con el FX de 8 núcleos tendríamos que tener 16GB de RAM mínimamente. Aunque en general y para trabajos pesados, prefiero realmente invertir en un i7 4790K con 16GB/32GB (depende los trabajos que se quieran hacer) antes que un FX 8320 y Water cooling custom para llevarlo a 6GHz, frecuencia en la cuál apenas supera al 4790K stock... de hecho, en rendering con Blender Cycles, el FX 9370 a 5GHz terminó el render con 7:49 Minutos, mientras que mi i7 3770K tuvo 7:39 Minutos con cooler stock a 4.2GHz La verdad, el valor de un H110 (el cooler que tenía el user del FX) + FX 9370 te podés comprar sin problemas un i7 4790K y tener menor consumo y un sistema más seguro y estable Lo que si, si estamos entre un FX 8320 ($2300-$2500 en ML) vs i5 4430 ($3000-$3200 en ML) prefiero el FX, que tiene un rendimiento similar y algo superior a 4.2GHz Pregunta #8: ¿Que tengo que tener en cuenta para un SLI / Crossfire? Antes que nada, considerá el SLI cuándo: Tu GPU siga siendo buena y sabés que con un SLI va a escalar y superar a la GPU que vos querés.Tengas una fuente que soporte tus dos placas de video trabajando a full load sin ningún problema.Tengas una buena ventilación en el gabinete. A lo que voy, es que no vale la pena por ejemplo hacer un SLI de GTX 650 Boost por ejemplo, pero si de GTX 660 (superan a una GTX 680 / 770), GTX 760/770/780/780Ti o las nuevas GTX 970 / 980. Además, un SLI de GTX 760 4GB rinde más que una GTX 780Ti y costaba menos, ahí conviene mucho. Si bien está "de moda" poner dos terribles placas en SLI/Crossfire, también están los que evalúan el mercado y se fijan: "uh mirá, un Crossfire de HD7970 usado que está acá rinde cómo una GTX 970 o poco más y vale 3k menos". Son cosas que se evalúan precio-rendimiento en el momento La verdad, sigue siendo buena opción hacer SLI de GTX 660 / 660Ti. Ya de por si una GTX 660Ti con OC le pisa los talones a la HD 7950 y supera a la R9 270x. Lo más conveniente sería hacer un SLI de GTX 760 / HD 7950 en adelante, pero cuándo no hay presupuesto y la gpu que tenemos no se puede vender, podremos montar un SLI/Crossfire si la fuente no es problema Lo que si, ¡atentos a la temperatura! Si las GPUs están muy cerca pueden ganar 4°-6°c más que estando solas, si éstas no tienen buena refrigeración y el gabinete no es descente pueden tocar temperaturas peligrosas en full load. Pregunta #9: Tengo un Phenom II, ¿actualizo a un FX o espero? Depende de donde vengas y a donde querés ir Si tenés un Phenom II x4 965 BE (por ejemplo) y querés ir a un FX 4300 realmente vas a perder rendimiento, y con un FX 6300 vas a tener un poquito más de rendimiento, que la verdad, por la movida que tenés que hacer, me quedaría con el Phenom II x4 y a darle rosquilla se a dicho Si venís de un Phenom II x6 1100T BE y vas al FX 8320, tampoco vale la pena... mejor overclockear el x6 (ya sea 1075T, 1090T, etc) hasta 3.8GHz y vas a tener mejor o similar rendimiento, ¡una lástima que sea así! Pregunta #10: ¿Que GPU es mejor? Hoy en día, la cosa viene así (ordenado de menos potente a más potente): Gracias @Aidenn por la corrección de algunas GPUs y sugerencias nuevas R7 240 GDDR3R7 240 GDDR5 / HD 6670 / HD 7730R7 250R7 250x / HD 7770 GHz Edition / HD 6850 / HD 6870GTX 560TiGTX 750 / R7 250x Boost / HD 7790 / HD 6870 / HD 6850 OCGTX 650 Ti Boost / HD 6950 / HD 6870 1GHz / HD 7790 OCR7 260xGTX 750TiR7 265 / GTX 650TI Boost / GTX 750TI OCHD 7850 (apenas superior que la R7 265) / R7 265 OC / R7 260x OC / GTX 750Ti OCR9 270 / HD 7850 OC / GTX 660R9 270x OC / HD 7870 OC / GTX 660TiGTX 760 / R9 270x OCR9 280 / HD 7950 / GTX 670HD 7970R9 280x / HD 7970 OCGTX 770 / R9 280x OCR9 290GTX 780 / TitanGTX 780 3GB SLI / GTX Titan ZGTX 970R9 290x / R9 270x 4GB CFXGTX 780Ti / SLI GTX 760 4GBGTX Titan BlackGTX 980GTX 980 OC / SLI GTX 770 4GBR9 295x2 / R9 290 4GB CFXGTX 980TiR9 390x (al parecer) Pregunta #11: En la gama media-alta y alta de GPUs, ¿que elijo? Por ahora y hasta mediados del 2015 si no me equivoco, Nvidia no va a tener una competencia real. Esto es porque la GTX 7xx son las que compiten con las R7 y R9 200 Series de AMD. Las GTX 9xx compiten con la serie 300 de AMD, pero éstas fueron retrasadas hasta finales del 2015 (según leí) debido a las grandes mejorías que tuvieron la serie GTX 9xx de Nvidia que, al parecer, eran mucho más de las que AMD se esperaba. Además a TSMC le está costando llevar los chips a 20nm, algo que también le costó a Nvidia y fue su principal retraso al lanzar las GTX 9xx Ahora con esta breve explicación, vayamos al punto Una GTX 770 por ejemplo, es mejor que la 280x, pero cuándo estámos ajustados, lo mejor sería comprar una buena ensambladora de la 280x y darle OC en caso de necesidad. Recordemos que si no tenemos un buen procesador y queremos jugar con Physics, lo mejor es comprar la 770, porque las bajadas de Frames con Physics+procesador malo nos van a asustar En resúmen, hay que comprar lo que pueda el bolsillo, yo particularmente prefiero seguir ahorrando y comprarme una GTX 970, pero allá están los apurados Después por ejemplo, si estamos queriendo comprar la R9 290x, por menos dinero tenemos la GTX 970 que rinde más Pregunta #12: ¿Por qué es tan importante el Dual Channel? Esto es bastante simple de explicar: Un kit Dual Channel de 2400MHz por ejemplo, tiene dos memorias que corren a 1200MHz reales y, en Dual Channel, tienen una velocidad efectiva de 2400MHz (2 canales que corren a 1200MHz). Ahora bien, si sacamos una memoria, más allá de tener un módulo menos de memoria, tendremos la mitad de transferencia de ancho de banda porque sólo se usa un canal de transferencia Esto no es una estafa y, de hecho, el tipo de memoria especifica esto: DDR = Double Data Rate (en Español Doble 'Ratio' de datos o Velocidad de datos doble). Miguel Roldan tal vez lo explique mejor (@miguel0884, corregido por @IceGames): sea o no sea Dual channel la frecuencia efectiva de una memoria de 2400MHz es de 2400MHz y la real es 1200MHz, por eso double rate: lo que el Dual channel hace es duplicar las puertas de salida o bit y así aumenta la tasa de transferencia. Hay 2 modos: Ganged (Dual channel): 64bit en el cual los bancos de cruzan para mejorar la transferencia de datos entre los módulos.Unganged (Dual single channel): 128bit que usa los 2 bancos como uno solo pero de mayor capacidad de transferencia de datos que uno de 64bit. Este modo casi no se usa pero en plataformas AMD, si usáss los 4 bancos DIMM de la mother pasas a usar el modo Unganged Pregunta #13: ¿Plataforma AM1 o BGA1170? Acá voy a profundizar enormemente porque, a simple vista, son dos plataformas con similares rendimientos en los cuáles, la mayor diferencia que existe es su precio, y ambos están bastante ajustados. La verdad que veo que un Quad Core de AMD, por primera vez, le pisa e incluso le gana a un Quad Core de Intel a mayor frecuencia... Ahora que tenemos la teoría plasmada, vamos a ver cuánto vale armar una PC con esta plataforma hoy en día (Argentina). PC AMD ($1620) AMD Athlon 5350Gigabyte GA-AM1m-S2HEl mother ofrece dos salidas USB 3.0 y dos 2.0, salida HDMI, dos salidas PS/2 para Mouse y teclado y una ficha RJ-45 para red Gigabit, perfil Intel XMP para las memorias de hasta 1600MHz, un PCI-E x16 corriendo a velocidad de x4, dos PCI-E x1 y dos SATA III, sinceramente lo mejorcito que se puede encontrar > + Info PC Intel ($1635) Intel Celeron J1900 (Soldado) Este Asrock Q1900b-itx (mother con J1900 soldado, así se comercializan todos) posee una ficha RJ-45 Gigabit y un diseño diminuto. Hay que aclarar que este Asrock no se le pueden poner otras memorias que no sean las SO-DIMM DDR3 (las de Notebook) así que desde ya les digo que si tenían memorias SDRAM de PC de escritorio, tendrán que comprar si o si unas SO-DIMM En cuánto el mother en si, tiene las mismas salidas que el Gigabyte, solo que este en vez de tener 2 USB 2.0 y 2 USB 3.0, tiene 1 USB 3.0 y 3 USB 2.0 + Info Cosas a tener en cuenta: Las desventajas de la plataforma Intelera es que no ofrece ningún tipo de expansión, ni siquiera de placa de video ya que posee un PCI-E x1 de bajo rendimiento, así que no le podremos poner algo más que una placa wifi. En cambio, el AM1 se le puede tranquilamente colocar una XFX R7 250 de las Low Profile y jugar bien, porque el procesador la verdad, ¡no es malo para esa GPU! Entonces, la plataforma Intel consume menos porque las memorias SO-DIMM (tengo entendido) son de menor consumo, además que el Celeron J1900 tiene un TDP de 10w contra los 25w del Athlon 5350 pero, a fin de cuentas, si compramos cualquier combo gabinete itx+fuente, poseen una fuente de entre 300w y 450w, más que suficiente para mover cualquiera de las dos configuraciones sin ningún tipo de problema ¡Ahora pasemos a las pruebas de rendimiento! x264 HD Pruebas con HD 7970 y APU 5350 Pruebas con GTX 770 y APU 5350 Los invito además, a que vean este benchmark de TechSpot en el que se ve cómo el APU 5350 pasa por arriba al J1900 de Intel en todas las pruebas, ¡por fin AMD sacaste un procesador mejor y a menores frecuencias! Felicidades chicos Review de TechSpot. En resúmen, compren el AM1 sin dudarlo, además por más que posea un cooler, la verdad que mucho ruido no hace Pregunta #14: ¿Y por qué no un G3220? Algo que puede sorprendernos es la plataforma 1150 de Intel. Ayer con mi papá viendo este tema, me hizo ver una serie de cosas: En OCStore está el Celeron J1900 con el mismo mother Asrock por $1170 ARG¡La plataforma 1150 es más barata que AMD! ¡Si! Así tal cuál lo leyeron, me parece que AMD ya no compite ni siquiera por precio Vamos a darle claridad a este asunto para que no digan que soy un fanboy y que la plataforma 1150 es mucho más cara, porque no es así Tenemos un Pentium G3220 por $100 menos que el Athlon 5350 y un Gigabyte GAH81m-h por $950, lo que hace un total de $1850, que son $200 más que el APU 5350 pero esa diferencia de plata (que hoy por hoy es salir a comprar la comida para un día y medio) vale la pena, y ya nos damos cuenta viendo benchmarks que hasta en juegos es mejor. Benchmark del AMD Athlon 5350 y del Pentium G3220. Por $200 más tenemos una plataforma que, a pesar de que consuma más que el Athlon 5350, tiene algo más de rendimiento y el día de mañana le metemos un i7 4790K y seguimos tirando. Esa capacidad de upgrade no tiene precio la verdad Pregunta #15: ¿Que velocidad de RAM tengo que poner? ¿Cuál es la recomendada? Este video de LinusTechTips lo deja muy claro. Resúmen: Al menos que trabajen con aplicaciones serias de renderizado (After Effects, Blender, 3DSMax, etc) no vale la pena comprar memorias de gran frecuencia. Para gaming, 1333MHz Dual channel alcanza y sobra. Por ahora no se me ocurren más cosas, ¡iré agregando! Cualquier corrección es bienvenida. Soy ser humano y me puedo equivocar che... ¡Felices fiestas!

Este post es muy viejo. ¡Ahora podés entrar a mi portafolio con todos mis proyectos! Hola Taringueros! Les quiero comentar, que ya hace un tiempo estoy desarrollando videojuegos en Unity 3D. Un poco sobre mi: Vivo actualmente en Argentina, tengo 13 años, y programo en más de 8 lenguajes distintos, y se manejar todos con un conocimiento normal o excelente He creado un sitio web con el nombre de Ice Games, para publicar mis juegos y software que desarrollo y, de esta forma, mantenerlos al tanto de las novedades, lo que pasa con cada proyecto... etc Los lenguajes que se programar son: Diseño web CSS, HTML, PHP, Javascript (poco), MySQL (poco) Programación de software VB, C++, C# (medio), UnityScript, Unity3D Actualmente, estoy desarrollando un juego llamado Big Wheel. Un juego de carreras callejeras. Ya hice un script para simular el vehículo, pero no logro que las ruedas giren como tienen que girar (giran de costado XD). Lo más probable es que sea el modelo 3D, luego lo veré jaja Ustedes podrán leer esta página para publicarte en mi sitio web Mis Proyectos! Por un lado, tengo al Laberín 3D, que fue un proyecto entretenido, para matar tiempo, pero si te ponías a buscar bugs, los encontrabas de todos los colores xD. Como es un proyecto terminado, pueden entrar en este link. Allí lo podrán jugar online, ver fotos, videos, etc. Laberín 2.0 (Alpha) En primer lugar, ¿que es la palabra Alpha (o alfa)? Es la primera versión del programa, la cual es enviada a los verificadores para probarla, o bien a los que estén interesados en él. Algunos equipos de desarrollo utilizan el término alfa informalmente para referirse a una fase donde un producto todavía es inestable, aguarda todavía a que se eliminen los errores o a la puesta en práctica completa de toda su funcionalidad, pero satisface la mayoría de los requisitos. Galería . . . . Historia La historia está en progreso, pero se espera que sea parecida a esta. Carl es el personaje ¿Porqué Carl escapa de este mundo? Los padres de carl entraron en guerra con el planeta Goyhana, un planeta guerrero, en el que dominaban las terribles bestias, dotados de colmillos, una gran fuerza y altura, y armas de última generación. Los padres de Carl, Sarah y Ray, decidieron enviar a Carl a un planeta habitable, en el cuál él se pudiera desarrollar, llamado Tierra. Resulta, que estas bestias han empezado a invadir este planeta, poco a poco, hay más muertos y más bestias decididas a matar a aquél que se les interponga. ¿Podrá Carl hacerle frente a esta catástrofe? Esperemos que sí, porque si no, el mundo se acabará rápido Pueden descargarlo (versión Alpha, recuerden), clic acá Juegos en desarollo Big Wheel Estoy empezando con este juego, desinteresadamente, para empezar un videojuego de coches. Por ahora no he programado mucho, solo lo que son las cámaras, pero bueno, lo he empezado hace 2 días, y no pongo todo el día en él Bueno, como lo empecé hace poquito, solo tengo pocas imágenes, pero dejen esta página en favoritos para seguir los avances. Actualizado! Mapa de Italia al 50% Este juego está en etapa de desarrollo, le falta mucho... pero no tanto para publicar el Alfa