Intel_Developers

Usuario

Esta serie de videos presenta una introducción a las herramientas de Intel disponibles para los desarrollador juegos para Android*. Descubre los beneficios que estas herramientas pueden traer a tu día a día como programador, sea que desarrolles para dispositivos con arquitectura Intel o no. Estas herramientas mejorarán tu rutina de trabajo ahorrándote tiempo, dándote herramientas para crear experiencias más interesantes y ayudándote a apuntar tu juego a múltiples arquitecturas y plataformas con el menor esfuerzo posible. Dale una mirada a los videos de tu interés y sigue los links en pantalla para conocer más acerca de las herramientas. Activa los subtítulos en español dando clic al botón "CC" del player de video. Intel® Graphics Performance Analyzers Seth Schneider, Intel Technical Engineer Seth presenta el Analizador de rendimiento de gráficos, un conjunto de potentes herramientas que ayudan a los desarrolladores a utilizar todo el potencial de la plataforma. Los analizadores proveen una visión del rendimiento del sistema en tiempo real, rastrear errores, localizar problemas gráficos y mucho más. link: https://www.youtube.com/embed/vc2HjMf238A ¿Quieres ver el resto de los videos? Sigue este link.

Esta serie de videos presenta una introducción a las herramientas de Intel disponibles para los desarrolladores Android*. Descubre los beneficios que estas herramientas pueden traer a tu día a día como programador, sea que desarrolles para dispositivos con arquitectura Intel o no. Estas herramientas mejorarán tu rutina de trabajo ahorrándote tiempo, dándote herramientas para crear experiencias más interesantes y ayudándote a apuntar tu aplicación a múltiples arquitecturas y plataformas con el menor esfuerzo posible. Dale una mirada a los videos de tu interés y sigue los links en pantalla para conocer más acerca de las herramientas. Activa los subtítulos en español dando clic al botón "CC" del player de video. Desarrollar apps en HTML5 mediante Intel XDK Dale Schouten, Intel Technical Consulting Engineer El Intel XDK te permite desarrollar en HTML5 y obtener aplicaciones móviles instalables para Android*, Windows* y iOS*. Dale nos guía a través de las características de la herramienta que facilita a los desarrolladores crear, depurar y desplegar aplicaciones a través de múltiples sistemas operativos, utilizando un solo código base. link: https://www.youtube.com/embed/-JUVzO8pqTk ¿Quieres ver el resto de los videos? Sigue este link!

En esta entrevista, el actor que se hizo conocido por interpretar a Sheldon Cooper, cuenta sus gustos tecnológicos fuera de “The Big Bang Theory”. Por Ben Worthen Jim Parsons, protagonista de la comedia de CBS “The Big Bang Theory”, no es físico teórico en la vida real, pero es sin lugar a dudas agradable y considerado. Hace poco tiempo estuvo varios días en Los Ángeles grabando una serie de anuncios para Intel RealSense, una tecnología de cámaras 3D que posibilita a las computadoras personales ver como si fueran personas. Llegó al set de filmación después de haber dedicado tiempo a familiarizarse con esta tecnología. En un rato libre que tuvo entre la filmación de escenas y posar para 50 de las fotos de licencia de conducir más ridículas que se hayan visto, nos concedió una breve entrevista. ¿Cuál fue la primera vez que usaste una computadora? La primera computadora que usé fue la Commodore 64. Yo iba a la escuela primaria. No sé por qué la teníamos y no sé por qué aprendía técnicas de programación muy básicas. Tenía que hacer ya no me acuerdo qué para que un punto se moviera por la pantalla y después repitiera el movimiento una y otra vez. Sin embargo, eso no me llevó a tener una exitosa carrera en este ramo. ¿Qué tipo de tecnología o dispositivos utilizas ahora? Tengo una computadora portátil, un iPad, mi teléfono y mi Kindle. Y aquí es donde se pone interesante porque la tecnología se ha infiltrado tanto en nuestra vida que podría continuar y decir el DVR, el sistema Sonos y así hasta el horno de microondas. Creo que no soy muy diestro con la tecnología. No juego habitualmente ni nada parecido, y así y todo he delegado muchas de las responsabilidades de mi vida a la tecnología, que me ha simplificado muchas cosas. ¿Sientes que aprecias la tecnología? La doy por sentada. Es algo que se aprovecha, como la electricidad. Existe, ¿pero no ha existido siempre? Aunque soy muy consciente de que no. Creo que eso se debe a lo bueno que es el diseño, también, porque las cosas que uso todos los días están tan bien diseñadas que no pienso en ellas. No vivimos en un estado de asombro permanente. Lo maravilloso es que no es necesario pensar en ellas. Alcanza con presionar un botón. ¿Qué aspectos de la tecnología te entusiasman? Me entusiasma todo lo nuevo, para ser sincero. También me ocurre lo mismo con novedades que no son tecnológicas. Como un nuevo libro, un nuevo programa de televisión, cualquier cosa nueva. No me considero alguien que enloquece por los aparatos nuevos, digamos. Pero al mismo tiempo generan mucho entusiasmo y dan ganas de ver si son algo que nos queremos llevar a casa y usar en nuestra vida. Tuviste la oportunidad de probar la tecnología RealSense en el set. ¿Qué piensas de ella? Al probar esta tecnología quedé pasmado. Tiene algo tan natural que resulta apasionante. Pero a la vez es algo extraña. Como el escaneo 3D: en lo único en lo que tenía que concentrarme era en mantener la cabeza en una posición y moverla a la izquierda y a la derecha. Ni siquiera llevó mucho tiempo, fue bastante poco lo que tuve que hacer, y ¡bam! Ahí estaba. En un clic, la versión digital de mi cara estaba en un avatar. No uso videojuegos, pero si lo hiciera, podría estar en cualquier juego. Es tan divertido, porque durante años pudimos usar pantallas táctiles, pero esto tiene el efecto de hacerte sentir casi si pudieras hacer más presión, aunque en ningún momento toqué nada. El efecto parece ser más profundo que la experiencia de la pantalla táctil únicamente. ¿Quieres conocer más sobre la tecnología RealSense que cautivó a Jim Parsons? Sigue este link. ¿Quieres ver lo que los desarrolladores están haciendo con RealSense? Haz click aquí.

Las prendas inteligentes son una de las últimas tendencias en la tecnología informática. El sistema operativo Android* Wear de Google las convierte en un nuevo suelo fértil para el desarrollo de aplicaciones. En este artículo daremos un panorama general de Android Wear, con especial atención a los dispositivos que se pueden usar como prendas, los tipos de aplicaciones y cómo desarrollarlas y depurarlas. También explicaremos dos maneras de depurar aplicaciones para prendas inteligentes mediante ADB. Dispositivos El concepto de prenda inteligente abarca distintos tipos de aparatos: auriculares, dispositivos médicos y de ejercitación, joyas electrónicas y hasta dispositivos para animales domésticos. Actualmente, la categoría de productos estrella es la de relojes inteligentes. Las empresas de tecnología más importantes ofrecen sus propias líneas de relojes basados en Android Wear. Pebble Steel*, ASUS ZenWatch*, Motorola 360*, LG G Watch R* y Samsung Gear S* son las más recientes del mercado. Todas tienen diseños diferentes, pero comparten funcionalidades admitidas por Android Wear: tecnología Google Now*, registro de actividad física, control de la música y órdenes por voz. Además, todos los relojes inteligentes dependen de dispositivos móviles Android/iOS* que se comunican con ellos por Bluetooth*. Hay aplicaciones especiales para conectar smartphones y tabletas electrónicas a las prendas inteligentes. ¿Qué se puede desarrollar? Aunque Android Wear es un proyecto relativamente nuevo, Android Wear Center, el equivalente a Google Play*, ofrece una amplia gama de aplicaciones ideadas específicamente para prendas inteligentes. Hay muchísimas para relojes. Todos los días, Android Wear Center publica nuevos lanzamientos de aplicaciones de personalización, música, comunicación, salud, ejercicio y diversos otros tipos. A pesar de lo pequeñas que son las pantallas de los relojes, también hay juegos estilo arcade y de ingenio para ellos, aunque todavía no muchos. La gran mayoría de las aplicaciones Wear son diseños de esfera de reloj, que personalizan la función esencial, que es la de indicar la hora. ¿Cómo se puede desarrollar? Por una parte, crear aplicaciones para Android Wear se parece mucho a desarrollar para tabletas y smartphones. Se pueden utilizar herramientas ya conocidas como el JDK, el SDK de Android (Android Wear es compatible con la mayoría de las API de Android), Eclipse*, Android Studio y otros entornos de desarrollo integrado. Este vínculo conduce a una lista de las clases de la biblioteca Wearable Support. Por otra parte, Google brinda una visión y principios de diseño exclusivos del desarrollo de aplicaciones para prendas inteligentes, que tratan las diferencias fundamentales entre esta tecnología y la de dispositivos móviles. Las diferencias que deberá contemplar la aplicación son el poco tamaño de la pantalla y los caracteres especiales de interacción. Además, se deben considerar la estructura de la aplicación, la sensibilidad al contexto, la interfaz de usuario, el estilo y las esferas de reloj. ¿Cómo se depura? Depurar es un proceso inherente a todo ciclo de desarrollo, y el caso de las aplicaciones de Android Wear no escapa a esa regla. En esta sección, mostramos cómo depurar aplicaciones para prendas inteligentes. Utilizamos dos dispositivos: el reloj LG G Watch R con Nexus 4*. Para más información, leer este artículo

El mercado de los juegos electrónicos ofrece en la actualidad más oportunidades que nunca. Para aprovecharlas, las empresas publican títulos que ofrecen experiencias increíbles a los usuarios, tanto en PC con Microsoft Windows* como en dispositivos móviles. Optimizar los gráficos para los procesadores Intel® Core™ e Intel® Atom™ se está convirtiendo en una necesidad estratégica. Los juegos para dispositivos móviles, que en un principio eran informales y menos elaborados, han evolucionado. Las proyecciones de ingresos en este segmento muestran crecimientos sensacionales. Para ser precisos, la empresa de estudios de mercado Newzoo proyecta que los juegos para dispositivos móviles sustituirán a las consolas como el segmento de juegos con mayores ingresos: 30.000 millones de dólares en 2015, cifra que trepará a 40.900 millones en 2017. Funcom desarrolló LEGO* Minifigures Online (LMO) con las PC 2 en 1 basadas en la arquitectura Intel y las tabletas Android como dispositivos de destino. Se trata de un producto que consolida el prestigio de esta empresa que lleva más de 20 años ofreciendo juegos de alta calidad. Gracias a las optimizaciones que realizaron, el rendimiento gráfico es excepcional en ambas plataformas; perfeccionaron lo logrado en éxitos indiscutidos de Funcom como The Longest Journey (ubicado en el puesto 59 de la lista de MetaCritic de los 100 mejores juegos para PC de todos los tiempos)2, Anarchy Online*, Age of Conan* y The Secret World*. Efectos de sincronización avanzada de píxeles para la tecnología de gráficos de Intel® La generación actual de hardware para gráficos de Intel® prolonga el liderazgo de Intel en innovación informática, incluidos el funcionamiento pleno con DirectX* 12 y la adopción de funcionalidades avanzadas en la próxima generación de juegos. Un ejemplo perfecto es la extensión de sincronización de píxeles para DirectX 11, que hace posibles las operaciones de mezcla programables. Este conjunto de funcionalidades está teniendo una gran aceptación y pasará a formar parte del estándar DirectX 12 (con el nombre Raster Ordered Views); es compatible con hardware gráfico de otros fabricantes (entre ellos, Nvidia Maxwell*) y está habilitado en OpenGL* con la extensión GL_INTEL_fragment_shader_ordering. La extensión de sincronización de píxeles de Intel les da a los desarrolladores control sobre el orden de las operaciones de los sombreadores de píxeles. Se puede utilizar para implementar funciones tales como mezcla personalizada, sombras volumétricas avanzadas y transparencia independiente del orden. Brinda una manera de serializar y sincronizar el acceso a un píxel desde diferentes sombreadores de píxeles y garantizar que los cambios de píxeles sean deterministas. En el hardware Intel®, la serialización se limita a píxeles directamente superpuestos, por lo cual el rendimiento no se modifica para el resto del código. Los siguientes son ejemplos de algoritmos que habilita este conjunto de funcionalidades: Mapas de sombras volumétricas adaptables (AVSM) Transparencia independiente del orden (para Android y Windows) Mezcla programable LEGO Minifigures Online utiliza AVSM para lograr efectos complejos de humo y nubes tanto en Windows como en Android. En las figuras 1 a 4, se muestran comparaciones de las mismas escenas del juego en PC 2 en 1 basadas en procesadores Intel, primero con AVSM deshabilitado y después con AVSM habilitado. La calidad superior de gráficos que se logra al usar AVSM en estas escenas le suma realismo a la experiencia del usuario y la hace más inmersiva. Esta posibilidad también llegará a las tabletas Android basadas en procesadores Intel Atom x5 y x7. Figura 1. Escena de “Actually Hopping Antelope – Nivel 2” con AVSM deshabilitado. Figura 2. Escena de “Actually Hopping Antelope – Nivel 2” con AVSM habilitado. Figura 3. Escena de “Scarlet Serrated Brainiac – Nivel 5” con AVSM deshabilitado. Figura 4. Escena de “Scarlet Serrated Brainiac – Nivel 5” con AVSM habilitado. Para más información sobre estas optimizaciones, visitanos aquí

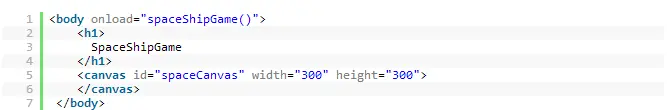

Introducción *Zona de: Desarrolladores Intel Estoy seguro de que la mayoría de nosotros tiene entre sus planes programar un videojuego demente o no tan demente. La mayoría de estos planes quedan en la nada porque muchos piensan que programar videojuegos es excepcionalmente complicado. Eso es relativamente cierto, pero no es tan difícil como algunos creen. Todos aquellos que comprendan la esencia de HTML, CSS y JavaScript* cumplen con los requisitos para comenzar un proyecto simple. * Cómo agregar el elemento canvas a una página web Una de las funcionalidades que más entusiasman de HTML5 es el elemento que se puede usar para dibujar gráficos vectoriales y crear asombrosos efectos, juegos interactivos y animaciones. "Canvas" significa "lienzo" y en la Web se lo define como un área rectangular que permite hacer representaciones dinámicas, y que admite el uso de scripts, de formas bidimensionales e imágenes de mapas de bits. El canvas de HTML5 es ideal para crear materiales visuales fabulosos que enriquezcan las interfaces de usuario, los diagramas, los álbumes de fotos, los cuadros, los gráficos, las animaciones y las aplicaciones de dibujo integradas. Este elemento funciona con bibliotecas de JavaScript y CSS3, lo cual permite crear juegos y animaciones interactivos basados en la Web. * El código elemental para usar y configurar un canvas se ve así: Esto se parece al elemento ; la diferencia es que no tiene los atributos src y alt. El elemento solo tiene dos características: ancho (width) y altura (height). Si las representaciones parecen no ser precisas, se puede intentar designar explícitamente el ancho y la altura en los atributos de en lugar de con CSS. Los valores predeterminados de los atributos de ancho altura son de 300 y 300, respectivamente. Se usará la id para inicializar el canvas por medio de JavaScript. El texto junto al signo de igual se usará como llamada de respuesta cuando el navegador móvil no lo admita. * Dibujo del fondo y la nave espacial de un juego, con canvas de HTML5 y JavaScript La variable "canvas" crea el canvas que necesitamos para dibujar los objetos gráficos, y la variable "ctx" retiene el contexto de representación. En este caso es un objeto gráfico bidimensional. Este contexto contiene los métodos elementales para dibujar en el canvas, tales como arc(), lineto() y fill(). A continuación pintamos el fondo de negro, colocamos sobre él asteroides luminosos y dibujamos la nave con el objeto de contexto. Cuando ejecutamos el código, la pantalla se ve como la imagen de la Figura 1. Figura 1 Ahora vamos a mover la nave de nuestro juego con el elemento canvas de HTML5 y JavaScript. El ejemplo de código está compuesto por HTML5 y JavaScript, y muestra cómo mover la nave sobre las estrellas. Canvas usa el modo rápido para crear esta imagen animada. Son dos los pasos necesarios para ejecutar esto en el juego. Debemos volver a dibujar la imagen cada vez que la movamos. Luego debemos restablecer el trabajo preliminar (fondo) que se destruyó cuando le dibujamos la nave encima. El código de abajo muestra cómo borrar la imagen de la nave a medida que se mueve y dibujar otra en una ubicación diferente. También muestra cómo evitar y restaurar vistas previas de la nave y el fondo. Canvas no memoriza la trayectoria de dibujo de los píxeles, por eso el ejemplo muestra las maneras óptimas de mantener la trayectoria de cada píxel a medida que se recupera, elimina, mueve y restaura en el código. * Veamos cómo declarar algunas de las variables: * Cómo establecer un bucle de juego para procesar los eventos principales del juego * El código de abajo guarda el fondo anterior para que podamos borrar la nave y luego dibujarla en la nueva ubicación. Así se logra la ilusión de que la nave se ha movido. Para obtener la información de cada píxel de una sección rectangular del canvas, una opción es obtener el objeto de datos de la imagen con la estrategia getimagedata() para la configuración del canvas y después acceder a la información de los píxeles desde la propiedad de información. Cada píxel de la información de la imagen contiene cuatro partes: una roja, una verde, una azul y una alfa. Para jugar, tenemos que llamar al método Loopgame(). Para ello, llamamos al método setInterval. Este último método pide una función o evalúa una expresión a intervalos definidos. A este LoopGame se lo llama en bucles de 20 milisegundos, que se utilizan mucho en los juegos porque con ellos se logran procesos de animación básicos a intervalos fijos. * Animación en canvas La etiqueta <canvas> de HTML permite realizar animaciones de dos maneras: > La habitual y que se utiliza en la mayoría de las animaciones es volver a dibujar toda la pantalla para cada movimiento. Esto funciona bien cuando la superficie de dibujo es sencilla y se cuenta con un procesador rápido. No se recomienda para animaciones de mayor tamaño o más impredecibles. > La segunda manera de lograr movimientos con canvas es la que usamos en el ejemplo de código de este artículo. Es la técnica sugerida para animaciones más grandes o complejas, y es la que se recomienda usar. A pesar de que exige más código para establecerla, se ejecuta mucho más rápido que el estilo de actividad más común. Como este círculo se actualiza cada 20 milisegundos, el ojo humano no llega a ver que la nave se ha borrado, sino que le parece que se está moviendo. Ello reduce el peligro de daño ocular por el parpadeo de la pantalla entre cada movimiento, ya que solo se dibuja una pequeña parte de la pantalla por vez. * Configuramos addEventListner para que controle los eventos táctiles, capture las nuevas posiciones X e Y, y luego ubique la nave donde corresponda. Cuando el usuario presiona o mueve el dedo sobre la pantalla, el evento movespaceShip() se activa de inmediato. Hasta ahora hemos visto cómo dibujar/cambiar el fondo de la nave para nuestro juego. Si golpeamos un asteroide, la nave va a explotar. Para regresar de manera segura a la base, debemos mantenernos apartados de los asteroides o volarlos en pedazos antes de chocar con ellos. Con este fin, podemos usar el elemento canvas para conservar un registro de cada píxel de la pantalla. La primera etapa consiste en generar una representación (una instantánea) de la pantalla en el punto en el cual la nave se está por mover. Esta ubicación ya ha sido calculada con eventTouch.pageX y eventTouch.pageY. La siguiente etapa se trata de probar los datos de la instantánea. Buscamos un valor rojo (255) en un segmento de 4 bytes. Si lo encontramos, hay un asteroide presente. Decimos en un segmento de 4 bytes porque a cada píxel se le asigna un valor de color que consiste en cuatro partes: una roja, una verde, una azul y una alfa. Alfa denota la traslucidez (transparencia). Por ejemplo, un píxel negro está compuesto de 0 % rojo, 0 % verde, 0 % azul y 0 % alfa. Sabemos que mediante el uso de la técnica y el código mencionados antes, podrá convertir en poco tiempo este fragmento de código en un juego de nave espacial con todas las letras. HTML5 es una tendencia a futuro en el mundo del desarrollo de aplicaciones. Intel cree que es importante ayudar a los desarrolladores experimentados a hacer la transición a este enfoque multiplataforma y a los desarrolladores nuevos a entrar rápidamente en ritmo con este enfoque que tanto entusiasmo despierta, para que así puedan desarrollar sus aplicaciones y juegos en casi todas las plataformas informáticas modernas. Hay más recursos a disposición en las páginas Intel HTML5 y Intel Android. +info: ACÁ

Introducción ¿Cómo hace una empresa de desarrollo de juegos independiente para mantenerse vigente y ampliar su mercado? Veamos el caso de la multipremiada Threaks, creadora de BeatBuddy, y hablemos con el codirector ejecutivo Wolf Lang para ver cómo se abren camino en el mundo del desarrollo de juegos. De proyecto estudiantil a proyecto independiente Threaks GmbH es un grupo independiente con sede en Hamburgo dedicado al desarrollo de juegos. Se especializa en la creación de juegos musicales no lineales para la comercialización sustentable de música digital. El primer reconocimiento que obtuvo fue la nominación a “Mejor Proyecto Estudiantil” en los German Videogame Awards de 2011, por una de las primeras versiones de su juego para PC con estilo de juego para consola Beatbuddy. Con la creencia de que los videojuegos son un medio artístico que puede brindar experiencias sin igual creadas por el usuario, idearon el primer juego musical no lineal de acción y aventura, en el cual el usuario puede avanzar o retroceder en una canción. Cada nivel usa una canción y un conjunto de gráficos dibujados a mano diferentes, con una mecánica y un diseño de nivel que depende de la estructura de la canción. La mecánica de juego es diferente para las estrofas (juegos de ingenio y luchas) que para el estribillo (estilo arcade, viajes en el Bubblebuggy). Para Wolf Lang, cofundador de Threaks, Beatbuddy es un juego como Super Mario creado a partir de una composición musical visualmente deconstruida. Beatbuddy pasó por varios prototipos hasta que se pudo encontrar el equilibrio justo entre visualización y mecánica. Ha sido muy complicado poder atraer tanto a los fans de juegos musicales como a los usuarios masivos. En este artículo de Wolf Lang hay un cuadro interesante de las diferentes reacciones de ambos grupos: http://www.makinggames.biz/features/5-reasons-why-music-games-suck,7085.html. El artículo también habla de algunas cuestiones relacionadas con la industria musical a las que tuvieron que dedicar mucho tiempo. Durante los dos años siguientes, Threaks procesó opiniones y mejoró su producto. Wolf considera que el concurso Level Up de Intel le dio un gran impulso a la empresa en la industria de los juegos. Beatbuddy ganó el Intel Level Up Award en 2012 al mejor sonido y a los méritos artísticos. La repercusión y la exposición a los líderes de esta industria hizo entrar a este pequeña empresa independiente en el mundo real de los juegos. Lograron que la versión de preproducción fuera aceptada en Steam y tuvieron más cobertura gratis. Luego, Beatbuddy ganó el premio “Mejor Juego para PC” en PAX East 2013. Expansión a nuevas plataformas con una interfaz de usuario Touch-First Threaks continuó su relación con Intel y juntos comenzaron a expandir el desarrollo mediante la optimización de la interfaz para dispositivos “2 en 1”. Los ingenieros de Threaks desarrollaron y compartieron código para la transición a “2 en 1” en Unity. El código está disponible bajo licencia más abajo. La transición incluye un elemento emergente automático y un conmutador táctil para cuando el sistema pasa a modo de tableta. En la sección de Referencias del final de la nota hay vínculos a más información de transiciones a “2 en 1”. Luego vino una versión para OS X* y iOS*, y tanto el juego como la banda de sonido se vendieron en Apple Store, donde BeatBuddy obtuvo el “Editor’s Choice”. La versión para iPad* fue elegida como mejor juego de 2014 en 6 países. Fueron varias las dificultades que surgieron para pasar a los dispositivos móviles, desde los usuarios que apagan el sonido hasta el poco espacio disponible en disco, porque los archivos de música no comprimida son muy grandes. La mayoría de los juegos usan archivos mp3, pero estos no proporcionan el nivel de información musical que es esencial para una aplicación que utiliza los stems de la música y hace corresponder de manera muy precisa la animación con la música y el ritmo. Además, la parte visual tiene que ser increíble aunque el rendimiento varíe. Por eso, Threaks desarrolló su propia tecnología de sonido (patente pendiente) que hace que las animaciones sean precisas al milisegundo con archivos de sonido interrelacionados con la mecánica del juego. Las nuevas plataformas exigen que se reevalúe toda la interfaz. Threaks dedicó de seis a nueve meses a considerar y crear una interfaz para dispositivos móviles porque no querían agregar botones ni palancas de mando virtuales que hicieran menos natural la manera de jugar. Entonces rediseñaron toda la mecánica del juego para garantizar la fluidez general y utilizaron el complemento gratuito TouchScript. El resultado fue un juego en el cual la experiencia del usuario es100 % táctil e intuitiva: se sigue el dedo del jugador para que pueda controlar al personaje y a la vez disfrutar de los juegos de ingenio rítmicos. ¿Cuáles son las herramientas de desarrollo necesarias para hacer todo esto? Threaks usa Unity* para el desarrollo interplataforma. Dicen que en general diseñan los juegos en papel, anotan las ideas e intercambian opiniones hasta decidir qué hacer. Luego pasan a Unity para la fase de prototipo, con lo cual se aseguran que todo funcione cuando sea interactivo. Cuando se les preguntó sobre la versión para iOS, dijeron que usaron Unity3D para poder desarrollar prácticamente todo en Windows*, y solo necesitaron una Mac* para hacer más compilaciones y pruebas. Hacia Android* El próximo reto de Threaks es llevar el juego a Android. En la conferencia de desarrolladores de juegos Game Developers Conference (GDC) de 2015, Threaks mostrará los resultados obtenidos. Ya hay a la venta en la tienda de Google una versión para dispositivos Android basados en lntel que utilizan el procesador Intel® Atom™ Serie Z3000 para tabletas Android*. ¡Están todos invitados a pasar por el stand de Intel en la GDC 2015 y saludar a Threaks! Wolf destaca que los entusiasmó mucho que los dispositivos Android basados en Intel fueran bastante poderosos. Con gráficos 3D dibujados a mano y una tecnología de sonido complicada, no podrían haber hecho funcionar el juego en los dispositivos del pasado, pero con los nuevos chips y el mayor poder de cálculo, es “asombroso lo que se puede hacer en los nuevos dispositivos… Intel Android es una plataforma muy interesante e importante”. Además, en el caso de Android, tuvieron que lidiar con el menor período de atención de los usuarios de pantallas pequeñas y hacer que el juego se entendiera en 30 segundos. Por lo tanto, agregaron una guía para que el usuario sepa más rápido cómo jugar. Wolf explica que al expandirse a otras plataformas y tamaños de pantalla, descubrieron que los controles históricos de PC no tienen sentido en el mundo móvil y que no todos los juegos móviles pueden pasar a PC. Algunos juegos son demasiado complicados para tabletas y otros, como los que usan ritmos, se pueden en realidad mejorar en los dispositivos móviles. Retribución a la comunidad ¿Cómo pueden llegar al éxito los desarrolladores independientes? Wolf Lang tiene el deseo de que se forme una comunidad independiente europea como la de Estados Unidos. En 2013 ayudaron a crear el Indie Arena en el Gamescon de Alemania, que comenzó con 10 desarrolladores europeos en 2013 y que creció a 18 en 2014. El Indie Arena dio una prueba visual del interés del público de juegos en las aplicaciones independientes y condujo a que los organizadores del Gamescon llevaran el Indie MEGABOOTH a Europa por primera vez en el Gamescon de 2014. Intel ve el valor de estas exhibiciones y patrocina el Indie MegaBooth de la GDC 2015. Threaks también trabajó con el equipo de Humble Bundle, que tradujo por primera vez el escaparate al alemán y presentó a 12 desarrolladores alemanes de juegos independientes. Medios sociales Consejos para pequeños desarrolladores Wolf recomienda a todos los desarrolladores que buscan exposición y buena prensa que inscriban su aplicación en un concurso de Intel. “Se logra que se hable de uno, lo que es muy valioso, y en caso de ganar uno puede conocer a líderes de la industria, ¡lo que es fabuloso!”. Y si se tiene la oportunidad de aparecer en un stand de Intel: “Como pequeño desarrollador, es una gran oportunidad para que un juego tenga exposición. Es difícil pagar un stand, tener semejante cobertura en los medios y hacer contactos… Es una combinación de ventajas caída del cielo". Otros recursos Threaks ha proporcionado el código de clase utility de detección en “2 en 1” para usar en Unity, que se adjunta en este artículo. Contiene una clase MonoBehaviour"TwoInOneUtil" que proporciona una notificación de cambio hacia el modo de tableta o desde ese modo, mediante suscripción al evento "ModeChanged". Es necesario definir un "símbolo de scripting define" adicional denominado "TWOINONE". El código se adjunta al final de este artículo. Intel ofrece: la guía para desarrolladores para pantalla táctil http://software.intel.com/en-us/touch-and-sensors, información sobre desarrollo de aplicaciones para valores altos de dpi para Windows 8, información sobre detección de cambios de factores de forma y cómo escribir aplicaciones que tengan en cuenta el 2 en 1. Microsoft brinda información sobre cambio de escala para diferentes pantallas y compatibilidad con múltiples resoluciones.

Intel anunció hoy que está ayudando al estudio independiente Flying Mollusk a utilizar la tecnología Intel® RealSense™ en su ambicioso juego de horror psicológico “Nevermind*”, que emplea biofeedback. Intel se enteró de Nevermind por medio de Kickstarter junto antes de la conferencia de desarrolladores de juegos GDC de 2014. Después de reunirse con los desarrolladores, haber sido testigo de su visión y pasión por crear un producto revolucionario, Intel se dio cuenta de que la tecnología RealSense era mejor que ninguna otra para ayudarlos a plasmar esa visión. Como Nevermind reacciona a las variaciones del ritmo cardíaco del jugador, la única manera de disfrutar a pleno del juego era usar una banda pectoral voluminosa y bastante incómoda que hiciera contacto con la piel. La tecnología Intel RealSense brinda opciones más cómodas, por eso Intel sugirió emplear la cámara 3D Intel RealSense para medir el ritmo cardíaco. Ahora, un año después y en plena colaboración exitosa con Intel, Flying Mollusk tiene todo listo para dar acceso inicial al juego a quienes lo financiaron por Kickstarter y a determinados asistentes a la GDC. “Creemos que la capacidad de la tecnología Intel RealSense para medir el ritmo cardíaco tiene un potencial sin precedentes para los usuarios de juegos inmersivos” dijo Chuck McFadden, productor de Intel RealSense Games. “¿Qué sucede cuando un juego de horror puede detectar lo asustado y tenso que está el jugador? ¿Qué sucede cuando una complicada guía percibe que el lector está confundido? ¿Qué sucede cuando el jugador está en ese momento “zen” perfecto y el juego lo nota? Antes, las computadoras y los juegos solo comprendían al usuario por intermedio de los botones que presionaba. Ahora, con la tecnología Intel RealSense, pueden comenzar a ver y reaccionar de modo tal que refuerzan la sensación de inmersión y dan un mayor sentido a nuestros pasatiempos preferidos”. Para obtener información más completa sobre las optimizaciones del compilador, consulte nuestro Aviso de optimización.

(antes llamada Tecnología de Informática Perceptual de Intel) Disponible ahora: sea el primero en la fila para crear una experiencia más envolvente. Descargue el SDK de Intel® RealSense™ para Windows* (versión 2014, Gold) y reserve su Kit para Desarrolladores. Creación de aplicaciones que usan los sentidos La oportunidad para los desarrolladores La computadora personal tiene décadas de antigüedad, ¿pero qué tan personal se ha vuelto durante todo ese tiempo? ¿Interactúa usted con su computadora de la misma manera que con su familia o sus amigos? ¿Su computadora comprende su estilo de comunicación? ¿Trabajar y jugar en una computadora es intuitivo, o es engorroso? En Intel, pensamos que se podría mejorar la interacción hombre-máquina y ese es el motivo por el cual los últimos años estuvimos tratando de dilucidar cómo hacer que las computadoras se sientan, justamente, más personales. Con el fin de crear una interfaz que sea realmente natural, en primer lugar tuvimos que hacer que las máquinas percibieran el mundo como lo hacemos nosotros. La combinación de hardware y software que introdujimos se llama tecnología Intel® RealSense™. Esta tecnología comprende cuatro importantes modos de comunicación: las manos, el rostro, la voz y el entorno que rodea al usuario. La cámara 3D Intel RealSense, que puede comprender e interpretar la profundidad casi como un ojo humano, lo hace posible. Si está entusiasmado por ver qué puede hacer la tecnología Intel RealSense, ¡magnífico! Le recomendamos que visite nuestro sitio de tecnología. Si es desarrollador de software, entonces tenemos noticias muy interesantes: el SDK de Intel RealSense hace fácil usar nuestro singular hardware e increíble software para crear sus propias aplicaciones. Otra noticia que le va a interesar aún más: en 2014, la cámara 3D Intel RealSense™ se integrará en ultrabooks, notebooks, equipos 2 en 1 y equipos todo en uno. Desarrolle experiencias que a sus clientes les encantarán En Intel, desbordamos de entusiasmo por la llegada al mercado de cámaras 3D integradas, pero quienes deberían sentirse eufóricos son los desarrolladores de software. En 2012 y 2013, cuando la tecnología Intel RealSense se llamaba informática perceptual, los clientes tenían que comprar una cámara 3D periférica para disfrutar de las aplicaciones que utilizaban esa tecnología. Ahora que hay equipos de Dell, HP, Lenovo, Asus, Fujitsu, NEC y Acer con cámaras 3D integradas, las aplicaciones creadas en el SDK de Intel RealSense funcionarán en una amplia variedad de sistemas, lo que constituye una oportunidad formidable para los desarrolladores. Sabemos que los profesionales del software están entre las personas más creativas del sector tecnológico, por eso estamos impacientes por ver qué usos descubren que nosotros no previmos. Y algo importante: ¿qué funcionalidades admitirá el SDK de Intel RealSense? Un mundo de aplicaciones creativas Uno de nuestros objetivos a medida que avanzamos de la informática perceptual a la tecnología Intel RealSense es asegurarnos de que su implementación sea sencilla para los desarrolladores. No hay que ser un experto en aprendizaje de máquinas ni en algoritmos de seguimiento de manos para incluir gestos en las aplicaciones. Dicho esto, también brindamos acceso total a los datos de profundidad sin procesar, por lo cual los desarrolladores tienen las puertas abiertas para innovar como prefieran. Con esta capacidad de creación al alcance de la mano, hay libertad para aplicar el ingenio a las interfaces y deleitar a los usuarios. Intel se está concentrando en cinco categorías principales de aplicaciones: colaboración inmersiva, juegos, interacción natural, aprendizaje y juegos educativos, y escaneo 3D. Veamos en detalle las categorías y analicemos la tecnología detrás de cada una. Colaboración inmersiva significa que se pueden crear aplicaciones que hacen posible reunirse prácticamente en cualquier lugar. Imagine que necesita hacer una videoconferencia con Bill por una reunión de negocios. Con la eliminación del fondo, puede llamar a Bill desde lo que él podría creer que es una lujosa oficina con aire acondicionado, cuando en realidad usted está sentado a metros de la playa en un complejo vacacional. La eliminación del fondo, que se trata en esencia de una pantalla verde sin pantalla, es una funcionalidad fácil de implementar, gracias al SDK de Intel RealSense. Los juegos van de la mano con los usuarios de la tecnología Intel RealSense que quieren poner en uso todos sus sentidos para participar en un juego y controlarlo. El menú de desarrollo para la tecnología Intel RealSense incluye tanto funcionalidades existentes como nuevas. Se puede usar reconocimiento del habla para tomar el control de las acciones en juegos bélicos tácticos como There Came an Echo, que publicará pronto Iridium Studios. El control de gestos, el análisis facial y el seguimiento de cabeza, manos y dedos también se puede usar para enriquecer o reemplazar métodos de entrada tradicionales y lograr así una precisión sin igual en juegos tales como Head of the Order, otro ganador del Intel® Perceptual Computing Challenge. There Came an Echo usa la voz para controlar juegos bélicos tácticos There Came and Echo es un juego de estrategia en tiempo real controlado por voz, y protagonizado por Will Wheaton, famoso por Star Trek*, Eureka* y The Big Bang Theory*. Actualmente se está desarrollando para sistemas con la tecnología Intel® RealSense™ y se publicaría a mediados de 2014 en Steam*. Fue diseñado desde cero para recibir instrucciones por voz mediante la tecnología Intel® RealSense. Posibilita al jugador, que actúa de comandante de operaciones de una pequeña unidad táctica, usar órdenes de voz para cumplir con objetivos tácticos e incluso interactuar con otros integrantes de la unidad. En este video, Jason Wishnov, director ejecutivo y jefe de arquitectos de Iridium Studio, habla del proceso de desarrollo de There Came and Echo. Contar historias interactivamente agrega una nueva dimensión a la manera normal de contarlas, al combinar el mundo virtual con el real. Con el uso de técnicas de realidad aumentada, podemos personalizar, dramatizar y agregar contenido emocional a las aplicaciones; para ello, creamos un mundo virtual tridimensional y hacemos que los elementos de la historia dependan de la actividad del usuario. Una aplicación basada en un libro infantil podría incluir a una niña jugando con una muñeca. Al incorporar funcionalidades de realidad aumentada a esta aplicación, podemos hacer que la muñeca virtual sonría a la niña, imite sus expresiones faciales o incluso le diga “Hola” cuando la reconozca. La pequeña que juegue con esta aplicación sacará más provecho de formar parte de esta experiencia inmersiva si usa todos los sentidos para interactuar con el contenido. Con el agregado de la capacidad de detectar no solo al usuario sino al entorno, podemos representar el contenido de manera fotorrealista y crear así un entorno local con el que la niña interactúe. La muñeca virtual puede saltar a la mesa real y caminar a medida que la niña interactúa por medio de gestos. Experimente la manera interactiva de contar historias con un recorrido por Uncle Jeffrey’s Funky Farm Es muy interesante hablar de la realidad aumentada y de contar historias de manera interactiva, pero mejor es que eche un vistazo por sí mismo: visite Uncle Jeffrey’s Funky Farm, un proyecto de demostración de Intel CES 2014. En esta granja, los niños pueden participar de una experiencia mágica y ver algunas de las posibilidades casi infinitas de la realidad aumentada. Cae nieve, se forman arcoíris y las ovejas balan mientras el tío Jeffrey lleva al usuario a recorrer la granja. Todo aquel que visite la granja aprovechará más el formar parte de esta experiencia inmersiva porque usará todos los sentidos para interactuar con el contenido. Interacción natural Las aplicaciones con interacción natural ponen el control literalmente en la punta de los dedos de los clientes. Al usar las posibilidades de la tecnología Intel RealSense, como el seguimiento de manos y dedos, la detección de puntos de referencia faciales y el reconocimiento del habla, se pueden seguir con precisión las manos y los dedos, y usar gestos simples o manipulaciones 3D precisas para controlar las aplicaciones. Seguimiento de manos y dedos: esta funcionalidad trabaja entre 0,2 y 1,2 m; proporciona posiciones 3D de lugares puntuales de las puntas de los dedos, la palma y el antebrazo, que se pueden emplear para controlar aplicaciones. En 2013, el SKD solamente admitía una cantidad muy limitada de puntos de referencia de dedos y manos, pero en 2014 el SDK Beta admite 22 puntos de seguimiento de articulaciones y manos, lo cual mejora la precisión y la resolución. Así es posible ofrecer nuevos usos de aplicaciones con un control más granular de la interfaz gráfica de usuario y mejor seguimiento de las puntas de los dedos y la orientación de las manos, con lo cual las interacciones se vuelven más sofisticadas. En 2013 (izq.), el SDK reconocía solamente las puntas de los dedos, el centro de la palma, el punto de agarre y el antebrazo. En 2014 (der.), puede seguir 22 puntos. Seguimiento de gestos: identifica 8 posturas estáticas y 6 gestos dinámicos que crean movimientos y gestos de las manos en el aire y que sirven de vía natural para interactuar con el software. Como ejemplos de posturas estáticas podemos mencionar los pulgares arriba y el signo de la paz, mientras que un movimiento circular o de ola es un gesto dinámico. Análisis facial: con el SDK de Intel Perceptual Computing, el análisis facial se limitaba a la detección frontal bidimensional y a 7 puntos de referencia, incluidos los ojos, la boca y la nariz, lo que permitía comparar el rostro presente con una biblioteca de referencias de rostros ya almacenados. El análisis facial 3D ha mejorado en 2014 y ahora admite profundidad tridimensional, con 78 puntos de referencia que aumentan la exactitud, detección facial 3D real y alabeo, cabeceo y guiñada del rostro. Así es posible identificar la presencia de rostros dentro de los límites de la cámara, y la ubicación de los rasgos de la cara. También permite seguir y reconocer posturas de la cabeza, y reconocer expresiones y emociones tales como enojo, sorpresa y frustración, a partir de esos puntos de referencia faciales. En 2013 (izq.), el SDK admitía solo 7 puntos y detección 2D. En 2014 (der.), admite 78 puntos de referencia, profundidad para detección 3D real, y alabeo, cabeceo y guiñada. Reconocimiento del habla: posibilita crear aplicaciones que el usuario controle y con las cuales interactúe naturalmente con la voz. Además de permitir dar órdenes y controlar, también incluye dictado y traducción de texto a voz en nueve idiomas. El reconocimiento del habla es una funcionalidad muy potente para controlar aplicaciones y juegos sin usar las manos, como vimos antes con There Came an Echo. Capturar y compartir Con el SDK de Intel RealSense, proporcionamos la capacidad de escanear, modificar, imprimir y compartir objetos pequeños. Funciona así: como Intel RealSense utiliza una cámara 3D, se puede girar un objeto frente al dispositivo informático para construir una grilla 3D. Si se le superpone color a la grilla, se obtiene una réplica digital imprimible que se puede compartir. ¿Quiere crear soldados para que jueguen sus hijos? No hay problema. ¿Desea cargar un modelo 3D de la tetera que tiene a la venta por internet? Es 100 % posible. Además, estamos abstrayendo la tecnología para que los desarrolladores puedan incorporar el escaneo 3D a sus propias aplicaciones. Programas para desarrolladores: el resto de la oportunidad Hasta ahora hemos hablado de dos partes de la oportunidad que ofrece a los desarrolladores la tecnología Intel RealSense en 2014: un mercado en crecimiento y un SDK pleno de funcionalidades. Hay una tercera parte que es igual de importante: los programas que ha creado Intel para recompensar a los desarrolladores, asegurarse de que sus procesos de desarrollo sean exitosos, y exhibir y vender sus productos. La clave de todo esto será un nuevo Centro de Recursos para Desarrolladores de la Tecnología Intel® RealSense™, el único lugar al que necesitarán acudir los desarrolladores para aprender acerca de esta tecnología, descargar el SDK, pedir un Kit de Cámara Intel RealSense para Desarrolladores, participar en competencias como el App Challenge y en programas educativos, y ver una exhibición completa de demos y aplicaciones 100 % funcionales. Intel® RealSense™ App Challenge 2014 es la continuación del sumamente exitoso 2013 Intel Perceptual Computing Challenge. En la Fase de Concepción, a los desarrolladores se les dio información general del SDK y la cámara 3D de Intel RealSense antes del envío de las propuestas de solicitud para demos en cinco categorías: juegos, aprendizaje y juegos educativos, interacción natural, colaboración/creación inmersiva e innovación abierta. Se han seleccionado cientos de finalistas en esta fase para que continúen hacia la Fase de Desarrollo de Aplicaciones, en la cual recibirán un Kit de Cámara Intel RealSense para Desarrolladores y tendrán aproximadamente 10 semanas para terminar su demo. Los finalistas compiten por premios que suman USD 1.000.000 en efectivo y oportunidades de comercialización. Para obtener información más completa sobre las optimizaciones del compilador, consulte nuestro Aviso de optimización.

Skate con IoT, escaneo 3D, rotación de cubos con Unity, y mucho más. Expertos, innovadores y Black Belts de la Zona Intel® de Desarrolladores colaboran con cientos de artículos y publicaciones de blog todos los meses. Hemos reunido las historias de desarrolladores de software, desde ejemplos de código hasta guías prácticas, más populares para que nadie se pierda nada. 1. Escaneo 3D con Intel® RealSense™: Cómo escanear y luego preparar para Blender y Unity Son cuatro pasos, en los que se utiliza el SDK más reciente para la cámara Intel® RealSense™ F200 con escaneo 3D. Es una funcionalidad asombrosa que posibilitará a los desarrolladores y los artistas digitales escanear objetos del mundo real para usarlos en sus proyectos, mediante el uso de Unity. 2. Un skate conectado a Intel® Edison Este video enseña a conectar un skate a la placa Intel® Edison y registrar los movimientos en un gráfico. 3. Entrevistas en video: Innovadores de Software de Intel® en la GDC 2015 Nuestros Innovadores de Software muestran sus proyectos más recientes con la tecnología Intel® RealSense™ en la Conferencia de Desarrolladores de Juegos (GDC) de 2015. 4. 5 mitos sobre los hackatones y la comunidad Maker Es posible que quien nunca haya asistido a un hackatón crea que uno o más de estos mitos sobre la comunidad Maker son ciertos. Grace demuestra que cada uno de ellos está lejos de la verdad. 5. Presentamos la serie de procesadores SoC Intel® Atom™ x3 (nombre clave “SoFIA”) Para descubrir la plataforma Intel® Atom™ x3 y las funcionalidades que interesan a los desarrolladores de aplicaciones móviles. 6. Guía de compatibilidad con la arquitectura Intel® para proveedores de middleware Android* Con más de 200 nuevos dispositivos basados en la arquitectura Intel®, la compatibilidad con dispositivos x86 es cada vez es más importante para los proveedores de software middleware. Esta guía es ideal para aprender más sobre compatibilidad con el proveedor de middleware. 7. Rotación de un cubo con Unity* Toolkit y la tecnología Intel® RealSense™ ¿A quién no le interesa aprender a rotar un cubo virtual con los movimientos de la mano? El objetivo de esta guía es usar Unity Toolkit para crear una aplicación simple de Intel® RealSense™. 8. Funcionamiento fuera de línea y sincronización de datos en una aplicación para Android* En este magnífico artículo se explican las piezas, el adaptador de sincronización y el autenticador, además de cómo usar las notificaciones de mensajería de Google Cloud para desencadenar la sincronización de datos con un servidor back-end. 9. Cómo compartir superficies entre OpenCL™ y DirectX* 11 en Intel® Processor Graphics Esta guía muestra cómo crear superficies compartidas entre OpenCL y DirectX 11. 10. Acceso a WiFi en Intel® Galileo con Linux Yocto* ¿Necesita configurar WiFi en una placa Intel® Galileo? Este artículo lo guiará por los pasos de configuración con Yocto* Linux. ¡Atención que habrá otras 10 mejores historias de desarrolladores el próximo mes! Para obtener información más completa sobre las optimizaciones del compilador, consulte nuestro Aviso de optimización.