¿cómo son capaces de detectar las cámaras dónde hay una cara? ¿Te has parado a pensarlo?

Cuando pulsamos el disparador de nuestra cámara a medio camino, el AF (autofocus) y el AE (autoexposure) “examinan” los elementos que se encuentran dentro del cuadro y nuestra cámara los analiza.

De esta forma es cómo calculan los modos automáticos dónde deben hacer foco, cuál es la exposición correcta para ese punto o qué velocidad ISO es la adecuada para esas circunstancias.

En los últimos tiempos, los fabricantes de cámaras han incluido un nuevo parámetro en el análisis: el reconocimiento facial. ¿Cómo una cámara puede detectar si en una escena hay caras? Pues sencillo, a la hora de analizar los datos que envían el AF y el AE la cámara los contrasta con una base de datos de patrones de caras.

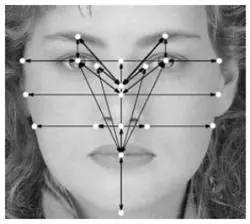

¿Patrones? Sí, las cámaras contemplan miles de estructuras faciales y la posición relativa de los diferentes elementos que configuran la cara:

La estructura de los ojos y de la nariz.

La distancia entre los ojos y la nariz.

El tamaño y la forma de la cara.

La temperatura de color de la piel.

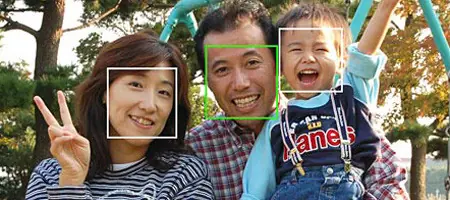

De esta manera, cuando detectan algo que cumple el patrón lo señalan, normalmente a través del LCD, y fijan el foco en ello. Y lo hacen ya sea una persona, la foto de una persona, un cuadro, una escultura, etc. Sí, se puede “engañar” al sistema con representaciones de caras, aunque no con las caras de animales (en Xataka Foto experimentamos hasta límites insospechables).

Algunos modelos pueden llegar a detectar hasta 10 caras dentro del cuadro, actuando para hacer lo posible porque todas salgan bien enfocadas. Dependiendo de los modelos este proceso lo harán de una manera o de otra.

Lo más común es que se le de prioridad de enfoque a la figura más centrada y se tome ésta como referencia tanto de foco como de valores para la exposición. La cámara procurará exponer bien el resto tambien, siempre que sea posible.

FUENTE